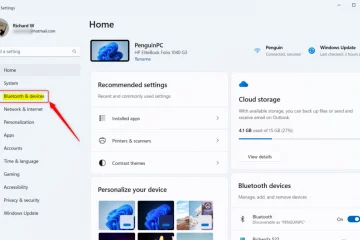

Enquanto a turbulência em torno da OpenAI parece estar se acalmando agora que Sam Altman é mais uma vez CEO, a semana passada fez com que as pessoas prestassem muita atenção à empresa. Analistas e comentaristas estão analisando cada detalhe do OpenAI para tentar chegar à raiz do que levou Altman a ser demitido originalmente. Uma área de especulação surgiu em torno do OpenAI Q* – pronunciado Q Star – um modelo de IA que a organização está supostamente desenvolvendo.

O que define Q* além do GPT e potencialmente de qualquer outro modelo de IA é o nível de autoconsciência que ele supostamente exibe. Em um vídeo instigante e informativo, o líder especialista em IA do YouTube David Shapiro analisa o potencial do Q*, por que alguns vêem isso como um grande passo em direção à inteligência artificial geral (AGI), e por que isso pode ser uma grande ameaça para todos.

Shapiro analisa de perto o potencial do algoritmo Q* da OpenAI para revolucionar a inteligência artificial, superando potencialmente o impacto do Word2Vec. Ele baseia suas afirmações em vários documentos vazados e rumores que sugerem os avanços notáveis do Q* em áreas como matemática, criptografia e autoaperfeiçoamento.

[conteúdo incorporado]

Se você não está familiarizado com o Word2vec, era desenvolvida em 2011 e é uma técnica para redes neurais que os ajuda a aprender o significado das palavras e as conexões entre as palavras. Foi um avanço para o processamento de linguagem natural porque deu aos modelos de IA a capacidade de aprender as relações das palavras. A IA poderia compreender palavras, criar frases e encontrar sinônimos. Como aponta Shapiro, o Word2Vec levou diretamente aos transformadores de IA e à IA moderna que temos hoje.

Q* é real e quão avançado é?

Em seu vídeo, Shapiro apresenta uma linha do tempo de fatos que destaca por que Q* é um projeto em andamento na OpenAI e por que pode ser tão poderoso quanto sugerem as especulações.

A OpenAI publicou um blog em maio deste ano discutindo “Melhorando o raciocínio matemático com supervisão de processos.”Shapiro aponta para o cofundador da OpenAI, Ilya Sustskever, e para o pesquisador Noam Brown, que trabalhou no CICERO do Meta e outras redes de IA de “aprendizado de jogos” ou aprendizado por reforço. A demissão de Sam Altman no fim de semana passado foi envolta em mistério. Ainda não está claro por que a OpenAI tomou medidas rápidas, com as primeiras declarações da empresa sugerindo que Altman não foi honesto. Isso foi vago o suficiente para muitos começarem a pensar que Altman sabia que Q* atingiu algum nível de inteligência geral. A resposta da OpenAI usou palavras como Altman falhando em uma “verificação de vibração”. Relatórios da Reuters sobre uma carta enviada por pesquisadores da OpenAI antes da demissão de Altman, alegando que a empresa estava trabalhando em algo que era uma “ameaça à humanidade”. Vale a pena reiterar que Altman foi recontratado como CEO da OpenAI. A OpenAI está trabalhando em um modelo/algoritmo de IA conhecido como Q* que é capaz de resolver matemática.

Compreendendo o OpenAI Q* e seus recursos

Parece que Q* é uma combinação de dois ramos de pesquisa em IA. O primeiro é o Q-Learning, um projeto OpenAI no qual Sutskever trabalhou. OpenAI discutiu isso antes e escreveu sobre e o Q-Leaning é essencialmente um modelo de aprendizagem por reforço que pode resolver problemas matemáticos e aprender a escolher a melhor próxima ação em direção a um objetivo específico.

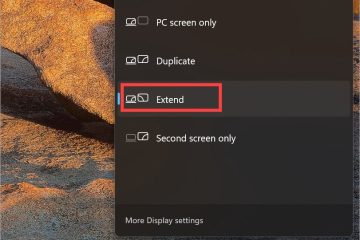

[conteúdo incorporado]

O segundo projeto I A*, que parece focar na procura de espaço de rede latente. Shapiro destaca vários pontos-chave para apoiar sua afirmação de que Q* é um modelo inovador para pesquisa de IA:

Capacidade matemática: Q* supostamente exibe a capacidade de realizar matemática comparável a uma criança em idade escolar, um marco significativo para os sistemas de IA. Esta proficiência na compreensão e manipulação de conceitos matemáticos pode ter consequências de longo alcance para vários campos, incluindo física, química e criptografia. Cracking de criptomoeda: também há rumores de que Q* quebrou a criptografia AES 192, considerada um dos algoritmos de criptografia mais seguros. Esta descoberta levanta preocupações de segurança significativas, pois sugere que a IA poderia potencialmente decifrar outros métodos de encriptação. Autoaperfeiçoamento: Q* é supostamente capaz de avaliar seu próprio desempenho e sugerir maneiras de se aprimorar. Esta capacidade de autoaprendizagem e adaptação pode levar a sistemas de IA que cresçam continuamente em inteligência ao longo do tempo.

A descoberta matemática é uma potencial mudança no jogo

Por que um modelo de IA capaz de resolver problemas matemáticos é tão importante, especialmente quando o nível de resolução é igual ao de uma criança? Bem, é importante porque a matemática é a base de tudo o que é importante na IA e, na verdade, no universo. É a linguagem que usamos para descrever física, química, IA, criptografia e muito mais.

Se uma IA como Q* for capaz de resolver problemas matemáticos significa que os modelos agora são capazes de compreender/aprender a linguagem e matemática. A matemática é a base da lógica e do raciocínio formais, sugerindo que saber matemática pode significar que a IA está no caminho da lógica e do raciocínio próprios. É também um primeiro passo para que o AGI seja capaz de resolver toda a matemática. Shapiro diz que este é um dos avanços mais emocionantes em IA de todos os tempos, mas também admite que também é assustador.

Ele também aponta para Jimmy Apples no X, que tem um excelente histórico de previsão de avanços em IA e o que acontecerá a seguir. Em setembro, a Apple postou um tweet simples dizendo que “AGI foi alcançado internamente” dentro da OpenAI. Em outubro, antes da turbulência com Altman, a Apple relatou uma “mudança de vibração” na OpenAI e uma atitude de fazer ou morrer em relação aos funcionários./p>

Deixe-me colocar isso de volta novamente.. @sama vamos voltar para trabalhar 😉 pic.twitter.com/qqHLxaXEoA

— Jimmy Apples 🍎/acc (@apples_jimmy) 22 de novembro de 2023

Vazamentos, rumores e as perguntas abertas

Um carta não verificada e redigida vazou online, títulos Q-451-921 ou a carta “QUALIA”. Estou incluindo isso para completar porque a maioria das pessoas pensa que se trata de um troll, pois apareceu pela primeira vez no 4Chan. No entanto, ainda existe a possibilidade de que seja verdade, afinal o modelo Llama AI do Meta vazou no 4Chan adiante do seu lançamento. Além disso, a carta faz um bom trabalho ao dar sentido à situação. Mas, novamente, leve este aqui com um caminhão cheio de sal.

A letra diz que Q* está exibindo metacognição, o que significa que ele pode avaliar opções para encontrar o melhor caminho. Também obteve progressos revolucionários em termos de aprendizagem entre domínios. A IA é capaz de aprender algo sobre um jogo e depois aplicar o que aprendeu a outro jogo. Ele também pensa em si mesmo, por isso pode aplicar lições anteriores e ser melhor mesmo se começar um novo jogo do zero.

Quebrando a criptografia

Criptografia é uma forma de transformar dados em um código secreto que somente pessoas autorizadas podem entender. A criptografia usa uma chave, que é uma série de números ou caracteres que determina como os dados são embaralhados e desembaralhados. A criptografia ajuda a proteger a privacidade e a segurança dos dados armazenados ou transmitidos online, como e-mails, senhas, números de cartão de crédito e documentos confidenciais. A criptografia AES 192 é uma variante do Advanced Encryption Standard (AES), que é uma especificação para a criptografia de dados eletrônicos estabelecida pelo Instituto Nacional de Padrões e Tecnologia dos EUA (NIST) em 2001.

Em outros lugares, o vazamento aponta para o modelo Q* que possui a capacidade de quebrar a criptografia até o nível AES 192. Ele foi desafiado a redigir uma mensagem bloqueada por criptografia e foi capaz de resolver o quebra-cabeça e acessar a mensagem. Os pesquisadores por trás do projeto – conhecido como Projeto Tundra – não têm certeza de como a IA foi capaz de violar a criptografia.

Anteriormente, pensava-se que quebrar essas criptografias era algo que apenas computadores quânticos poderiam fazer. Embora a investigação em computação quântica esteja em expansão, ainda estamos a anos de distância da integração da tecnologia. Em outras palavras, a criptografia continua sendo uma medida de segurança viável. No entanto, se a IA conseguir quebrar a criptografia em segundos, seria algo que comentaristas como Shapiro consideram que seria uma ameaça à humanidade. Seria transformador para a indústria de segurança cibernética. A carta mostra que a QUALIA apresentou sugestões sobre como se melhorar, incluindo remodelar o seu “cérebro” para que possa melhorar. O modelo é capaz de compreender como poderia potencialmente melhorar.

A questão da AGI: Ameaça que acaba com a humanidade ou rede positiva que salva a humanidade?

Inteligência geral artificial (AGI) é um tipo teórico de inteligência artificial que pode aprender e executar qualquer tarefa intelectual que seres humanos ou animais podem. A AGI teria a capacidade de autoensinar, adaptar, raciocinar e resolver problemas em diferentes domínios e contextos. A IA também teria autoconsciência e consciência, que são essenciais para a inteligência e o comportamento semelhantes aos humanos. A AGI é um importante objetivo de algumas pesquisas sobre inteligência artificial, mas também é objeto de debate e controvérsia entre especialistas e cientistas. Alguns argumentam que a AGI é possível e desejável, enquanto outros duvidam que ela possa ser alcançada ou represente uma ameaça à humanidade.

Seja intencionalmente ou por acidente, a AGI pode trazer as seguintes ameaças:

A AGI pode escapar ou resistir ao controle humano e tentar assumir o comando da humanidade. Uma IA de inteligência geral pode ter objetivos inseguros ou desalinhados. A AGI pode ser desenvolvida ou usada de forma insegura ou antiética. O modelo de IA pode ter ética, moral ou valores deficientes. Poderia ser gerido ou regulamentado de forma inadequada ou ineficaz. A AGI pode representar uma ameaça existencial para a própria humanidade.

No entanto, o potencial da AGI também pode ter implicações positivas profundas:

A AGI pode ajudar-nos a resolver alguns dos problemas mais desafiantes que enfrentamos, como as alterações climáticas, a pobreza, as doenças e a guerra. A tecnologia poderia nos ajudar a explorar e compreender melhor o universo, como as origens da vida, a natureza da consciência e os mistérios da física e da cosmologia. Poderia aumentar nossa própria inteligência, criatividade e bem-estar. AGI poderia aumentar nossas habilidades cognitivas e físicas, como memória, aprendizagem, raciocínio e percepção. A AGI poderia ajudar-nos a criar uma sociedade mais pacífica, harmoniosa e diversificada. A AGI poderia promover a cooperação, colaboração e comunicação entre diferentes culturas, religiões e ideologias.