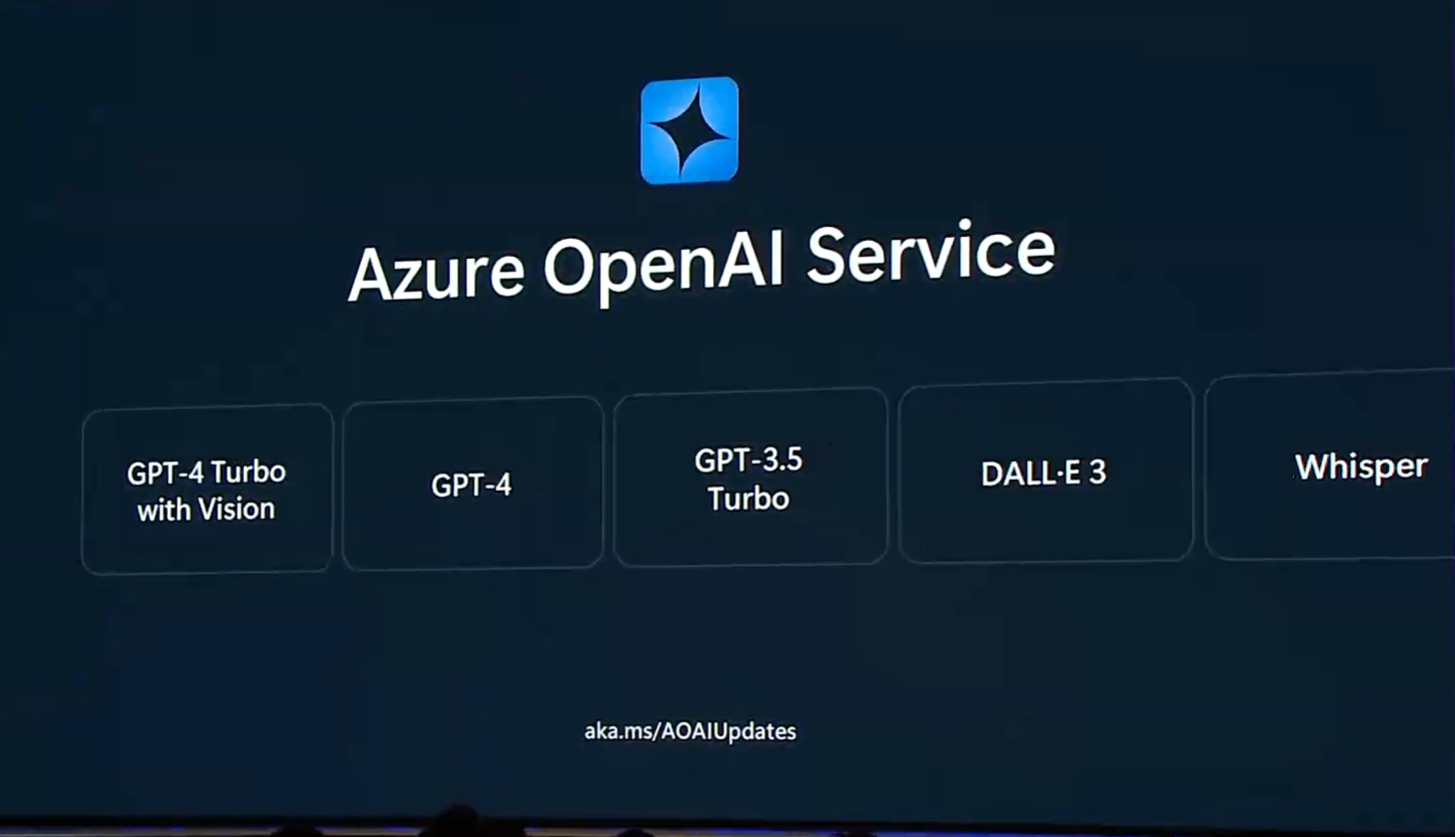

A Microsoft entrou com uma ação federal contra um grupo não identificado de cibercriminosos acusados de usar chaves de API roubadas para contornar protocolos de segurança em seu serviço Azure OpenAI.

De acordo com a reclamação arquivado no Tribunal Distrital dos EUA para o Distrito Leste da Virgínia, o grupo, conhecido como Does 1–10, supostamente desenvolveu e distribuiu ferramentas para explorar sistemas da Microsoft e gerar conteúdo prejudicial em violação de suas políticas.

As ações legais incluem violações da Fraude e abuso de computador (CFAA), a Lei de Direitos Autorais do Milênio Digital (DMCA) e a Lei de Organizações Corruptas e Influenciadas por Racketeers (RICO).

A gigante da tecnologia alega que o grupo operava um sofisticado esquema de hacking, monetizar o acesso não autorizado ao Azure OpenAI Service distribuindo software personalizado, incluindo um aplicativo do lado do cliente conhecido como “de3u” e um sistema de proxy reverso denominado “proxy reverso oai”.

Essas ferramentas permitiram que os usuários explorassem credenciais roubadas e contornassem as medidas de segurança avançadas da Microsoft.

Relacionado: Microsoft corta acesso ao Azure OpenAI para desenvolvedores chineses

>

A investigação da Microsoft começou em julho de 2024, quando descobriu que chaves de API – identificadores exclusivos que autenticam solicitações de usuários – emitidas para clientes legítimos do Azure OpenAI estavam sendo usadas para acessar seus sistemas sem autorização.

A empresa atribuiu a atividade a uma operação coordenada visando vários clientes, incluindo diversas empresas sediadas nos EUA.

“A maneira precisa pela qual os Réus obtiveram todas as chaves API usadas para transportar a má conduta descrita nesta reclamação é desconhecida”, afirmou a Microsoft em seu processo,”mas parece que os réus se envolveram em um padrão de roubo sistemático de chaves de API que lhes permitiu roubar chaves de API da Microsoft de vários clientes da Microsoft.”

Relacionado: ataques cibernéticos baseados em IA aumentam para mais de 600 milhões de incidentes diários

Ferramentas usadas no esquema

As os réus supostamente criaram o software de3u para facilitar o uso não autorizado do serviço Azure OpenAI. Esta ferramenta forneceu uma interface amigável para geração de imagens através do modelo DALL-E da OpenAI.

Ele se comunicava com os sistemas do Azure imitando solicitações legítimas de API e explorando credenciais roubadas para contornar as proteções integradas. O sistema de proxy reverso permitiu ainda mais esse abuso ao redirecionar o tráfego não autorizado através dos túneis Cloudflare, o que obscureceu as atividades e tornou-as mais difíceis de detectar.

A denúncia da Microsoft descreve as ferramentas em detalhes: “O aplicativo de3u dos réus se comunica com o Azure computadores que usam APIs de rede da Microsoft não documentadas para enviar solicitações projetadas para imitar solicitações legítimas da API do serviço Azure OpenAI. O sistema de proxy reverso oai permitiu que os usuários encaminhassem comunicações através de túneis Cloudflare para sistemas Azure e recebessem resultados que contornassem as restrições de segurança.”

As ferramentas também incluíam recursos para retirar metadados do conteúdo gerado por IA, evitando a identificação de suas origens e possibilitando ainda mais o uso indevido

Após a descoberta da Microsoft, os réus supostamente tentaram excluir a infraestrutura principal, incluindo páginas Rentry.org, o repositório GitHub para de3u e elementos do sistema de proxy reverso.

Contexto mais amplo e implicações em todo o setor

O processo surge em um momento em que as tecnologias generativas de IA estão sob maior escrutínio por seu potencial uso indevido. Ferramentas como DALL-E e OpenAI. O ChatGPT transformou a criação de conteúdo, mas também foi explorado para fins de desinformação, desenvolvimento de malware e imagens prejudiciais.

A ação legal da Microsoft ressalta os desafios contínuos enfrentados pelos fornecedores de IA em. protegendo seus sistemas.

A Microsoft enfatizou que as medidas de segurança integradas ao Azure OpenAI Service são robustas, empregando modelos de classificação neural multiclasse e proteções de metadados. Esses sistemas são projetados para bloquear conteúdo prejudicial e rastrear os resultados gerados pela IA até suas fontes.

No entanto, como este caso demonstra, mesmo as salvaguardas mais avançadas podem ser contornadas por determinados intervenientes. “Apesar das várias mitigações de segurança da Microsoft e da OpenAI, malfeitores sofisticados criaram maneiras de obter acesso ilegal aos sistemas da Microsoft”, observa a denúncia.

O grupo visado pela Microsoft não pode estar isolado em suas atividades. alega que os mesmos intervenientes provavelmente exploraram outros prestadores de serviços de IA, refletindo uma tendência mais ampla de abuso no espaço da IA. Isto realça as vulnerabilidades sistémicas das tecnologias de IA generativas e a necessidade de colaboração a nível da indústria para as resolver. ameaças.

Ações legais e contramedidas

Para combater a exploração, a Microsoft invalidou todas as credenciais roubadas e implementou medidas de segurança adicionais para evitar violações semelhantes. também obteve uma ordem judicial para confiscar domínios associados aos réus, incluindo “aitism.net”, que era fundamental para as suas operações.

Essas medidas permitem que a Unidade de Crimes Digitais da Microsoft redirecione as comunicações desses domínios para ambientes controlados para investigação mais aprofundada.

A denúncia também descreve a intenção da Microsoft de buscar indenização por danos e medidas cautelares para desmantelar os réus.’infraestrutura. Ao tomar medidas legais, a empresa pretende estabelecer um precedente para abordar o uso indevido de tecnologias de IA e responsabilizar os atores mal-intencionados.

Implicações para o futuro da segurança da IA

O caso ilustra a crescente sofisticação dos cibercriminosos que exploram sistemas de IA. À medida que a IA generativa se torna mais integrada nas aplicações empresariais e de consumo, os riscos de utilização indevida aumentam. Este incidente destaca a importância do investimento contínuo em tecnologias de segurança e a necessidade de quadros jurídicos para fazer face às ameaças emergentes.

Ao prosseguir com esta ação judicial, a Microsoft não está apenas abordando vulnerabilidades imediatas, mas também reforçando seu compromisso com o desenvolvimento responsável de IA.