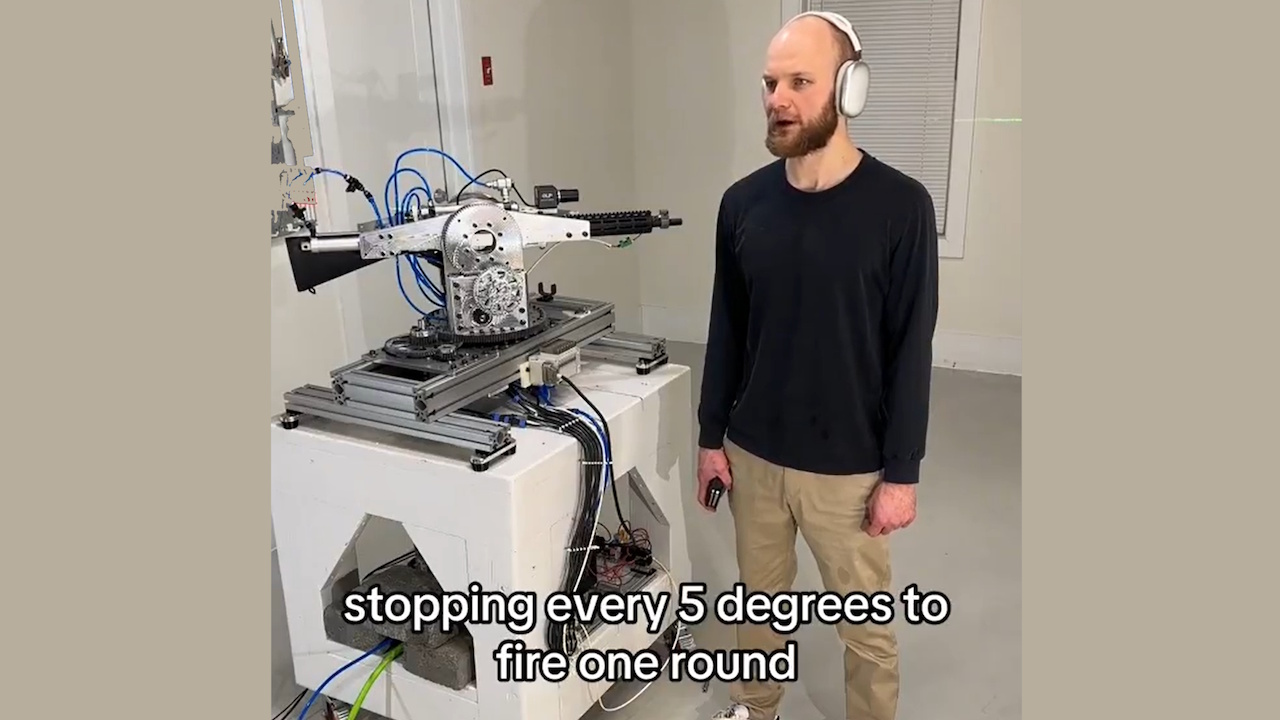

OpenAI đã thu hồi quyền truy cập API của một nhà phát triển đã sử dụng API thời gian thực của họ để hỗ trợ hệ thống Súng trường tự trị. Dự án bao gồm một tháp pháo robot được trang bị súng trường, có thể diễn giải các lệnh bằng lời nói và thực hiện các hành động bắn mô phỏng.

Vụ việc nhấn mạnh mối lo ngại ngày càng tăng về khả năng lạm dụng trí tuệ nhân tạo trong việc phát triển vũ khí tự động, đặt ra các câu hỏi về đạo đức và an toàn.

Nhà phát triển, được biết đến trực tuyến với tên “STS Innovations LLC,” đã chia sẻ video trực tuyến về hệ thống, minh họa chức năng của nó. Trong một clip, nhà phát triển đã đưa ra lệnh, “ChatGPT, chúng tôi đang bị tấn công từ kẻ tấn công. phía trước bên trái và phía trước bên phải”, tháp pháo ngay lập tức phản ứng, xoay và bắn khoảng trống theo các hướng được chỉ định.

Mô phỏng mục tiêu/lửa bằng tia laser #robotics #electronics

Một giọng nói tổng hợp được thêm vào, “Nếu bạn cần hỗ trợ thêm, hãy cho tôi biết.”Buổi trình diễn rùng rợn nêu bật cách các công cụ AI cấp độ người tiêu dùng có thể dễ dàng điều chỉnh cho các mục đích sử dụng có thể gây hại.

Cập nhật trên hệ thống theo dõi #robotics #vision #electronics

OpenAI’s Thực thi chính sách nhanh chóng

OpenAI, được biết đến với các chính sách nghiêm ngặt chống lại việc sử dụng công nghệ của mình trong vũ khí hóa, đã phản ứng kịp thời. Người phát ngôn giải thích:”Chúng tôi chủ động xác định hành vi vi phạm chính sách của mình và đã thông báo cho nhà phát triển ngừng hoạt động này trước khi nhận được yêu cầu của bạn.”

Công ty nhấn mạnh việc cấm sử dụng các công cụ của mình để tạo hoặc vận hành vũ khí hoặc tự động hóa các hệ thống có thể gây rủi ro cho sự an toàn cá nhân.

Quản lý độ giật hệ thống, bản trình diễn nhanh #robotics #electronics #cnc

API thời gian thực , một công cụ được thiết kế cho các ứng dụng tương tác, cho phép nhà phát triển chuyển đổi các lệnh ngôn ngữ tự nhiên thành đầu vào có thể thực hiện được cho tháp pháo robot.

Mặc dù API dành cho các trường hợp sử dụng có lợi, chẳng hạn như nâng cao khả năng tiếp cận hoặc cải thiện tương tác của khách hàng, nhưng việc sử dụng sai mục đích này cho thấy những thách thức trong việc quản lý các công nghệ sử dụng kép.

Liên quan: OpenAI và Anduril Forge Quan hệ đối tác để phòng thủ máy bay không người lái của quân đội Hoa Kỳ

Ý nghĩa rộng hơn đối với AI và vũ khí hóa

Vụ việc này đã làm dấy lên các cuộc tranh luận về đạo đức của vũ khí tự hành. Những hệ thống này, có khả năng lựa chọn và thu hút các mục tiêu mà không cần sự giám sát của con người, đặt ra những thách thức pháp lý và đạo đức phức tạp.

Liên hợp quốc từ lâu đã ủng hộ các quy định chặt chẽ hơn về AI trong chiến tranh, cảnh báo rằng các hệ thống tự trị có thể vi phạm luật pháp quốc tế và làm giảm trách nhiệm giải trình.

Liên quan: Anthropic Hợp tác với Palantir, AWS cho AI trong Tình báo và Quân đội Hoa Kỳ

Một báo cáo của Washington Post gần đây các ví dụ chi tiết đáng lo ngại về việc triển khai AI trong quân đội hoạt động, bao gồm cả tuyên bố rằng Israel đã sử dụng AI để chọn mục tiêu ném bom.

Báo cáo lưu ý: “Tại một số thời điểm nhất định, bằng chứng duy nhất cần có là mục tiêu là nam giới”. Những trường hợp như vậy nêu bật những rủi ro khi dựa vào AI trong các quyết định sinh tử và khả năng xảy ra hành vi bừa bãi. bạo lực.

Liên quan: Mũ nồi xanh đã sử dụng ChatGPT cho vụ nổ Cybertruck, Cảnh sát phát hành nhật ký trò chuyện

Vai trò của OpenAI trong công nghệ phòng thủ

xuống OpenAI mô tả những nỗ lực này mang tính chất phòng thủ, nhưng các nhà phê bình cho rằng chúng góp phần vào việc quân sự hóa rộng rãi hơn các công nghệ AI.

Ngành quốc phòng Hoa Kỳ, được hỗ trợ bởi ngân sách hàng năm gần 1 nghìn tỷ USD, ngày càng dựa vào các công nghệ tiên tiến để đạt được lợi ích. một lợi thế chiến lược. Sự giao thoa ngày càng tăng giữa các công ty AI và ứng dụng quân sự nêu bật những thách thức trong việc cân bằng đổi mới công nghệ với những cân nhắc về đạo đức.

Liên quan: Hiệp hội AI Palantir-Anduril mới nhằm giải quyết các lỗ hổng dữ liệu quốc phòng của Hoa Kỳ

Rủi ro về khả năng tiếp cận và vũ khí hóa tự chế

Việc các cá nhân dễ dàng lạm dụng các công cụ AI và các công nghệ khác như in 3D đã gây ra vấn đề. Cơ quan thực thi pháp luật đã gặp phải các trường hợp tự chế tạo vũ khí, chẳng hạn như hành động bị cáo buộc của Luigi Mangione, người được cho là đã sử dụng các bộ phận in 3D để lắp ráp súng. Những công nghệ này hạ thấp rào cản đối với các cá nhân trong việc tạo ra các hệ thống tự trị có khả năng gây chết người.

Dự án của STS 3D cho thấy cách các công cụ AI dễ tiếp cận có thể được điều chỉnh cho các mục đích ngoài ý muốn. Hành động quyết đoán của OpenAI trong trường hợp này thể hiện cam kết của họ trong việc ngăn chặn việc sử dụng sai mục đích, nhưng nó cũng nhấn mạnh khó khăn trong việc kiểm soát hoàn toàn cách thức triển khai các công nghệ của OpenAI khi chúng được đưa vào phạm vi công cộng.

Vụ việc đặt ra những câu hỏi lớn hơn về việc quản lý Công nghệ AI. Những người ủng hộ quy định nhấn mạnh sự cần thiết phải có các tiêu chuẩn toàn cầu rõ ràng để đảm bảo rằng sự phát triển AI phù hợp với các nguyên tắc đạo đức. Tuy nhiên, việc đạt được sự đồng thuận giữa các quốc gia có lợi ích và ưu tiên khác nhau vẫn là một nhiệm vụ khó khăn.