Nvidia đã công bố một bộ công cụ nhằm giải quyết nhu cầu ngày càng tăng về độ tin cậy, tính bảo mật và độ tin cậy trong các hệ thống AI tổng đài.

Được biết đến với cái tên Vi dịch vụ suy luận Nvidia (NIM), các dịch vụ mới được thiết kế để giúp doanh nghiệp triển khai các ứng dụng AI tuân thủ các nguyên tắc an toàn và ngăn ngừa những kết quả ngoài ý muốn.

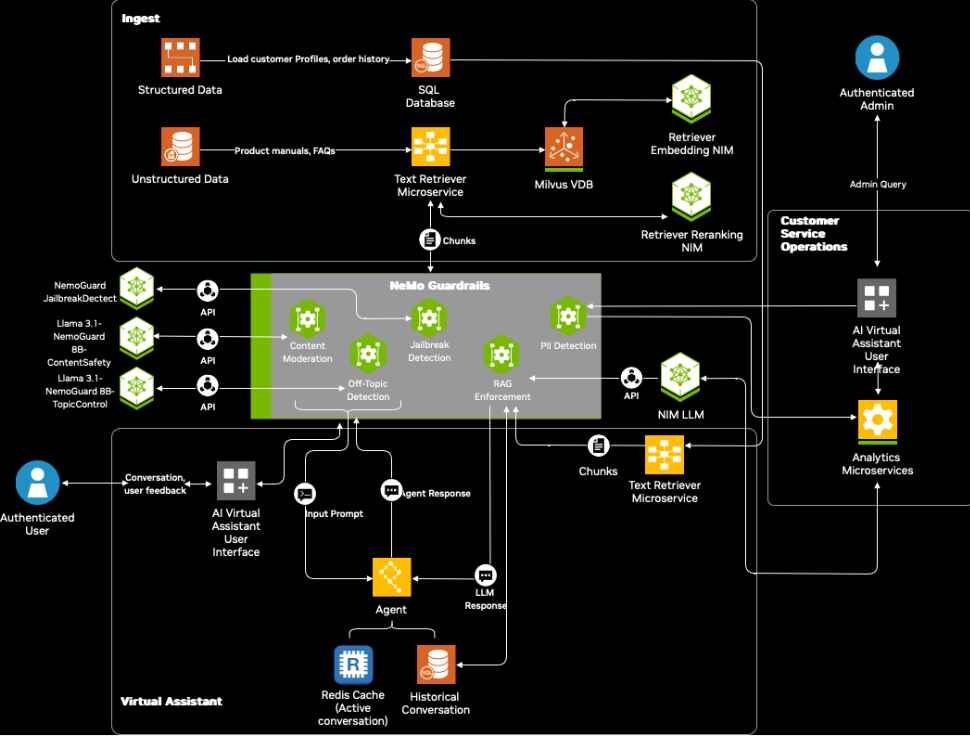

Là một phần của khung NeMo Guardrails, các vi dịch vụ này cung cấp các giải pháp chuyên biệt để kiểm duyệt nội dung, duy trì ranh giới cuộc trò chuyện và phát hiện các nỗ lực vượt qua các biện pháp bảo vệ.

Kari Briski, Phó chủ tịch phụ trách Mô hình AI doanh nghiệp tại Nvidia, đã nhấn mạnh tầm quan trọng của việc đảm bảo an toàn AI trong các ứng dụng ngày nay. Bà tuyên bố trong thông báo chính thức: “Các tác nhân AI đang nhanh chóng chuyển đổi các ngành công nghiệp bằng cách tự động hóa các hoạt động tương tác, nhưng việc đảm bảo tính bảo mật và độ tin cậy của chúng là rất quan trọng”.

[nội dung nhúng]

Giải quyết các thách thức về an toàn AI bằng các dịch vụ vi mô chuyên dụng

Agentic AI, một dạng trí tuệ nhân tạo tự động thực hiện các nhiệm vụ, đã được áp dụng ngày càng nhiều trong các ngành như bán lẻ, chăm sóc sức khỏe và ô tô

Trong khi các hệ thống này nâng cao hiệu quả. và sự tham gia của khách hàng, họ cũng nâng cao những lo ngại về kết quả đầu ra có hại, quyền riêng tư dữ liệu và các lỗ hổng bảo mật đối nghịch của Nvidia nhằm mục đích giảm thiểu những rủi ro này bằng ba giải pháp có mục tiêu:

NIM an toàn nội dung, được đào tạo trên Bộ dữ liệu an toàn nội dung Aegis độc quyền, được thiết kế để phát hiện và chặn các kết quả đầu ra không phù hợp hoặc có hại từ hệ thống AI. Tập dữ liệu này bao gồm trong số hơn 35.000 mẫu do con người chú thích, cho phép các mô hình xác định và phản ứng hiệu quả với nội dung độc hại.

Liên quan: NVIDIA cải tiến AI Agentic với các mô hình Llama và Cosmos Nemotron

Nvidia có kế hoạch cung cấp công khai tập dữ liệu thông qua Hugging Face vào cuối năm nay, mở rộng phạm vi hoạt động của nó khả năng tiếp cận dành cho các nhà phát triển và nhà nghiên cứu.

NIM kiểm soát chủ đề đảm bảo rằng các tương tác do AI tạo ra nằm trong ranh giới xác định, ngăn hệ thống chuyển sang các chủ đề không liên quan hoặc trái phép. Công cụ này đặc biệt hữu ích trong các tình huống dịch vụ khách hàng trong đó cần có những phản hồi nhất quán và phù hợp với ngữ cảnh.

NIM phát hiện bẻ khóa giải quyết mối lo ngại ngày càng tăng về các cuộc tấn công đối nghịch. Bằng cách phân tích dữ liệu đầu vào dựa trên tập dữ liệu gồm 17.000 lần thử bẻ khóa đã biết, vi dịch vụ sẽ xác định và chặn các lời nhắc độc hại được thiết kế để ghi đè các biện pháp bảo vệ hệ thống.

Lưu đồ của bảo mật trợ lý AI ảo thông minh cho dịch vụ khách hàng với NeMo Guardrails (Ảnh: Nvidia)

Lưu đồ của bảo mật trợ lý AI ảo thông minh cho dịch vụ khách hàng với NeMo Guardrails (Ảnh: Nvidia)

Briski nhấn mạnh tính hiệu quả của những công cụ này, ông cho biết: “Các mô hình nhỏ như mô hình trong NeMo Bộ sưu tập lan can cung cấp độ trễ thấp hơn, cho phép tích hợp liền mạch vào các môi trường hạn chế về tài nguyên như nhà kho hoặc bệnh viện.”

Cân bằng hiệu suất và an toàn AI

Một khía cạnh quan trọng Cách tiếp cận của Nvidia là cân bằng nhu cầu về an toàn với nhu cầu về hiệu suất cao. Nvidia cho biết thử nghiệm ban đầu cho thấy các dịch vụ vi mô mới chỉ tăng thêm khoảng nửa giây độ trễ trong khi cải thiện các biện pháp an toàn lên 50%.

Liên quan: NVIDIA công bố Mô hình AI Fugatto dành cho âm nhạc, giọng nói và hiệu ứng âm thanh

Mức độ tối ưu hóa này giải quyết một trong những mối quan tâm phổ biến nhất trong AI doanh nghiệp —đảm bảo thời gian phản hồi nhanh mà không ảnh hưởng đến bảo mật.

“Tùy thuộc vào sự tương tác của người dùng, nhiều LLM hoặc tương tác khác nhau có thể được thực hiện và bạn phải bảo vệ từng LLM hoặc tương tác đó,”Kari Briski nói.

Các trường hợp sử dụng của doanh nghiệp và sự áp dụng trong ngành

Một số doanh nghiệp lớn đã kết hợp NeMo Guardrails vào quy trình làm việc AI của họ để nâng cao độ an toàn và độ tin cậy. Ví dụ: Lowe’s, nhà bán lẻ đồ gia dụng, sử dụng. những công cụ này để cải thiện sự tương tác của khách hàng và đảm bảo tính chính xác của các phản hồi do AI tạo ra

Cerence AI, công ty dẫn đầu về AI trong ô tô, tận dụng các dịch vụ vi mô để hỗ trợ các công nghệ trợ lý trong ô tô “NeMo Guardrails giúp chúng tôi cung cấp. Nils Schanz, Phó chủ tịch điều hành sản phẩm và công nghệ tại Cerence AI giải thích.

Liên quan: Microsoft Cắt giảm đơn đặt hàng Nvidia GB200, ưu tiên GB300 trong bối cảnh sản xuất bị trì hoãn

Ngoài ra, các công ty như Amdocs và Taskus đang sử dụng những công cụ này để tạo ra các hệ thống AI an toàn hơn và đáng tin cậy hơn nhằm tương tác và hỗ trợ khách hàng. Amdocs, nhà cung cấp phần mềm truyền thông và truyền thông toàn cầu, sử dụng NeMo Guardrails để tăng cường tương tác với khách hàng dựa trên AI.

Sáng kiến nguồn mở và ý nghĩa rộng hơn

Để hỗ trợ các nhà phát triển thử nghiệm và nâng cao độ an toàn của AI, Nvidia đã giới thiệu Garak, một bộ công cụ nguồn mở để xác định lỗ hổng trong hệ thống AI.

Garak mô phỏng các tình huống đối nghịch, bao gồm các nỗ lực xâm nhập và bẻ khóa kịp thời, cho phép các tổ chức củng cố mô hình AI của họ chống lại các mối đe dọa tiềm ẩn.

Nhà phát triển cũng có thể truy cập hướng dẫn chi tiết và tham khảo các bản thiết kế để hợp lý hóa việc triển khai NeMo Guardrails và các vi dịch vụ. Những tài nguyên này bao gồm nhiều trường hợp sử dụng khác nhau, từ chatbot dịch vụ khách hàng đến trợ lý tự động trong môi trường bán lẻ và chăm sóc sức khỏe.