Klick Labs, bộ phận nghiên cứu của Klick Health có trụ sở tại Toronto, đã giới thiệu một phương pháp mới để phân biệt giữa các clip âm thanh do con người tạo ra và do AI tạo ra. Sự phát triển này diễn ra trong bối cảnh nội dung deepfake gia tăng, bao gồm video, âm thanh và hình ảnh do AI sản xuất bắt chước người thật.

Sự gia tăng của deepfake đã được đẩy nhanh nhờ sự ra đời của các chatbot AI tiên tiến, hiệu suất cao các trình tạo và sao chép giọng nói chất lượng như các trình tạo và sao chép giọng nói do Elevenlabs và Truecaller cung cấp. Những nhân vật cấp cao như Taylor Swift, Tổng thống Joe Biden và Giáo hoàng đều là mục tiêu của những hành vi giả mạo tinh vi này. Europol đã dự đoán rằng vào năm 2026, có tới 90% nội dung trực tuyến có thể được tạo ra bằng phương pháp tổng hợp , một cảm xúc được lặp lại bởi Cơ quan tình báo an ninh Canada, đã coi tình hình này là một mối đe dọa đáng kể.

Các vụ lừa đảo nhân bản giọng nói gần đây đã xảy ra nhấn mạnh sự cấp thiết của việc phát triển các phương pháp phát hiện deepfake đáng tin cậy. Đáp lại, Meta đã đưa ra các nhãn bắt buộc cho nội dung do AI tạo ra và Ủy ban Truyền thông Liên bang đã ra phán quyết rằng giọng nói giả mạo trong các cuộc gọi tự động là bất hợp pháp. Các chuyên gia về chính sách công và AI đặc biệt lo ngại về nguy cơ gia tăng sử dụng deepfake trong thời gian chuẩn bị cho cuộc bầu cử tổng thống Hoa Kỳ.

Cảm hứng và phương pháp công nghệ

Yan Fossat, Phó chủ tịch cấp cao về Nghiên cứu và phát triển sức khỏe kỹ thuật số tại Klick Labs , lấy cảm hứng từ khoa học viễn tưởng để giải quyết vấn đề này. Tham khảo các bộ phim như “Kẻ hủy diệt” và “Blade Runner”, Fossat và nhóm của ông đã hình dung ra một công cụ tương tự như máy Voight-Kampff, đo lường các phản ứng sinh lý để xác định tính xác thực. Kết quả của phương pháp này đã được xuất bản trên tạp chí truy cập mở JMIR Biomedical Engineering trình bày chi tiết những phát hiện của Klick Labs.

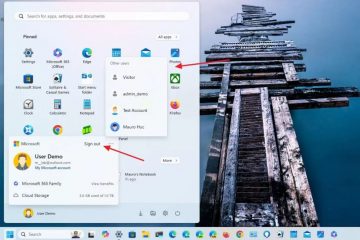

Tại phòng thí nghiệm ở Toronto, Fossat và nhóm của ông bắt đầu thử nghiệm phân tích giọng nói. Họ đã thu thập các mẫu âm thanh từ 49 cá nhân có giọng và phông nền đa dạng, đồng thời tạo ra các clip tổng hợp bằng cách sử dụng trình tạo deepfake. Sau đó, những đoạn clip này được xem xét kỹ lưỡng để tìm dấu ấn sinh học giọng nói—những đặc điểm riêng biệt trong giọng nói tiết lộ thông tin về sức khỏe hoặc sinh lý của người nói.

Klick Labs đã xác định được 12.000 dấu ấn sinh học giọng nói, nhưng phương pháp phát hiện hiện tại của họ dựa trên năm dấu hiệu cụ thể: lời nói độ dài, sự thay đổi, khoảng dừng nhỏ, khoảng dừng lớn và tỷ lệ thời gian dành cho việc nói so với khoảng dừng. Khoảng dừng vi mô là những khoảng dừng ngắn dưới nửa giây, trong khi khoảng dừng macro dài hơn. Những khoảng dừng này xảy ra một cách tự nhiên trong lời nói của con người khi mọi người thở hoặc tìm kiếm từ ngữ.

Những thách thức và triển vọng trong tương lai

Mặc dù đạt được tỷ lệ thành công 80% trong việc xác định các lỗi sâu , Fossat thừa nhận thách thức trong việc theo kịp công nghệ AI đang phát triển nhanh chóng. Ví dụ: những tiến bộ gần đây của OpenAI trong việc tạo ra các âm thanh giả mạo sâu mô phỏng các hơi thở vi mô đã khiến việc phát hiện trở nên phức tạp hơn. Tuy nhiên, Fossat vẫn lạc quan và lưu ý rằng hàng nghìn dấu hiệu sinh học khác, chẳng hạn như nhịp tim, có thể được tận dụng cho các phương pháp phát hiện trong tương lai.

Nghiên cứu của Klick Labs còn mở rộng ra ngoài khả năng phát hiện deepfake. Họ đang tiến hành 16 nghiên cứu khác về các dấu hiệu sinh học và bệnh về giọng nói, bao gồm một nghiên cứu được công bố trên Kỷ yếu của Phòng khám Mayo: Digital Health, chứng minh mô hình AI có khả năng phát hiện bệnh tiểu đường Loại 2 với độ chính xác cao chỉ bằng 10 giây dữ liệu giọng nói. Nghiên cứu này sẽ tiếp tục cộng tác với Bệnh viện Humber River ở Toronto, có khả năng dẫn tới các công cụ chẩn đoán dựa trên điện thoại.