Kuaishou, isang kilalang maikling video platform na nakabase sa Beijing, inihayag ang sariling binuo nitong modelo ng malaking wika na pinangalanang KwaiYii sa publiko noong nakaraang linggo, ayon sa isang ulat mula sa TechNode. Higit pa rito, inihayag din ng kumpanya ang pananaliksik nito sa Spiking Neural Networks at ang pagbuo ng SpikeGPT.

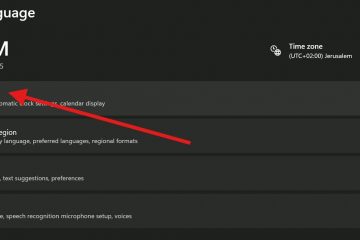

Ang release na ito ay dumating pagkatapos ng beta-testing phase para sa isang serbisyong tulad ng ChatGPT para sa mga Android device na nagsimula noong Agosto 18. Ang serbisyo ng dialog, na ipinagmamalaki ang 13 bilyong parameter na naka-root sa KwaiYii, ay nakikipaglaban sa OpenAI GPT-3.5 sa kapasidad nito para sa paggawa ng content, konsultasyon, at paglutas ng problema.

Ang LLM ay detalyado sa KwaiYii’s GitHub page. Ang pangunahing aplikasyon para sa AI chatbot ng Kuaishou ay ang paghahanap, gamit ang orihinal na nilalaman mula sa platform upang tugunan ang”mga guni-guni”ng AI – mga kamalian na nagreresulta mula sa hindi sapat na pagsasanay sa data.

SpikeGPT: A Leap in Energy Efficiency

Ipinoposisyon ng Kuaishou ang sarili bilang isang pangunahing puwersa sa Pananaliksik at pagpapaunlad ng AI, kapwa sa mga pampublikong mainstream na produkto at mga proyekto sa R&D. Ang KwaiYii ay isang halimbawa ng pangunahing pampublikong AI, habang tinalakay din ni Kuaishou ngayong linggo ang SpikeGPT, isang halimbawa ng mga pagsusumikap sa pananaliksik sa AI nito.

Ang mga hinihingi sa computational ng mga kontemporaryong large language models (LLMs) ay malaki. Gayunpaman, ang Spiking Neural Networks (SNNs) ay natukoy bilang isang mas maraming enerhiya-mahusay na alternatibo sa kumbensyonal na artipisyal na mga neural network, kahit na ang pagiging epektibo ng mga ito sa mga gawain sa pagbuo ng wika ay nananatiling hindi natukoy.

Isang pakikipagtulungan sa pananaliksik sa pagitan ng University of California at Kuaishou Technology ang nagpakilala ng SpikeGPT (sa pamamagitan ng Synced Review), ang inaugural generative spiking neural network (SNN) na modelo ng wika. Ang modelong ito, kasama ang 260M parameter na bersyon nito, ay tumutugma sa pagganap ng deep neural network (DNN ) habang pinapanatili ang mga benepisyong nakakatipid sa enerhiya ng mga computations na nakabatay sa spike.

Ang SpikeGPT ay isang generative na modelo ng wika na nailalarawan sa pamamagitan ng purong binary, mga unit ng spiking activation na hinimok ng kaganapan. Isinasama nito ang pag-ulit sa isang bloke ng transformer, na ginagawa itong tugma sa mga SNN. Hindi lamang inaalis ng integration na ito ang quadratic computational complexity ngunit pinapadali din ang representasyon ng mga salita bilang mga spike na hinimok ng kaganapan.

Maaaring iproseso ng modelo ang streaming ng data ng salita sa bawat salita, na nagpapasimula ng pag-compute bago pa man ang pagbuo ng isang kumpletong pangungusap, habang kinukuha pa rin ang mga long-range dependencies sa masalimuot na syntactic na istruktura. Ang pangkat ng pananaliksik ay nagsama rin ng iba’t ibang mga diskarte upang mapahusay ang pagganap ng SpikeGPT, tulad ng isang binary na hakbang sa pag-embed, isang token shift operator, at isang vanilla RWKV upang palitan ang tradisyonal na mekanismo ng pansin sa sarili.

Pag-unawa sa Spiking Mga Neural Network

Ang mga spiking neural network (SNN) ay isang uri ng artipisyal na neural network na inspirasyon ng paraan ng paggana ng mga biological neuron. Sa mga SNN, ang mga neuron ay nakikipag-usap sa isa’t isa sa pamamagitan ng pagpapadala ng mga spike, na mga maikling pagsabog ng aktibidad ng kuryente. Ang mga spike ay hindi tuloy-tuloy, ngunit sa halip ay nangyayari sa mga discrete time interval. Kabaligtaran ito sa mga tradisyunal na artipisyal na neural network, na gumagamit ng tuluy-tuloy na mga halaga upang kumatawan sa pag-activate ng mga neuron.

Ang mga SNN ay may ilang potensyal na pakinabang sa tradisyonal na mga artipisyal na neural network. Una, ang mga ito ay mas matipid sa enerhiya. Ito ay dahil ang mga spike ay ipinapadala lamang kapag kinakailangan, sa halip na tuluy-tuloy. Pangalawa, mas biologically realistic ang mga SNN. Ginagawa nitong isang mahusay na pagpipilian ang mga ito para sa mga application na nangangailangan ng mataas na antas ng pagiging totoo, tulad ng robotics at medical imaging.

Gayunpaman, may ilang hamon din ang mga SNN. Ang isang hamon ay mas mahirap silang sanayin kaysa sa tradisyonal na mga artipisyal na neural network. Ito ay dahil ang mga spike ay mga discrete na kaganapan, na nagpapahirap sa pag-backpropagate ng error sa pamamagitan ng network. Ang isa pang hamon ay ang mga SNN ay hindi gaanong nauunawaan gaya ng mga tradisyonal na artipisyal na neural network. Ginagawa nitong mahirap na magdisenyo at mag-optimize ng mga SNN para sa mga partikular na gawain.

Paano Gumaganap ang SpikeGPT

Sa isang empirikal na pag-aaral, ang SpikeGPT ay sinanay ng tatlong magkakaibang sukat ng parameter (45M, 125M, at 260M na mga parameter) at na-benchmark laban sa mga baseline ng transformer tulad ng Reformer, Synthesizer, Linear Transformer, at Performer gamit ang Enwik8 dataset. Ang mga resulta ay nagsiwalat na ang SpikeGPT ay naghatid ng maihahambing na mga resulta na may 22 beses na mas kaunting mga synaptic na operasyon (SynOps).

Ang pananaliksik na ito ay binibigyang-diin ang potensyal ng pagsasanay sa malalaking SNN upang magamit ang mga pagsulong sa mga transformer, na nagmumungkahi ng isang makabuluhang pagbawas sa mga kahilingan sa computational ng LLM. sa pamamagitan ng paglalapat ng event-driven spiking activation sa pagbuo ng wika. Ipinahayag ng mga mananaliksik ang kanilang intensyon na ipagpatuloy ang pagpipino ng kanilang modelo at ia-update ang kanilang preprint na papel nang naaayon. Ang code para sa SpikeGPT ay available sa GitHub ng proyekto, at ang ang papel na nagdedetalye sa modelo ay maa-access sa arXiv.