MiniMax ซึ่งเป็นสตาร์ทอัพด้าน AI ในสิงคโปร์ที่ได้รับการสนับสนุนจาก Alibaba และ Tencent ได้เปิดตัวโมเดล AI ซีรีส์ใหม่ที่มีหน้าต่างบริบทโทเค็นที่ทำลายสถิติถึง 4 ล้านรายการ

การเปิดตัว MiniMax-Text-01 และ MiniMax-VL-01 ทำให้บริษัทเป็นคู่แข่งสำคัญในการก่อตั้ง ผู้เล่นอย่าง OpenAI และ Google นำเสนอความสามารถขั้นสูงสำหรับแอปพลิเคชันที่ต้องการหน่วยความจำอย่างยั่งยืนและการจัดการอินพุตที่กว้างขวาง

โมเดลที่ออกแบบมาเพื่อจัดการกับงานที่เกี่ยวข้องกับเอกสารขนาดยาว การใช้เหตุผลที่ซับซ้อน และอินพุตหลายรูปแบบ ถือเป็นการก้าวกระโดดไปข้างหน้าใน AI ความสามารถในการขยายขนาดและ ความสามารถในการจ่าย การประกาศของ MiniMax เน้นย้ำถึงการมุ่งเน้นไปที่การพัฒนาเอเจนต์ AI โดยตอบสนองความต้องการที่เพิ่มขึ้นสำหรับระบบที่สามารถประมวลผลบริบทเพิ่มเติมได้

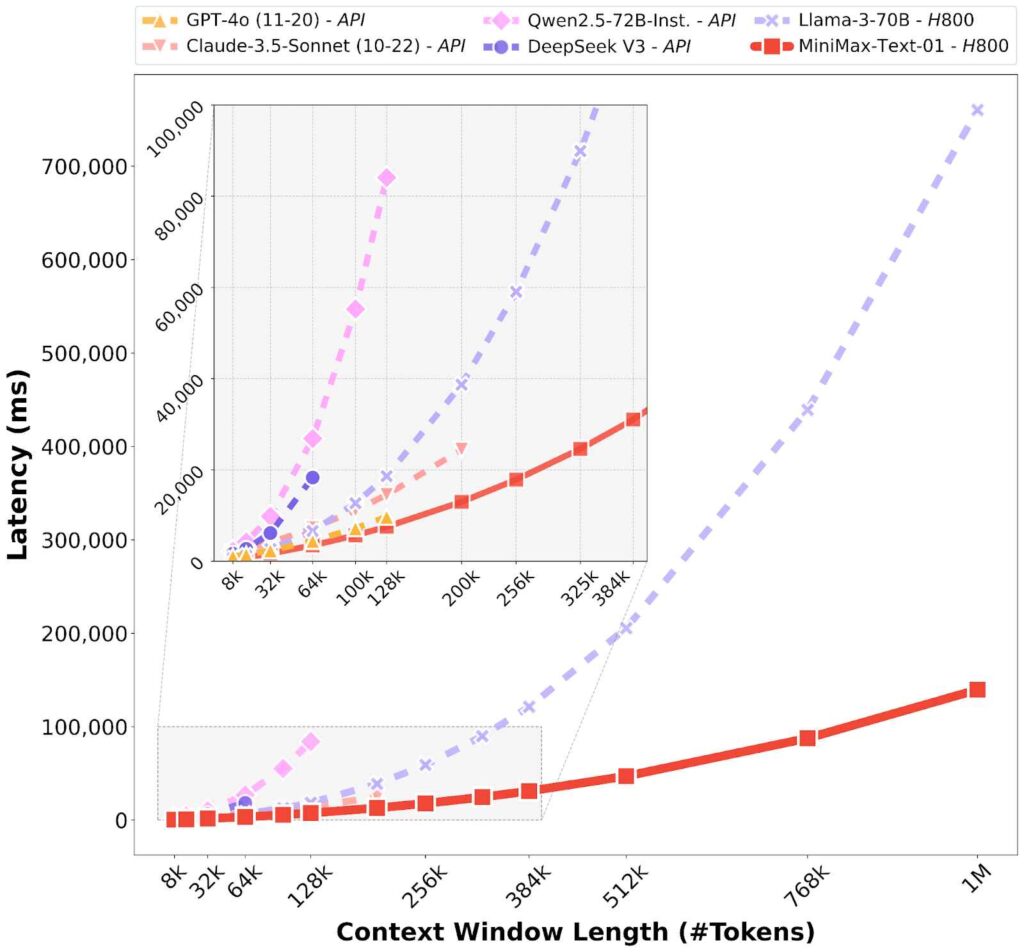

ตัว MiniMax-Text-01 มีพารามิเตอร์ทั้งหมด 456 พันล้านพารามิเตอร์ โดยมีการเปิดใช้งาน 45.9 พันล้านรายการต่อโทเค็นระหว่างการอนุมาน ออกแบบมาเพื่อการประมวลผลบริบทยาวที่มีประสิทธิภาพ ใช้กลไกความสนใจแบบไฮบริดที่รวมเลเยอร์เชิงเส้นและ SoftMax เพื่อปรับขยายขีดความสามารถให้เหมาะสม โมเดลนี้รองรับหน้าต่างบริบทที่มีโทเค็นมากถึง 1 ล้านโทเค็นในระหว่างการฝึก และขยายไปสู่โทเค็นการอนุมานที่น่าประทับใจถึง 4 ล้านโทเค็น

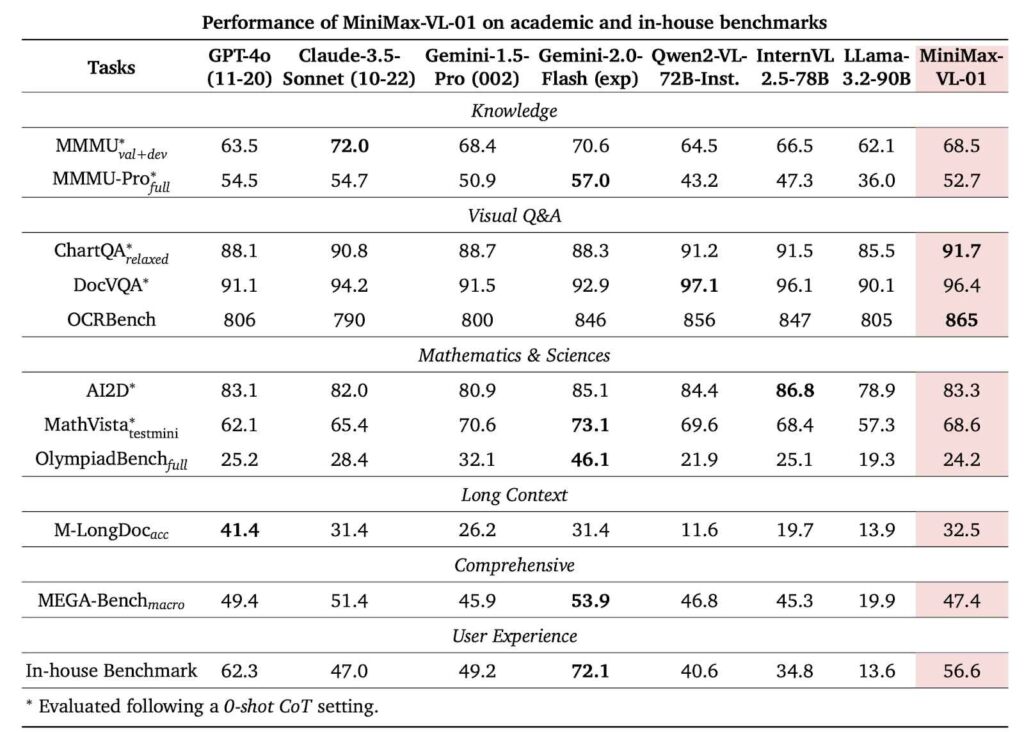

มาพร้อมกับ โมดูล Vision Transformer (ViT) MiniMax-VL-01 โมเดลนี้ได้รับการออกแบบมาสำหรับการใช้งานต่อเนื่องหลายรูปแบบ โดยจะประมวลผลโทเค็นภาษาวิสัยทัศน์จำนวน 512 พันล้านโทเค็นโดยใช้ไปป์ไลน์การฝึกอบรมสี่ขั้นตอนที่มีโครงสร้าง เพื่อให้มั่นใจถึงประสิทธิภาพที่แข็งแกร่งในงานที่ต้องมีการรวมข้อมูลภาพและข้อความ

โทเค็น 4 ล้านมีความหมายต่อ AI อย่างไร การพัฒนา

หน้าต่างบริบทในโมเดล AI จะกำหนดจำนวนข้อมูลที่พวกเขาสามารถประมวลผลได้พร้อมกัน โดยแต่ละโทเค็นจะแสดงถึงส่วนของข้อมูล เช่น คำหรือเครื่องหมายวรรคตอน

ความจุโทเค็น 4 ล้านโทเค็นของ MiniMax-Text-01 นั้นเหนือกว่ามาตรฐานอุตสาหกรรมอย่างมาก รวมถึง GPT-4 ของ OpenAI (32,000 โทเค็น) และ Gemini 1.5 Pro ของ Google (2 ล้านโทเค็น)

ตามข้อมูลของ MiniMax ความจุที่เพิ่มขึ้นนี้ช่วยให้โมเดลต่างๆ ประมวลผลปริมาณข้อมูลที่เทียบเท่ากับหนังสือหลายเล่มในการแลกเปลี่ยนครั้งเดียว

บริษัทระบุไว้ในบัญชี X ว่า”MiniMax-01 ประมวลผลโทเค็นได้อย่างมีประสิทธิภาพสูงสุด 4 ล้านโทเค็น ซึ่งมากกว่าความจุของรุ่นชั้นนำอื่น ๆ ถึง 20 ถึง 32 เท่า เราเชื่อว่า MiniMax-01 พร้อมที่จะรองรับแอปพลิเคชันที่เกี่ยวข้องกับตัวแทนที่คาดว่าจะเพิ่มขึ้นในปีหน้า เนื่องจากตัวแทนต้องการความสามารถในการจัดการบริบทเพิ่มเติมและหน่วยความจำที่ยั่งยืนมากขึ้น”

MiniMax-01 is Now โอเพ่นซอร์ส: การปรับขนาดความสนใจแบบ Lightning สำหรับยุค AI Agent

เรารู้สึกตื่นเต้นที่จะเปิดตัวโมเดลโอเพ่นซอร์สล่าสุดของเรา: โมเดลภาษาพื้นฐาน MiniMax-Text-01 และโมเดลมัลติโมดัลแบบเห็นภาพ MiniMax-VL-01.

💪นวัตกรรม Lightning Attention… pic.twitter.com/LbJhhmxD4P

— MiniMax (เป็นทางการ) (@MiniMax__AI) 14 มกราคม 2025

ความสามารถนี้เปิดประตูสู่การใช้งานในสาขาต่างๆ เช่น การวิจัย การวิเคราะห์ การประมวลผลเอกสารทางกฎหมาย และการจำลองที่ขับเคลื่อนด้วย AI ซึ่งการจัดการชุดข้อมูลขนาดใหญ่ถือเป็นสิ่งสำคัญ

รูปภาพ: MiniMax

รูปภาพ: MiniMax

เทคโนโลยีเบื้องหลัง MiniMax-01

หัวใจของโมเดลใหม่ของ MiniMax อยู่ที่”สถาปัตยกรรม Lightning Attention”ซึ่งเป็นระบบไฮบริดที่ผสมผสานชั้นความสนใจเชิงเส้นและ”SoftMax”ต่างจากโมเดลหม้อแปลงแบบดั้งเดิมที่ปรับขนาดความซับซ้อนในการคำนวณเป็นกำลังสองตามขนาดอินพุต Lightning Attention มีความสามารถในการขยายขนาดแบบเกือบเชิงเส้น ทำให้สามารถประมวลผลลำดับแบบยาวได้อย่างมีประสิทธิภาพ

นอกจากนี้ โมเดลยังรวม กรอบงาน Mixture of Experts (MoE) ซึ่งประกอบด้วยโมเดลย่อย 32 รุ่นหรือ “ผู้เชี่ยวชาญ” ที่ถูกเลือกเปิดใช้งานโดยขึ้นอยู่กับงาน

การออกแบบนี้เพิ่มประสิทธิภาพทรัพยากรการคำนวณในขณะที่รักษาประสิทธิภาพสูง >การเพิ่มประสิทธิภาพเคอร์เนล CUDA ช่วยเพิ่มความสามารถในการปรับขนาดและประสิทธิภาพของโมเดล

เกณฑ์มาตรฐานและประสิทธิภาพ

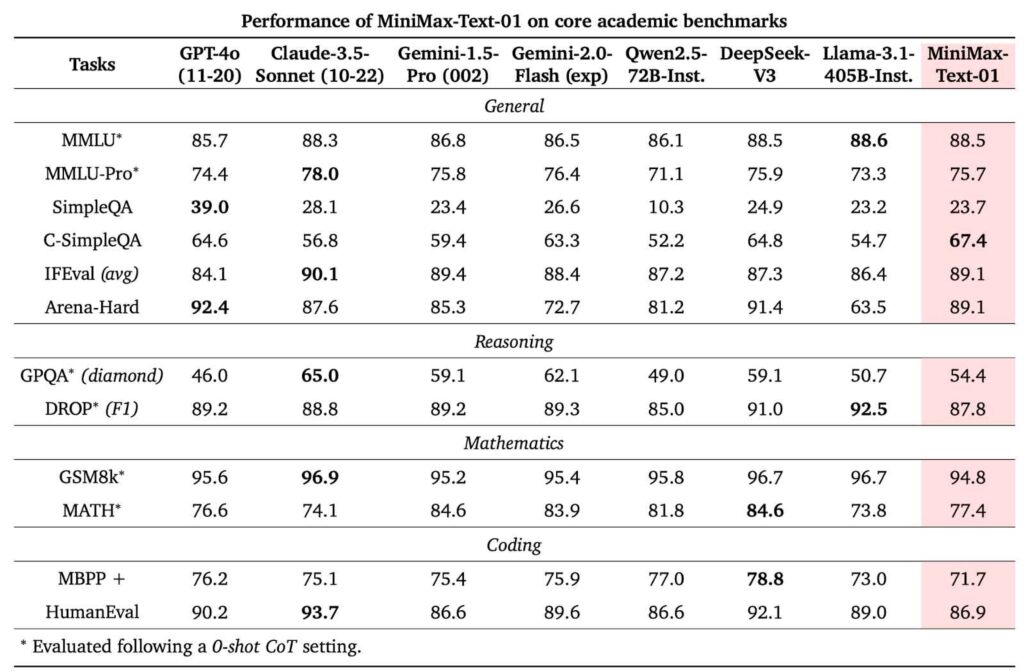

MiniMax-01 ทั้งสองรุ่นได้แสดงให้เห็นถึงผลลัพธ์ที่แข่งขันได้ บนเกณฑ์มาตรฐานอุตสาหกรรม ตัวอย่างเช่น MiniMax-Text-01 ได้รับความแม่นยำ 100% ในการทดสอบ Needle-in-a-Haystack พร้อมบริบทเพิ่มเติม ซึ่งตรงกับ Gemini 1.5 Pro ของ Google

ที่มา: MiniMax

ที่มา: MiniMax

ในงานต่อเนื่องหลายรูปแบบ MiniMax-VL-01 จะเก่งกว่า ในการประเมินภาษาวิสัยทัศน์ โดยมีความแม่นยำ 96.4% บน DocVQA และ 91.7% บนการวัดประสิทธิภาพ AI2D

ที่มา: MiniMax

ที่มา: MiniMax

แม้จะประสบความสำเร็จเหล่านี้ ผู้เชี่ยวชาญยังเตือนว่าเกณฑ์มาตรฐานเช่น Needle-in-a-Haystack อาจไม่ได้สะท้อนการใช้งานจริงอย่างสมบูรณ์ การศึกษาแนะนำว่าแม้ว่ากรอบเวลาบริบทขนาดใหญ่จะมีคุณค่า แต่ประสิทธิผลของมันขึ้นอยู่กับวิธีใช้งาน โดยเฉพาะอย่างยิ่งในงานที่ต้องใช้การสร้างเสริมการดึงข้อมูล (RAG)

การเข้าถึงและราคาที่แข่งขันได้

MiniMax ได้สร้างโมเดลที่พร้อมใช้งานบนแพลตฟอร์มเช่น GitHub และ Hugging Face รวมถึงผ่านแพลตฟอร์ม Hailuo AI ที่เป็นเอกสิทธิ์ของบริษัท

นักพัฒนายังสามารถเข้าถึงได้ผ่าน API ในอัตราการแข่งขันสูง: 0.20 ดอลลาร์ต่อโทเค็นอินพุตหนึ่งล้าน และ 1.10 ดอลลาร์ต่อโทเค็นเอาต์พุตหนึ่งล้าน ราคานี้บั่นทอน GPT-4 API ของ OpenAI อย่างมาก ซึ่งเรียกเก็บเงิน 2.50 ดอลลาร์ต่อโทเค็นอินพุตหนึ่งล้านรายการ

อย่างไรก็ตาม ใบอนุญาตของ MiniMax มีข้อจำกัด ตัวอย่างเช่น แพลตฟอร์มที่มีผู้ใช้งานมากกว่า 100 ล้านรายต่อเดือนจะต้องได้รับการอนุญาตพิเศษ และโมเดลดังกล่าวไม่สามารถใช้เพื่อปรับปรุงระบบ AI ของคู่แข่งได้ เงื่อนไขเหล่านี้อาจจำกัดการยอมรับในองค์กรขนาดใหญ่

ความท้าทายด้านจริยธรรมและบริบทด้านกฎระเบียบ

MiniMax เผชิญกับการตรวจสอบข้อเท็จจริงอย่างต่อเนื่องเกี่ยวกับการใช้เนื้อหาที่มีลิขสิทธิ์ในชุดข้อมูลการฝึกอบรม บริการสตรีมมิ่งของจีน iQiyi ได้ยื่นฟ้องบริษัทที่ไม่ได้รับอนุญาต การใช้การบันทึก ในขณะที่แอป Talkie ของ MiniMax ซึ่งมีรูปประจำตัวของบุคคลสาธารณะที่สร้างโดย AI ได้ถูกลบออกจาก App Store ของ Apple ในเดือนธันวาคม 2024 โดยไม่ระบุรายละเอียด การละเมิด

ปัญหาเหล่านี้เกิดขึ้นเมื่อการควบคุมการส่งออกเทคโนโลยี AI ของสหรัฐฯ เข้มงวดยิ่งขึ้น กฎระเบียบใหม่ที่ประกาศโดยฝ่ายบริหารของ Biden มีเป้าหมายเพื่อจำกัดการขายชิป AI และเทคโนโลยีขั้นสูงให้กับบริษัทในจีน มาตรการเหล่านี้อาจทำให้การเข้าถึงฮาร์ดแวร์ที่จำเป็นในการฝึกและปรับขนาดโมเดลของ MiniMax ซับซ้อนขึ้น

MiniMax ในภูมิทัศน์ AI ที่มีการแข่งขันสูง

ก่อตั้งในปี 2021 โดยอดีตพนักงาน MiniMax ของ SenseTime ได้ขยายผลงานอย่างรวดเร็ว ตั้งแต่ข้อความและโมเดลหลายรูปแบบไปจนถึงเครื่องสร้างวิดีโอ โมเดล Video-01 ของแพลตฟอร์ม Hailuo AI ได้รับความสนใจจากความสามารถในการสร้างวิดีโอที่สมจริง โดยเฉพาะอย่างยิ่งในด้านต่างๆ เช่น การเคลื่อนไหวของมือมนุษย์ ซึ่งเป็นแง่มุมที่ท้าทายในการสร้างวิดีโอ

ในขณะที่ MiniMax วางตำแหน่งตัวเองเป็นต้นทุน-ทางเลือกที่มีประสิทธิภาพแทนยักษ์ใหญ่ในอุตสาหกรรม ความสามารถในการรับมือกับความท้าทายทางกฎหมายและอุปสรรคด้านกฎระเบียบจะเป็นหัวใจสำคัญต่อการเติบโตอย่างต่อเนื่อง