ผู้โจมตีกำลังใช้ประโยชน์จากอินสแตนซ์ WebUI แบบเปิดที่ไม่ถูกต้องโดยใช้มัลแวร์ Ai-Generated เพื่อประนีประนอมระบบ Open WebUI ใช้โดยแพลตฟอร์ม AI chatbot ยอดนิยมเช่น Ollama และ LM Studio เพื่อให้อินเทอร์เฟซที่ใช้เบราว์เซอร์ที่เป็นโฮสต์ด้วยตนเองสำหรับการโต้ตอบกับโมเดลภาษาขนาดใหญ่

แคมเปญที่มีความซับซ้อนเป็นเครื่องหมายที่เกี่ยวข้องกับการเพิ่ม ตอนนี้เครื่องมือ AI ไม่เพียง แต่จะส่งสัญญาณที่เป็นอันตรายเท่านั้น แต่ยังเป็นเป้าหมายการเอารัดเอาเปรียบ การโจมตีส่งผลกระทบต่อ Linux และ Windows โดยมีวัตถุประสงค์เพื่อติดตั้ง cryptominers และ infostealers ผ่านการหลีกเลี่ยงขั้นสูง

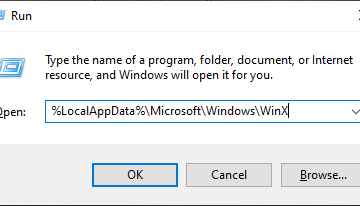

เหตุการณ์นี้เน้นถึงช่องโหว่ใหม่ที่สำคัญเป็นอินเทอร์เฟซ AI ที่ออกแบบมาเพื่อการผลิตยังสามารถกลายเป็นพื้นผิวการโจมตีที่สำคัญหากไม่ปลอดภัยอย่างเหมาะสม การสืบสวนของ Sysdig พบว่าผู้โจมตีได้รับการเข้าถึงเริ่มต้นไปยังระบบ Webui แบบเปิดซึ่งได้รับการเปิดเผยทางออนไลน์ด้วยสิทธิ์ในการดูแลระบบและไม่มีการตรวจสอบโดยการอัปโหลดสคริปต์ Python ที่สับสนอย่างหนัก

นักวิจัยสังเกต การวิเคราะห์ตัวตรวจจับรหัส CHATGPT ที่อ้างถึงโดย Sysdig สรุปว่าสคริปต์นั้น“ มีโอกาสสูงมาก (~ 85–90%) เป็น Ai-Generated หรือ AI ที่ได้รับการช่วยเหลืออย่างหนักความสนใจอย่างพิถีพิถันกับเคสขอบที่สมดุล มัลแวร์ AI-Assisted ขนานนาม“ Pyklump” โดยทีมวิจัยทำหน้าที่เป็นเวกเตอร์หลักสำหรับการโจมตีที่ตามมา

บทบาทคู่ของ AI-เครื่องมือสำหรับการสร้างมัลแวร์และเป้าหมายการแสวงหาผลประโยชน์ นี่เป็นเรื่องจริงโดยเฉพาะอย่างยิ่งเนื่องจากเครื่องมือ AI ที่โฮสต์ตนเองเติบโตขึ้นตามความนิยม

กายวิภาคของการบุกรุกที่ขับเคลื่อนด้วย AI

สคริปต์ Python ที่สร้างขึ้นเมื่อดำเนินการผ่านเครื่องมือ webui แบบเปิด Sysdig รายงานว่า Webhook Discord อำนวยความสะดวกในการสื่อสารคำสั่งและการควบคุม (C2) เทคนิคนี้เป็นเทรนด์ที่เพิ่มขึ้นเนื่องจากการผสมผสานอย่างง่ายดายกับการรับส่งข้อมูลเครือข่ายที่ถูกกฎหมาย

เพื่อหลีกเลี่ยงการตรวจจับผู้โจมตีใช้ประโยชน์จาก’processhider’ยูทิลิตี้ที่ทำให้กระบวนการที่เป็นอันตรายเช่น cryptominers หายไปจากรายการระบบมาตรฐาน นอกจากนี้พวกเขายังใช้’Argvhider’เพื่อซ่อนพารามิเตอร์บรรทัดคำสั่งที่สำคัญเช่น URL พูลเหมืองและที่อยู่กระเป๋าเงิน เครื่องมือนี้ประสบความสำเร็จโดยการเปลี่ยนเวกเตอร์อาร์กิวเมนต์ของกระบวนการในหน่วยความจำเพื่อให้เครื่องมือตรวจสอบไม่สามารถอ่านข้อมูลที่ละเอียดอ่อนดั้งเดิม

เส้นทางการโจมตีของ Windows เกี่ยวข้องกับการติดตั้ง Java Development Kit (JDK) นี่คือการเรียกใช้ไฟล์ Jar ที่เป็นอันตราย (Java Archive), Application-ref.jar ดาวน์โหลดจากเซิร์ฟเวอร์ C2 ขวดเริ่มต้นนี้ทำหน้าที่เป็นตัวโหลดสำหรับส่วนประกอบที่เป็นอันตรายต่อไป สิ่งเหล่านี้รวมถึง int_d.dat, windows 64 บิต DLL (ไลบรารีลิงก์แบบไดนามิก) ที่มีการเข้ารหัส Xor (วิธีการเข้ารหัส) และการหลีกเลี่ยง Sandbox

องค์ประกอบอื่นคือ int_j.dat ขวดหลังมี DLL อีกตัว APP_BOUND_DECRYPTOR.DLL ข้าง InfOstealers ต่างๆ ข้อมูลรับรองเป้าหมายเหล่านี้จากส่วนขยายของเบราว์เซอร์ Chrome และ Discord App_bound_decryptor.dll นั้นใช้การเข้ารหัส XOR, ใช้ชื่อท่อ (กลไกสำหรับการสื่อสารระหว่างกระบวนการ), และรวมคุณสมบัติการตรวจจับ Sandbox

มากกว่า 17,000 อินสแตนซ์ WebUI ที่เปิดอยู่ทางออนไลน์

บทบาทการขยายตัวของ AI ใน Cyber Conflict

การแสวงหาผลประโยชน์ WebUI แบบเปิดนี้เป็นตัวอย่างล่าสุดภายในรูปแบบที่กว้างขึ้นเนื่องจาก AI ถูกรวมเข้ากับการปฏิบัติการทางไซเบอร์ เร็วเท่าที่เดือนตุลาคม 2567 Microsoft รายงานการโจมตีทางไซเบอร์ที่ขับเคลื่อนด้วย AI เกินกว่า 600 ล้านเหตุการณ์ต่อวันโดยเน้นว่าผู้โจมตี“ กำลังเพิ่มขึ้นในวิธีการที่ไซเบอร์อาชญากรสามารถทำให้วิธีการของพวกเขาผ่าน AI Generative ได้อย่างไร” รายงานการป้องกันดิจิตอลของพวกเขา 2024 ยังระบุด้วยว่า“ ปริมาณการโจมตีนั้นยอดเยี่ยมมากเกินไปสำหรับกลุ่มใดกลุ่มหนึ่งที่จะจัดการด้วยตนเอง”

จำนวนแคมเปญมัลแวร์ที่ขับเคลื่อนด้วย AI ที่เพิ่มขึ้นกำลังใช้แอปพลิเคชันปลอมและ Captchas เพื่อกำหนดเป้าหมายผู้ใช้ พวกเขามักจะใช้เครื่องมือ Dark Web AI เช่น Wormgpt และ Fraudgpt สำหรับการสร้างอีเมลฟิชชิ่งและมัลแวร์ที่ซับซ้อน

ภายในเดือนมกราคม 2568 อัตราความสำเร็จของการโจมตีฟิชชิ่งได้รายงานสามเท่าปี สิ่งนี้ส่วนใหญ่มาจากความสามารถของ AI ในการสร้างเหยื่อที่น่าเชื่อถือและมีการแปลมากขึ้นตามรายงานของคลาวด์และภัยคุกคามของ NetSkope LLMs สามารถให้การแปลที่ดีขึ้นและมีความหลากหลายมากขึ้นในการพยายามหลบเลี่ยงตัวกรองสแปมและเพิ่มความน่าจะเป็นที่จะหลอกผู้ที่ตกเป็นเหยื่อ

การแข่งขันอาวุธความปลอดภัยทางไซเบอร์ AI

ในขณะที่ผู้โจมตีใช้ AI ตัวอย่างเช่น Google เปิดตัว Sec-Gemini V1 ในเดือนเมษายน แบบจำลอง AI นี้ช่วยผู้เชี่ยวชาญด้านความปลอดภัยด้วยการตรวจจับและวิเคราะห์ภัยคุกคามแบบเรียลไทม์ ความคิดริเริ่มนี้เป็นไปตามความสำเร็จก่อนหน้านี้เช่น AI Big Sleep AI ของ Google ซึ่งเมื่อปีที่แล้วระบุช่องโหว่ที่สำคัญในเอ็นจินฐานข้อมูล SQLite Google ได้ประกาศการค้นพบและการแก้ไขข้อบกพร่องนั้นก่อนที่จะส่งผลกระทบต่อผู้ใช้

ผู้ขายรายใหญ่รายอื่นยังช่วยเสริมความสามารถของ AI ด้วย Fortinet เมื่อเดือนพฤศจิกายนที่ผ่านมาได้ขยายเครื่องมือรักษาความปลอดภัย AI ด้วยการรวมใหม่เพื่อการตรวจจับภัยคุกคามที่ดีขึ้น ในเดือนเมษายนปี 2568 Google ได้เสริมสร้างกลยุทธ์การรักษาความปลอดภัย AI โดยการเปิดตัวแพลตฟอร์มความปลอดภัยแบบครบวงจรซึ่งรวม Gemini AI เพื่อรวมการตรวจจับภัยคุกคามและการตอบสนองโดยใช้การให้เหตุผลที่มีโครงสร้าง สิ่งนี้ตรงกันข้ามกับวิธีการเช่น Copilot ความปลอดภัยของ Microsoft ซึ่งมุ่งเน้นไปที่การทำงานอัตโนมัติแบบแยกส่วนมากขึ้น