Perplexity AI ได้เปิดตัว R1 1776 รูปแบบภาษาโอเพนซอร์ซขนาดใหญ่ (LLM) ที่สร้างขึ้นบนรูปแบบการใช้เหตุผลของจีน Deepseek R1 โดยอ้างว่าไม่มีการเซ็นเซอร์ที่รัฐบาลกำหนดอีกต่อไป

บริษัท ระบุว่าการปรับเปลี่ยนไปยัง Deepseek ได้ลบกลไกการกรองที่มีอยู่ซึ่ง จำกัด การตอบสนองต่อหัวข้อที่อ่อนไหวทางการเมือง ด้วยการสร้างโมเดล เปิดเผยต่อสาธารณะในการกอดใบหน้า ความงุนงงกำลังวางตำแหน่งตัวเองเป็นผู้เล่นหลักในการอภิปรายอย่างต่อเนื่องเกี่ยวกับ AI ความโปร่งใสและการกลั่นกรอง

aravind srinivas ผู้ร่วมก่อตั้งและซีอีโอของ Perplexity

Move ติดตามการขยายตัวของ Perplexity อย่างต่อเนื่องในการค้นหาและการดึงข้อมูล AI ที่ขับเคลื่อนด้วย คำตอบ

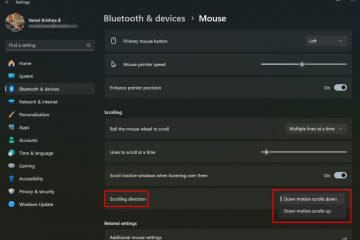

ในชุดของโพสต์บน X, Srinivas แบ่งปันรายละเอียดเพิ่มเติมเกี่ยวกับ R1 1776 กับมาตรฐานสำหรับ เปอร์เซ็นต์การเซ็นเซอร์และประสิทธิภาพ

หลังการฝึกอบรมเพื่อลบการเซ็นเซอร์ได้ทำโดยไม่ทำร้ายความสามารถในการใช้เหตุผลหลักของแบบจำลอง-ซึ่งเป็นสิ่งสำคัญที่จะทำให้แบบจำลองยังคงมีประโยชน์ในงานที่สำคัญทั้งหมด pic.twitter.com/rdhvszy8zi

-aravind srinivas (@aravsrinivas) 18 กุมภาพันธ์ 2025 ที่ถูกบล็อก R1 เวอร์ชันดั้งเดิมของ Deepseek แม้จะมีการเรียกร้องการเปิดกว้าง R1 1776 ไม่ได้ทั้งหมดหากไม่มีอคติ การปรับข้อมูลการฝึกอบรมและการปรับรูปแบบยังคงสะท้อนถึงตัวเลือกที่เกิดขึ้นจากนักพัฒนาของ Perplexity นักวิจัยของ AI ยืนยันว่าไม่มีระบบ AI ที่เป็นกลางอย่างแท้จริงเนื่องจากการตอบสนองนั้นมีรูปร่างโดยข้อมูลและวิธีการที่ใช้ในระหว่างการฝึกอบรม

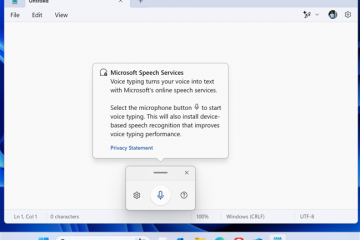

และอีกหนึ่ง:”ใครคือ Xi Jinping” pic.twitter.com/eupg3jr6jf

-aravind srinivas (@aravsrinivas) 18 กุมภาพันธ์ 2025 มันแตกต่าง

ซึ่งแตกต่างจากรุ่น AI ที่สร้างขึ้นตั้งแต่เริ่มต้น R1 1776 เป็นรุ่น Deepseek ที่ได้รับการดัดแปลงซึ่งเป็นรูปแบบภาษาขนาดใหญ่ที่ได้รับการพัฒนาจากจีนซึ่งได้รับการฝึกฝนด้วยชุดข้อมูลที่ได้รับอิทธิพลจากระบบนิเวศของสื่อที่ควบคุมโดยรัฐของจีน ความงุนงงอ้างว่า Deepseek มีกฎการกรองภายในที่บล็อกหัวข้อที่อ่อนไหวทางการเมืองซึ่ง R1 1776 ไม่บังคับใช้อีกต่อไป

ชื่อ”R1 1776″ตัวเองแนะนำข้อความโดยเจตนาอ้างอิงถึงปีแห่งความเป็นอิสระของอเมริกา การเปิดตัวเป็นความมุ่งมั่นในการเข้าถึงข้อมูลฟรีนักวิจารณ์ยืนยันว่าแม้แต่แบบจำลอง AI ที่เปิด นักพัฒนา.

ความงุนงงไม่ได้ยืนยันอย่างชัดเจนว่า R1 1776 ใช้นโยบายการกลั่นกรองทางเลือกใด ๆ.

เปิด AI กับ AI ที่เป็นกรรมสิทธิ์: การอภิปรายเกี่ยวกับการกลั่นกรอง

การเปิดตัว R1 1776 เกิดขึ้นในช่วงเวลาที่ บริษัท AI ถูกแบ่งออกไปมากขึ้นว่าแบบจำลองควรถูกควบคุมอย่างเข้มงวดหรือเข้าถึงได้อย่างอิสระหรือไม่ และความเสี่ยงด้านความปลอดภัย

ในทางกลับกันความงุนงงเข้าร่วม Meta และ Mistral AI ในการโต้แย้งว่าโมเดลโอเพ่นซอร์สโปรโมต AI ความโปร่งใส ด้วยการทำให้แบบจำลองของพวกเขาเปิดเผยต่อสาธารณชนพวกเขาอ้างว่าช่วยให้นักวิจัยและนักพัฒนาสามารถตรวจสอบการตัดสินใจของ AI และท้าทายอคติที่อาจเกิดขึ้น

ในขณะที่นักวิจัยและผู้สนับสนุนโอเพนซอร์สบางคนสนับสนุนท่าทางของ Perplexity อาจถูกเอาเปรียบสำหรับการเผยแพร่ข้อมูลเท็จ การอภิปรายเกี่ยวกับการเปิดกว้างของ AI นั้นยังห่างไกลจากความกังวลเกี่ยวกับความเสี่ยงด้านความปลอดภัยและการพิจารณาทางจริยธรรมอย่างต่อเนื่อง การเปิดตัว R1 1776 เป็นเพียงหนึ่งในหลาย ๆ การเคลื่อนไหวล่าสุดโดย Perplexity AI เพื่อวางตำแหน่งตัวเองในฐานะคู่แข่งรายใหญ่ในการค้นหาและการดึงข้อมูล AI บริษัท ได้รับการพัฒนาบริการอย่างแข็งขันซึ่งท้าทายการปกครองของ Openai, Google และ Microsoft ในพื้นที่ค้นหา AI

ก่อนที่จะมีการวิจัย Deep Research ล่าสุดซึ่งให้การตรวจสอบข้อเท็จจริงตามเวลาจริงของ AI ความงุนงงในเดือนมกราคมเปิดตัว API การเข้าถึงโมเดลโซนาร์ซึ่งช่วยให้นักพัฒนาสามารถฝังความสามารถในการค้นหา AI ที่ใช้พลังงานของ Perplexity ลงในแอปพลิเคชันของตนเอง

บริษัท ได้เข้าสู่มือถือ ตลาด AI ด้วยการเปิดตัวผู้ช่วย AI หลายรูป-การค้นหาและผู้ช่วยเสมือนจริง

ข้อกังวลด้านกฎระเบียบและการพิจารณาทางจริยธรรม

การเปิดตัว R1 1776 ยังเน้นถึงความกังวลด้านกฎระเบียบที่เพิ่มขึ้นเมื่อรัฐบาลดำเนินการทั่วโลกไปสู่การกำหนดนโยบายการกำกับดูแล AI ผู้ร่างกฎหมายในสหรัฐอเมริกาและยุโรปกำลังพิจารณากฎระเบียบของ AI ที่อาจส่งผลกระทบต่ออนาคตของแบบจำลองโอเพนซอร์ซ นโยบายเหล่านี้คาดว่าจะมุ่งเน้นไปที่ความโปร่งใสการป้องกันทางจริยธรรมและความเสี่ยงด้านความปลอดภัยที่เกิดจากระบบ AI ที่เปิดเผยต่อสาธารณะ

หนึ่งในข้อกังวลหลักของโมเดล AI แบบเปิดคือการใช้ในทางที่ผิด โดยไม่มีการกลั่นกรองอย่างเข้มงวด AI สามารถสร้างเนื้อหาที่ทำให้เข้าใจผิดถูกนำไปใช้ประโยชน์สำหรับภัยคุกคามทางไซเบอร์หรือจัดการสำหรับแคมเปญการบิดเบือนข้อมูลขนาดใหญ่ บริษัท เช่น OpenAI และ Google DeepMind ได้อ้างถึงความเสี่ยงเหล่านี้ว่าเป็นเหตุผลในการรักษาโมเดลที่ทรงพลังที่สุดของพวกเขา

กับรัฐบาลทั่วโลกที่ถกเถียงกันถึงอนาคตของกฎระเบียบ AI การเคลื่อนไหวของ Perplexity กับ R1 1776 การตรวจสอบข้อเท็จจริง ไม่ว่าหน่วยงานกำกับดูแลจะกำหนดข้อ จำกัด ในโมเดล AI โอเพนซอร์ซหรืออนุญาตให้พวกเขายังคงเข้าถึงได้อย่างกว้างขวางยังคงเป็นคำถามเปิดอยู่

อนาคตของความโปร่งใส AI

บทนำของ R1 1776 แสดงถึงเหตุการณ์สำคัญในการอภิปรายเกี่ยวกับความโปร่งใสของ AI และการกลั่นกรองเนื้อหา การตัดสินใจของ Perplexity AI ในการปรับเปลี่ยน Deepseek และลบข้อ จำกัด ของมันท้าทายแนวโน้มที่เกิดขึ้นในหมู่ บริษัท AI ที่สำคัญที่จัดลำดับความสำคัญการกำกับดูแลเนื้อหาที่เข้มงวด

เป็นการอภิปรายเกี่ยวกับความปลอดภัยของ AI จริยธรรมและการเปิดกว้างต่อไป R1 1776 จะทำหน้าที่เป็นกรณี ศึกษาเพื่อประสิทธิภาพและความเสี่ยงของ AI ที่ไม่ จำกัด หากนำมาใช้อย่างกว้างขวางโมเดลสามารถกระตุ้นให้นักพัฒนารายอื่นติดตามเส้นทางที่คล้ายกัน อย่างไรก็ตามหากมันถูกนำไปใช้ในทางที่ผิดหรือเชื่อมโยงกับข้อกังวลที่เข้าใจผิดมันอาจกระตุ้นให้หน่วยงานกำกับดูแลบังคับใช้การกำกับดูแล AI ที่เข้มงวดยิ่งขึ้น

คำถามที่กว้างขึ้นยังคงอยู่: แบบจำลอง AI ควรจัดลำดับความสำคัญของการเปิดกว้าง จำเป็นต้องรักษาความไว้วางใจของประชาชนหรือไม่