Hugging Face ได้เปิดตัวโมเดล AI น้ำหนักเบา 2 รุ่น ได้แก่ SmolVLM-256M-Instruct และ SmolVLM-500M-Instruct โดยมีจุดมุ่งหมายเพื่อกำหนดนิยามใหม่ของวิธีที่ AI สามารถทำงานบนอุปกรณ์ที่มีพลังในการคำนวณที่จำกัด

โมเดลที่ใช้พารามิเตอร์ 256 ล้านและ 500 ล้านตามลำดับ ได้รับการออกแบบมาเพื่อจัดการกับความท้าทายที่นักพัฒนาต้องเผชิญในการทำงานกับฮาร์ดแวร์ที่มีข้อจำกัดหรือการวิเคราะห์ข้อมูลขนาดใหญ่ด้วยต้นทุนที่ต่ำที่สุด

การเปิดตัว แสดงถึงความก้าวหน้าในด้านประสิทธิภาพและการเข้าถึงสำหรับการประมวลผล AI โมเดล SmolVLM มอบความสามารถหลายรูปแบบขั้นสูง ช่วยให้งานต่างๆ เช่น การอธิบายรูปภาพ การวิเคราะห์วิดีโอสั้น และการตอบคำถามเกี่ยวกับ PDF หรือแผนภูมิทางวิทยาศาสตร์

ดังที่ Hugging Face อธิบายว่า “SmolVLM ทำให้การสร้างที่ค้นหาได้เร็วและราคาถูกกว่า ฐานข้อมูลด้วยความเร็วที่เทียบได้กับโมเดลถึง 10 เท่าของขนาด”

นิยามใหม่ของ AI ต่อเนื่องหลายรูปแบบด้วยโมเดลที่เล็กลง

SmolVLM-256M-สอน และ SmolVLM-500M-Instruct ได้รับการออกแบบมาเพื่อเพิ่มประสิทธิภาพสูงสุดในขณะที่ลดการใช้ทรัพยากรให้เหลือน้อยที่สุด ข้อมูลหลายรูปแบบ เช่น ข้อความและรูปภาพ พร้อมกัน ทำให้มีความหลากหลายสำหรับการใช้งานที่หลากหลาย

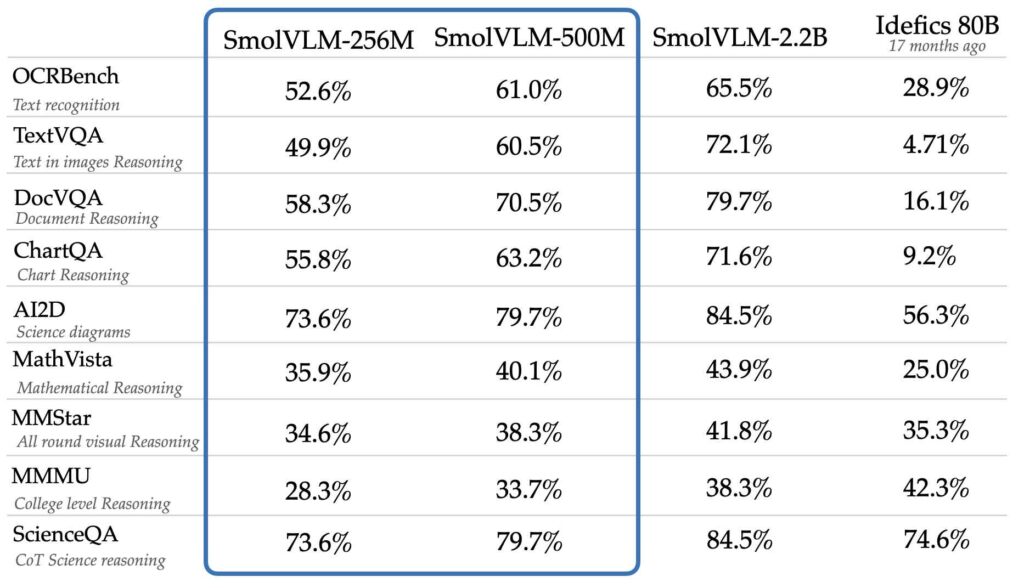

แม้จะมีขนาดลดลง แต่โมเดลก็บรรลุถึงระดับประสิทธิภาพที่เทียบเคียงได้ หรือดีกว่าโมเดลที่ใหญ่กว่ามาก เช่น Idefics 80B ตามเกณฑ์มาตรฐาน เช่น AI2D ซึ่งประเมินความสามารถในการทำความเข้าใจและการใช้เหตุผลด้วย แผนภาพทางวิทยาศาสตร์

Idefics 80B เป็นการทำซ้ำ โมเดลภาษาภาพ Flamingo ที่เป็นซอร์สโค้ดแบบปิดของ DeepMind พัฒนาโดย ใบหน้ากอด ที่สามารถประมวลผลทั้งรูปภาพและการป้อนข้อความ

ที่มา: Hugging Face

ที่มา: Hugging Face

การพัฒนาโมเดลเหล่านี้ อาศัยชุดข้อมูลที่เป็นกรรมสิทธิ์สองชุด ได้แก่ The Cauldron และ Docmatix The Cauldron คือคอลเลกชันชุดข้อมูลรูปภาพและข้อความคุณภาพสูง 50 ชุดที่เน้นการเรียนรู้แบบหลายรูปแบบ ในขณะที่ Docmatix ได้รับการปรับแต่งสำหรับการทำความเข้าใจเอกสาร โดยจับคู่ไฟล์ที่สแกนพร้อมคำอธิบายภาพโดยละเอียดเพื่อเพิ่มความเข้าใจ

ทีม M4 ของ Hugging Face ซึ่งเป็นที่รู้จักในด้านความเชี่ยวชาญด้าน AI ต่อเนื่องหลายรูปแบบ เป็นหัวหอกในการสร้างชุดข้อมูลเหล่านี้

ในการประกาศ Hugging Face เน้นย้ำถึงความสำคัญของการทำให้ AI เข้าถึงได้มากขึ้น “นักพัฒนาบอกเราว่าพวกเขาต้องการโมเดลสำหรับแล็ปท็อปหรือแม้แต่เบราว์เซอร์ และข้อเสนอแนะดังกล่าวได้กระตุ้นให้เกิดการสร้างแบบจำลองเหล่านี้” ทีมงานกล่าว โมเดลเหล่านี้แก้ไขข้อจำกัดในทางปฏิบัติที่นักพัฒนาจำนวนมากเผชิญ โดยเฉพาะอย่างยิ่งเมื่อทำงานกับอุปกรณ์ของผู้บริโภคหรือการทำงานที่คำนึงถึงงบประมาณ

นวัตกรรมทางเทคนิคในโมเดล SmolVLM

ปัจจัยสำคัญในความสำเร็จของโมเดลนั้นอยู่ที่การออกแบบที่เป็นรากฐานของ Hugging Face ได้ทำการตัดสินใจเชิงกลยุทธ์เพื่อเพิ่มประสิทธิภาพและ ความแม่นยำอย่างหนึ่ง การตัดสินใจคือการนำตัวเข้ารหัสการมองเห็นที่มีขนาดเล็กกว่า SigLIP base patch-16/512 มาใช้ แทนที่จะเป็นตัวที่ใหญ่กว่า SigLIP 400M SO ใช้ในรุ่นก่อนๆ เช่น SmolVLM 2B.

ตัวเข้ารหัสขนาดเล็กกว่านี้ประมวลผลภาพที่ความละเอียดสูงกว่าโดยไม่เพิ่มค่าใช้จ่ายในการคำนวณอย่างมีนัยสำคัญ

นวัตกรรมอีกอย่างหนึ่งเกี่ยวข้องกับโทเค็น ซึ่งเป็นกระบวนการสำคัญในแบบจำลอง AI ซึ่งข้อมูลจะถูกแบ่งออกเป็นหน่วยที่เล็กลง (โทเค็น ) เพื่อการวิเคราะห์ ด้วยการเพิ่มประสิทธิภาพวิธีการประมวลผลโทเค็นรูปภาพ Hugging Face จึงลดความซ้ำซ้อนและปรับปรุงความสามารถของโมเดลในการจัดการข้อมูลที่ซับซ้อน

ตัวอย่างเช่น ตัวแยกภาพย่อยซึ่งก่อนหน้านี้แมปกับโทเค็นหลายรายการ ในปัจจุบันจะแสดงด้วยโทเค็นเดียว ซึ่งช่วยเพิ่มเสถียรภาพในการฝึกอบรมและคุณภาพการอนุมาน “ด้วย SmolVLM เรากำลังกำหนดนิยามใหม่ของสิ่งที่โมเดล AI ขนาดเล็กสามารถทำได้” ทีมงานอธิบายในการประกาศของพวกเขา

ตัวเลือกการออกแบบเหล่านี้ทำให้โมเดล SmolVLM สามารถเข้ารหัสรูปภาพในอัตรา 4,096 พิกเซลต่อโทเค็น ซึ่งมีความสำคัญ การปรับปรุงมากกว่า 1,820 พิกเซลต่อโทเค็นที่เห็นในเวอร์ชันก่อนหน้า ผลลัพธ์ที่ได้คือความเข้าใจด้านภาพที่คมชัดยิ่งขึ้นและความเร็วในการประมวลผลที่เร็วขึ้น

มุมมองของ SmolVLM สำหรับ แอปพลิเคชัน

ประโยชน์เชิงปฏิบัติของ SmolVLM ขยายไปไกลกว่ากรณีการใช้งาน AI ทั่วไป นักพัฒนาสามารถรวมโมเดลเหล่านี้เข้ากับเวิร์กโฟลว์ที่มีอยู่ได้อย่างราบรื่นโดยใช้เครื่องมือ เช่น Transformers, MLX และ ONNX ยังได้ให้คำแนะนำที่ดีอีกด้วย-จุดตรวจสอบที่ปรับแต่งสำหรับทั้งสองรุ่น ช่วยให้ปรับแต่งได้ง่ายสำหรับงานเฉพาะ

โมเดลนี้เหมาะอย่างยิ่งสำหรับการวิเคราะห์และการดึงข้อมูลเอกสาร โดยความร่วมมือกับ IBM Hugging Face ได้ใช้ SmolVLM-256M กับพวกเขา ระบบ Docling แสดงให้เห็นถึงศักยภาพในการทำให้เวิร์กโฟลว์เป็นอัตโนมัติและดึงข้อมูลเชิงลึกจากไฟล์ที่สแกน ผลลัพธ์ในช่วงแรกๆ จากความร่วมมือครั้งนี้แสดงให้เห็นความหวัง โดยเน้นถึงความอเนกประสงค์ของโมเดล

นอกจากนี้ โมเดล SmolVLM ยังมีให้บริการภายใต้ Apache ใบอนุญาต 2.0 ช่วยให้นักพัฒนาทั่วโลกเข้าถึงได้แบบเปิดกว้าง ความมุ่งมั่นในการพัฒนาโอเพ่นซอร์สนี้สอดคล้องกับภารกิจของ Hugging Face ในการสร้างประชาธิปไตยให้กับ AI ซึ่งช่วยให้องค์กรจำนวนมากขึ้นสามารถนำเทคโนโลยีขั้นสูงมาใช้โดยไม่ต้องเผชิญกับต้นทุนที่สูงเกินควร

การสร้างสมดุลระหว่างต้นทุนและประสิทธิภาพ

การเปิดตัว SmolVLM-256M และ SmolVLM-500M ทำให้กลุ่มผลิตภัณฑ์ SmolVLM สมบูรณ์ ซึ่งขณะนี้ได้รวม Vision Language Models ขนาดเล็กเต็มรูปแบบที่ออกแบบมาเพื่อการใช้งานที่หลากหลาย

โมเดลเหล่านี้มีประสิทธิภาพเป็นพิเศษสำหรับสภาพแวดล้อมที่มีทรัพยากรจำกัด เช่น แล็ปท็อปสำหรับผู้บริโภคหรือแอปพลิเคชันบนเบราว์เซอร์ รุ่น 256M ซึ่งเป็น Vision Language Model ที่เล็กที่สุดเท่าที่เคยมีมา โดดเด่นด้วยความสามารถในการส่งมอบประสิทธิภาพที่แข็งแกร่งบนอุปกรณ์ที่มี RAM น้อยกว่า 1GB

Hugging Face ทำให้ SmolVLM กลายเป็นโซลูชันที่ใช้งานได้จริงสำหรับนักพัฒนาที่จัดการกับปัญหาขนาดใหญ่-ปรับขนาดการประมวลผลข้อมูลตามงบประมาณ