Nvidia ได้ประกาศชุดเครื่องมือเพื่อตอบสนองความต้องการความไว้วางใจ ความปลอดภัย และความน่าเชื่อถือที่เพิ่มขึ้นในระบบ AI แบบตัวแทน

รู้จักกันในชื่อ Nvidia Inference Microservices (NIM) ข้อเสนอใหม่ ได้รับการออกแบบมาเพื่อช่วยให้องค์กรต่างๆ ปรับใช้แอปพลิเคชัน AI ที่สอดคล้องกับหลักเกณฑ์ด้านความปลอดภัยและป้องกันผลลัพธ์ที่ไม่ได้ตั้งใจ

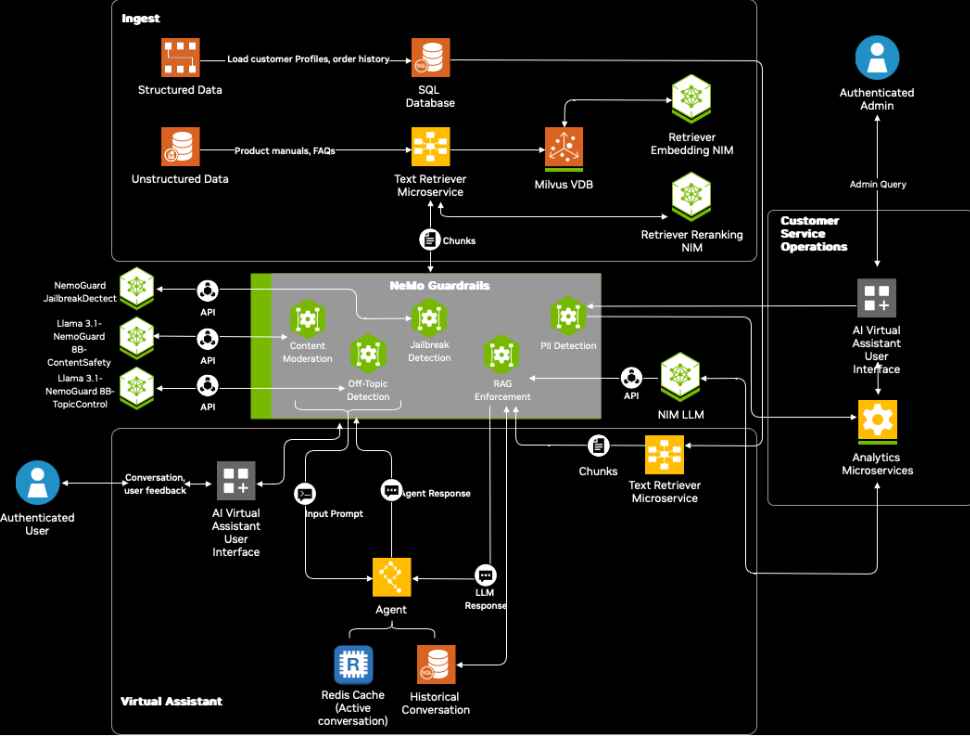

ในฐานะส่วนหนึ่งของเฟรมเวิร์ก NeMo Guardrails ไมโครเซอร์วิสเหล่านี้มอบโซลูชันเฉพาะทางสำหรับการกลั่นกรองเนื้อหา การบำรุงรักษา ขอบเขตการสนทนา และการตรวจจับความพยายามที่จะเลี่ยงการป้องกัน

Kari Briski รองประธานฝ่ายโมเดล AI ระดับองค์กรของ Nvidia เน้นย้ำถึงความสำคัญของการรับรองความปลอดภัยของ AI ในแอปพลิเคชันในปัจจุบัน “ตัวแทน AI กำลังเปลี่ยนแปลงอุตสาหกรรมอย่างรวดเร็วด้วยการโต้ตอบอัตโนมัติ แต่การรับรองความปลอดภัยและความน่าเชื่อถือเป็นสิ่งสำคัญ” เธอระบุในประกาศอย่างเป็นทางการ

[เนื้อหาที่ฝัง]

จัดการกับความท้าทายด้านความปลอดภัยของ AI ด้วยไมโครเซอร์วิสเฉพาะทาง

Agentic AI ซึ่งเป็นปัญญาประดิษฐ์รูปแบบหนึ่งที่ทำงานโดยอัตโนมัติ ได้รับการนำไปใช้ในอุตสาหกรรมต่างๆ เช่น การค้าปลีก การดูแลสุขภาพ และยานยนต์

แม้ว่าระบบเหล่านี้จะเพิ่มประสิทธิภาพและการมีส่วนร่วมของลูกค้า แต่ก็ยังทำให้เกิดความกังวลเกี่ยวกับผลลัพธ์ที่เป็นอันตราย ความเป็นส่วนตัวของข้อมูล และช่องโหว่ของฝ่ายตรงข้าม NIM ของ Nvidia มุ่งหวังที่จะลดความเสี่ยงเหล่านี้ด้วยโซลูชันเป้าหมายสามประการ:

The NIM ความปลอดภัยของเนื้อหา ที่ได้รับการฝึกอบรมเกี่ยวกับกรรมสิทธิ์ ชุดข้อมูลความปลอดภัยของเนื้อหา Aegis ได้รับการออกแบบมาเพื่อตรวจจับและบล็อกเอาต์พุตที่ไม่เหมาะสมหรือเป็นอันตรายจากระบบ AI ชุดข้อมูลนี้ซึ่งประกอบด้วยตัวอย่างที่มีคำอธิบายประกอบโดยมนุษย์มากกว่า 35,000 ตัวอย่าง ช่วยให้โมเดลสามารถระบุและตอบสนองต่อเนื้อหาที่เป็นพิษได้อย่างมีประสิทธิภาพ

ที่เกี่ยวข้อง: NVIDIA พัฒนา Agentic AI ด้วยโมเดล Llama และ Cosmos Nemotron

Nvidia วางแผนที่จะเผยแพร่ชุดข้อมูลต่อสาธารณะผ่าน Hugging Face ในปลายปีนี้ ซึ่งเป็นการขยายขอบเขต การเข้าถึงสำหรับนักพัฒนาและนักวิจัย

การควบคุมหัวข้อ NIM ช่วยให้มั่นใจได้ว่าการโต้ตอบที่ AI สร้างขึ้นจะอยู่ภายในขอบเขตที่กำหนด ป้องกันไม่ให้ระบบหลุดออกไปในหัวข้อที่ไม่เกี่ยวข้องหรือไม่ได้รับอนุญาต เครื่องมือนี้มีประโยชน์อย่างยิ่งในสถานการณ์การบริการลูกค้าที่จำเป็นต้องมีการตอบสนองที่สอดคล้องกันและเกี่ยวข้องกับบริบท

Jailbreak Detection NIM จัดการกับความกังวลที่เพิ่มขึ้นเกี่ยวกับการโจมตีของฝ่ายตรงข้าม ด้วยการวิเคราะห์อินพุตกับชุดข้อมูลที่พยายามเจลเบรกที่ทราบถึง 17,000 ครั้ง ไมโครเซอร์วิสจะระบุและบล็อกข้อความเตือนที่เป็นอันตรายซึ่งออกแบบมาเพื่อแทนที่การป้องกันของระบบ

ผังงานของ รักษาความปลอดภัยให้กับผู้ช่วย AI เสมือนอัจฉริยะสำหรับการบริการลูกค้าด้วย NeMo Guardrails (ภาพ: Nvidia)

ผังงานของ รักษาความปลอดภัยให้กับผู้ช่วย AI เสมือนอัจฉริยะสำหรับการบริการลูกค้าด้วย NeMo Guardrails (ภาพ: Nvidia)

Briski เน้นย้ำถึงประสิทธิภาพของเครื่องมือเหล่านี้ โดยระบุว่า “รุ่นขนาดเล็กเช่นรุ่นใน คอลเลกชัน NeMo Guardrails ให้เวลาแฝงที่ต่ำกว่า ช่วยให้สามารถบูรณาการเข้ากับสภาพแวดล้อมที่มีทรัพยากรจำกัด เช่น คลังสินค้าหรือโรงพยาบาลได้อย่างราบรื่น”

สร้างสมดุลด้านความปลอดภัยและประสิทธิภาพของ AI

A แนวทางที่สำคัญของ Nvidia คือการสร้างสมดุลระหว่างความต้องการด้านความปลอดภัยกับความต้องการประสิทธิภาพสูง Nvidia กล่าวว่าการทดสอบในช่วงต้นบ่งชี้ว่าไมโครเซอร์วิสใหม่เพิ่มเวลาแฝงเพียงประมาณครึ่งวินาทีในขณะที่ปรับปรุงมาตรการความปลอดภัยได้ 50%

ที่เกี่ยวข้อง: NVIDIA เปิดตัวโมเดล Fugatto AI สำหรับเพลง เสียง และเอฟเฟกต์เสียง

การเพิ่มประสิทธิภาพระดับนี้ช่วยแก้ไขข้อกังวลที่พบบ่อยที่สุดประการหนึ่งใน AI ขององค์กร —รับประกันเวลาตอบสนองที่รวดเร็วโดยไม่กระทบต่อความปลอดภัย

“ขึ้นอยู่กับการโต้ตอบของผู้ใช้ LLM หรือการโต้ตอบต่างๆ สามารถทำได้ และคุณต้องป้องกันแต่ละรายการ”Kari Briski กล่าว

กรณีการใช้งานระดับองค์กรและการยอมรับในอุตสาหกรรม

องค์กรขนาดใหญ่หลายแห่งได้รวม NeMo Guardrails เข้ากับขั้นตอนการทำงาน AI ของตนเพื่อเพิ่มความปลอดภัยและความน่าเชื่อถือ ตัวอย่างเช่น Lowe’s ซึ่งเป็นผู้ค้าปลีกอุปกรณ์ปรับปรุงบ้านได้ใช้ เครื่องมือเหล่านี้เพื่อปรับปรุงการโต้ตอบกับลูกค้าและรับประกันความแม่นยำของการตอบสนองที่สร้างโดย AI

Cerence AI ผู้นำด้าน AI ในยานยนต์ ใช้ประโยชน์จากไมโครเซอร์วิสเพื่อขับเคลื่อนเทคโนโลยีผู้ช่วยในรถยนต์ Guardrails ช่วยให้เราส่งมอบการตอบสนองที่เชื่อถือได้ มีสติ และปราศจากภาพหลอน โดยรักษาโมเดลของเราจากผลลัพธ์ที่เป็นอันตราย”Nils Schanz รองประธานบริหารฝ่ายผลิตภัณฑ์และเทคโนโลยีของ Cerence AI อธิบาย

ที่เกี่ยวข้อง: Microsoft ตัดคำสั่งซื้อ Nvidia GB200 โดยจัดลำดับความสำคัญ GB300 ท่ามกลางความล่าช้าในการผลิต

นอกจากนี้ บริษัทอย่าง Amdocs และ Taskus ยังใช้เครื่องมือเหล่านี้เพื่อสร้างความปลอดภัยและ ระบบ AI ที่เชื่อถือได้มากขึ้นสำหรับการมีส่วนร่วมและการสนับสนุนของลูกค้า Amdocs ผู้ให้บริการซอฟต์แวร์ระดับโลกสำหรับการสื่อสารและสื่อ ใช้ NeMo Guardrails เพื่อปรับปรุงการโต้ตอบกับลูกค้าที่ขับเคลื่อนด้วย AI

ความคิดริเริ่มแบบโอเพ่นซอร์สและผลกระทบในวงกว้าง

เพื่อสนับสนุนนักพัฒนาในการทดสอบและเพิ่มความปลอดภัยของ AI Nvidia ได้เปิดตัว Garak ซึ่งเป็นชุดเครื่องมือโอเพ่นซอร์สสำหรับการระบุ ช่องโหว่ในระบบ AI

Garak จำลองสถานการณ์ที่ขัดแย้งกัน รวมถึงการแทรกทันทีและการพยายามแหกคุก ช่วยให้องค์กรต่างๆ เสริมความแข็งแกร่งให้กับโมเดล AI ของตนเพื่อต่อต้าน ภัยคุกคามที่อาจเกิดขึ้น

นักพัฒนายังสามารถเข้าถึง บทช่วยสอนโดยละเอียด และ พิมพ์เขียวอ้างอิง เพื่อปรับปรุงการใช้งาน NeMo Guardrails และไมโครเซอร์วิส แหล่งข้อมูลเหล่านี้ครอบคลุมกรณีการใช้งานที่หลากหลาย ตั้งแต่แชทบอตบริการลูกค้าไปจนถึงผู้ช่วยอัตโนมัติในร้านค้าปลีกและการดูแลสุขภาพ