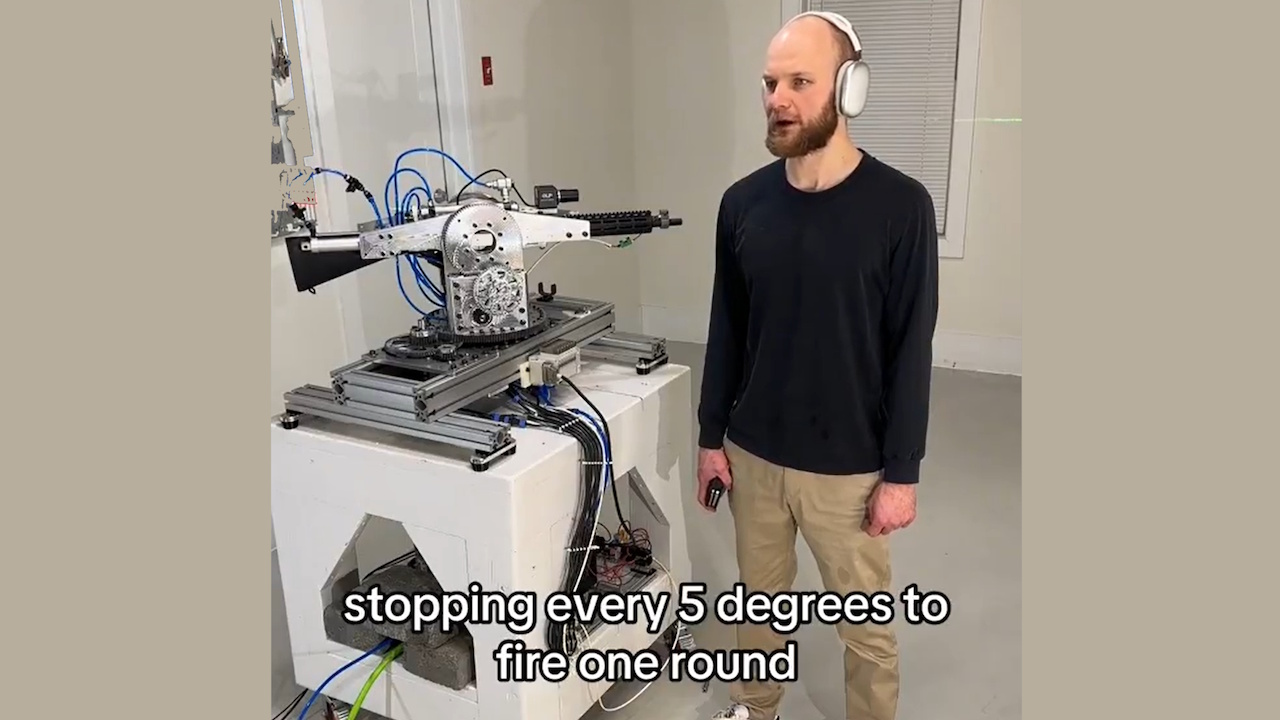

OpenAI ได้เพิกถอนการเข้าถึง API สำหรับนักพัฒนาที่ใช้ Realtime API เพื่อขับเคลื่อนระบบปืนไรเฟิลอัตโนมัติ โครงการนี้เกี่ยวข้องกับป้อมปืนหุ่นยนต์ที่ติดตั้งปืนไรเฟิล สามารถตีความคำสั่งด้วยวาจาและดำเนินการจำลองการยิงได้

เหตุการณ์ดังกล่าวตอกย้ำความกังวลที่เพิ่มขึ้นเกี่ยวกับการใช้ปัญญาประดิษฐ์ในทางที่ผิดที่อาจเกิดขึ้นในการพัฒนาอาวุธอัตโนมัติ ทำให้เกิดคำถามเกี่ยวกับจริยธรรมของ AI และความปลอดภัยของ AI

นักพัฒนาซอฟต์แวร์ที่รู้จักทางออนไลน์ในชื่อ “STS Innovations LLC” แชร์วิดีโอของระบบออนไลน์เพื่อสาธิตการทำงานของระบบ ในคลิปหนึ่ง นักพัฒนาออกคำสั่ง “ChatGPT เราอยู่ภายใต้ การโจมตีจาก ด้านหน้าซ้ายและขวาด้านหน้า”ซึ่งป้อมปืนตอบสนองทันที โดยหมุนและยิงกระสุนไปในทิศทางที่กำหนด

การจำลองการเล็ง/ไฟด้วยเลเซอร์ #โรโบติกส์ #electronics

เสียงสังเคราะห์ที่เพิ่มเข้ามา “ถ้าคุณ หากต้องการความช่วยเหลือเพิ่มเติม โปรดแจ้งให้เราทราบ”การสาธิตสุดระทึกนี้เน้นย้ำว่าเครื่องมือ AI ระดับผู้บริโภคสามารถปรับให้เข้ากับการใช้งานที่อาจเป็นอันตรายได้อย่างง่ายดาย

อัปเดตระบบติดตาม #โรโบติกส์ #วิสัยทัศน์ #อิเล็กทรอนิกส์ ♬ เสียงต้นฉบับ – sts_3d

การบังคับใช้นโยบายที่รวดเร็วของ OpenAI

OpenAI ซึ่งเป็นที่รู้จักในด้านนโยบายที่เข้มงวดในการต่อต้านการใช้เทคโนโลยีในการสร้างอาวุธ ได้ตอบสนองทันที โฆษก บอกกับลัทธิแห่งอนาคตว่า”เราได้ระบุการละเมิดนโยบายของเราในเชิงรุกและแจ้งให้ทราบ นักพัฒนาซอฟต์แวร์ต้องหยุดกิจกรรมนี้ก่อนที่จะรับคำถามของคุณ”

บริษัทเน้นย้ำถึงข้อห้ามในการใช้เครื่องมือเพื่อสร้างหรือใช้งานอาวุธหรือทำให้ระบบอัตโนมัติที่อาจก่อให้เกิดความเสี่ยงต่อความปลอดภัยส่วนบุคคล

<เครื่องหมายคำพูดบล็อก > @sts_3d

ระบบจัดการการหดตัว สาธิตด่วน #robotics #electronics #ซีเอ็นซี

The Realtime API ซึ่งเป็นเครื่องมือที่ออกแบบมาสำหรับ แอปพลิเคชันแบบโต้ตอบช่วยให้นักพัฒนาสามารถแปลงคำสั่งภาษาธรรมชาติให้เป็นอินพุตที่สามารถดำเนินการได้สำหรับป้อมปืนหุ่นยนต์

แม้ว่า API จะมีไว้สำหรับกรณีการใช้งานที่เป็นประโยชน์ เช่น การเพิ่มการเข้าถึงหรือการปรับปรุงการโต้ตอบกับลูกค้า การใช้ในทางที่ผิดนี้แสดงให้เห็นถึงความท้าทายในการควบคุมเทคโนโลยีการใช้งานสองทาง

ที่เกี่ยวข้อง: OpenAI และ Anduril Forge ร่วมมือกันเพื่อการป้องกันโดรนของกองทัพสหรัฐฯ

ผลกระทบในวงกว้างสำหรับ AI และการใช้อาวุธ

คดีนี้กลับมาลุกเป็นไฟอีกครั้ง การอภิปรายเรื่องจริยธรรมของอาวุธอัตโนมัติ ระบบเหล่านี้ซึ่งมีความสามารถในการเลือกและมีส่วนร่วมกับเป้าหมายโดยไม่ต้องมีการควบคุมดูแลของมนุษย์ ก่อให้เกิดความท้าทายทางกฎหมายและศีลธรรมที่ซับซ้อน

สหประชาชาติได้สนับสนุนให้มีกฎระเบียบที่เข้มงวดมากขึ้นเกี่ยวกับ AI ในการทำสงคราม โดยเตือนว่าระบบอัตโนมัติอาจละเมิดกฎหมายระหว่างประเทศและลดความรับผิดชอบ

ที่เกี่ยวข้อง: มานุษยวิทยา ร่วมมือกับ Palantir, AWS สำหรับ AI ในด้านข่าวกรองและการทหารของสหรัฐฯ

รายงานของ Washington Post แบบละเอียดเมื่อเร็วๆ นี้ ตัวอย่างที่น่าหนักใจของการนำ AI ไปใช้ในการปฏิบัติการทางทหาร รวมถึงการกล่าวอ้างว่าอิสราเอลใช้ AI เพื่อเลือกเป้าหมายในการวางระเบิด

รายงานระบุว่า”ในบางช่วงเวลา การยืนยันที่จำเป็นเพียงอย่างเดียวคือเป้าหมายนั้นเป็นผู้ชาย”กรณีดังกล่าวเน้นย้ำถึงความเสี่ยงของการพึ่งพา AI ในการตัดสินใจเรื่องความเป็นหรือความตาย และศักยภาพในการเลือกปฏิบัติโดยไม่เลือกปฏิบัติ ความรุนแรง

ที่เกี่ยวข้อง: Green Beret ใช้ ChatGPT สำหรับ Cybertruck Blast ตำรวจเผยแพร่บันทึกการแชท

บทบาทของ OpenAI ในการป้องกัน เทคโนโลยี

ในขณะที่ OpenAI บังคับใช้นโยบายห้ามการใช้อาวุธ ความร่วมมือกับ Anduril Industries ซึ่งเป็นบริษัทที่เชี่ยวชาญด้านโซลูชันการป้องกันที่ขับเคลื่อนด้วย AI ก็ทำให้เกิดคำถามเกี่ยวกับจุดยืนของตน

การทำงานร่วมกัน มีเป้าหมายเพื่อเพิ่มความฉลาดในสนามรบและปรับปรุงระบบการป้องกันด้วยโดรน OpenAI อธิบายว่าความพยายามเหล่านี้เป็นการป้องกัน แต่นักวิจารณ์แย้งว่าความพยายามเหล่านี้มีส่วนช่วยในการเสริมกำลังทหารในวงกว้างของเทคโนโลยี AI

ภาคกลาโหมของสหรัฐฯ ได้รับการสนับสนุนจากงบประมาณประจำปีเกือบ 1 ล้านล้านดอลลาร์ โดยอาศัยเทคโนโลยีขั้นสูงมากขึ้นเรื่อยๆ เพื่อให้เกิดความได้เปรียบเชิงกลยุทธ์ ที่เกี่ยวข้อง: กลุ่มความร่วมมือ AI Palantir-Anduril ใหม่เพื่อจัดการกับช่องว่างข้อมูลด้านกลาโหมของสหรัฐฯ

ความเสี่ยงในการใช้อาวุธ DIY และการเข้าถึง

ความง่ายดาย ซึ่งบุคคลสามารถใช้เครื่องมือ AI และเทคโนโลยีอื่น ๆ ในทางที่ผิด เช่น การพิมพ์ 3 มิติ ทำให้เกิดปัญหาขึ้น หน่วยงานบังคับใช้กฎหมายได้เผชิญกับกรณีการใช้อาวุธ DIY เช่น การกระทำที่ถูกกล่าวหาของ Luigi Mangione ซึ่ง มีรายงานว่าใช้ชิ้นส่วนที่พิมพ์แบบ 3 มิติเพื่อประกอบอาวุธปืน เทคโนโลยีเหล่านี้ช่วยลดอุปสรรคสำหรับบุคคลในการสร้างระบบอัตโนมัติที่อาจเป็นอันตรายถึงชีวิตได้

โครงการของ STS 3D แสดงให้เห็นว่าเครื่องมือ AI ที่เข้าถึงได้สามารถปรับให้เข้ากับวัตถุประสงค์ที่ไม่ได้ตั้งใจได้อย่างไร การดำเนินการที่เด็ดขาดของ OpenAI ในกรณีนี้แสดงให้เห็นถึงความมุ่งมั่นในการป้องกันการใช้งานในทางที่ผิด แต่ยังตอกย้ำถึงความยากลำบากในการควบคุมวิธีการใช้เทคโนโลยีอย่างเต็มที่เมื่อเข้าสู่โดเมนสาธารณะ

เหตุการณ์ดังกล่าวทำให้เกิดคำถามที่กว้างขึ้นเกี่ยวกับการกำกับดูแลของ เทคโนโลยีเอไอ ผู้สนับสนุนด้านกฎระเบียบเน้นย้ำถึงความจำเป็นในการมีมาตรฐานระดับโลกที่ชัดเจนเพื่อให้แน่ใจว่าการพัฒนา AI สอดคล้องกับหลักการทางจริยธรรม อย่างไรก็ตาม การบรรลุฉันทามติระหว่างประเทศที่มีความสนใจและลำดับความสำคัญต่างกันยังคงเป็นงานที่น่ากังวล