YouTube lanserade ett nytt verktyg på tisdagen för att bekämpa AI-djupförfalskningar, vilket ger kreatörer mer kontroll över sin digitala identitet.

Systemet för likhetsdetektering låter användare hitta och begära borttagning av videor som missbrukar deras ansikte eller röst. Det här steget från den Google-ägda plattformen kommer efter veckor av kontroverser kring OpenAI:s Sora 2-app.

Lanseringen av Sora 2 väckte motreaktioner från Hollywood och kändisfamiljer på grund av otillåtna deepfakes. Detta tvingade OpenAI att snabbt ändra sina regler och samarbeta med skådespelarnas fackföreningar för att förbättra säkerheten, vilket framhävde en växande branschomfattande kamp om kontrollen av AI-genererat innehåll.

YouTube-Likeness-Detection.jpg”>YouTube-Likeness-Detection.jpg>You Rolls Skaparskydd

YouTube-Likeness-Detection.jpg”>YouTube-Likeness-Detection.jpg>You Rolls Skaparskydd

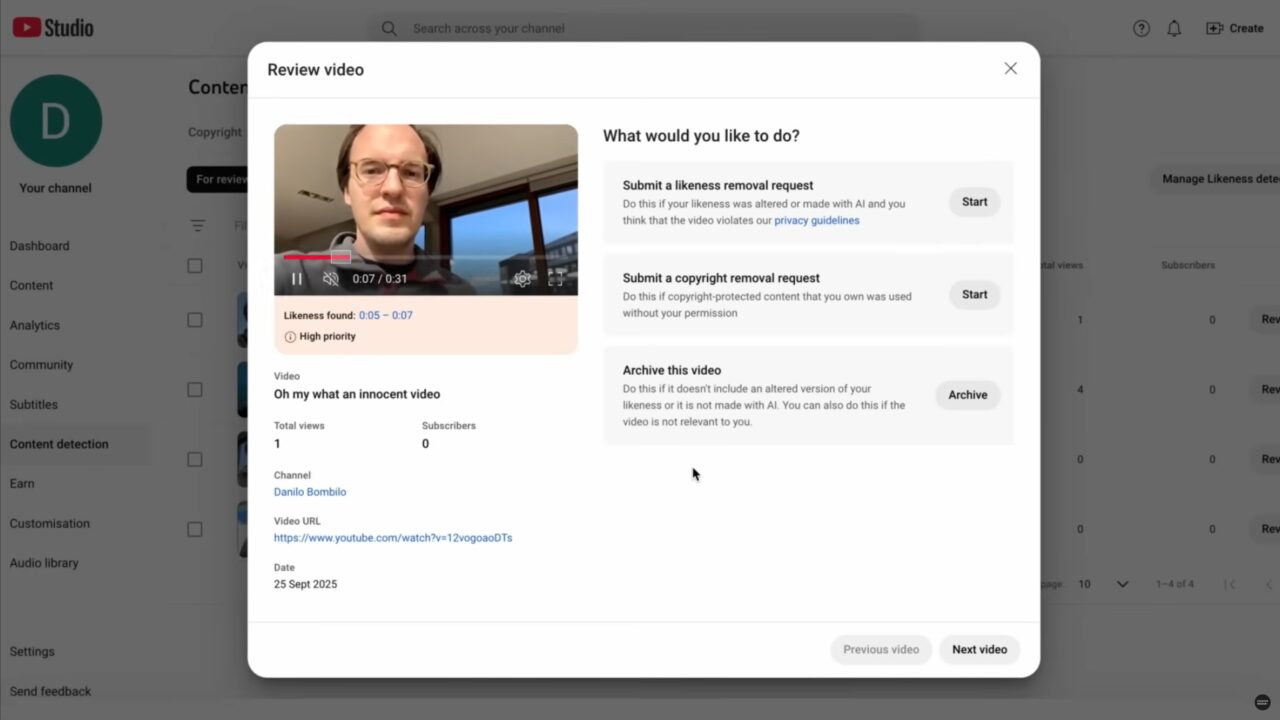

I ett viktigt steg för att stärka sin community har YouTube officiellt lanserat sin likhetsdetekteringsteknik för kvalificerade kreatörer i YouTubes partnerprogram.

Systemet är konstruerat för att identifiera AI-genererat eller förändrat innehåll som använder en kreatörs ansikte eller röst utan deras medgivande. Det erbjuder ett proaktivt försvar mot den stigande vågen av övertygande deepfakes.

För att komma åt verktyget måste kreatörer genomföra en engångsprocess för identitetsverifiering, som kräver ett statligt ID och en kort selfievideo för att förhindra bedrägeri. använd.

Efter introduktionen skannar systemet, som fungerar på liknande sätt som YouTubes etablerade Content ID för upphovsrätt, nya uppladdningar efter potentiella matchningar.

När en möjlig felanvändning inträffar. flaggade kan kreatörer granska videoklippet och välja att lämna in en begäran om borttagning via YouTubes process för integritetsklagomål eller ett standardupphovsrättsanspråk.

Detta ger kreatörer en direkt mekanism för att skydda sitt personliga varumärke och identitet, vilket tar itu med en långvarig rädsla inom kreatörsekonomin om potentialen för digital identitetsstöld att orsaka rykteskada.

[inbäddat innehåll till Open3>A Open Direct Response] YouTubes metodiska utrullning står i skarp kontrast till den kaotiska debuten av OpenAI:s Sora 2-videogenerator. Lanserades i början av oktober, Sora 2:s initiala”opt-out”-policy för offentliga personer och upphovsrättsskyddade karaktärer slog omedelbart tillbaka. Plattformens design, som uppmuntrade snabbt, viralt videoskapande, innebar att användarna översvämmade den sociala appen med obehöriga och ofta kränkande djupförfalskningar, vilket utlöste ett våldsamt protest från allmänheten. Den mest kraftfulla kritiken kom från familjerna till avlidna offentliga personer. Zelda Williams, dotter till skådespelaren Robin Williams, beskrev smärtan av att se”arvet från riktiga människor förtätas till… hemskt, TikTok-slope att spela dem är galet.” De medborgerliga rättighetsledarna Malcolm X och Martin Luther King Jr.s egendomar fördömde också de”respektlösa”och”sårade”. Bernice King, Dr. Kings dotter, gjorde en enkel men resonant vädjan på sociala medier för att filmerna med hennes far skulle sluta. Hollywood mobiliserade snabbt mot plattformen. Den inflytelserika Creative Artists Agency (CAA) märkte appen som en”betydande risk”för sina kunder. Samtidigt lade Motion Picture Association (MPA) den juridiska skyldigheten för missbruk på AI-företaget. MPA:s VD Charles Rivkin sa att”…det förblir deras ansvar – inte rättighetsinnehavarnas – att förhindra intrång på Sora 2-tjänsten.” Denna enhetliga front från den kreativa industrin skapade en fullskalig PR-kris för OpenAI. Företaget stod inför intensiv press och försökte vända kursen. VD Sam Altman tillkännagav en pivot till ett mer detaljerat”opt-in”-system för skyddade karaktärer bara några dagar efter lanseringen. Företaget ändrade senare sina regler för att tillåta representanter för”nyligen avlidna”figurer att blockera deras likheter. Denna policy omsattes i praktiken när OpenAI pausade alla generationer av Martin Luther King Jr. på hans egendoms begäran. I ett uttalande erkände OpenAI den svåra balansen som det stod inför och sa:”Även om det finns starka yttrandefrihetsintressen i att skildra historiska personer, anser OpenAI att offentliga personer och deras familjer ska ha kontroll över hur seriens likhet i slutändan används.”kulminerade den 20 oktober, när OpenAI tillkännagav ett formellt partnerskap med skådespelaren Bryan Cranston och facket SAG-AFTRA för att stärka dess skyddsräcken, ett landmärke som innebär att en ledande AI-utvecklare samarbetar direkt med kreativa fackföreningar för att forma policyn.Navigera i Uncharted Legal and Ethical Territory of The Soyra>

Detta juridiska vakuum, utan någon överordnad federal standard, har tillåtit en spridning av innehåll som, även om det inte alltid är olagligt oroande och olagligt för familjen, skapar betydande känslomässig oro och oro för familjen likadana.

Debatten väcker också grundläggande frågor om hur AI-modeller är utbildade. Kritiker hävdar att branschens beroende av att skrapa enorma mängder webbdata utan uttryckligt tillstånd är en grundläggande fråga som ännu inte har lösts.

Medan OpenAI har uttryckt sitt stöd för federal lagstiftning som NO FAKES Act, oroar sig förespråkare för digitala rättigheter att sådana lagar kan kväva yttrandefriheten och parodierna i denna miljö, om inte den här miljön försiktigt. YouTubes skaparcentrerade verktyg erbjuder en annan väg framåt. Genom att tillhandahålla en tydlig, tillgänglig mekanism för individer att kontrollera sin egen likhet, positionerar plattformen sig själv som en mer ansvarsfull förvaltare av digital identitet.

För skådespelaren Bryan Cranston, som var föremål för otillåtna Sora-klipp, är sådana proaktiva åtgärder väsentliga.”Jag är tacksam mot OpenAI för dess policy och för att ha förbättrat dess skyddsräcken, och hoppas att de och alla företag som är involverade i detta arbete respekterar vår personliga och professionella rättighet att hantera replikering av vår röst och likhet.”

När branschen brottas med dessa nya teknologier, kommer kontrasten mellan OpenAI:s”bygga i offentliga”-kaos och YouTubes olika manskapsstrukturer, nutida verktygsbaserade strukturerade, verktygsbaserade strategier. AI-genererad innehåll.

Resultatet av dessa divergerande strategier kommer sannolikt att skapa avgörande prejudikat för ansvarsfull AI-distribution i det tekniska landskapet.