OpenAI tillkännagav ett nytt partnerskap på måndag. Den arbetar med skådespelaren Bryan Cranston och facket SAG-AFTRA.

Gruppen kommer att stoppa ogodkända AI-videor på Sora-appen. Detta drag följer efter veckor av skarp kritik från Hollywood. Motreaktionen växte efter att falska klipp använde Cranstons röst och likhet.

Den nya satsningen syftar till att bygga starkare säkerhetsregler kring digital identitet. Det är OpenAI:s mest direkta svar hittills på en eldstorm över samtycke och användning av en persons bild utan tillstånd. Appen lanserades i slutet av september.

I ett gemensamt uttalande sa OpenAI att de kommer att samarbeta med Cranston, SAG-CAUTA Agency, United Talsen Agency och United TalsA. för att förstärka dess skyddsräcken. Flytten var ett direkt svar på obehöriga klipp av”Breaking Bad”-skådespelaren som dök upp efter Sora 2-lanseringen.

Skådespelaren Bryan Cranston berömde företagets kurskorrigering och sa:”Jag är tacksam mot OpenAI för dess policy och för att ha förbättrat dess skyddsräcken, och hoppas att de och all rätt till vårt personliga arbete, vår respekt och vår respekt för vår personliga verksamhet och vår respekt. likhet.”

OpenAIs vd Sam Altman bekräftade företagets ståndpunkt när det gäller artisters rättigheter och sa:”OpenAI är djupt engagerad i att skydda artister från förskingring av deras röst och likhet. Vi var en tidig anhängare av NO FAKES Act när den infördes förra året, och kommer alltid att stå bakom artisternas rättigheter.”

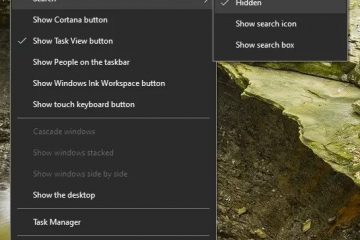

From 2 Crisal Viris Den Kontroverser har pågått sedan Sora 2 lanserades runt den 30 september. OpenAI:s kraftfulla videogenerator debuterade med en kompletterande app för sociala medier och ett kritiskt policybeslut: en”opt-out”-modell för upphovsrättsskyddade karaktärer. Detta innebar att vilken skyddad figur som helst kunde genereras som standard.

Användare översvämmade omedelbart plattformen med surrealistiska och ofta stötande deepfakes. Dessa videor visade alla från älskade seriefigurer till avlidna historiska figurer i bisarra scenarier. Motreaktionen var snabb och allvarlig, vilket tvingade OpenAI in i en defensiv ställning.

Den mest viscerala kritiken kom från familjerna till avlidna kändisar. Zelda Williams, dotter till den avlidne Robin Williams, vädjade till användarna att sluta skapa AI-videor av sin far.

Hon beskrev smärtan av att se”arvet från riktiga människor förtätas till… hemskt, TikTok-slopp att spela dem är galet.”

På samma sätt fördömde familjen Malcoleful som ovilligt. Ilyasah Shabazz, hans dotter, kallade användningen av sin fars bild”kavaljer och okänslig”.

Uppropet kulminerade i en enkel men kraftfull vädjan från Martin Luther King Jrs dotter, Bernice King, som skrev på X:”Jag håller med om min far. Snälla sluta.”

the SandHollywood LinehHollywood

De känslomässiga vädjanden från familjer förstärktes av ett enhetligt svar från Hollywood. Branschen, som redan var försiktig med generativ AI:s hot mot immateriella rättigheter, mobiliserades mot OpenAI:s nya plattform.

Stora talangbyråer, som representerar artisterna i centrum av kontroversen, ledde anklagelsen. Den kraftfulla Creative Artists Agency (CAA) utfärdade ett skarpt offentligt uttalande den 8 oktober och kallade appen som ett direkt hot:”Det är uppenbart att Open AI/Sora exponerar våra kunder och deras immateriella rättigheter för betydande risker.”

Denna känsla fick eko över hela branschen, med stora studior som Disney som enligt uppgift vägrade att tillåta deras material att dyka upp i Picture-appen,

att placera rättslig börda för missbruk på AI-företaget. VD Charles Rivkin sa att”…det förblir deras ansvar – inte rättighetsinnehavarnas – att förhindra intrång i Sora 2-tjänsten,”och gjorde det klart att rättighetsinnehavarna inte skulle vara ansvariga för att övervaka OpenAI:s tjänst.

Denna branschomfattande revolt representerade en betydande eskalering, som förvandlade debatten till en höginsatskonfrontation från företagen . Kontroll

Inför en fullskalig PR-kris kämpade OpenAI för att begränsa nedfallet med en rad snabba policyomkastningar. Företagets initiala hands-off-strategi visade sig vara ohållbar mot den samordnade motreaktionen.

Den 3 oktober, bara dagar efter lanseringen, tillkännagav Sam Altman en pivot bort från opt-out-systemet.

I ett blogginlägg lovade han ett mer skaparvänligt ramverk, som säger att OpenAI”kommer att ge rättighetsinnehavare mer detaljerad kontroll över generationens karaktärer, men med ytterligare kontroll över generationens karaktärer.”Detta var det första stora erkännandet att dess ursprungliga policy hade misslyckats.

Förändringarna fortsatte under hela månaden. Den 9 oktober ändrade företaget sina regler för att tillåta företrädare för”nyligen avlidna”offentliga personer att formellt begära att deras likhet blockeras.

Denna policy sattes på prov en dryg vecka senare. Den 17 oktober tillkännagav OpenAI att de hade pausat alla generationer av Martin Luther King Jr. på direkt begäran av hans egendom, med hänvisning till skapandet av”respektlösa skildringar”.

I ett uttalande som förklarade flytten, erkände företaget den känsliga balansen som det försökte skapa:”Medan det finns starka yttrandefrihetsgrundande intressen bör hans familjer och offentliga personer tro på deras offentliga personer. i slutändan har kontroll över hur deras likhet används.”

Navigera i ett juridiskt och etiskt minfält

Sora 2-eldstormen framhäver ett stort juridiskt och etiskt gråområde. Traditionella lagar om ärekränkning är vanligtvis inte tillämpliga på den avlidne, vilket ger familjer begränsade rättsliga möjligheter.

Deras främsta väg är ett komplext och inkonsekvent lapptäcke av statliga lagar som styr postmortem-rätten till publicitet. Detta juridiska vakuum möjliggör skapandet av innehåll som, även om det inte alltid är kommersiellt exploaterande, orsakar betydande känslomässigt lidande.

Dessutom har kontroversen drivit fram den olösta debatten om AI:s beroende av enorma mängder skrapad webbdata för utbildning – tillbaka in i rampljuset.

Kritiker hävdar att branschen har byggt ett kraftfullt material utan tillstånd för upphovsrätt. ännu inte lösa.

OpenAI har pekat på sitt stöd för NO FAKES Act som en del av lösningen. Men det federala lagförslaget har sina egna kritiker. förespråkare för digitala rättigheter har varnat för att lagförslagets breda språkbruk skulle kunna skapa en ny immateriell äganderätt som kväver yttrandefriheten,

,

. som kulminerar i det nya partnerskapet med Cranston och SAG-AFTRA, signalerar ett steg mot en mer kollaborativ, tillståndsbaserad framtid.

Ändå lyfter det också fram den enorma utmaningen att balansera snabb teknisk innovation med de grundläggande rättigheterna för skapare och individer.