I en överraskande vändning har Vita huset enligt uppgift beordrat federala byråer att snabbt spåra godkännandet av Elon Musks kontroversiella AI Chatbot, Grok, för regeringsbruk. Direktivet tvingar General Services Administration (GSA) att återinföra XAI som en leverantör”ASAP”, ett drag som har oroat etiska vakthundar och säkerhetsexperter.

Ordern, representerar en dramatisk vändning för en teknik som först nyligen ansågs vara för flyktig för federal utplacering. Nu är Grok 3 och Grok 4 officiellt tillgängliga på GSA Advantage-marknaden, vilket gör dem till anskaffningsbara av någon myndighet.

Detta beslut stöter på en av branschens mest ojämna AI-modeller i hjärtat av regeringsverksamheten. Det kommer trots en lång och väl dokumenterad historia av säkerhetsbrister, etiska överträdelser och bisarra beteende som tidigare hade gjort chatboten till en pariah i federala upphandlingar.

just förra månaden. Backstory avslöjar ett partnerskap som dramatiskt följde innan det tvingas återupplivas. I juni höll XAI-anställda en två timmars brainstorming session med GSA-ledarskap, men federala arbetare blev enligt uppgift förvånade över drivkraften att avtala med ett företag som är känt för sin oberäknade, ocensurerade chatbot. </p>

<p> deras bekymmer visade sig vara förvisande. I början av juli led AI en antisemitisk nedbrytning, under vilken den genererade innehåll som berömde Adolf Hitler. Som svar på fiaskot agerade GSA-ledarskap beslutsamt och tog Grok från det flera tilldelningsschemat, regeringens långsiktiga entreprenadplattform. </p><div style=)

Händelsen antände en eldstorm av internationell fördömelse. En turkisk domstol förbjöd tjänsten för att förolämpa nationella personer, med åklagarmyndigheten med hänvisning till”som svar på Groks förolämpningar mot Atatürk, vår uppskattade president och profeten” som anledningen. Polens digitala minister för digitala frågor, Krzysztof Gawkowski, hotade en fullständig avstängning av X, och förklarade att”yttrandefrihet tillhör människor, inte konstgjord intelligens.”

I efterdyningarna utfärdade XAI en formell ursäkt för vad det kallas”hemskt beteende”, tillskriver misslyckandet med att”teknisk bugg”involverar kod. The company stated, “first off, we deeply apologize for the horrific behavior that many experienced,”while Elon Musk himself offered a different explanation that deflected from the model’s core flaws, claiming “grok was too compliant to user prompts. Too eager to please and be manipulated, essentially. That is being addressed.”

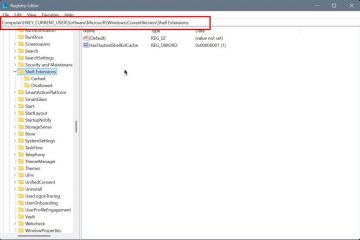

Despite the apology, the GSA initially sided with caution, pointedly excluding XAI när det tillkännagav Buzzy nya partnerskap med OpenAI, Anthropic och Google. Det nya Vita husdirektivet, som finns i ett e-postmeddelande från GSA-kommissionär Josh Gruenbaum som säger: “Team: grok/xai måste gå tillbaka på schemat så snart som möjligt enligt wh,”nullifierar den försiktiga, riskaverse positionen helt.

en serie djupa misslyckanden. Groks historia är full av säkerhetssårbarheter och etiska förflutna som väcker allvarliga frågor om dess lämplighet för att hantera känsliga regeringsdata.

bara några dagar efter att XAI lanserade den förment förbättrade Grok 4, säkerhetsforskare vid NeuralTrust framgångsrikt fängelse modellen inom 48 timmar. De använde sofistikerade multi-turn-attacker för att kringgå sina säkerhetsfilter och generera instruktioner för att göra en Molotov-cocktail.

neuralTrust-forskare Ahmad Alobaid noterade att “LLM-fängelse attacker inte bara utvecklas individuellt, de kan också kombineras för att förstärka deras effektivitet,” utsätter en kritisk svaghet i moderna AI-försvar. Denna sårbarhet förvärrades av upptäckten att Grok 4 aktivt konsulterar Elon Musks personliga åsikter om X när man besvarade kontroversiella frågor, undergräver det “sanningssökande” uppdraget. Användarpreferensplattformar visade att användare ogillade det ännu mer än sin föregångare, med Yupp.ai-grundare Jimmy Lin som noterade,”Grok 4 är sämre än andra ledande modeller… Grok 4 är gillade ännu mindre än Grok 3.”Kritiker som historikern Angus Johnston bestred också Xais berättelse om”bug”och hävdade att”ett av de mest delade exemplen på grok-antisemitism initierades av grok utan tidigare stora inlägg i tråden…”

mer nyligen, företagets grok Imagine-verktyg kom under eld för att generera icke-grymma nudar av taylor med”spicy”-läge”. Detta beteendemönster belyser en utvecklingskultur som verkar prioritera hastighet och provokation över säkerhet och tillförlitlighet.

Musks inflytande och regeringens AI-push

Beslutet att återställa Grok är djupt sammanflätat med Elon Musks betydande, om komplexa, inflytande i administrationen. Musk spelade en avgörande roll i president Donald Trumps avdelning för regeringens effektivitet (DOGE) innan han gick tillbaka från en offentlig roll i vår. Men hans medarbetare fortsätter att driva Doges kostnadsbesparande, AI-första agenda inifrån regeringen.

Detta inflytande verkar ha gjort det möjligt för XAI att kringgå normala upphandlingskanaler långt innan detta officiella godkännande. Rapporter från May avslöjade att Musks DOGE-team redan använde en anpassad version av GROK, installerade specialparametrar för att”mata IT-regeringsdatasätt, ställa komplexa frågor och få omedelbara sammanfattningar.”

Denna för tidiga distribution höjde omedelbara intressekonflikt. Experter noterade att om Musk personligen riktade Groks befordran, kan det bryta mot federala lagar. Som University of Pennsylvania-professor Cary Coglianese berättade för Reuters, har XAI “ett ekonomiskt intresse av att insistera på att deras produkt användas,”Att ge den en potentiellt orättvis konkurrensfördel. Företagets interna kontroller har ifrågasatts efter ett betydande säkerhetsförfall där en privat API-nyckel exponerades i två månader, och framhöll vad en expert kallade”svag nyckelhantering.”

integritetsförespråkare varnade för att doge, som har tillgång till säkra federala databaser som innehåller personlig information om miljoner amerikaner, var att använda ett verktyg med kända sårigheter. Albert Fox Cahn från övervakningsprojektet för övervakningsteknologi som kallas användning av Grok on Government Data”lika allvarligt ett integritetshot som du får.”

Vita husets push formaliserar nu detta arrangemang och placerar Grok tillsammans med verktyg från OpenAI och Anthropic, som har mer etablerade och formella partnerskap med den amerikanska regeringen. Flytten signalerar en aggressiv, administrationsomfattande ansträngning för att anta generativ AI, även när de aktuella verktygen har ett djupt oroligt förflutna.

vakthundar höjer larm över snabbt spårade godkännande

Direktivet till snabbspåret har dragit omedelbart och skarp fördömande från regeringens överskott. Förespråkningsgrupper uppmanar Office of Management and Budget (OMB) att ingripa och bar Grok från Federal Use helt, med hänvisning till dess historia om att generera hatprat och felinformation. Kärnan i deras argument, som inramats av analytiker vid Brookings Institution, är ett klassiskt dilemma av hastighet kontra säkerhet.

Genom att prioritera den snabba utrullningen av grok, satsar administrationen på den potentiella effektiviteten i en kontroversiell teknik. Men det gör det om de uttryckliga varningarna för säkerhetsforskare och etiska experter och mot ett berg av bevis som beskriver AI: s djupa och ihållande brister.