Anthropic uppdaterar sin integritetspolicy, vilket gör den till den senaste stora AI-utvecklaren att använda konsumentchattdata för modellutbildning som standard. Börjar omedelbart för nya användare och ansöker om befintliga användare som inte väljer ut senast den 28 september, kommer företaget att behålla och analysera samtal från sina Claude AI-tjänster för att förbättra framtida modeller.

Denna skift anpassar antropiska med konkurrenter som Google och Meta, som har liknande opt-out-policyer. The move intensifies the ongoing debate over user privacy and data control in the race for more powerful AI, placing the burden on individuals to actively manage how their personal information is used.

Anthropic Adopts Opt-Out Data Training Policy

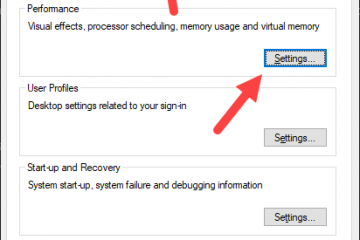

Under the new terms, data from users of Claude’s free, Pro, and Max tiers will be collected unless they navigate to their settings and Välj uttryckligen bort . För dem som samtycke förlänger Anthropic också sin datalagringsperiod avsevärt, från de föregående 30 dagarna till fem år.

Den policyn är på liknande sätt bred och täcker användaruppladdade filer, foton, videor och till och med skärmdumpar som användare ställer frågor om. Likaså kommer Metas AI-app, som lanserades i april 2025, också minns användarchattar som standard för att anpassa svar och visade sig fånga känsliga detaljer som härleds från chattar.

Denna konvergens av strategier bland stora tekniska spelare underkörar det enorma värdet av verkliga användardata i konkurrensloppet för att bygga mer kapacitet och kontext och kontext och kontext och sammanhang. Juridiska prejudikatmontering

Denna branschövergripande pivot har möttes med betydande motstånd från integritetsförespråkare och har utlöst juridiska utmaningar. Kritiker hävdar att dessa opt-out-system är utformade för att avskräcka användare från att skydda sina data. Ben Winters of the Consumer Federation of America kallade sådana upplysningar och val”Upplysningar och konsumentval kring sekretessinställningar är skrattande dåliga.”

Det lagliga landskapet blir också mer farliga för teknikföretag. I januari 2025 inlämnades en stämningsansökan mot LinkedIn, och anklagade den för att ha använt privata Inmail-meddelanden från premiumbonnenter för att utbilda AI-modeller, påstås kränka alla användarchatter-hade de användarnas eventuella bevis. Denna härskande oroade integritetsexperter som Jay Edelson, som varnade:”Idén att du har ett gäng advokater som kommer att göra vad de är med några av de mest känsliga uppgifterna på planeten… bör göra alla oroliga.”

Dessa fall belyser en växande spänning mellan den tekniska industrins törst till data och dess lagliga skyldigheter till användare. Många anser att balansen är avstängd, med Justin Brookman från konsumentrapporter som noterar,”Idén med en agent är att det fungerar för min räkning-inte för att försöka manipulera mig för andras räkning.”

en tydlig klyftan: strängare integritet för enterprise-användare

en CRUCIAL i CRUCIAL I CUTIME i dessa policyer är en tydlig linje företag. Anthropic säger uttryckligen sin nya opt-out-policy gäller inte dess kommersiella erbjudanden , inklusive Claude för arbete, gov, utbildning eller dess API-kunder. Företag erbjuder starkare integritetsgarantier och datasegregering till betalande företagskunder, som hanterar känslig företagsinformation och kräver strängare kontroller. Detta skapar ett tvåskiktssystem där vardagliga användare behandlas som en resurs för modellträning.

När AI blir mer integrerad i det dagliga livet, kommer denna klyftan sannolikt att driva ytterligare debatt om rättvisa och samtycke. Som en forskare från University of Oxford, Caroline Green, konstaterade:”Det finns lite problem när det gäller AI-utveckling, där etiken och människorna är en andra tanke, snarare än utgångspunkten.”

meta talesman Thomas Richards försvarade hans företags tillvägagångssätt,”Vi har tillhandahållit värderande personlig personalisering för människor på vår plattform för beslut… Det är rätt för dem,”men för många berättar standardinställningarna en annan historia.