Metas fristående AI-applikation har antänt en eldstorm av kritik och skapat vad många kallar en integritetskatastrof av offentligt sänder användarnas till synes privata och ofta djupt personliga samtal för alla att se. Appens”Discover”-flöde, avsett som en social funktion, är istället att avslöja en kontinuerlig ström av känsliga användarfrågor på allt från juridiska problem till medicinska sjukdomar, i en fiasko som en författare för TechCrunch som beskrivs som”The Start of a 21st Century Horror Film: Your Browser History har varit public hela tiden, och du hade ingen idé.”

lust i april. interaktioner. Torrenten av offentligt synliga inlägg tyder dock på att många är helt medvetna om att de publicerar sina privata tankar. Som rapporterats av Wired , dessa delade chattar inkluderar en 66-årig man som frågar. Meta hävdar att chattar är privata som standard och bara blir offentliga efter att användare har slutfört en delningsprocess med flera steg, det offentliga flödet är full av bevis på användarförvirring. Integritetsexperter har funnit situationen “otroligt beträffande”, förklarar att den avslöjar en grundläggande offentlig missförstånd av hur moderna AI-system och datasekretess fungerar. This design choice has created a privacy nightmare where users’ names and profile photos are attached to their most sensitive inquiries.

Flawed by Design: A Social Feed of Private Thoughts

Kärnan i frågan ligger i appens sociala-för-design”Discover”-flöde. När appen lanserades sa Metas VP för produkten, Connor Hayes, att flödet var avsett att”avmystifiera AI”genom att visa vad den kunde göra. I praktiken har det blivit en offentlig huvudbok av privata stunder och har gjort jämförelser med den ökända AOL-dataläckan 2006 detaljerad av The New York Times , där pseudonymiserade användaresökningshistorier publicerades.

Exemplen på oavsiktlig överdelning är omfattande. Säkerhetsexpert Rachel Tobac hittade instanser av användare som delar hemadresser och känsliga domstolsinformation, medan andra synliga frågor inkluderar användare som ber om hjälp av hjälp av en hyresgäst. Förväntningar om hur ett verktyg fungerar inte matchar verkligheten, du har dig en enorm användarupplevelse och säkerhetsproblem.

Människor har byggt ett schema runt AI-chattbots och förväntar sig inte att deras AI-chattbot-anvisningar kommer att dyka upp i ett socialt mediestil Discover Feed-… June 12, 2025

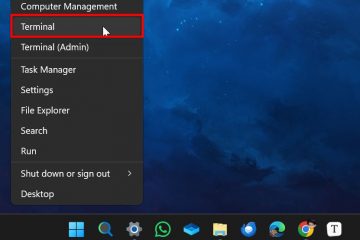

A key reason for the confusion may be the lack of any Sekretessrelaterade instruktioner eller pop-ups när de först använder appen, att placera användare direkt i gränssnittet utan varning om att deras chattar kan bli offentliga.

Bakstället från integritetsförespråkare har varit snabb. Mozilla Foundation har Formellt krävde att meta stänger av”upptäckt”-foderfördelningen tills rätt kan vara implementerade, kallar för alla intrång. The problem has become so apparent that some users have begun trolling the platform, asking how to make water bottle bongs or sharing their résumés to ask for cybersecurity jobs.

The Data Engine: Memory, Training, and Future Ads

Beyond the public-facing issues of the Discover feed, the Meta AI app operates on a data-hungry model that has sparked separate but related privacy oro. Appens”Memory”-funktion är på som standard och analyserar automatiskt och lagrar fakta från användarsamtal för att anpassa framtida svar. Metas egna servicevillkor varnar otydligt användare:”Dela inte information som du inte vill att AIS ska använda och behålla.”

Enligt The Washington Post Att avslöjningarna och privata inställningar”är skratta. Europa. Max Schrems, ordförande för Noyb, framhöll det rättsliga prejudikatet och noterade att Europeiska domstolen redan har avvisat Metas”legitima intresse”påstående för reklam. Han ställde sedan den kritiska frågan:”Hur ska det ha ett”legitimt intresse”att suga upp all data för AI-utbildning?”

Vidare kan dessa intima samtal snart driva Metas primära verksamhet, som CEO Mark Zuckerberg har öppet nämnt en stor möjlighet att visa annonser inom AI Interaktioner.

Metas aggressiva tryck av sina AI-produkter, trots deras uppenbara brister, äger rum mot bakgrund av enormt inre tryck och strategisk brådskande. Företaget gör kolossala investeringar för att komma ikapp i AI Arms-loppet, framhävt av en nyligen genomförd $ 14 miljarder avtal för en 49%-andel i Data-Mabeling Firm Scale AI. The deal installs Scale AI’s founder, Alexandr Wang, at the head of a new “superintelligence”lab within Meta.

This move is viewed by analysts as a massive ‘Acqui-Hire’ Designad för att kringgå interna utvecklingsflaskhalsar efter att en allvarlig talangavlopp såg att det mesta av det ursprungliga Llama-forskarteamet avgår till konkurrenterna. Investeringen följer betydande förseningar i utvecklingen av Metas nästa generations”Behemoth”AI-modell. Affärens struktur, en 49%-andel snarare än ett fullständigt förvärv, ses också av vissa som en strategisk manöver för att undvika ytterligare antitrustgranskning från tillsynsmyndigheter.

Partnerskapet ger också Meta till en närmare anpassning till skala AI: s kontroversiella och omfattande arbete som ett viktigt kontrakt för Pentagon. Scale AI’s founder has been a vocal proponent of this work, arguing in a recent op-ed that there is “no room for neutrality in the global technology race.”

This fusion of a consumer tech giant with a firm deeply embedded in military AI adds another layer of ethical complexity to Meta’s AI ambitions, which are already shadowed by ongoing lawsuits alleging its models were trained on pirated Böcker.

I slutändan är Meta AI-appens integritetskris inte en isolerad incident utan en direkt följd av företagets bredare strategi. I sin höga insatser för att bygga ett dominerande, allomfattande AI-ekosystem, rör sig Meta i en brythck, drivs av massiva investeringar och en glupsk aptit för användardata. Det felaktiga”Discover”-foderen visar att användarens integritet i denna sprint för AI-överhöghet har blivit ett acceptabelt skadet, tvingat en svår avvägning för konsumenterna och inbjudande oundvikliga sammanstötningar med tillsynsmyndigheter över hela världen.