YouTube a lansat marți un nou instrument pentru a lupta împotriva falsurilor profunde ale inteligenței artificiale, oferind creatorilor mai mult control asupra identității lor digitale.

Sistemul de detectare a asemănării le permite utilizatorilor să găsească și să solicite eliminarea videoclipurilor care le folosesc greșit chipul sau vocea. Această mișcare a platformei deținute de Google vine după săptămâni de controverse în jurul aplicației Sora 2 de la OpenAI.

Lansarea Sora 2 a stârnit o reacție din partea Hollywood-ului și a familiilor celebrităților cu privire la falsurile neautorizate. Acest lucru a forțat OpenAI să-și schimbe rapid regulile și să colaboreze cu sindicatele actorilor pentru a îmbunătăți siguranța, evidențiind o luptă în creștere la nivel de industrie asupra controlului conținutului generat de inteligență artificială.

YouTube Rolls Out. pentru protecția creatorilor

YouTube Rolls Out. pentru protecția creatorilor

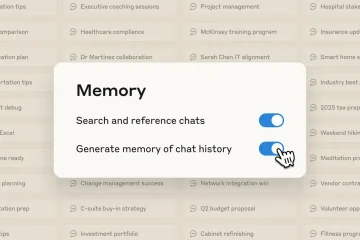

Într-un pas important pentru a-și împuternici comunitatea, YouTube și-a lansat oficial tehnologia de detectare a asemănării pentru creatorii eligibili în Programul de parteneriat YouTube.

Sistemul este proiectat pentru a identifica conținutul generat de AI sau modificat care utilizează chipul sau vocea unui creator fără consimțământul acestuia. Oferă o apărare proactivă împotriva valului în creștere al deepfake-urilor convingătoare.

Pentru a accesa instrumentul, creatorii trebuie să finalizeze un proces unic de verificare a identității, care necesită un act de identitate guvernamental și un videoclip scurt selfie pentru a preveni fraudele. utilizați.

După integrare, sistemul, care funcționează similar cu Content ID stabilit de YouTube pentru drepturi de autor, scanează noile încărcări pentru potriviri potențiale.

Când o posibilă potrivire. Utilizarea abuzivă este semnalată, creatorii pot examina videoclipul și pot alege să depună o cerere de eliminare prin procesul YouTube de reclamație privind confidențialitatea sau o revendicare standard privind drepturile de autor.

Acest lucru le oferă creatorilor un mecanism direct de a-și proteja marca și identitatea personală, abordând o temere de lungă durată în economia creatorilor cu privire la potențialul ca uzurparea identității digitale să cauzeze prejudicii reputației.

[Conținutul încorporat>A Open AI] Deepfake Firestorm

Lansarea metodică a lui YouTube contrastează puternic cu debutul haotic al generatorului de videoclipuri Sora 2 de la OpenAI.

Lansată la începutul lunii octombrie, politica inițială de „renunțare” a Sora 2 pentru personalitățile publice și personajele protejate prin drepturi de autor a dat imediat înapoi. Designul platformei, care a încurajat crearea rapidă și virală de videoclipuri, a însemnat utilizatorii să inunde aplicația socială însoțitoare cu falsuri neautorizate și adesea ofensatoare, stârnind o strigăre publică aprigă.

Cea mai puternică critică a venit din partea familiilor personalităților publice decedate. Zelda Williams, fiica actorului Robin Williams, a descris durerea de a vedea „moștenirile oamenilor adevărați condensate în… oribile, păpușarea TikTok este înnebunitoare.”

Moșiile liderilor pentru drepturile civile Malcolm X și Martin Luther King Jr. au condamnat, de asemenea, reprezentațiile „nerespectuoase” și „rănitoare”. Bernice King, fiica doctorului King, a făcut o cerere simplă, dar rezonantă pe rețelele de socializare, pentru ca videoclipurile tatălui ei să înceteze.

Hollywood s-a mobilizat rapid împotriva platformei. Influenta Creative Artists Agency (CAA) a etichetat aplicația drept „risc semnificativ” pentru clienții săi. Între timp, Motion Picture Association (MPA) a pus sarcina legală de utilizare abuzivă în mod direct companiei AI. CEO-ul MPA, Charles Rivkin, a declarat că „… rămâne responsabilitatea lor – nu a deținătorilor de drepturi – să prevină încălcarea serviciului Sora 2.”

Acest front unificat al industriei creative a creat o criză de PR în general pentru OpenAI.

Confruntându-se cu o presiune intensă, compania s-a grăbit să inverseze cursul. CEO-ul Sam Altman a anunțat schimbarea către un sistem mai granular, de „înscriere” pentru personajele protejate, la doar câteva zile după lansare.

Compania și-a modificat ulterior regulile pentru a le permite reprezentanților figurilor „decedate recent” să le blocheze asemănările. Această politică a fost pusă în practică atunci când OpenAI a întrerupt toate generațiile de Martin Luther King Jr. la cererea moșiei sale.

Într-o declarație, OpenAI a recunoscut echilibrul dificil cu care se confruntă, spunând: „Deși există un puternic interes pentru libertatea de exprimare în a descrie personaje istorice, OpenAI crede că personalitățile publice și familiile lor ar trebui să aibă în cele din urmă controlul asupra modului în care asemănarea lor ar trebui să dețină controlul asupra modului în care aceste măsuri sunt utilizate în cele din urmă. a culminat pe 20 octombrie, când OpenAI a anunțat un parteneriat oficial cu actorul Bryan Cranston și sindicatul SAG-AFTRA pentru a-și consolida balustradele de siguranță, o mișcare de reper care vede un dezvoltator de inteligență artificială de vârf colaborând direct cu sindicatele creative pentru a modela politica.

Navigarea pe teritoriul neexplorat juridic și etic al AI

>

2 și noul instrument YouTube evidențiază vasta zonă gri juridică și etică din jurul IA generativă. Legile tradiționale în materie de defăimare nu se aplică adesea persoanelor decedate, lăsând familiile cu un mozaic de drepturi de publicitate post-mortem inconsecvente la nivel de stat ca singurul lor recurs.

Acest vid legal, fără un standard federal imperativ, a permis proliferarea conținutului care, deși nu întotdeauna este ilegal, provoacă nesiguranță emoțională semnificativă și nesiguranță emoțională și pentru platforme asemănătoare. se reaprinde și dezbaterea întrebări fundamentale despre modul în care sunt antrenate modelele AI. Criticii susțin că dependența industriei de eliminarea unor cantități masive de date web fără permisiune explicită este o problemă fundamentală care nu a fost încă rezolvată.

În timp ce OpenAI și-a exprimat sprijinul pentru legislația federală, cum ar fi Actul NO FAKES, susținătorii drepturilor digitale se îngrijorează că astfel de legi ar putea înăbuși libertatea de exprimare și parodia, dacă nu este creat cu atenție, acest mediu turbulent, incorect YouTube. instrumentul oferă o cale diferită înainte. Oferind un mecanism clar și accesibil pentru ca indivizii să-și controleze propria asemănare, platforma se poziționează ca un administrator mai responsabil al identității digitale.

Pentru actorul Bryan Cranston, care a făcut obiectul unor clipuri Sora neautorizate, astfel de măsuri proactive sunt esențiale. „Sunt recunoscător OpenAI pentru politica sa și pentru îmbunătățirea barajelor sale și sper că ei și toate companiile implicate în această activitate ne respectă dreptul personal și profesional de a gestiona replicarea vocii și asemănării noastre.”

În timp ce industria se confruntă cu aceste noi tehnologii, contrastul dintre haosul „construiți în public” al OpenAI și abordarea YouTube, structurată și bazată pe instrumente, a două filosofii de gestionare a viitorului, bazate pe instrumente foarte diferite. Conținut generat de AI.

Rezultatul acestor strategii divergente va crea probabil precedente cruciale pentru implementarea responsabilă a AI în peisajul tehnologic.