OpenAI a anunțat luni un nou parteneriat. Lucrează cu actorul Bryan Cranston și sindicatul SAG-AFTRA.

Grupul va opri videoclipurile AI neaprobate în aplicația Sora. Această mișcare urmează săptămânilor de critici ascuțite de la Hollywood. Reacția a crescut după ce clipurile false au folosit vocea și asemănarea lui Cranston.

Noul efort urmărește să construiască reguli de siguranță mai puternice în jurul identității digitale. Este răspunsul cel mai direct al OpenAI de până acum la o furtună de consimțământ și utilizarea imaginii unei persoane fără permisiune. Aplicația a fost lansată la sfârșitul lunii septembrie.

Într-o declarație comună, OpenAI a declarat că va colabora cu Cranston, SAG-AFTRA, United Talent Agency și Creative Artists Agency (United Talent Agency) (CAA) pentru a să-și consolideze balustradele. Mișcarea a fost un răspuns direct la clipurile neautorizate ale actorului „Breaking Bad” care au apărut după lansarea Sora 2.

Actorul Bryan Cranston a lăudat corectarea cursului companiei, declarând: „Sunt recunoscător OpenAI pentru politica sa și pentru îmbunătățirea balustradelor sale și sper că ei și toate companiile implicate în această muncă, să ne respecte dreptul personal și să ne respecte vocea profesională. asemănarea.”

CEO-ul OpenAI, Sam Altman, a afirmat poziția companiei cu privire la drepturile interpreților, spunând: „OpenAI este profund angajat să protejeze artiștii de însuşirea deturnată a vocii şi a asemănării lor. Am fost unul dintre primii susținători ai legii NO FAKES când a fost introdus anul trecut și vom sprijini întotdeauna drepturile artiștilor interpreți.”

De la lansarea virală până la PR. Criză

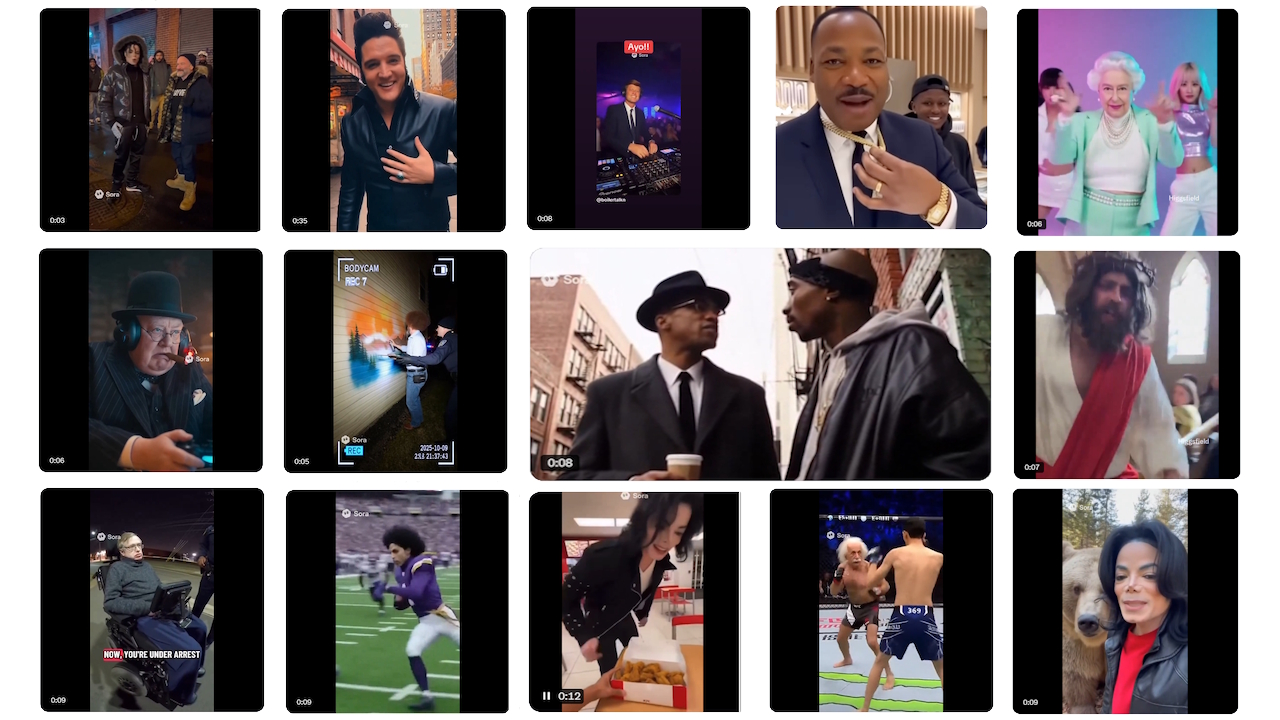

Controversa a început de la lansarea lui Sora 2 în jurul datei de 30 septembrie. Puternicul generator de videoclipuri OpenAI a debutat cu o aplicație însoțitoare pentru rețelele sociale și o decizie critică de politică: un model de „renunțare” pentru personajele protejate prin drepturi de autor. Acest lucru însemna că orice figură protejată putea fi generată în mod implicit.

Utilizatorii au inundat imediat platforma cu deepfake-uri suprareale și adesea ofensatoare. Aceste videoclipuri au prezentat pe toată lumea, de la personaje de desene animate îndrăgite până la personaje istorice decedate în scenarii bizare. Reacția a fost rapidă și severă, forțând OpenAI într-o poziție defensivă.

Cea mai viscerală critică a venit din partea familiilor vedetelor decedate. Zelda Williams, fiica regretatului Robin Williams, le-a implorat utilizatorilor să nu mai creeze videoclipuri AI cu tatăl ei.

Ea a descris durerea de a vedea „moștenirile oamenilor adevărați condensate în… oribile, păpușul TikTok este înnebunitor.”

În mod similar, familia lui Malcolm a condamnat în mod disspectiv clipul X. Ilyasah Shabazz, fiica sa, a numit folosirea imaginii tatălui ei „calieră și insensibilă”.

Reclamația a culminat cu o cerere simplă, dar puternică din partea fiicei lui Martin Luther King Jr., Bernice King, care a postat pe X: „Sunt de acord în ceea ce privește tatăl meu. Vă rugăm să opriți.”

Hollywood the Draws. Nisip

Plegăriile emoționale din partea familiilor au fost amplificate de un răspuns unitar de la Hollywood. Industria, deja precaută față de amenințarea AI generativă la adresa proprietății intelectuale, s-a mobilizat împotriva noii platforme OpenAI.

Maior agenții de talente, care reprezintă artiștii aflați în centrul controversei, au condus acuzația. Puternica Creative Artists Agency (CAA) a emis o declarație publică clară pe 8 octombrie, etichetând aplicația drept o amenințare directă: „Este clar că Open AI/Sora expune clienții noștri și proprietatea lor intelectuală la riscuri semnificative.”

Acest sentiment a fost răspândit în industrie, studiourile importante precum Disney refuzând să permită apariția materialului lor în asociere. in, plasând sarcina legală pentru utilizare abuzivă direct pe firma AI. CEO Charles Rivkin a declarat că „… rămâne responsabilitatea lor – nu a deținătorilor de drepturi – să prevină încălcarea serviciului Sora 2″, arătând clar că deținătorii de drepturi nu vor fi responsabili pentru supravegherea serviciului OpenAI.

Această revoltă la nivel de industrie a reprezentat o escaladare semnificativă, transformând dezbaterea într-o confruntare corporativă cu mize mari pentru a recâștiga o confruntare corporativă.

Control

Confruntându-se cu o criză de PR în general, OpenAI s-a străduit să limiteze consecințele printr-o serie de inversări rapide ale politicii. Abordarea inițială de excludere a companiei s-a dovedit insuportabilă împotriva reacției coordonate.

Pe 3 octombrie, la doar câteva zile după lansare, Sam Altman a anunțat o schimbare de la sistemul de renunțare.

Într-o postare pe blog, el a promis un cadru mai prietenos pentru creatori, afirmând că OpenAI „va oferi deținătorilor de drepturi mai mult control granular, cu modele de caractere similare, dar suplimentare pentru generarea de caractere. controale”. Aceasta a fost prima admitere majoră că politica sa inițială a eșuat.

Modificările au continuat pe parcursul lunii. Până la 9 octombrie, compania și-a modificat regulile pentru a permite reprezentanților personalităților publice „decedate recent” să solicite în mod oficial blocarea asemănării lor.

Această politică a fost pusă la încercare la puțin peste o săptămână mai târziu. Pe 17 octombrie, OpenAI a anunțat că a întrerupt toate generațiile lui Martin Luther King Jr. la cererea directă a proprietății sale, invocând crearea de „reprezentări lipsite de respect”.

Într-o declarație care explică mișcarea, compania a recunoscut echilibrul delicat pe care încearcă să-l atingă: „În timp ce există puternice persoane cu libertatea de exprimare și în familiile lor, ar trebui să creadă în familiile lor istorice libere de exprimare puternice. în cele din urmă au control asupra modului în care asemănarea lor este folosit.”

Navigarea într-un câmp minat legal și etic

Furtuna Sora 2 evidențiază o vastă zonă gri juridică și etică. Legile tradiționale în materie de defăimare nu se aplică în mod obișnuit persoanelor decedate, lăsând familiile cu un recurs legal limitat.

Caile lor principală este un mozaic complex și inconsecvent de legi de stat care reglementează dreptul de publicitate postmortem. Acest vid legal permite crearea de conținut care, deși nu este întotdeauna exploatat comercial, provoacă o suferință emoțională semnificativă.

În plus, controversa a dus dezbaterea nerezolvată cu privire la dependența AI de cantități mari de date web răzuite pentru instruire – înapoi în centrul atenției.

Criticii susțin că firmele de drepturi de autor au găsit încă o problemă puternică pentru modelele de drepturi de autor, că industria a creat o problemă puternică. pentru a rezolva.

OpenAI a subliniat sprijinul său pentru Actul NO FAKES ca parte a soluției. Cu toate acestea, acel proiect de lege federal are propriii critici. Avocații drepturilor digitale avocații au avertizat că limbajul larg al proiectului de lege ar putea crea un nou drept de proprietate intelectuală care înăbușă serii de concesii, concesii și libertăți de exprimare.

culminând cu noul parteneriat cu Cranston și SAG-AFTRA, semnalează o mișcare către un viitor mai colaborativ, bazat pe permisiuni.

Totuși, evidențiază, de asemenea, imensa provocare de a echilibra inovația tehnologică rapidă cu drepturile fundamentale ale creatorilor și ale persoanelor.