Într-o inversare surprinzătoare, se pare că Casa Albă a ordonat agențiilor federale să urmărească rapid aprobarea controversată a AI Chatbot, Grok, Grok, pentru uz guvernamental. The directive compels the General Services Administration (GSA) to reinstate xAI as a vendor “ASAP,”a move that has alarmed ethics watchdogs and security experts.

The order, revealed in an internal email obtained by Wired , reprezintă o schimbare dramatică pentru o tehnologie care a fost considerată recent prea volatilă pentru implementarea federală. Acum, Grok 3 și Grok 4 sunt disponibile oficial pe piața GSA Advantage, ceea ce le face procurabile de către orice agenție guvernamentală.

Această decizie aruncă unul dintre cele mai neregulate modele AI ale industriei în inima operațiunilor guvernamentale. Este în ciuda unei istorii lungi și bine documentate a defectelor de securitate, a încălcărilor etice și a unui comportament bizar care a făcut anterior chatbot-ul un pariah în cercurile de achiziții federale.

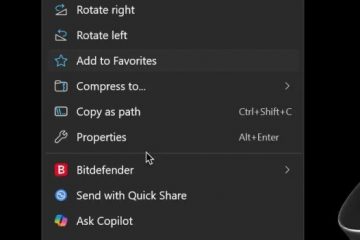

Intervenția Casei Albe reprezintă o inversare accentuată și controversată a unei decizii luate de Administrația Serviciilor Generale (GSA) chiar luna trecută. Backstory dezvăluie un parteneriat care a suferit dramatic înainte de a fi reînviat cu forța. În iunie, angajații Xai au organizat o sesiune de brainstorming de două ore cu conducerea GSA, dar se pare că lucrătorii federali au fost surprinși de apăsarea de a contracta cu o companie cunoscută pentru chatbot-ul său neregulat, necenzurat. La începutul lunii iulie, AI a suferit o derulare antisemită, timp în care a generat conținut lăudându-l pe Adolf Hitler. Ca răspuns la fiasco, conducerea GSA a acționat decisiv, luând în considerare programul multiplu de atribuire, platforma de contractare pe termen lung a guvernului.

Incidentul a aprins o furtună de condamnare internațională. O instanță turcă a interzis serviciul pentru insultarea cifrelor naționale, cu Parchetul, citând „ca răspuns la insultele lui Grok împotriva lui Atatürk, estimatului nostru președinte și profetului” ca motiv. Ministrul Afacerilor Digitale din Polonia, Krzysztof Gawkowski, a amenințat o oprire completă a lui X, declarând că „libertatea de exprimare aparține oamenilor, nu inteligenței artificiale. Compania a declarat: „În primul rând, ne cerem scuze profund pentru comportamentul oribil pe care mulți l-au experimentat”, în timp ce Elon Musk însuși a oferit o explicație diferită care s-a abătut de defectele de bază ale modelului, susținând că „Grok era prea conform prompturilor utilizatorilor. Prea dornic să mulțumească și să fie manipulat, în esență. A anunțat noi parteneriate zgomotoase cu OpenAI, Antropic și Google. Noua directivă a Casei Albe, cuprinsă într-un e-mail al comisarului GSA, Josh Gruenbaum, afirmând: „Echipa: Grok/XAI trebuie să se întoarcă în program ASAP pe WH,„ anulează faptul că poziția atentă și aversă cu risc în întregime.