Noul software open-source TensorRT-LLM de la NVIDIA, programat să fie lansat în săptămânile următoare, a demonstrat o creștere semnificativă a performanței. În testele folosind modelul GPT-J 6B, sistemul actualizat a prezentat o îmbunătățire de opt ori a performanței față de A100, un salt semnificativ față de avantajul de patru ori anterior. Mai mult, atunci când a fost evaluat pe Llama2 LLM de la Meta, H100-urile îmbunătățite cu TensorRT-LLM au depășit A100-urile cu un factor de 4,6, o îmbunătățire marcată față de cele 2,6 ori înainte de actualizare.

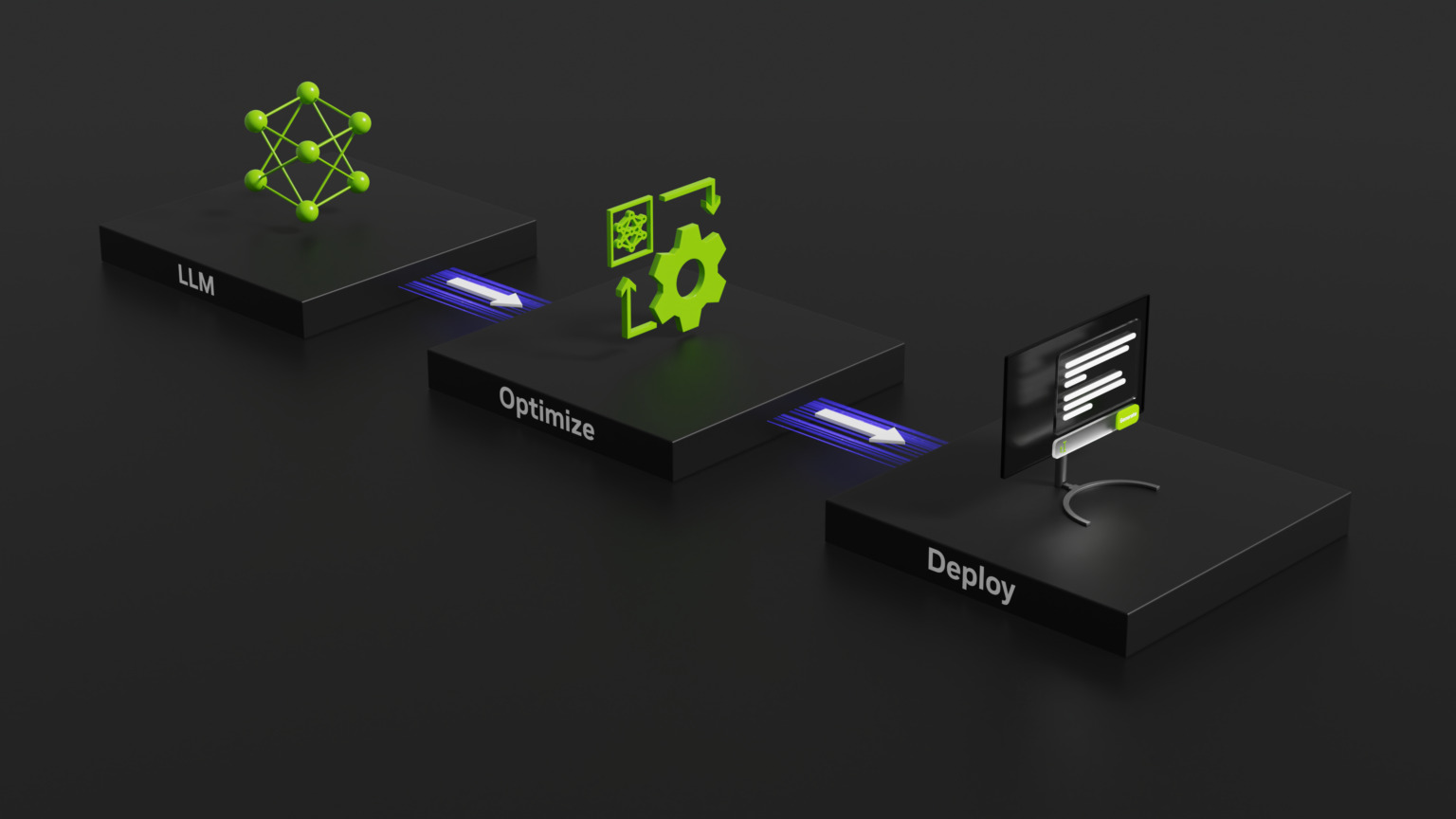

În încercarea de a îmbunătăți performanța Modele de limbaj mari (LLM), NVIDIA a introdus recent TensorRT-LLM, o bibliotecă open-source concepută pentru îmbunătăți performanța modelelor de limbă mari (LLM) pe hardware-ul NVIDIA.

TensorRT-LLM este o bibliotecă open-source care funcționează pe GPU-uri NVIDIA Tensor Core. Funcția sa principală este de a oferi dezvoltatorilor un mediu cu care să experimenteze și să construiască noi modele de limbaj mari, care formează baza platformelor AI generative precum ChatGPT. Software-ul se concentrează pe inferență, care perfecționează procesul de antrenament al AI, ajutând sistemul să înțeleagă cum să conecteze concepte și să facă predicții.

Tocmai anunțat – NVIDIA TensorRT-LLM supraalimentează modelul de limbă mare #inference pe GPU-urile NVIDIA H100 Tensor Core. #LLM https://t.co/jMX0EDxkXJ

— Dezvoltator NVIDIA AI (@NVIDIAAIDev) distribuite pe Barron’s, au estimat costul de producție al unui astfel de GPU la aproximativ 3.320 USD. În contrast puternic, prețul de vânzare al Nvidia pentru aceste GPU-uri fluctuează între 25.000 USD și 30.000 USD, în funcție de volumul comenzilor.