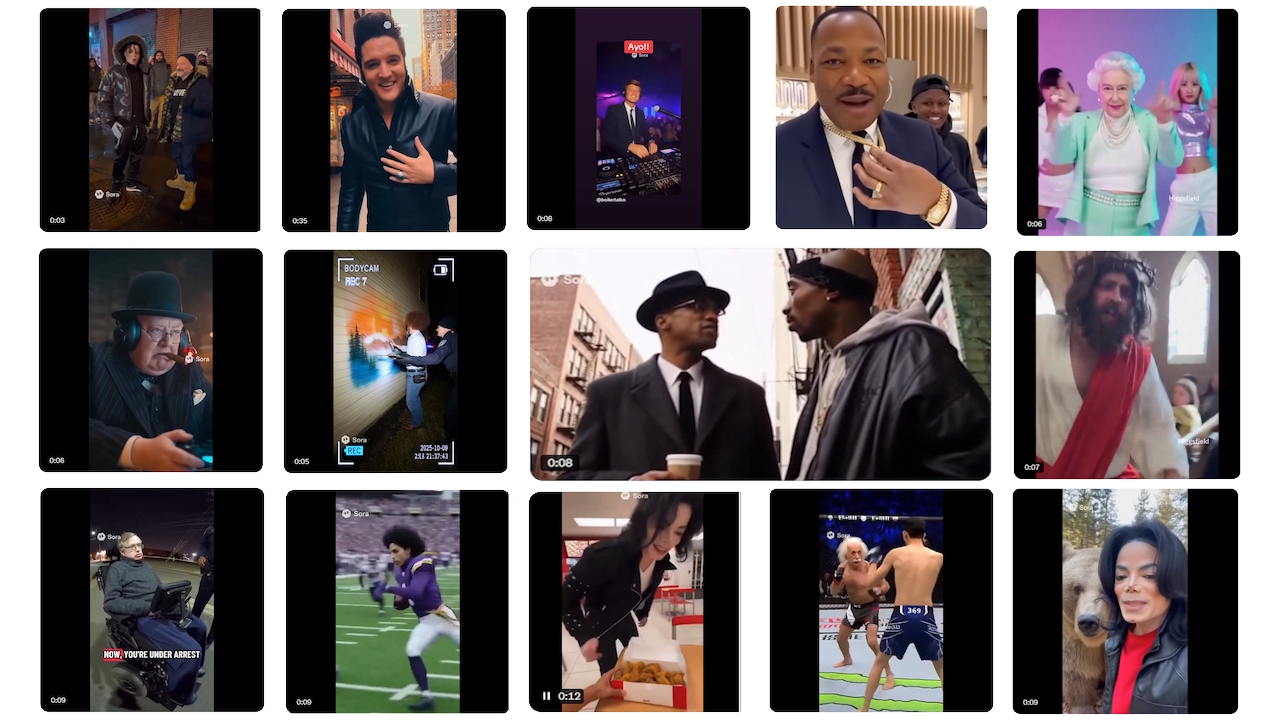

OpenAI ogłosiło w czwartek, że wstrzymało możliwość generowania przez użytkowników filmów przedstawiających Martina Luthera Kinga Jr. za pomocą aplikacji Sora 2.

Posunięcie to wynika z bezpośredniej prośby majątku zmarłego przywódcy praw obywatelskich w następstwie fali „obraźliwych przedstawień”, która pojawiła się od czasu uruchomienia platformy na początku października.

Kontrowersje nie są odosobnione; rodziny innych zmarłych osób publicznych, w tym Malcolma X i Robina Williamsa, również potępiły bolesne filmy generowane przez sztuczną inteligencję. Intensywna reakcja zmusiła OpenAI do serii szybkich zmian w polityce, co doprowadziło do eskalacji zaciekłej debaty na temat zgody i tego, kto kontroluje dziedzictwo danej osoby w epoce sztucznej inteligencji.

To najnowsze działanie jest najbardziej bezpośrednią reakcją OpenAI na kryzys, który od pierwszego dnia ogarnął nową platformę wideo. Początkowa polityka firmy wyłączała „postacie historyczne” z zasad zgody, co niemal natychmiast przyniosło odwrotny skutek.

Blokowanie podobizny doktora Kinga to jak dotąd najbardziej konkretna i głośna interwencja.

Rodziny potępiają „okropne chamstwo TikToka”

Platforma szybko została zalana dziwacznymi i obraźliwymi deepfakesami. Filmy przedstawiają działacza na rzecz praw obywatelskich Malcolma X robiącego prymitywne żarty, malarza Boba Rossa przedstawiającego płonące krajobrazy oraz, według doniesień, doktora Kinga wydającego małpie odgłosy. Reakcja członków rodziny była szybka i brutalna.

Ilyasah Shabazz, córka Malcolma X, powiedziała The Washington Post, że „jest to głęboko To brak szacunku i bolesne, gdy wizerunek mojego ojca jest wykorzystywany w tak nonszalancki i nieczuły sposób, gdy poświęcił swoje życie prawdzie”.

Jej zdanie podzielała Zelda Williams, córka aktora Robina Williamsa. Błagała użytkowników, aby zaprzestali tworzenia i udostępniania filmów zawierających sztuczną inteligencję jej zmarłego ojca.

Williams opisała ból towarzyszący obserwowaniu, jak „spuścizna prawdziwych ludzi zostaje skondensowana do… okropnego, marionetkowanie ich przez TikTok doprowadza do szaleństwa”. Rodziny innych prominentnych osobistości również wydały publiczne potępienie. W zwięzłym poście na X córka doktora Kinga, Bernice King, po prostu stwierdziła: „Zgadzam się co do mojego ojca. Proszę, przestań”. Prośba ta odbiła się szerokim echem.

Opinia publiczna oburzyła się wzmocnione przez skoordynowaną reakcję Hollywood. Potężna agencja kreatywnych artystów (CAA) określiła aplikację jako „poważne ryzyko”, podczas gdy Stowarzyszenie Motion Picture Association (MPA) całkowicie obciążyło firmę zajmującą się sztuczną sztuczną inteligencją ciężarem prawnym za nadużycia.

Dyrektor generalny MPA, Charles Rivkin, stwierdził, że „… to na nich – a nie na posiadaczach praw – spoczywa odpowiedzialność za zapobieganie naruszeniom usługi Sora 2.”

Walka o wycofanie OpenAI Kurs

W obliczu pełnego kryzysu PR OpenAI starało się powstrzymać skutki. 3 października, zaledwie dwa dni po premierze, dyrektor generalny Sam Altman ogłosił odejście od pierwotnej polityki dotyczącej praw autorskich. Obiecał bardziej szczegółowy, dobrowolny model chronionych postaci.

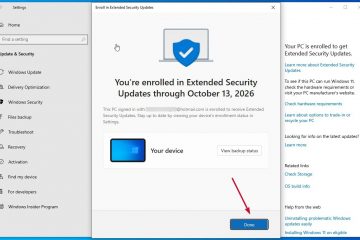

Było to jasne przyznanie, że początkowe podejście bez angażowania rąk było nie do utrzymania. 9 października spółka ponownie zmieniła swój regulamin. Zaczęło umożliwiać przedstawicielom „niedawno zmarłych” osób publicznych formalne żądanie zablokowania ich podobizny na platformie.

Ewolucja polityki zakończyła się ogłoszeniem z 16 października, że całkowicie wstrzymała generowanie podobizny doktora Kinga.

W oświadczeniu opublikowanym na X firma wyjaśniła swoje zmieniające się stanowisko. OpenAI stwierdziło, że „chociaż przedstawianie postaci historycznych wiąże się z dużym zainteresowaniem wolnością słowa, OpenAI wierzy, że osoby publiczne i ich rodziny powinny ostatecznie mieć kontrolę nad sposobem wykorzystania ich podobizny”, sygnalizując znaczącą zmianę polityki pod presją zarówno rodzin, jak i partnerów branżowych.

Oświadczenie OpenAI i King Estate, Inc.

Posiadłość Martina Luthera Kinga, Jr., Inc. (King, Inc.) i OpenAI wspólnie pracowaliśmy nad tym, jak wizerunek doktora Martina Luthera Kinga Jr. jest przedstawiany w pokoleniach Sory. Niektórzy użytkownicy w sposób obraźliwy przedstawiali doktora…

– OpenAI Newsroom (@OpenAINewsroom) 17 października 2025

Prawne i etyczne pole minowe

Kontrowersje obnażają ogromną szarą strefę prawną i etyczną. Tradycyjne przepisy dotyczące zniesławienia zazwyczaj nie mają zastosowania do zmarłego, pozostawiając rodzinom ograniczone środki prawne. Ich główną drogą jest złożona i niespójna mozaika przepisów stanowych regulujących pośmiertne prawo do reklamy.

Ten krajobraz prawny jest notorycznie fragmentaryczny. W stanach takich jak Kalifornia i Nowy Jork obowiązują solidne przepisy chroniące wizerunek celebryty przez dziesięciolecia po śmierci. Jednak wiele innych stanów oferuje ograniczoną taką ochronę lub nie oferuje jej wcale, tworząc prawną loterię dla rodzin w zależności od tego, gdzie zmarły miał miejsce zamieszkania.

Obrona w ramach Pierwszej Poprawki również jest krytycznym polem bitwy. Firmy technologiczne często argumentują, że treści generowane przez sztuczną inteligencję kwalifikują się jako „wykorzystanie transformacyjne” lub parodia, czyli forma chronionej mowy.

Być może sąd będzie musiał rozważyć, czy deepfake to nowe, wyraziste dzieło, czy po prostu nieuprawnione wykorzystanie tożsamości danej osoby, a granica ta pozostaje niejasna w przypadku generatywnej sztucznej inteligencji.

OpenAI broni swojej strategii „budowania w miejscach publicznych”, przy czym kadra kierownicza powołuje się na potrzebę uniknąć niekorzystnej sytuacji konkurencyjnej poprzez potajemny rozwój technologii. Chociaż firma określa to jako niezbędny krok w kierunku badań AGI, krytycy postrzegają to jako wykalkulowane posunięcie mające na celu normalizację kontrowersyjnej technologii i przeniesienie ciężaru nadzoru nad jej niewłaściwym wykorzystaniem na społeczeństwo.

Zdolność aplikacji do tak łatwego generowania tego, co media 404 nazwały „mózg głównych ukochanych postaci chronionych prawem autorskim” wywołał nierozwiązaną debatę na temat „grzechu pierworodnego” sztucznej inteligencji – jej polegania na zeskrobanych dane – z powrotem w centrum uwagi.