Zespół

Alibaba QWen we wtorek wypuścił QWEN3-Coder, potężną nową serię modeli kodowania AI open source skierowanych bezpośrednio do rywali takich jak Anthropic. Modele, zatytułowane masywną wersję 480 miliardów parametrów, są zaprojektowane do „agencyjnej” pracy, umożliwiając im autonomicznie obsługę złożonych zadań rozwoju oprogramowania.

Globalna wersja 22 lipca 2025 r. Na jak github Ustaw nowy standard dla modeli otwartych. Jednak premiera pojawia się również wśród głębokiego sceptycyzmu w branży w stosunku do testów porównawczych AI, napędzany najnowszymi zarzutami, że inny z własnych modeli Alibaba oszukuje kluczowe testy wydajności.

Pod maską: Agentic Agentic Powerhouse

href=”https://huggingface.co/qwen/qwen3-coder-480b-a35b-instruct”target=”_ blank”> qwen3-coder-480b-a35b-instruct , masywny model mieszanki z-experts (MOE). Zawiera 480 miliardów parametrów ogółem, ale aktywuje tylko 35-miliardowy parametr dla dowolnego zadania. Ta architektura zapewnia ogromną moc przy jednoczesnym zachowaniu wydajności obliczeniowej.

Jego specyfikacje techniczne są ogromne. Model oferuje natywną długość kontekstu 256 000-tokatowego, którą można rozszerzyć do miliona tokenów przy użyciu metod ekstrapolacji, takich jak przędza. Ta ogromna pojemność jest dostosowana do zrozumienia w skali repozytorium, umożliwiając AI uchwycenie pełnego kontekstu dużych projektów oprogramowania.

Ta kontekstowa świadomość jest połączona z niesamowitą szerokością. Model obsługuje szeroką gamę języków programowania, od głównego nurtu, takich jak C ++, Python i Java, po wyspecjalizowane języki, takie jak Abap, Rust i Swift, jak szczegółowo opisano na temat github . Pozwala to obsługiwać różnorodne środowiska programistyczne i wyspecjalizowane zadania, takie jak wstawienie kodu „wypełniania-in-the-middle”.

Poza przed treningiem, alibaba skupiona na zaawansowanych technikach po treningu. Zespół rozwinął to, co nazywa uczeniem się wzmocnienia kodu (kod RL) w szerokim zakresie zadań kodowania w świecie rzeczywistym. Takie podejście opiera się na zasadzie rozwiązywania problemów, które są „trudne do rozwiązania, ale łatwe do zweryfikowania”, wykorzystując informacje zwrotne oparte na wykonaniu w celu znacznego zwiększenia wskaźników sukcesu.

Aby kultywować prawdziwe zachowanie agencyjne, zespół wdrożył tak, jak nazywa „RL długoterminowy”. Wymagało to zbudowania skalowalnego systemu na chmurze Alibaba zdolnej do równolegle uruchamiania 20 000 niezależnych środowisk. Ta infrastruktura stanowi kluczową pętlę sprzężenia zwrotnego do nauczania modelu planowania, korzystania z narzędzi i podejmowania decyzji w złożonych, wielu odwrotnych interakcjach.

Zgodnie z danymi o wydajności opublikowanej przez zespół QWEN, nowy model kodera QWEN3 ustanawia się jako najwyższy poziom modelowy model kodowania, osiągając najwyższe wyniki wśród jego wyników z otwartego samopoczucia. W sprawie weryfikowanego przez SWE, kluczowy test funkcji inżynierii oprogramowania rzeczywistego, model QWEN3-koder wynosi imponujący 69,6% z 500 zakrętami interakcji.

To stawia go w bezpośrednim konkurencji z wiodącym modelem właścicielskim, Claude-Sonnet-4, który osiągnął 70,4% w podobnych warunkach. Ponadto, koder QWEN3 znacznie przewyższa inne główne modele w terenie, w tym Kimi-K2 (65,4%), GPT-4,1 (54,6%) i Gemini-2,5-Pro (49,0%), umacniając swoją pozycję jako potężny nowy konkurencja w wyścigu o agencyjną AI Supremacy. Supremacy

To wydanie sygnalizuje agresywne pchnięcie Alibaba na następną granicę AI: Acenciarna inteligencja. Przemysł szybko wykracza poza prostych asystentów kodu do autonomicznych agentów, którzy mogą planować, wykonywać i dostosowywać się do złożonych, wieloetapowych zadań rozwojowych. Koder QWEN3 to nie tylko nowy model; Jest to strategiczne wejście do tego eskalacji „wyścigu zbrojeń”.

Trend jest już zatwierdzony w przedsiębiorstwie. Na przykład Bank Investment Bank Goldman Sachs zaczął niedawno pilotować agenta AI Devin do zbudowania „hybrydowej siły roboczej”. Jego szef technologii, Marco Argenti, opisał przyszłość, w której „tak naprawdę chodzi o ludzi i AI, które pracują obok siebie. Inżynierowie będą oczekiwać, że będą mogli naprawdę opisywać problemy w spójny sposób…„ Przesuwanie ludzkiego skupienia się od żmudnego kodowania do rozwiązywania problemów na wysokim poziomie.

QWEN3-koder wpada w tłum i fiercyście. W Stanach Zjednoczonych Amazon niedawno zaprezentował swojego agenta Kiro, aby narzucić strukturę na chaotyczne „kodowanie atmosfery”, podczas gdy Google realizuje dwukrotny atak ze swoim kompleksowym studiem Firebase i bezpłatnym CLI Gemini. Openai nadal zaktualizuje swojego agenta Codex, niedawno dając mu dostęp do Internetu do autonomicznego znajdowania i wykorzystania danych.

Konkurs jest równie intensywny w Chinach „War of Sto-Sto-Setka modeli”. Koder QWEN3 jest ustawiony w stosunku do Powerhouse’ów open source, takich jak AI Moonshot, który niedawno wydał swój 1-bilionowy model KIMI K2. Ta krajowa rywalizacja jest napędzana presją geopolityczną, która zmusza chińskie firmy do budowania samowystarczalnych ekosystemów.

Wysokie stawki tego wyścigu są widoczne w bezwzględnej konkurencji o talenty i technologię. Windsurf w kodowaniu Windsurf niedawno widział, jak Google zakłada swojego dyrektora generalnego i najlepszego talentu, zawierającego przejęcie Landage Openai i umożliwiając rywalizującym poznaniu nabycie pozostałej firmy.

Bitwa rozciąga się na publiczne postrzeganie, często walczące z tablicami liderów. W jasnym przykładzie tej „wojny porównawczej” XAI Elona Muska niedawno zatrudnił wykonawców specjalnie do wyszkolenia swojego modelu Grok 4 w celu pokonania Anthropica Claude’a. Niezwykłe koszty operacyjne są również czynnikiem, jak widać, gdy antropiczne zaostrzone limity użytkowania dla subskrybentów premium, podkreślające finansowe obciążenie świadczenia tych potężnych usług.

Uruchomienie zachmurzone przez wzroście sceptycyzmu

pomimo imponującego technicznego roszczenia QWEN3-Code’u jest zachowany przez rosnącego powiernika w AI. Czas jest niezręczny dla Alibaba. Zaledwie kilka dni wcześniej, 18 lipca, Badanie z Fudan University zarzuciło, że model QWEN2.5 miał „oszukiwał” w punkcie Math-500 Benchmark . rozumowanie. Ta kontrowersja podkreśla systemowy problem zanieczyszczenia danych, w którym pytania testowe wyciekają na zestawy szkoleniowe, zawyżając wydajność i tworząc fałszywe wrażenie prawdziwych możliwości modelu.

Społeczność AI pozostaje głęboko podzielona na praktykę „nauczania testu”. Niektóre, jak dyrektor generalny LMARENA, Anastasios Angelopoulos, postrzegają to jako normalną część rozwoju, stwierdzając: „Jest to część standardowego przepływu pracy modelu. Musisz zbierać dane, aby ulepszyć swój model.”

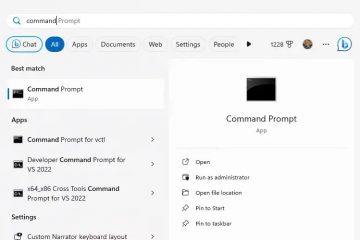

Inni ostrzegają przed niebezpiecznym rozłączeniem między wynikami testowymi a użytecznością prawdziwego świata. Jak zauważył strateg AI, Nate Jones: „W momencie, gdy ustaliliśmy dominację tablicy liderów jako cel, ryzykujemy tworzenie modeli, które przodują w trywialnych ćwiczeniach i flądrze, gdy stają w obliczu rzeczywistości”. Ten sentyment jest powtórzony przez ekspertów takich jak Sara Hooker, szef Cohere Labs, który argumentował, że „gdy tablica liderowa jest ważna dla całego ekosystemu, zachęty są zgodne z tym, że jest to zawstydzone,„ stwarzając ryzyko modeli, które są dobre na egzaminach, ale słabe w praktycznych zadaniach. Przyjęcie, Alibaba uwalnia pakiet narzędzi obok modeli. Firma uruchomiła „QWen Code”, interfejs wiersza poleceń rozwidlony z Google Gemini CLI i dostosowany do nowych modeli. Zapewnia to programistom gotowe środowisko do kodowania agencyjnego.

W doświadczonym ruchu w celu poszerzenia jego atrakcyjności zespół QWEN zapewnił również kompatybilność z istniejącymi, popularnymi narzędziami programistów. W szczególności QWEN3-CODER może być używane z kodem Claude Claude CLI, pozwalając deweloperom na zmianę zaplecza bez zakłócenia ich przepływów pracy . Zdobycie lojalności programistów. Udostępniając swoje potężne modele za pomocą wielu platform, w tym jego własne studio API Alibaba stawia to narzędzia i łatwość użytkowania będą przyczynić się do przyjęcia na rynku ostrożnym wobec Vendor of Vendor. QWEN3-235B-A22B-Instruct-2507, który