Anthropic, laboratorium sztucznej inteligencji znane z chatbota Claude, zgodziło się egzekwować i utrzymywać zabezpieczenia uniemożliwiające swoim modelom generowanie tekstów piosenek chronionych prawem autorskim.

Ta decyzja jest częścią ugoda prawna z czołowymi wydawcami muzycznymi, w tym z Universal Music Group i Concord Music Group, którzy oskarżyli firmę o naruszenie praw autorskich za używanie tekstów piosenek bez zezwolenia w zbiorach danych szkoleniowych AI.

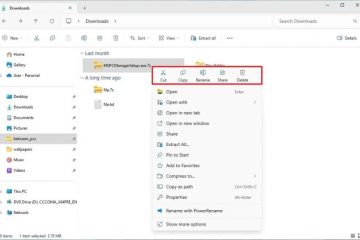

Zatwierdzone przez USA Sędzia okręgowy Eumi Lee, porozumienie rozwiązuje część wstępnego nakazu, którego domagają się wydawcy. Zmusza Anthropic do utrzymania istniejących „poręczy ochronnych” dla Claude i podobnych modeli, aby zapobiec powielaniu materiałów chronionych prawem autorskim.

Sprawa ta wyznacza kluczowy moment w rosnącym napięciu między innowacjami w zakresie sztucznej inteligencji a prawami własności intelektualnej.

The Zarzuty: bezlicencjonowane wykorzystanie tekstów piosenek

W pozwie wszczętym w październiku 2023 r. zarzuca się, że firma Anthropic przeszkoliła swoje systemy sztucznej inteligencji, korzystając z tekstów z ponad 500 piosenek, bez zabezpieczenia licencji. Wydawcy podali przykłady takie jak Katy Perry’s Roar oraz utwory The Rolling Stones i Beyoncé, oskarżając narzędzie AI o generowanie niemal dosłownych reprodukcji tych tekstów.

W jednym z przykładów podanych w zgłoszeniu opisano, że Claude stworzył „prawie identyczną kopię” Ryku Perry’ego. Wydawcy argumentowali, że to nieuprawnione użycie nie tylko narusza prawo autorskie, ale także podważa ich relacje z autorami piosenek i innymi zainteresowanymi stronami.

„Nielicencjonowane wykorzystywanie przez firmę Anthropic materiałów chronionych prawem autorskim nieodwracalnie szkodzi relacjom wydawców z obecnymi i potencjalnymi partnerami-autorami piosenek, ” – stwierdzono w pozwie, podkreślając szerszy wpływ na zaufanie branży.

Poręcze ochronne: jak działają i ich rola w Zgodność

Poręcze to środki techniczne zaprojektowane w celu ograniczenia wyników sztucznej inteligencji, zapewniające, że modele takie jak Claude nie reprodukują materiałów chronionych prawem autorskim lub szkodliwych. Te zabezpieczenia mogą obejmować filtry blokujące określone wyniki oraz algorytmy przeznaczone do wykrywania i zapobiegania dosłowne odwzorowanie danych szkoleniowych i mechanizmy nadzoru nad interakcją użytkownika z modelem.

Anthropic twierdzi, że obecne bariery ochronne są solidne i zdolne do zapobiegania takim wynikom. Rzecznik firmy stwierdził: „We posiadają liczne procesy mające na celu zapobieganie takim naruszeniom. Nasza decyzja o przystąpieniu do tego postanowienia jest zgodna z tymi priorytetami.”

Zgodnie z umową wydawcy muzyczni mogą powiadamiać Anthropic, jeśli te środki zawiodą. Firma jest zobowiązana do niezwłocznego zbadania i usunięcia wszelkich niedociągnięć. Anthropic zachowuje prawo do optymalizacji swoich metod, nie może zmniejszać skuteczności swoich zabezpieczeń.

Dozwolony użytek i precedensy prawne

Anthropic bronił wykorzystuje materiały chronione prawem autorskim zgodnie z doktryną „dozwolonego użytku”, argumentując, że szkolenie generatywnych modeli sztucznej inteligencji obejmuje transformacyjne wykorzystanie danych. W dokumentach prawnych firmy stwierdzono: „Nadal nie możemy się doczekać, aby wykazać, że zgodnie z obowiązującym prawem autorskim wykorzystywanie materiałów potencjalnie chronionych prawem autorskim do szkolenia modeli generatywnej sztucznej inteligencji jest kwintesencją dozwolonego użytku”.

Jednakże wydawcy twierdzą, że praktyka ta dewaluuje ich twórczość i narusza istniejące rynki licencji. Twierdzą, że firmy zajmujące się sztuczną inteligencją omijają ustalone kanały licencjonowania, co przynosi artystom i wydawcom szkody gospodarcze i reputacyjne.

Ten pozew jest pierwszym, który skupia się na tekstach w zbiorach danych szkoleniowych AI, ale wpisuje się w szersze spory dotyczące OpenAI w związku z podobnymi oskarżeniami w związku z wykorzystywaniem artykułów prasowych, podczas gdy New York Times i inne media wyraziły obawy dotyczące sztucznej inteligencji.-generowane treści replikujące ich pracę.

Implikacje dla branży i perspektywy na przyszłość

Pozew Anthropic podkreśla wyzwania związane z zrównoważeniem postępu technologicznego z własnością intelektualną zabezpieczenia. Ponieważ generatywna sztuczna inteligencja staje się coraz bardziej integralną częścią branż, od rozrywki po dziennikarstwo, firmy znajdują się pod presją, aby poradzić sobie z tymi zawiłościami prawnymi i etycznymi.

Proaktywne umowy licencyjne mogą stanowić drogę naprzód. OpenAI nawiązał już współpracę z wydawcami takimi jak TIME i Associated Press, a Microsoft zawarł umowy z HarperCollins na wykorzystanie jej tytułów non-fiction do szkolenia w zakresie sztucznej inteligencji.

Umowa Anthropic z wydawcami muzyki może służyć jako szablon dla przyszłych rozwiązań, wykazanie znaczenia przejrzystych i możliwych do wyegzekwowania mechanizmów zgodności. Ponieważ jednak sędzia Lee nie wydał jeszcze orzeczenia w szerszej kwestii, czy nielicencjonowane szkolenie w zakresie sztucznej inteligencji stanowi dozwolony użytek, wynik sprawy może stanowić precedens.