Zoom zmienił politykę, która pozwalałaby firmie wykorzystywać dane klientów do trenowania modeli sztucznej inteligencji (AI). Polityka, która została ogłoszona w marcu, spotkała się z sprzeciwem obrońców prywatności i użytkowników, którzy obawiali się, w jaki sposób zostaną wykorzystane ich dane.

Zoom chce, aby jego rozmowy wideo były inteligentniejsze dzięki sztucznej inteligencji, ale nie chce również posiadać dane, które ją napędzają. Firma zaktualizowała swoje warunki korzystania z usługi w marcu, roszcząc sobie wszelkie prawa do danych generowanych przez użytkowników podczas ich połączeń. Dane te obejmują nie tylko audio i wideo, ale także tekst, obrazy i emocje. Zoom planuje wykorzystać te dane do szkolenia i ulepszania nowych funkcji AI, które nazywa „Zoom IQ“.

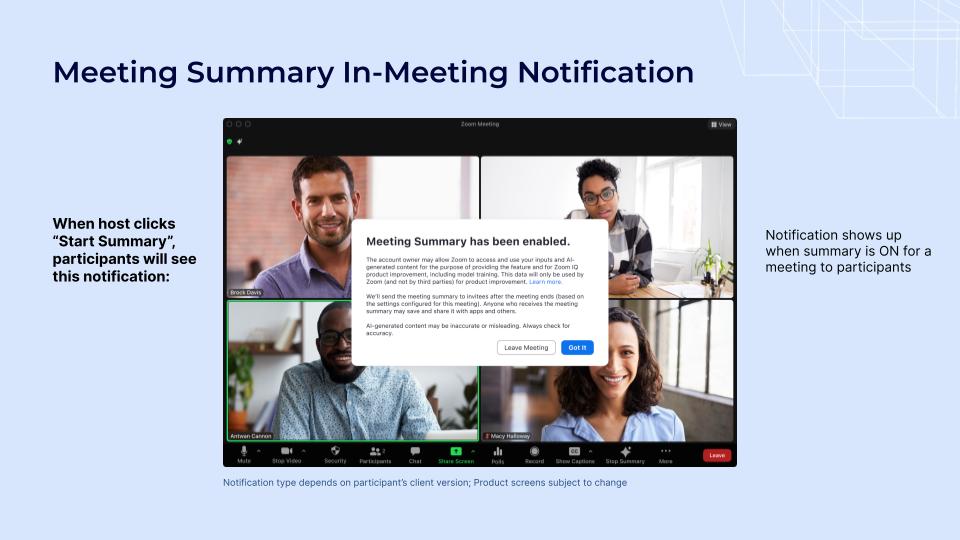

Zoom IQ to zestaw generatywnych funkcji sztucznej inteligencji, które Zoom wprowadzał przez cały rok. Te funkcje mają na celu poprawę komfortu użytkowania i produktywności rozmów wideo. Na przykład Zoom IQ może automatycznie generować połączenia streszczenia, transkrypcje i działania. Może też tworzyć realistyczne awatary, tła i filtry dla użytkowników.

Aby to osiągnąć, Zoom wykorzystuje własny model językowy, a także te opracowane przez OpenAI i Anthropic, dwa wiodące laboratoria badawcze AI. Zoom mówi, że używa „federacyjnego ” podejście do sztucznej inteligencji, co oznacza, że nie centralizuje danych od użytkowników, ale raczej rozdziela proces uczenia się na różne urządzenia i serwery.

Cofnięcie się i cofnięcie decyzji

W poniedziałkowym postie na blogu Zoom jasno wyjaśnia zmianę zasad następujące zobowiązanie: „W przypadku sztucznej inteligencji nie używamy treści audio, wideo ani czatów do szkolenia naszych modeli bez zgody klienta”.

Zgodnie z nową polityką Zoom będzie wykorzystywać dane klientów wyłącznie do szkolenia swoich modeli AI jeśli klienci wyrazili na to zgodę. Zgodę tę można wyrazić poprzez nowe ustawienie w aplikacji Zoom. Klienci, którzy nie wyrażą zgody, nie będą wykorzystywać ich danych do trenowania modeli AI. Zoom mówi, że nowa polityka wejdzie w życie 15 sierpnia. Firma twierdzi również, że usunie wszelkie dane klientów, które zostały już wykorzystane do szkolenia modeli AI bez zgody.

Odwrócenie polityki Zoom polega na tym, że zwycięstwo obrońców prywatności i użytkowników, którzy obawiali się, w jaki sposób zostaną wykorzystane ich dane. Jest to również znak, że firmy zaczynają poważniej traktować prywatność w następstwie niedawnych naruszeń danych i skandali związanych z prywatnością.

Generacyjne obawy dotyczące prywatności AI

To, w jaki sposób modele AI, takie jak chatboty i narzędzia do kodowania, obsługują dane użytkowników, jest gorącym tematem. Istnieją obawy co do sposobu uzyskiwania dostępu do danych i ich wykorzystywania, nawet wśród największych graczy w branży. Niezależnie od tego, czy chodzi o OpenAI i ChatGPT, Google Bard czy Bing Chat firmy Microsoft, istnieje wiele odpowiedzi na pytania dotyczące pozyskiwania danych AI.

W marcu 2023 r. OpenAI uruchomiło platformę wtyczek dla ChatGPT, która umożliwia programistom tworzenie wtyczek które rozszerzają funkcjonalność ChatGPT. Jednak ostatnio pojawiły się dowody na to, że wtyczki ChatGPT powodują zagrożenie dla prywatności. Jednym z głównych zagrożeń jest to, że wtyczki mogą zostać użyte do wstrzyknięcia złośliwego kodu do sesji ChatGPT. Może to umożliwić atakującym kradzież danych, instalowanie złośliwego oprogramowania, a nawet przejęcie kontroli nad komputerem użytkownika.

Google Bard zadebiutował w Europie w zeszłym miesiącu po miesiącach opóźnienia spowodowanego obawami o prywatność. Wprowadzenie Barda na rynek UE wymagało od Google przestrzegania zasad obowiązujących w bloku. Firma Google zajmowała się kwestiami regulacyjnymi i prawnymi ze strony Komisji Europejskiej i innych organów, które były zaniepokojone potencjalnym wpływem firmy Bard na ochronę danych, prywatność, konkurencję i prawa własności intelektualnej. Google musiało wykazać, że Bard przestrzega surowych zasad i standardów UE, takich jak Ogólne rozporządzenie o ochronie danych (RODO) i ustawa o usługach cyfrowych (DSA).