Et tverrbedriftsforskningsarbeid for å løse et forsøk på tvers av selskaper/>

overraskende visning av samarbeid på tvers av bransje, henvendte Apple seg til sin hovedrivals teknologi for å bygge sitt nyeste forskningsverktøy.

Opprettelsen av Pico-Banana-400K ble drevet av store flaskehalser, høy kvalitet og vedvarende utvikling av datasett og høy kvalitet åpent tilgjengelige datasett basert på ekte bilder. Mange eksisterende ressurser er enten helt syntetiske, begrenset i menneske-kuratert omfang, eller bygget med proprietære modeller, noe som hindrer brede fellesskapsfremgang.

Apples forskere uttaler at målet deres var å skape et”robust grunnlag for opplæring og benchmarking av neste generasjon tekststyrte bilderedigeringsmodeller.”

“Ifølge deres distinguB. fra tidligere syntetiske datasett er vår systematiske tilnærming til kvalitet og mangfold.”

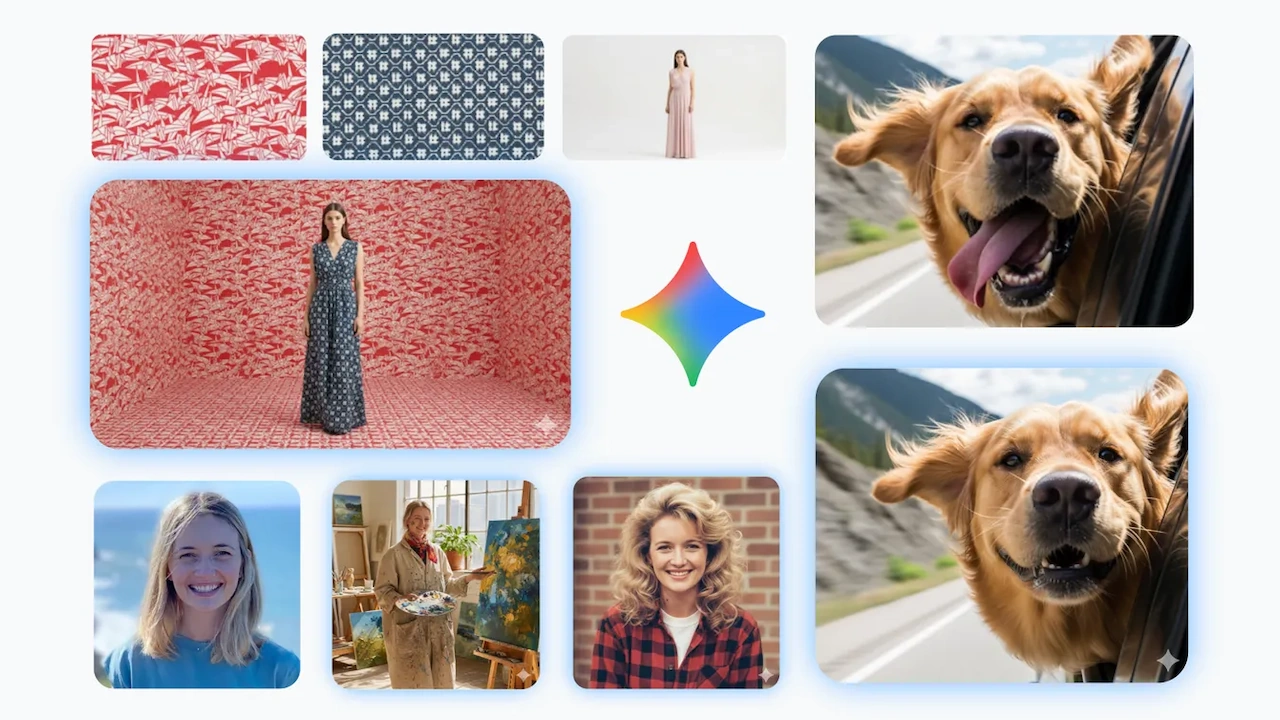

Teamet hentet originale fotografier fra OpenImages-samlingen og brukte Googles kraftige Nano-Banana-modell, nå offisielt kjent som Gemini 2.5 Flash Image, for å generere et stort utvalg av redigeringer.

En andre Google-modell, Gemini-Pro, tjente som en visuell kvalitet og 5-pro-bedømmer. Hele prosessen kostet omtrent $100 000.

Inne i datasettet: Mer enn bare enkeltredigeringer

Drilling ned i datasettets struktur avslører en ressurs designet for komplekse forskningsscenarier. Selv om den heter”400K”, består samlingen faktisk av 386 000 kuraterte eksempler organisert i en detaljert taksonomi med 35 redigeringstyper fordelt på åtte hovedkategorier.

Disse spenner fra enkle piksel-og fotometriske justeringer til komplekse semantiske endringer på objektnivå, redigeringer av scenekomposisjon og stilistiske transformasjoner. eksempler for standard overvåket finjustering. Et andre delsett gir 72 000 flersvingseksempler, noe som muliggjør forskning på sekvensiell redigering og kontekstbevisste modifikasjoner der en modell må spore endringer over flere trinn.

Til slutt inkluderer et preferanseundersett med 56 000 eksempler par med vellykkede og mislykkede redigeringer. Dette er avgjørende for tilpasningsforskning og for opplæring av belønningsmodeller som kan lære å skille høykvalitetsresultater fra feil. Forskere kan få tilgang til det komplette datasettet på Apples forskningsportal under en ikke-kommersiell Creative Commons-lisens.

Belysning av grensen og feilene ved AI-redigering

Ytelsesmålinger fra datasettet viser at globale og stilistiske redigeringer, som å bruke et vintage-filter eller endre en scenes generelle tone til «golden hour», er svært pålitelige. Imidlertid er redigeringer som krever presis romkontroll og geometrisk forståelse fortsatt en betydelig utfordring.

Oppgaver som å flytte et objekt i en scene hadde en suksessrate på under 60 %, og tekstgenerering i bilder var spesielt sprø.

Dette gir verdifull kontekst for det sterkt konkurranseutsatte AI-bildemarkedet. Googles underliggende Nano-Banana-modell ble den topprangerte bilderedigereren på offentlige ledertavler selv før den offisielle lanseringen.

Suksessen er en del av et bredere bransjekappløp, med ByteDance som lanserer sin Seedream 4.0-modell som en direkte utfordrer og Meta-lisensieringsteknologi fra Midjourney etter interne tilbakeslag.

C. Nicole Brichtova, en produktleder hos Google DeepMind, sa:”Vi legger evner som pleide å kreve spesialiserte verktøy i hendene på hverdagsskapere, og det har vært inspirerende å se eksplosjonen av kreativitet dette har utløst.”

Tidlige brukere har berømmet modellens konsistens. Andrew Carr, medgründer av AI-startup Cartwheel, fant det unikt kapabelt, og sa:”Den nye Gemini 2.5 Flash Image-modellen var den første som kunne gi begge deler.”

Apples utgivelse blir også diskutert som et godt eksempel på”modelldestillasjon.”Dette er en prosess der en stor, kraftig modell (Nano-Banana) brukes til å generere et massivt opplæringsdatasett.

Andre forskere kan deretter bruke disse offentlige dataene til å trene opp mindre, mer effektive og potensielt åpen kildekode-modeller som etterligner egenskapene til det originale proprietære systemet. Ved å gjøre disse høykvalitetsresultatene offentlige, hjelper Apple effektivt med å demokratisere tilgangen til toppmoderne AI, og fremmer et mer åpent og samarbeidende forskningslandskap.

“`