Google presser på for global handling mot kunstig generell intelligens (AGI), og understreker presset til å skape sikkerhetstiltak før disse systemene går videre over menneskets kontroll. I et blogginnlegg publisert i går av DeepMind, avslørte selskapet et nytt internasjonalt sikkerhetsrammeverk bygget rundt tre viktige søyler: å styrke teknisk forskning, implementere systemer for tidlig varsling og fremme internasjonalt samarbeid gjennom styringsorganer.

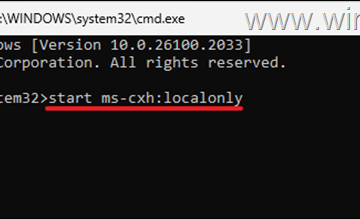

I stedet for å fokusere utelukkende på politiske rammer eller abstrakte etiske hensyn. Selskapet understreker at behovet for sikkerhetstiltak ikke er en fjern bekymring, men en umiddelbar utfordring.”[A] sentrale element i strategien vår er å identifisere og begrense tilgangen til farlige evner som kan misbrukes, inkludert de som muliggjør cyberangrep.”DeepMind uttalte i sin

I april 2023 slo Google DeepMind samlet hjerneslaget med DeepMind, og dannet en enhetlig forskningsenhet som har til oppgave å fremme AI-evner og sikre sikkerheten til disse fremskrittene. Fusjonen banet vei for utviklingen av Gemini-modellfamilien, som så betydelige oppgraderinger med den nylige utgivelsen av Gemini 2.5 Pro Experimental-den siste multimodale AI-modellen som var i stand til avansert resonnement. Denne fremgangen signaliserer DeepMinds voksende evner, så vel som fokus på å sikre at så kraftige systemer blir distribuert på en ansvarlig måte.

ekko fra rivaler-og noen få motsetninger

DeepMinds oppfordring om sikkerhetsregulering eksisterer ikke isolert. Den kommer når andre store AI-laboratorier begynner å ta lignende skritt. Antropic, en av DeepMinds mest betydningsfulle konkurrenter, ga en lignende advarsel i november 2024, og oppfordret regulatorer til å iverksette raske tiltak innen 18 måneder for å forhindre løpende AI-utvikling.

Selskapet introduserte nye interne politikker, inkludert”kapasitetsgrenser”som automatisk utløser sterkere sikkerhetskraft som AI-system. Antropic har også samarbeidet med U.S. Department of Energys nasjonale atomsikkerhetsadministrasjon, og kjørt rød-teaming øvelser for å teste sine Claude-modellene i høysikkerhetsinnstillinger. Dette initiativet understreker det økende fokuset på AI-sikkerhet, spesielt i sammenhenger der AI kan påvirke nasjonal sikkerhet.

Meta, som lenge har forkjempet åpen AI-utvikling, vurderer også sin tilnærming. I februar 2025 kunngjorde selskapet et skifte i sin AI-strategi med Frontier AI-rammeverket, som deler modeller i kategoriene”høyrisiko”og”kritisk risiko”. Meta forklarte at modeller av kritisk risiko ikke lenger ville bli utgitt offentlig uten strenge garantier på plass.

Denne avgjørelsen fulgte misbruk av lama-modellene i å generere ondsinnede skript og uautoriserte militære chatbots. Meta la vekt på at målet er å minimere katastrofale risikoer forbundet med disse modellene.

Mens disse trekkene gjenspeiler et skifte mot forsiktighet, demonstrerer de også det stadig mer komplekse forholdet mellom AI-utvikling og dens potensielle misbruk. Etter hvert som flere selskaper rekalibrerer strategiene sine, passer DeepMinds forslag inn i et større mønster av forsiktighet når industrien sliter med fremtiden til AGI.

å bygge verktøyene for modellinneslutning

mens mye av samtalen rundt AI-sikkerhetssentre om styring, fokuserer andre selskaper på tekniske løsninger. I februar lanserte Anthropic den konstitusjonelle klassifisereren, et eksternt filtreringssystem designet for å forhindre motstridende spørsmål og skadelige utganger fra AI-modellene. Tester viste at klassifisereren reduserte suksessraten for jailbreak fra 86% til bare 4,4%.

For å validere effektiviteten, kjørte Anthropic en offentlig utfordring som tilbyr en $ 15.000 dusør til alle som kunne omgå systemet. Ingen av deltakerne lyktes med å bryte det fullstendig, og understreker den voksende sofistikering av verktøy designet for å inneholde AI-systemer.

Videre fremskritt sin forpliktelse til sikkerhet, anthropic i mars lanserte sin tolkbarhetsramme, og kaller det et”AI-mikroskop”som et verktøy som gir innsikt i hvordan modeller som Claude tar beslutninger. Ved å analysere nevrale aktiveringer, kan det spore hvordan modellen behandler informasjon og oppdage potensielt skadelig atferd.

Denne tolkbarheten er essensiell, argumenterer DeepMind, da det kan forhindre uønskede utfall før de manifesterer seg.

sammen med disse verktøyene. Clio ble introdusert i desember 2024 og analyserer millioner av samtaler med Claude for å oppdage misbruk av misbruk. Systemet prioriterer personvern ved å anonymisere samtaler før du behandler dem. Denne proaktive tilnærmingen til å overvåke AI-atferd stemmer overens med DeepMinds vektlegging av behovet for kontinuerlig sikkerhetstilsyn når AI-systemer blir mer sofistikert.

EU-loven og nasjonal politikkinnsats tar tak

DeepMinds forslag kommer når regjeringene begynner å ta betalt til å regulere et til å gjøre et EUs AI-lov, som trådte i kraft 2. februar, forbyr visse AI-systemer som ble ansett for å utgjøre”uakseptable risikoer”og pålegger strenge åpenhetskrav til de som anses høyrisiko.

Disse forskriftene krever at selskaper avslører hvordan deres modeller er trent, hvilke data de bruker, og hvordan de miterer potensielle ris. Selskaper som Openai og Meta har offentlig forpliktet seg til å oppfylle disse kravene, selv om mange ennå ikke har overholdt fullt ut.

EU-lovens implementering følger månedene med debatt i bransjen om hvordan man best kan balansere innovasjon med sikkerhet. EU-kommisjonen har allerede indikert at manglende overholdelse kan føre til heftige bøter-opp til 6% av et selskaps globale inntekt for brudd.

I USA har Det hvite hus begynt å vurdere Anthropics nylige forslag, som oppfordrer strengere sikkerhetsprotokoller og tilsynsmekanismer for AGI-modeller. Som rapportert av TechCrunch, rullet Anthropic stille flere sikkerhetsforpliktelser det gjorde i de første dagene av Biden-administrasjonen, og reiste spørsmål om konsistensen i bransjens selvregulerende innsats. Dette bakteppet setter scenen for DeepMinds oppfordring til sterkere styring.

Vektere i maskinvare-og bransjepartnerskap

Stasjonen for AI-sikkerhet er ikke begrenset til programvare alene. Maskinvareselskaper spiller også en rolle i å bygge AI-sikkerhetsinfrastruktur. Nvidia introduserte for eksempel Nemo-rekkverk i januar 2025, en serie mikroservices designet for å gi sanntids beskyttelse mot skadelig AI-atferd. Verktøyene inkluderer innholdssikkerhetsfilter, jailbreak-deteksjon og emnekontroll, alt designet for å fungere i takt med eksisterende modeller for å sikre at de forblir i samsvar med sikkerhetsprotokoller.

Disse verktøyene er allerede distribuert i sektorer som Healthcare, Retail og Automer, som tilbyr et nivå. Kari Briski, visepresident for Enterprise AI-modeller i Nvidia, bemerket at disse systemene lar bedrifter”sikre modellene sine mot skadelige utganger”mens de opprettholder ytelsen med lav latens. Ved å integrere disse teknologiene posisjonerer NVIDIA seg som en nøkkelaktør i AIs fremtidige sikkerhet.

Samarbeidet mellom maskinvare-og programvareselskaper understreker det kollektive ansvaret som deles i hele bransjen for å adressere AGI-risikoer. Mens DeepMinds ramme tar til orde for en global styringsstruktur, er det tydelig at veien for å sikre AI vil kreve samordnede tiltak fra både utviklere og maskinvareleverandører.