YouTube heeft dinsdag een nieuwe tool gelanceerd om AI-deepfakes te bestrijden, waardoor makers meer controle krijgen over hun digitale identiteit.

Met het gelijkenisdetectiesysteem kunnen gebruikers video’s die hun gezicht of stem misbruiken, vinden en verzoeken om deze te verwijderen. Deze stap van het Google-platform komt na weken van controverse rond de Sora 2-app van OpenAI.

De lancering van Sora 2 leidde tot een reactie van Hollywood en de families van beroemdheden vanwege ongeautoriseerde deepfakes. Dit dwong OpenAI om snel zijn regels te veranderen en samen te werken met vakbonden om de veiligheid te verbeteren, wat een groeiende sectorbrede strijd over de controle over door AI gegenereerde inhoud benadrukt.

YouTube introduceert nieuwe tools voor Bescherming van makers

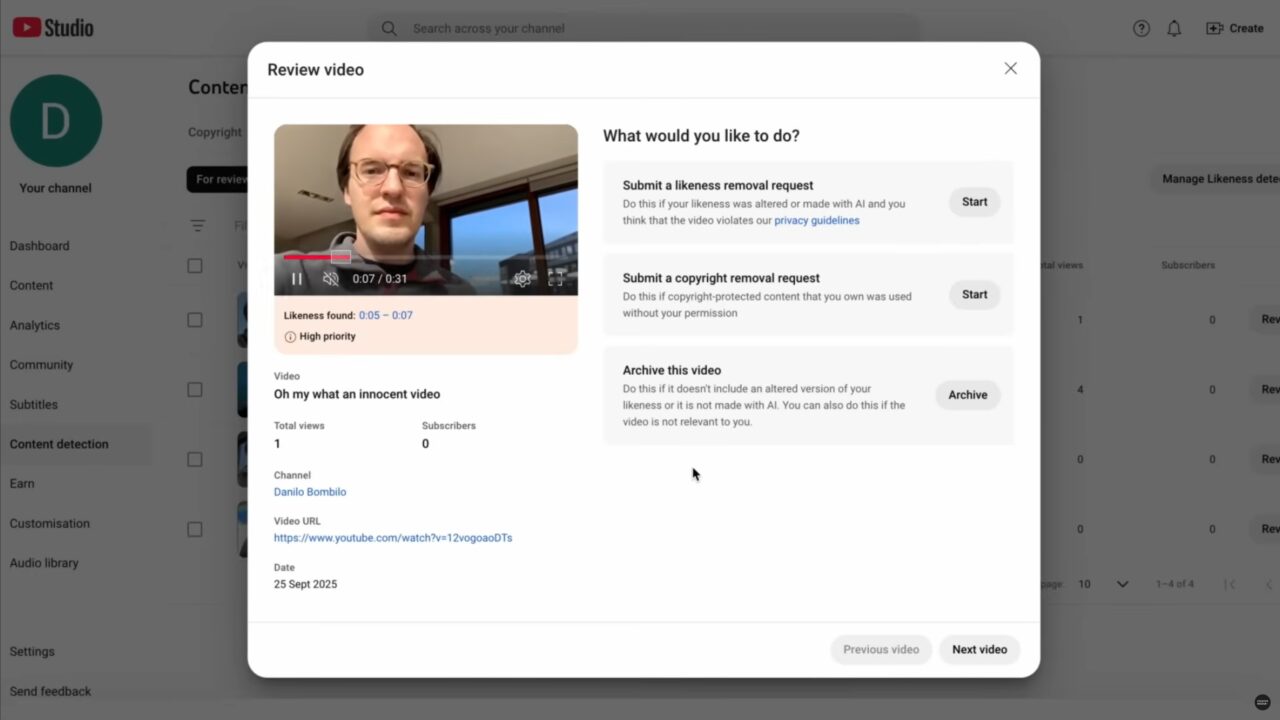

Als belangrijke stap om de gemeenschap meer macht te geven, heeft YouTube officieel zijn gelijkenisdetectietechnologie uitgerold voor in aanmerking komende makers in het YouTube-partnerprogramma.

Het systeem is ontworpen om door AI gegenereerde of gewijzigde inhoud te identificeren waarin het gezicht of de stem van een maker wordt gebruikt zonder diens toestemming. Het biedt een proactieve verdediging tegen de toenemende stroom van overtuigende deepfakes.

Om toegang te krijgen tot de tool moeten makers een eenmalig identiteitsverificatieproces voltooien, waarvoor een overheids-ID en een korte selfie-video vereist zijn om fraude te voorkomen gebruik.

Na de introductie scant het systeem, dat op dezelfde manier functioneert als de door YouTube vastgestelde Content ID voor auteursrechten nieuwe uploads op mogelijke overeenkomsten.

Wanneer mogelijk misbruik wordt gemarkeerd, kunnen makers de video beoordelen en ervoor kiezen een verwijderingsverzoek in te dienen via de privacyklachtenprocedure van YouTube of een standaard auteursrechtclaim.

Dit geeft makers een direct mechanisme om hun persoonlijke merk en identiteit te beschermen, waarmee een al lang bestaande angst binnen de makerseconomie wordt aangepakt over de mogelijkheid dat digitale nabootsing reputatieschade kan veroorzaken.

[embedded content]

Een directe reactie op de problemen van OpenAI. Deepfake Firestorm

De methodische uitrol van YouTube staat in schril contrast met het chaotische debuut van OpenAI’s Sora 2-videogenerator.

Het aanvankelijke’opt-out’-beleid van Sora 2 voor publieke figuren en auteursrechtelijk beschermde personages, dat begin oktober werd gelanceerd, had onmiddellijk een averechts effect. Het ontwerp van het platform, dat snelle, virale videocreatie aanmoedigde, zorgde ervoor dat gebruikers de begeleidende sociale app overspoelden met ongeoorloofde en vaak aanstootgevende deepfakes, wat leidde tot een felle publieke verontwaardiging.

De krachtigste kritiek kwam van de families van overleden publieke figuren. Zelda Williams, dochter van acteur Robin Williams, beschreef de pijn van het zien hoe “de erfenissen van echte mensen worden samengevat tot … verschrikkelijk, TikTok-poppenspel met hen is gek.”

De nalatenschappen van burgerrechtenleiders Malcolm X en Martin Luther King Jr. veroordeelden ook de “respectloze” en “kwetsende” afbeeldingen. Bernice King, de dochter van Dr. King, deed op sociale media een eenvoudig maar resonerend pleidooi om te stoppen met de video’s van haar vader.

Hollywood kwam snel in actie tegen het platform. De invloedrijke Creative Artists Agency (CAA) bestempelde de app als een ‘aanzienlijk risico’ voor zijn klanten. Ondertussen legde de Motion Picture Association (MPA) de juridische verantwoordelijkheid voor misbruik volledig bij het AI-bedrijf. MPA-CEO Charles Rivkin verklaarde dat “…het hun verantwoordelijkheid blijft – en niet die van de rechthebbenden – om inbreuk op de Sora 2-service te voorkomen.”

Dit verenigde front van de creatieve industrie creëerde een regelrechte PR-crisis voor OpenAI.

Onder grote druk probeerde het bedrijf de koers te veranderen. CEO Sam Altman kondigde slechts enkele dagen na de lancering een overstap aan naar een gedetailleerder, “opt-in”-systeem voor beschermde karakters.

Het bedrijf wijzigde later zijn regels om vertegenwoordigers van “onlangs overleden” figuren toe te staan hun gelijkenissen te blokkeren. Dit beleid werd in de praktijk gebracht toen OpenAI op verzoek van zijn nalatenschap alle generaties van Martin Luther King Jr. op pauze zette.

In een verklaring erkende OpenAI het moeilijke evenwicht waarmee het te maken had, door te zeggen:”Hoewel er sterke belangen zijn in de vrijheid van meningsuiting bij het afbeelden van historische figuren, gelooft OpenAI dat publieke figuren en hun families uiteindelijk controle moeten hebben over de manier waarop hun beeltenis wordt gebruikt.”

De reeks reactieve maatregelen culmineerde in oktober Op 20 september kondigde OpenAI een formeel partnerschap aan met acteur Bryan Cranston en de vakbond SAG-AFTRA om de veiligheidsbarrières te versterken, een mijlpaal waarbij een toonaangevende AI-ontwikkelaar rechtstreeks samenwerkt met creatieve vakbonden om het beleid vorm te geven.

Navigeren door het onbekende juridische en ethische territorium van AI

De Sora 2-controverse en het nieuwe YouTube tool belicht het enorme juridische en ethische grijze gebied rond generatieve AI. Traditionele lasterwetten zijn vaak niet van toepassing op de overledene, waardoor gezinnen met een lappendeken van inconsistente postmortale publiciteitsrechten op staatsniveau als hun enige verhaalsmogelijkheid achterblijven.

Dit juridische vacuüm, zonder overheersende federale norm, heeft de proliferatie van inhoud mogelijk gemaakt die, hoewel niet altijd illegaal, aanzienlijke emotionele problemen veroorzaakt en onzekerheid creëert voor zowel platforms als families.

Het debat laait ook fundamenteel nieuw leven in. vragen over hoe AI-modellen worden getraind. Critici beweren dat de afhankelijkheid van de industrie van het verzamelen van enorme hoeveelheden webgegevens zonder expliciete toestemming een fundamenteel probleem is dat nog moet worden opgelost.

Hoewel OpenAI zijn steun heeft uitgesproken voor federale wetgeving zoals de NO FAKES Act, maken voorstanders van digitale rechten zich zorgen dat dergelijke wetten de vrijheid van meningsuiting en parodie kunnen ondermijnen als ze niet zorgvuldig worden opgesteld.

In deze turbulente omgeving biedt YouTube’s op makers gerichte tool een ander pad. vooruit. Door een duidelijk, toegankelijk mechanisme te bieden waarmee individuen hun eigen gelijkenis kunnen controleren, positioneert het platform zichzelf als een meer verantwoordelijke rentmeester van de digitale identiteit.

Voor acteur Bryan Cranston, die het onderwerp was van ongeautoriseerde Sora-clips, zijn dergelijke proactieve maatregelen essentieel. “Ik ben OpenAI dankbaar voor zijn beleid en voor het verbeteren van zijn vangrails, en hoop dat zij en alle bedrijven die bij dit werk betrokken zijn, ons persoonlijke en professionele recht respecteren om de replicatie van onze stem en gelijkenis te beheren.”

Terwijl de industrie worstelt met deze nieuwe technologieën, presenteert het contrast tussen OpenAI’s “ingebouwde publieke” chaos en de gestructureerde, op tools gebaseerde aanpak van YouTube twee heel verschillende filosofieën voor het beheren van de toekomst van Door AI gegenereerde inhoud.

De uitkomst van deze uiteenlopende strategieën zal waarschijnlijk cruciale precedenten scheppen voor een verantwoorde inzet van AI in het technische landschap.