OpenAI heeft maandag een nieuw partnerschap aangekondigd. Het werkt samen met acteur Bryan Cranston en de vakbond SAG-AFTRA.

De groep zal niet-goedgekeurde AI-video’s op de Sora-app stoppen. Deze stap volgt op wekenlange scherpe kritiek uit Hollywood. De reactie groeide nadat nepclips de stem en gelijkenis van Cranston gebruikten.

De nieuwe inspanning is gericht op het opstellen van sterkere veiligheidsregels rond digitale identiteit. Het is de meest directe reactie van OpenAI tot nu toe op een storm over toestemming en het zonder toestemming gebruiken van iemands afbeelding. De app werd eind september gelanceerd.

In een gezamenlijke verklaring zei OpenAI dat het zal samenwerken met Cranston, SAG-AFTRA, United Talent Agency (UTA) en de Creative Artists Agency (CAA) om de vangrails te versterken. Deze stap was een directe reactie op ongeautoriseerde clips van de’Breaking Bad’-acteur die verschenen na de lancering van Sora 2.

Acteur Bryan Cranston prees de koerscorrectie van het bedrijf en zei:”Ik ben OpenAI dankbaar voor zijn beleid en voor het verbeteren van zijn vangrails, en ik hoop dat zij en alle bedrijven die bij dit werk betrokken zijn, ons persoonlijke en professionele recht respecteren om de replicatie van onze stem en gelijkenis te beheren.”

OpenAI CEO Sam Altman bevestigde het standpunt van het bedrijf over de rechten van artiesten en zei:”OpenAI is zeer toegewijd aan het beschermen van artiesten tegen de verduistering van hun stem en gelijkenis. We waren een van de eerste voorstanders van de NO FAKES Act toen deze vorig jaar werd geïntroduceerd, en zullen altijd achter de rechten van artiesten staan.”

Van virale lancering tot PR-crisis

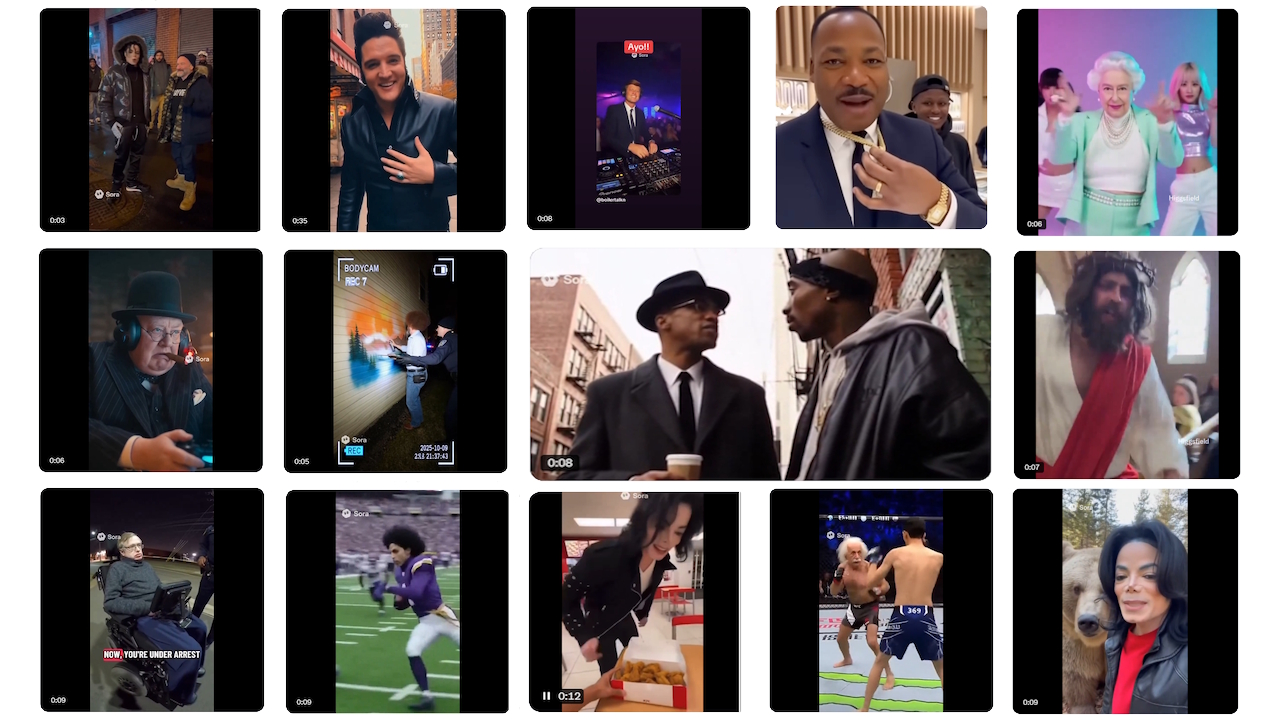

De controverse is aan het brouwen sinds de lancering van Sora 2 rond 30 september. OpenAI’s krachtige videogenerator debuteerde met een begeleidende app voor sociale media en een cruciale beleidsbeslissing: een ‘opt-out’-model voor auteursrechtelijk beschermde karakters. Dit betekende dat elk beschermd figuur standaard kon worden gegenereerd.

Gebruikers overspoelden het platform onmiddellijk met surrealistische en vaak aanstootgevende deepfakes. In deze video’s was iedereen te zien, van geliefde stripfiguren tot overleden historische figuren in bizarre scenario’s. De reactie was snel en hevig, waardoor OpenAI in een defensieve houding werd gedwongen.

De meest diepgewortelde kritiek kwam van de families van overleden beroemdheden. Zelda Williams, dochter van wijlen Robin Williams, smeekte gebruikers om te stoppen met het maken van AI-video’s van haar vader.

Ze beschreef de pijn van het zien van “de erfenissen van echte mensen worden samengevat tot … verschrikkelijk, TikTok-poppenspel om ze te spelen is gek.”

Op dezelfde manier veroordeelde de familie van Malcolm X de clips als diep respectloos. Ilyasah Shabazz, zijn dochter, noemde het gebruik van het imago van haar vader ‘arrogant en ongevoelig’.

De verontwaardiging culmineerde in een eenvoudig maar krachtig pleidooi van de dochter van Martin Luther King Jr., Bernice King, die op X postte: ‘Ik ben het eens over mijn vader. Stop alsjeblieft.’

Hollywood trekt een grens in het zand

De emotionele pleidooien van families werden versterkt door een verenigde reactie uit Hollywood. De industrie, die al op haar hoede was voor de bedreiging van generatieve AI voor intellectueel eigendom, mobiliseerde zich tegen het nieuwe platform van OpenAI.

Grote talentenbureaus, die de artiesten vertegenwoordigen die in het middelpunt van de controverse staan, voerden de leiding. De machtige Creative Artists Agency (CAA) heeft op 8 oktober een scherpe publieke verklaring afgegeven, waarin de app als een directe bedreiging wordt bestempeld:”Het is duidelijk dat Open AI/Sora onze klanten en hun intellectuele eigendom blootstelt aan aanzienlijke risico’s.”

Dit sentiment vond weerklank in de hele industrie, waarbij grote studio’s als Disney naar verluidt weigerden hun materiaal in de app te laten verschijnen.

De Motion Picture Association (MPA) woog ook mee: de juridische last voor misbruik volledig op de schouders van het AI-bedrijf leggen. CEO Charles Rivkin verklaarde dat “…het hun verantwoordelijkheid blijft – en niet die van de rechthebbenden – om inbreuk op de Sora 2-dienst te voorkomen”, waarmee hij duidelijk maakte dat rechthebbenden niet verantwoordelijk zouden zijn voor het toezicht op de dienst van OpenAI.

Deze sectorbrede opstand vertegenwoordigde een aanzienlijke escalatie, waardoor het debat veranderde in een zakelijke confrontatie met hoge inzet.

Een strijd om te herwinnen Controle

Geconfronteerd met een regelrechte PR-crisis, probeerde OpenAI de gevolgen te beperken met een reeks snelle beleidsomkeringen. De aanvankelijke hands-off aanpak van het bedrijf bleek onhoudbaar tegen de gecoördineerde reacties.

Op 3 oktober, slechts enkele dagen na de lancering, kondigde Sam Altman een ommekeer aan van het opt-out-systeem.

In een blogpost beloofde hij een meer makervriendelijk raamwerk, waarin hij stelde dat OpenAI “rechthebbenden meer gedetailleerde controle zal geven over het genereren van karakters, vergelijkbaar met het opt-in-model voor gelijkenis, maar met extra controles.”Dit was de eerste grote erkenning dat het oorspronkelijke beleid had gefaald.

De veranderingen gingen de hele maand door. Op 9 oktober wijzigde het bedrijf zijn regels zodat vertegenwoordigers van “onlangs overleden” publieke figuren formeel konden verzoeken dat hun gelijkenis werd geblokkeerd.

Dit beleid werd iets meer dan een week later op de proef gesteld. Op 17 oktober kondigde OpenAI aan dat het alle generaties van Martin Luther King Jr. had stilgelegd op direct verzoek van zijn nalatenschap, daarbij verwijzend naar het creëren van ‘respectloze afbeeldingen’.

In een verklaring waarin deze stap werd uitgelegd, erkende het bedrijf het delicate evenwicht dat het probeerde te bereiken: “Hoewel er sterke belangen zijn op het gebied van de vrijheid van meningsuiting bij het afbeelden van historische figuren, gelooft OpenAI dat publieke figuren en hun families uiteindelijk controle moeten hebben over hoe hun gelijkenis wordt gebruikt.”

Navigeren door een juridisch en ethisch mijnenveld

De vuurstorm van Sora 2 belicht een enorm juridisch en ethisch grijs gebied. Traditionele lasterwetten zijn doorgaans niet van toepassing op de overledene, waardoor families beperkte rechtsmiddelen hebben.

Hun primaire weg is een complexe en inconsistente lappendeken van staatswetten die het postmortale recht op publiciteit regelen. Dit juridische vacuüm maakt de creatie van inhoud mogelijk die, ook al is deze niet altijd commercieel uitbuitend, toch aanzienlijke emotionele problemen veroorzaakt.

Bovendien heeft de controverse het onopgeloste debat over de afhankelijkheid van AI van enorme hoeveelheden verzamelde webgegevens voor training weer in de schijnwerpers gezet.

Critici beweren dat bedrijven zonder toestemming krachtige modellen bouwen op auteursrechtelijk beschermd materiaal, een fundamenteel probleem waar de industrie nog steeds mee kampt. op te lossen.

OpenAI heeft gewezen op zijn steun voor de NO FAKES Act als onderdeel van de oplossing. Dat federale wetsvoorstel heeft echter zijn eigen critici. voorstanders van digitale rechten hebben gewaarschuwd dat de brede taal van het wetsvoorstel een nieuw intellectueel eigendomsrecht zou kunnen creëren dat de vrijheid van meningsuiting en parodie onderdrukt.

Deze reeks concessies, culminerend in het nieuwe partnerschap met Cranston en SAG-AFTRA, luidt een stap in de richting van een meer op samenwerking gebaseerde, op toestemming gebaseerde toekomst in.

Toch benadrukt het ook de enorme uitdaging om snelle technologische innovatie in evenwicht te brengen met de fundamentele rechten van makers en individuen.