Microsoft transformeert Windows 11 in een’AI-pc’met een grote Copilot-update die vandaag is aangekondigd, met als doel de interactie met computers natuurlijker en intelligenter te maken.

Een nieuw’Hey, Copilot’-wakeword stelt gebruikers in staat spraakopdrachten te geven, terwijl de nu wereldwijd beschikbare Copilot Vision de AI laat zien en begrijpen wat er op het scherm staat om hulp te bieden.

Microsoft geeft ook een voorproefje van de experimentele Copilot Acties waarmee de assistent taken rechtstreeks op de pc voor de gebruiker kan uitvoeren. Deze updates, die nu worden uitgerold, vertegenwoordigen de visie van Microsoft om een proactieve AI-partner diep in de kern van het besturingssysteem te verankeren.

De Consumer Chief Marketing Officer van het bedrijf, Yusuf Mehdi heeft de ambitie duidelijk geformuleerd en stelde:”De visie die we hebben is: laten we het hele besturingssysteem rond AI herschrijven, en in wezen bouwen wat echt de AI-pc wordt.”

De revisie duidt op een strategische gok dat de toekomst van personal computing niet alleen gaat over verwerkingskracht, maar over intelligente, conversatie-interactie. Het doel is om van elk Windows 11-apparaat een platform te maken voor dit nieuwe paradigma, dat ook Copilot-connectoren omvat voor services als Gmail.

‘Hé, Copilot’: stem wordt een kern-pc-invoer

Microsoft doet een hernieuwde en ambitieuze poging om stem als primaire methode voor pc-interactie te introduceren. Het middelpunt van deze inspanning is het nieuwe wake-word’Hey, Copilot’, dat nu algemeen beschikbaar is en dat de wrijving wegneemt die gepaard gaat met het klikken op een pictogram om een gesprek te starten. Deze functie staat centraal in de strategie van het bedrijf om zijn krachtige AI toegankelijker te maken voor een breder publiek.

Dit is niet de eerste poging van het bedrijf tot spraakintegratie. Critici wijzen al snel op de spectaculaire mislukking van Cortana op Windows 10 tien jaar geleden. Microsoft gokt er echter op dat de verfijning van de moderne AI gebruikers er uiteindelijk van zal overtuigen dat praten met hun pc niet raar is, wat een echte gedragsverandering teweegbrengt waar pogingen uit het verleden dat niet konden.

Het vertrouwen van het bedrijf wordt ondersteund door interne gegevens die suggereren dat wanneer mensen hun stem gebruiken, ze twee keer zoveel met Copilot communiceren dan wanneer ze tekst gebruiken.

Microsoft wijst op bestaand gedrag, zoals de miljarden minuten die worden besteed aan praten in Teams-vergaderingen. en het gebruik van toegankelijkheidstools, als bewijs dat gebruikers al vertrouwd zijn met het praten met hun apparaten.

De ervaring is ontworpen om naadloos te zijn. Nadat u de opt-in-functie in de instellingen hebt ingeschakeld, zorgt het zeggen van’Hé, Copiloot’ervoor dat er een microfoonpictogram en een geluidssignaal verschijnen, ter bevestiging dat de assistent luistert. Gebruikers kunnen het gesprek beëindigen door’Tot ziens’te zeggen of door simpelweg hun interactie te stoppen. Dit gebruiksgemak is volgens Microsoft de’magische ontgrendeling’van spraak.

[embedded content]

Yusuf Mehdi, hoofd consumentenzaken van Microsoft, gelooft dat deze verschuiving diepgaand zal zijn. “In onze gedachten wordt stem nu het derde invoermechanisme dat je met je pc kunt gebruiken”, legde hij uit in een briefing.

Deze ambitie gaat verder dan alleen maar dicteren, en positioneert stem als een hulpmiddel voor complexe opdrachten en vragen die de kloof kunnen overbruggen tussen de intentie van een gebruiker en de vaardigheid van AI-prompts.

De ultieme visie is een computer die echt op conversaties kan communiceren en reageren.”Je zou met je pc moeten kunnen praten, ervoor zorgen dat hij je begrijpt, en daar vervolgens magie uit laten gebeuren.”

Mehdi voegde eraan toe. Dit vertegenwoordigt een grote gok, waarbij we ervan uitgaan dat AI steminteractie eindelijk overtuigend genoeg heeft gemaakt om tientallen jaren van gebruikersgewoonten rond het toetsenbord en de muis te veranderen.

Een AI die uw scherm ziet: Copilot Vision wordt wereldwijd uitgerold

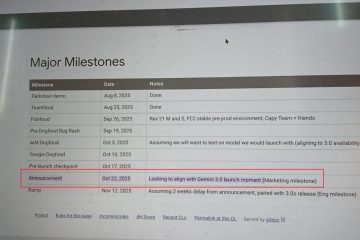

Een belangrijk onderdeel van deze AI-centrische toekomst is Copilot Vision, dat nu beschikbaar is in alle markten waar Copilot wordt aangeboden. Met deze functie kan de AI het scherm van een gebruiker’zien’en analyseren, waardoor contextuele hulp wordt geboden in elke toepassing.

Deze mogelijkheid is snel geëvolueerd sinds de eerste beperkte preview, die beperkt was tot de Edge-browser en een betaald abonnement vereiste.

De functie transformeert Copilot van een passieve chatbot in een actieve, visuele gids. In tegenstelling tot de controversiële Recall-functie is Vision strikt opt-in en staat deze niet altijd aan.

Gebruikers moeten expliciet toestemming verlenen voor elke sessie door op een afzonderlijk’brilpictogram’te klikken, waardoor hun schermweergave in wezen wordt gestreamd op een manier die lijkt op een Teams-oproep.

Eenmaal geactiveerd kan Vision stapsgewijze instructies bieden, pc-problemen oplossen of vragen over inhoud op het scherm beantwoorden. De mogelijkheid is uitgebreid van het bekijken van afzonderlijke applicaties naar een volledige’Desktop Share’-modus, waardoor de AI de context van de gehele workflow van een gebruiker kan begrijpen.

[embedded content]

Het Microsoft Copilot-team legde de functionaliteit uit en zei:”wanneer u uw bureaublad (of een specifiek browser-of app-venster) deelt, kan Copilot zien wat u ziet en er in realtime met u over praten.”

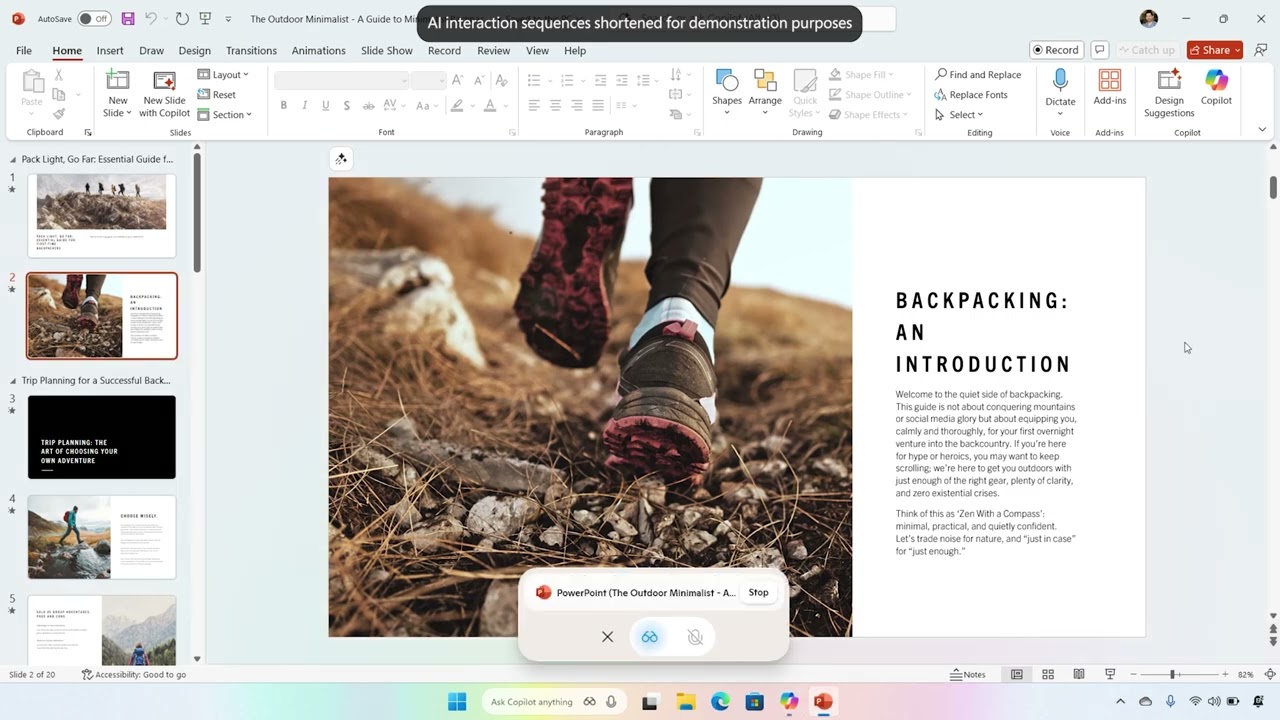

Praktisch toepassingen zijn uitgebreid. Een gebruiker kan tips vragen over een creatief project, hulp krijgen bij het verbeteren van zijn cv of begeleiding krijgen bij het navigeren door een nieuw spel. Dankzij de functie “Hoogtepunten” kan Copilot zelfs visueel aangeven waar moet worden geklikt om een taak te voltooien. Voor de productiviteit kan het een volledige PowerPoint-presentatie analyseren op inzichten zonder dat de gebruiker door elke dia hoeft te bladeren.

Hoewel Vision kan zien en adviseren, kan het geen actie ondernemen namens de gebruiker; die mogelijkheid is gereserveerd voor de afzonderlijke functie Copilot Actions. Om de ervaring veelzijdiger te maken, bereidt Microsoft ook een’Text-in Text-out’-modus voor, waardoor gebruikers met Vision kunnen communiceren via tekst in plaats van alleen via spraak.

Dit systeembrede bewustzijn is cruciaal voor het leveren van echt contextuele hulp. Door te begrijpen wat een gebruiker doet, kan Copilot relevante ondersteuning bieden zonder dat er lange uitleg nodig is, waardoor het doel van een’alledaagse metgezel’dichterbij komt. Een opnieuw ontworpen taakbalk biedt toegang met één klik tot deze tools, waardoor ze verder worden geïntegreerd in de kernervaring van Windows.

Van assistent tot agent: Copilot Acties nemen de controle over uw pc

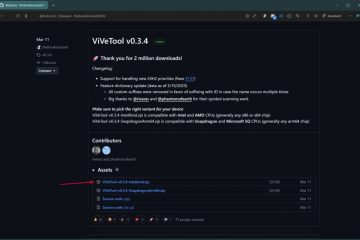

Misschien wel het meest toekomstgerichte element van de update is de experimentele preview van Copilot Actions voor lokale bestanden. Deze functie is beschikbaar voor Windows Insiders via Copilot Labs en stelt de AI in staat taken in meerdere stappen rechtstreeks op de pc van een gebruiker uit te voeren. Dit markeert een belangrijke stap in de richting van een toekomst van agentische AI, waarbij de assistent niet alleen reageert, maar actief namens u werkt.

Deze nieuwe mogelijkheid transformeert Copilot in wat Microsoft een’algemene agent’noemt. In plaats van alleen vragen te beantwoorden, kan het apps openen, typen, scrollen en complexe reeksen acties uitvoeren.

Gebruikers kunnen een taak in hun eigen woorden beschrijven (zoals het sorteren van vakantiefoto’s of het extraheren van informatie uit een pdf) en de agent zal proberen deze te voltooien door interactie met desktop-en webapplicaties.

Het systeem is ontworpen om te functioneren als een echte digitale medewerker. Terwijl de agent op de achtergrond werkt, kunnen gebruikers zich op andere zaken concentreren. Ze kunnen op elk moment de voortgang van de agent volgen, de specifieke acties bekijken die deze heeft ondernomen, of zelfs de controle over de taak volledig terugnemen. Deze mogelijkheid breidt zich uit op de webgebaseerde acties die Microsoft voor het eerst aankondigde in april, waardoor de kracht van automatisering rechtstreeks naar het Windows-bureaublad wordt gebracht.

Het bedrijf is echter transparant over zijn experimentele karakter en begint met een beperkt aantal gebruiksscenario’s om de prestaties te optimaliseren en te leren van gebruik in de echte wereld.

Navjot Virk, Corporate Vice President Windows Experiences van Microsoft, waarschuwde dat het systeem nog steeds aan het leren is.”In het begin zie je misschien dat de agent een aantal fouten maakt, of problemen tegenkomt wanneer hij een aantal zeer complexe applicaties probeert te gebruiken”, merkte ze op.

Deze transparantie maakt deel uit van een weloverwogen strategie om de verwachtingen van gebruikers voor deze krachtige maar opkomende technologie te beheersen.

[embedded content]

Leren van Recall: een nieuwe focus op opt-in en beveiliging

Microsoft is nadrukkelijk waarbij de nadruk wordt gelegd op het privacygerichte, opt-in-ontwerp van deze nieuwe functies. Deze voorzichtige aanpak is een directe en noodzakelijke reactie op de felle reacties op de Windows Recall-functie, die na de onthulling zwaar werd bekritiseerd vanwege de aanzienlijke beveiligingsproblemen.

Recall werd aanvankelijk verkocht met de belofte van privacy op het apparaat. Destijds verklaarde Yusuf Mehdi:”Recall maakt gebruik van uw persoonlijke semantische index, volledig gebouwd en opgeslagen op uw apparaat. Uw snapshots zijn van u; ze blijven lokaal op uw pc.”

Die belofte werd verbrijzeld toen onderzoekers ontdekten dat de functie de gegevens opsloeg in een niet-gecodeerde lokale database, waardoor wat velen een”goudmijn voor malware”noemden ontstond.

De intense kritiek dwong zich ertoe het bedrijf om de functie uit te stellen en de beveiliging ervan opnieuw te ontwerpen. Met Copilot Vision and Actions neemt Microsoft geen enkel risico.

Het bedrijf heeft een duidelijke reeks beveiligingsverplichtingen gepubliceerd, waarbij wordt benadrukt dat deze krachtige agentische ervaringen op verantwoorde wijze worden geïntroduceerd.

Cruciaal is dat Copilot Actions standaard is uitgeschakeld. Gebruikers moeten er expliciet voor kiezen om deze in te schakelen en kunnen deze op elk gewenst moment onderbreken, de controle overnemen of uitschakelen.

Microsoft belooft ook volledige zichtbaarheid, waardoor gebruikers de voortgang van de agent kunnen volgen en elke stap kunnen bekijken die deze neemt. Voor gevoelige beslissingen kan de agent zelfs specifieke goedkeuring vragen voordat hij verder gaat.

Deze draai weg van de passieve gegevensverzameling van Recall is van cruciaal belang voor het opbouwen van gebruikersvertrouwen. Het nieuwe model voor Copilot Actions is ontworpen om ervoor te zorgen dat de gebruiker altijd de controle heeft, een schril contrast met de aanvankelijke altijd-aan-aanpak van Recall. Deze zorgvuldige, preview-first-implementatie is bedoeld om feedback te verzamelen en beveiligingscontroles te verfijnen voordat een bredere release plaatsvindt.

Uiteindelijk positioneert Microsoft zijn AI-pc als een betrouwbare partner. Zoals Mehdi zei:”we willen dat iedereen die de overstap maakt, ervaart wat het betekent om een pc te hebben die niet alleen een hulpmiddel is, maar een echte partner.”

Het succes van deze ambitieuze visie zal niet alleen afhangen van de mogelijkheden van de technologie, maar ook van het vermogen van het bedrijf om gebruikers ervan te overtuigen dat zijn krachtige nieuwe AI-tools zowel veilig als beveiligd zijn.

[embedded content]