Oracle heeft vandaag, samen met strategische partner NVIDIA, zijn volgende generatie AI-native infrastructuur onthuld, met als koploper het enorme OCI Zettascale10 supercomputercluster en het diep geïntegreerde Oracle AI Database 26ai.

Aangekondigd op de AI World-conferentie zijn de nieuwe platforms ontworpen om de meest veeleisende AI-workloads aan te sturen, van het trainen van fundamentele modellen tot het uitvoeren van complexe gegevens analytics.

Deze grote productlancering verstevigt de positie van Oracle als cruciale wapenhandelaar in de AI-computerrace. Het verdiept de banden met NVIDIA en bevordert zijn strategie om de fundamentele “pistolen en scheppen” te bieden voor de hele AI-industrie.

Oracle’s AI-arsenaal: Zettascale10 en database 26ai

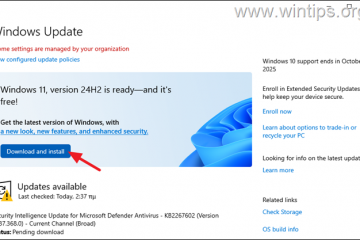

Het middelpunt van de aankondiging is de OCI Zettascale10, een evolutie van Oracle’s eerste zettascale cluster geïntroduceerd in september 2024. Het is een cloud-supercomputer ontworpen voor extreme schaal, het verbinden van honderdduizenden NVIDIA GPU’s in clusters van meerdere gigawatt die tot een ongekende 16 leveren zettaflops van topprestaties.

Deze enorme clusters zijn gehuisvest in datacentercampussen op gigawatt-schaal, hyper-geoptimaliseerd voor dichtheid binnen een straal van twee kilometer om de best mogelijke GPU-naar-GPU-latentie te garanderen. Dit is precies de architectuur die met OpenAI wordt geïmplementeerd op de vlaggenschip-supercomputersite Stargate in Abilene, Texas.

De kerninnovatie van het systeem is de nieuwe Acceleron RoCE-netwerkarchitectuur van Oracle. Dit ontwerp maakt op slimme wijze gebruik van de schakelmogelijkheden die zijn ingebouwd in moderne GPU-netwerkinterfacekaarten (NIC’s), waardoor ze tegelijkertijd verbinding kunnen maken met meerdere, fysiek geïsoleerde netwerkvlakken. Dit creëert wat Oracle een ‘breed, ondiep, veerkrachtig weefsel’ noemt.

Deze aanpak verhoogt de betrouwbaarheid voor grootschalige AI-taken dramatisch door het verkeer automatisch weg te leiden van overbelaste of onstabiele vliegtuigen, waardoor kostbare stilstand en herstart wordt vermeden. Het maakt ook gebruik van energie-efficiënte optica om de netwerk-en koelingskosten te verlagen zonder dat dit ten koste gaat van de doorvoercapaciteit, waardoor een groter deel van het energiebudget wordt besteed aan computergebruik.

OpenAI’s vice-president van infrastructuur, Peter Hoeschele, prees het ontwerp en merkte op:”Het zeer schaalbare, op maat gemaakte RoCE-ontwerp maximaliseert fabrieksbrede prestaties op gigawatt-schaal, terwijl het grootste deel van de kracht op rekenkracht wordt geconcentreerd.”

De hardware wordt aangevuld met Oracle AI Database 26ai, een mijlpaalondersteuningsrelease voor de lange termijn die AI rechtstreeks in de vlaggenschipdatabase van het bedrijf integreert.

Dit is niet zomaar een add-on; het vertegenwoordigt een fundamenteel herontwerp om AI-workloads native en veilig af te handelen. Een van de belangrijkste nieuwe mogelijkheden is Unified Hybrid Vector Search.

Met Database 26ai kunnen ontwikkelaars AI-vectorzoekopdrachten combineren met traditionele relationele, tekst-, JSON-, kennisgrafiek-en ruimtelijke zoekopdrachten in één enkele zoekopdracht, waardoor veel geavanceerdere inzichten uit complexe, multimodale bedrijfsgegevens mogelijk worden.

[embedded content]

De database introduceert ook ingebouwde ondersteuning voor agentic AI-workflows via het Model Context Protocol (MCP) en een Private AI Services Container. Deze container biedt een kant-en-klare omgeving voor het veilig uitvoeren van privé-instances van AI-modellen, die overal kunnen worden ingezet, van de publieke cloud tot on-premises datacenters.

Een diepe alliantie met NVIDIA

De nieuwe producten tonen een diepgaande, meerlaagse samenwerking met NVIDIA die veel verder reikt dan alleen silicium. Oracle’s AI Database 26ai is nauw geïntegreerd met de softwarestack van NVIDIA en biedt native ondersteuning voor NVIDIA NIM-microservices.

Hierdoor kunnen ontwikkelaars eenvoudig complexe RAG-pijplijnen (Retrieval-Augmented Generation) implementeren. De database is ook ontworpen om gebruik te maken van de cuVS-bibliotheek van NVIDIA voor GPU-versnelde vectorindexering, een cruciaal knelpunt in veel AI-toepassingen. Bovendien is NVIDIA AI Enterprise nu standaard beschikbaar in de OCI-console, waardoor de toegang tot een volledige reeks tools wordt gestroomlijnd.

De samenwerking was een centraal thema van het evenement. Mahesh Thiagarajan, Oracle’s EVP van Cloud Infrastructure, verklaarde:”Ik geloof dat de AI-markt wordt gedefinieerd door cruciale partnerschappen zoals die tussen Oracle en NVIDIA.”

Ian Buck van NVIDIA herhaalde dit en zei:”Door deze nieuwste samenwerking markeren Oracle en NVIDIA nieuwe grenzen op het gebied van baanbrekend versneld computergebruik…”, zo schetst hij de partnerschap als krachtvermenigvuldiger voor de adoptie van AI in ondernemingen.

Het aanwakkeren van de Grote AI-computerwapenwedloop

Deze aankondigingen zijn Oracle’s laatste salvo in de voortdurende AI-computerwapenwedloop. Deze kapitaalintensieve oorlog tussen technologiegiganten hervormt momenteel de economie. Uit een analyse van een econoom van Harvard blijkt dat de uitgaven voor AI-infrastructuur in de eerste helft van 2025 92% van de Amerikaanse bbp-groei hebben veroorzaakt.

De urgentie is voelbaar, gedreven door een existentiële angst om achterop te raken. Zoals OpenAI-president Greg Brockman ronduit zei:”Ik maak me veel meer zorgen dat we falen vanwege te weinig rekenkracht dan te veel.”

Deze mentaliteit voedt initiatieven ter waarde van biljoenen dollars, zoals Project Stargate, waar Oracle een belangrijke rol in speelde bij het opnieuw opstarten nadat het eerder dit jaar tot stilstand was gekomen.

De enorme omvang van de investeringen heeft geleid tot bezorgdheid over een industriële zeepbel, waarbij sommige critici wijzen op een “circulair financieringsmodel” waarbij partners investeren in projecten die alleen worden terugbetaald via de verkoop van hardware. Toch benadrukken marktleiders dat de uitbouw een noodzakelijk antwoord is op een enorme computercrisis.

De ‘AI-supermarkt’-strategie: weddenschappen afdekken met AMD

De strategie van Oracle is niet om te concurreren bij het bouwen van basismodellen, maar om de neutrale ‘AI-supermarkt’ voor de hele industrie te worden. Deze aanpak lijkt zijn vruchten af te werpen en belangrijke spelers aan te trekken die behoefte hebben aan een betrouwbare, krachtige infrastructuur zonder leveranciersafhankelijkheid.

Een goed voorbeeld is de historische vijfjarige cloudovereenkomst van OpenAI ter waarde van $300 miljard met Oracle om een enorme capaciteit van 4,5 gigawatt voor zijn Stargate-project veilig te stellen. Deze deal alleen al biedt een krachtig anker voor de AI-cloudactiviteiten van Oracle.

In een stap die deze strategie krachtig bevestigt, kondigde Oracle ook een belangrijk partnerschap met AMD aan. Het bedrijf is van plan om 50.000 van AMD’s nieuwe Instinct MI450 AI-chips in zijn cloud te implementeren, waardoor klanten een essentieel alternatief krijgen voor de hardware van NVIDIA.

Deze diversificatie komt rechtstreeks tegemoet aan de zorgen in de hele sector over de veerkracht van de toeleveringsketen. Het volgt ook op recente berichten dat Oracle’s eigen AI-cloudmarges onder druk stonden door de hoge kosten van chips, waardoor een tweede bron een strategische noodzaak werd.

Oracle Cloud’s SVP, Karan Batta, sprak zijn vertrouwen uit in het nieuwe aanbod en zei tegen verslaggevers:”We hebben het gevoel dat klanten AMD heel, heel goed zullen gaan gebruiken-vooral op het gebied van inferentie.”

Voor klanten heeft deze concurrentie de concurrentie vergroot. belooft meer keuze en betere prijzen. Analist Holger Mueller merkte de bredere betekenis op en zei:”Geweldige AI heeft geweldige data nodig. Met Oracle AI Database 26ai krijgen klanten beide.”