Chinese AI Startup Deepseek heeft een opmerkelijke update gelanceerd voor zijn R1-kunstmatige intelligentiemodel, aangewezen Deepseek-R1-0528, het aanzienlijk verbeteren van de mogelijkheden en het positioneren van de toonaangevende wereldwijde systemen. Ondanks opmerkelijke prestaties, beschouwt het bedrijf het nieuwe model als een”kleine update.”

Het bedrijf zegt dat de nieuwe versie de aanzienlijk verbeterde prestaties in redeneren, wiskunde en programmering levert, terwijl het ook het genereren van onjuiste informatie of”hallucinaties”vermindert. Dit is belangrijk voor gebruikers en de bredere industrie, die de snelle voortgang van Chinese AI-bedrijven benadrukt en een krachtigere, betrouwbare AI-tools belooft, waardoor de wereldwijde AI-competitie wordt geïntensiveerd.

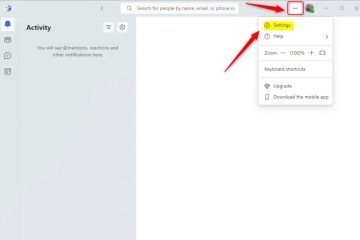

Deepseek

Voor gebruikers vertaalt dit zich in de verwachtingen van nauwkeurigere en contextueel relevante uitgangen, vooral bij het aanpakken van complexe taken. Het bedrijf benadrukte ook dat de R1-0528-versie verbeterde ondersteuning biedt voor functieaanroepen, waardoor een betere interactie mogelijk is met externe tools en een verbeterde ervaring voor”vibe codeering,”suggereert meer intuïtieve code-generatie, zoals vermeld in hun aankondiging. de nieuwste iteratie van diepe r1 billion-billon-billion-billon-billon-billion-bill-60-670-670-670-architectuur (Moe), met een mengsel) met een mengsel. maar activeert slechts ongeveer 37 miljard per token tijdens inferentie. Deepseek kwantificeert de prestatiesprong met specifieke benchmarkresultaten. Met name, in de AIME 2025-test, een uitdagende wiskundige concurrentie, steeg de nauwkeurigheid van het model naar verluidt van 70% naar 87,5%. Dit wordt toegeschreven aan een grotere redeneringdiepte; Het nieuwe model was gemiddeld 23.000 tokens-eenheden van tekst verwerkt-per vraag in deze test, een significante toename ten opzichte van de vorige 12.000 tokens. Verder demonstreren ervan, op het LivecodeBench-leaderboard, onderhouden door onderzoekers van UC Berkeley, MIT en Cornell, de nieuwe Deepseek R1-0528 beter presteerde Xai’s Grok-3-Mini en Alibaba’s Qwen-3. een belangrijke verbetering van DeepSeek is de’Reduced Hallucination Rate,’Reduced Hallucination Rate,’een kritieke stap voorwaarts als een kritieke stap voorheen’een kritieke stap voorwaarts als een kritieke stap voorheen’een kritieke stap voorwaarts als een kritieke stap vooraan. Plausibele maar valse informatie blijft een aanhoudende uitdaging. Ontwikkelaars die het model testen, hebben ook opgemerkt dat r1-0528 de officiële chatwebsite van Deepseek Door de optie”Deepthink”in te schakelen. R1-0528-model is ook toegankelijk met een gratis API via OpenRouter. Open-source community, Deepseek heeft ook Deepseek-R1-0528-QWen3-8b uitgebracht. Licentie onder de MIT-licentie , waardoor commercieel gebruik en distillatie ook is gereageerd. href=”https://unsloth.ai/blog/deepseek-r1-0528″target=”_ blank”> blogpost verbeterde mogelijkheden en dieper denken

Terwijl Deepseek’s knuffelpostdetails een belangrijke upgrade hebben, karakteriseerde sommige de release in De uitdrukkelijke tribune , die ook een DeepSeek-vertegenwoordiger vermeldt in een privé-wechat-groep. Deepseek bereidt zich voor op het R2-redeneermodel van de volgende generatie, waarvan de lancering naar verluidt werd versneld om beter te concurreren met Global AI Labs.

De originele Deepseek R1 heeft eerder in het jaar een aanzienlijke impact gemaakt door Openai’s O1 op verschillende redeneringsfensores. Variant. De beweerde dat het rapport aantoonde dat Deepseek niet zomaar een AI-app was, maar”een wapen in het arsenaal van de Chinese Communistische Partij, ontworpen om Amerikanen te bespioneren, onze technologie te stelen en de Amerikaanse wetgeving te ondermijnen.”

In antwoord op dergelijke druk op de Computational Focused Accessing Gevalideerde Gevalideerde, is dit Deepseek-modellen eind 2024.