Google dringt aan op wereldwijde actie op kunstmatige algemene intelligentie (AGI), en benadrukt de urgentie van het creëren van beveiligingen voordat deze systemen verder gaan dan menselijke controle. In een blogpost dat gisteren door DeepMind werd gepubliceerd, onthulde het bedrijf een nieuw internationaal veiligheidskader dat rond drie belangrijke pijlers is gebouwd: het versterken van technisch onderzoek, het implementeren van systemen voor vroegtijdige waarschuwing en het bevorderen van internationale samenwerking door bestuursorganen.

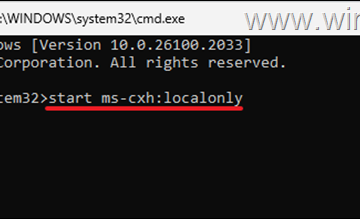

in plaats van zich te concentreren op beleidsframeworks of abstracte ethische overwegingen, is de diepgang in de praktijk in de praktijk van de snelle evolutie. Het bedrijf benadrukt dat de behoefte aan veiligheidsmaatregelen geen verre zorg is, maar een onmiddellijke uitdaging.”[A] sleutelelement van onze strategie is het identificeren en beperken van de toegang tot gevaarlijke mogelijkheden die kunnen worden misbruikt, inclusief die die cyberaanvallen mogelijk maken.”een tijd waarin de ontwikkeling van AGI versnelt. DeepMind framing Agi niet alleen als een toekomstige mogelijkheid, maar als een dreigende realiteit, onderstreept de noodzaak van voorzorgsmaatregelen vandaag.

In april 2023 heeft Google Deepmind zijn hersenteam samengevoegd met DeepMind, waardoor een uniforme onderzoeksentiteit wordt gevormd met het bevorderen van AI-mogelijkheden en het waarborgen van de veiligheid van die vooruitgang. De fusie maakte de weg vrij voor de ontwikkeling van de Gemini-modelfamilie, die belangrijke upgrades zag met de recente release van Gemini 2.5 Pro Experimental-het nieuwste multimodale AI-model dat in staat is tot geavanceerde redenering. Deze vooruitgang geeft de groeiende mogelijkheden van Deepmind aan, evenals de focus op het verzorgen van dergelijke krachtige systemen die op verantwoorde wijze worden ingezet. Het komt aan wanneer andere grote AI-labs soortgelijke stappen beginnen te nemen. Anthropic, een van de belangrijkste concurrenten van DeepMind, gaf in november 2024 een soortgelijke waarschuwing uit en drong er bij regelgevers op aan om binnen 18 maanden snel actie te ondernemen om weggelopen AI-ontwikkeling te voorkomen.

Het bedrijf introduceerde nieuw intern beleid, waaronder”capaciteitsdrempelingen”die automatisch sterkere beveiligingsbeveiligingen trigger als AI-systemen als AI-systemen als AI-systemen als AI-systemen vooruit. Anthropic heeft ook samengewerkt met de National Nuclear Security Administration van het Amerikaanse ministerie van Energie, waarbij ze rood-teaming oefeningen uitvoert om zijn Claude-modellen te testen in instellingen met een hoge beveiliging. Dit initiatief benadrukt de toenemende focus op AI-veiligheid, met name in contexten waarin AI de nationale veiligheid zou kunnen beïnvloeden.

Meta, die al lang voor open AI-ontwikkeling is gericht, evalueert ook zijn aanpak. In februari 2025 kondigde het bedrijf een verschuiving aan in zijn AI-strategie met het Frontier AI-framework, dat modellen verdeelt in de categorieën”Hoge risico”en”kritisch risico”. Meta legde uit dat modellen voor kritisch risico niet langer publiekelijk zouden worden vrijgegeven zonder strenge waarborgen.

Deze beslissing volgde het misbruik van zijn lama-modellen bij het genereren van kwaadaardige scripts en ongeoorloofde militaire chatbots. Meta benadrukte dat het doel is om catastrofale risico’s die bij deze modellen zijn geassocieerd te minimaliseren.

Hoewel deze bewegingen een verschuiving naar voorzichtigheid weerspiegelen, demonstreren ze ook de steeds complexere relatie tussen AI-ontwikkeling en het potentiële misbruik ervan. Naarmate meer bedrijven hun strategieën opnieuw kalibreren, past het voorstel van DeepMind in een groter patroon van voorzichtigheid naarmate de industrie worstelt met de toekomst van Agi.

het bouwen van de tools voor modelverbruik

Terwijl veel van het gesprek rond AI-veiligheidscentra op het bestuur zijn gericht op technische oplossingen. In februari lanceerde Anthropic de constitutionele classificator, een extern filtersysteem dat is ontworpen om tegenstanders en schadelijke uitgangen van zijn AI-modellen te voorkomen. Tests toonden aan dat de classificator de jailbreak-succespercentages verlaagde van 86% tot slechts 4,4%.

Om de effectiviteit ervan te valideren, leidde Anthropic een publieke uitdaging met een premie van $ 15.000 aan iedereen die het systeem kon omzeilen. Geen van de deelnemers is erin geslaagd het volledig te breken en de groeiende verfijning te onderstrepen van tools die zijn ontworpen om AI-systemen te bevatten.

die zijn inzet voor veiligheid bevordert, lanceerde antropisch in maart zijn interpreteerbaarheidskader, en noemde het een”AI-microscoop”als een hulpmiddel dat insights inzichten in hoe claude beslissingen neemt. Door neurale activeringen te analyseren, kan het traceren hoe het model informatie verwerkt en potentieel schadelijk gedrag detecteert.

Deze interpreteerbaarheid is essentieel, betoogt DeepMind, omdat het ongewenste resultaten kan voorkomen voordat ze zich manifesteren. Geïntroduceerd in december 2024 analyseert Clio miljoenen gesprekken met Claude om patronen van misbruik te detecteren. Het systeem geeft prioriteit aan privacy door gesprekken te anonimeren voordat ze ze verwerken. Deze proactieve benadering voor het monitoren van AI-gedrag komt overeen met de nadruk van DeepMind op de noodzaak van doorlopend veiligheidsoverzicht naarmate AI-systemen geavanceerder worden.

De EU-wet en nationale beleidsinspanningen nemen vast

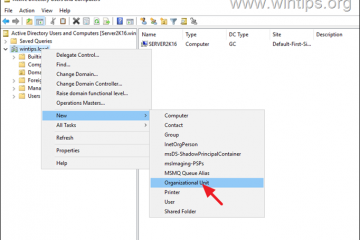

Het voorstel van DeepMind komt als de overheidsconcrete stappen in de wereld beginnen te reguleren AI. De AI-wet van de Europese Unie, die op 2 februari van kracht werd, verbiedt bepaalde AI-systemen die worden geacht”onaanvaardbare risico’s”te vormen en legt strikte transparantievereisten op aan degenen die worden beschouwd als hoog-risico.

Deze voorschriften manderen dat bedrijven onthullen hoe hun modellen worden getraind, welke gegevens ze gebruiken, en hoe ze potentieel risico’s mitigeren. Bedrijven zoals Openai en Meta hebben zich publiekelijk toegewijd om aan deze vereisten te voldoen, hoewel velen nog volledig moeten voldoen.

De implementatie van de EU-wet volgt maanden van debat binnen de industrie over hoe de innovatie het beste kan balanceren met veiligheid. De Europese Commissie heeft al aangetoond dat niet-naleving zou kunnen leiden tot boetes-tot 6% van de wereldwijde inkomsten van een bedrijf voor overtredingen.

In de Verenigde Staten is het Witte Huis begonnen met het overwegen van het recente voorstel van Anthropic, dat aanspoort om strengere veiligheidsprotocollen en toezichtsmechanismen voor AGI-modellen te overwegen. Zoals gemeld door TechCrunch, rolde antropische echter stilletjes verschillende veiligheidsverplichtingen terug die het in de begindagen van de Biden-administratie deed, waardoor vragen oproepen over de consistentie van de zelfregulerende inspanningen van de industrie. Deze achtergrond vormt het toneel voor de oproep van DeepMind voor sterker bestuur.

vangrails in hardware-en industriële partnerschappen

De drive voor AI-veiligheid is niet beperkt tot software alleen. Hardwarebedrijven spelen ook een rol bij het bouwen van AI-veiligheidsinfrastructuur. Nvidia introduceerde bijvoorbeeld Nemo-vangrails in januari 2025, een reeks microservices die zijn ontworpen om realtime waarborgen te bieden tegen schadelijk AI-gedrag. De tools omvatten contentveiligheidsfilters, jailbreak-detectie en onderwerpbeheersing, allemaal ontworpen om samen te werken met bestaande modellen om ervoor te zorgen dat ze voldoen aan veiligheidsprotocollen.

Deze tools worden al ingezet in sectoren zoals gezondheidszorg, detailhandel en automotive, die een niveau van toezicht bieden dat deepmind’s proposale voorzichten op een bredere schaal. Kari Briski, vice-president van Enterprise AI-modellen bij NVIDIA, merkte op dat deze systemen bedrijven in staat stellen”hun modellen te beveiligen tegen schadelijke output”met behoud van prestaties met lage latentie. Door deze technologieën te integreren, positioneert NVIDIA zichzelf als een belangrijke speler in de toekomstige veiligheid van AI. Terwijl het framework van DeepMind voor een wereldwijde bestuursstructuur pleit, is het duidelijk dat het pad om AI te beveiligen, gecoördineerde actie van zowel ontwikkelaars als hardwareproviders vereist.