OpenAI telah membatalkan akses API untuk pembangun yang menggunakan API Masa Nyata untuk menggerakkan sistem senapang autonomi. Projek itu, yang melibatkan turet robot yang dilengkapi dengan senapang, boleh mentafsir arahan lisan dan melaksanakan tindakan tembakan simulasi.

Insiden itu menggariskan kebimbangan yang semakin meningkat tentang kemungkinan penyalahgunaan kecerdasan buatan dalam membangunkan senjata autonomi, menimbulkan persoalan tentang etika AI dan keselamatan AI.

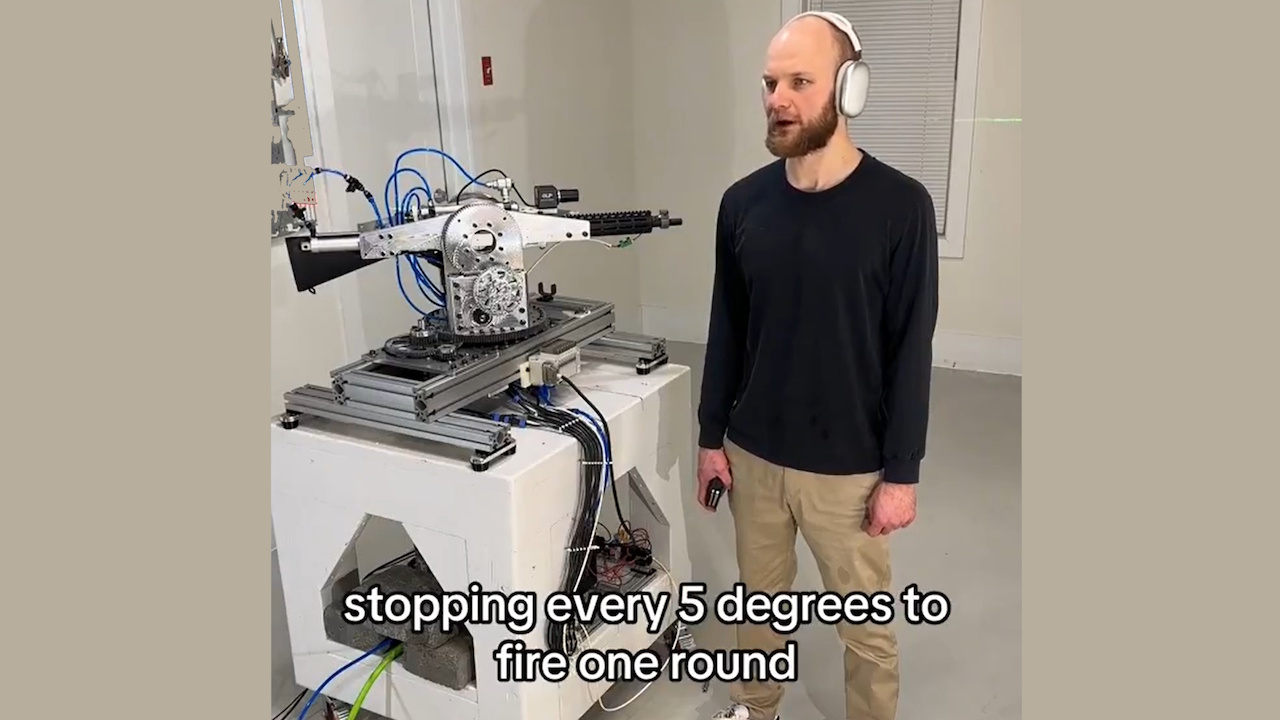

Pembangun, yang dikenali dalam talian sebagai “STS Innovations LLC,” berkongsi video sistem dalam talian, menunjukkan fungsinya. Dalam satu klip, pembangun mengeluarkan arahan, “ChatGPT, kami diserang dari depan kiri dan depan kanan,”yang mana turet segera bertindak balas, berputar dan menembak kosong pada arah yang ditentukan.

Sasaran/simulasi kebakaran dengan laser #robotik #electronics

Suara yang disintesis ditambahkan, “Jika anda memerlukan sebarang bantuan lanjut, beritahu saya sahaja.”Demonstrasi yang menyeramkan itu menyerlahkan cara alatan AI gred pengguna boleh disesuaikan dengan mudah untuk kegunaan yang berpotensi berbahaya.

Kemas kini pada sistem penjejakan #robotik #vision #electronics

Penguatkuasaan Dasar Swift OpenAI

OpenAI, yang terkenal dengan dasar ketat terhadap penggunaan teknologinya dalam persenjataan, bertindak balas dengan segera. Seorang jurucakap memberitahu Futurisme,”Kami secara proaktif mengenal pasti pelanggaran dasar kami ini dan memaklumkan pemaju untuk menghentikan aktiviti ini sebelum menerima pertanyaan anda.”

Syarikat itu menekankan larangannya terhadap penggunaan alatannya untuk mencipta atau mengendalikan senjata atau mengautomasikan sistem yang boleh menimbulkan risiko kepada keselamatan peribadi.

Sistem pengurusan mundur, demo pantas #robotik #electronics #cnc

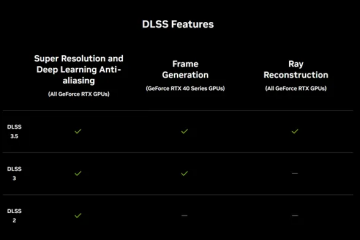

API Masa Nyata, alat yang direka untuk aplikasi interaktif, membenarkan pembangun mengubah arahan bahasa semula jadi kepada input yang boleh diambil tindakan untuk turet robotik.

Walaupun API bertujuan untuk kes penggunaan yang berfaedah, seperti meningkatkan kebolehcapaian atau meningkatkan interaksi pelanggan, penyalahgunaan ini menunjukkan cabaran mengawal selia teknologi dwi-guna.

Berkaitan: OpenAI dan Anduril Menjalin Perkongsian untuk Pertahanan Dron Tentera A.S.

Implikasi yang Lebih Luas untuk AI dan Senjata

Kes ini telah mencetuskan semula perdebatan mengenai etika senjata autonomi. Sistem ini, yang mampu memilih dan melibatkan sasaran tanpa pengawasan manusia, menimbulkan cabaran undang-undang dan moral yang kompleks.

PBB telah lama menyokong peraturan yang lebih ketat mengenai AI dalam peperangan, memberi amaran bahawa sistem autonomi boleh melanggar undang-undang antarabangsa dan mengurangkan akauntabiliti.

Berkaitan: Anthropic Bekerjasama dengan Palantir, AWS untuk AI dalam Perisikan dan Ketenteraan A.S.

Laporan Washington Post baru-baru ini contoh terperinci yang membimbangkan tentang penempatan AI dalam operasi ketenteraan, termasuk dakwaan bahawa Israel menggunakan AI untuk memilih sasaran pengeboman.

Laporan itu menyatakan,”Pada masa tertentu, satu-satunya pengesahan yang diperlukan ialah sasaran adalah lelaki.”Kes sedemikian menyerlahkan risiko bergantung pada AI dalam keputusan hidup atau mati dan potensi untuk sembarangan. keganasan.

Berkaitan: Green Beret Menggunakan ChatGPT untuk Cybertruck Blast, Polis Melepaskan Chat-Log

Peranan OpenAI dalam Teknologi Pertahanan

Walaupun OpenAI menguatkuasakan dasar yang melarang penggunaan senjata, perkongsiannya dengan Anduril Industries—sebuah syarikat yang pakar dalam penyelesaian pertahanan yang dipacu AI—menimbulkan persoalan tentang pendiriannya

Kerjasama ini bertujuan untuk meningkatkan perisikan medan perang dan meningkatkan sistem pertahanan dron OpenAI menggambarkan usaha ini sebagai pertahanan, tetapi pengkritik berpendapat ia menyumbang kepada ketenteraan yang lebih luas Teknologi AI.

Sektor pertahanan AS, disokong oleh belanjawan tahunan hampir $1 trilion, semakin bergantung pada teknologi canggih untuk mendapatkan kelebihan strategik ini, persimpangan yang semakin meningkat antara syarikat AI dan aplikasi ketenteraan ini menyerlahkan cabaran mengimbangi teknologi inovasi dengan pertimbangan etika.

Berkaitan: Konsortium AI Palantir-Anduril Baharu untuk Menangani Jurang Data Pertahanan A.S.

Risiko Senjata dan Kebolehcapaian DIY

Kemudahan individu boleh menyalahgunakan alatan AI dan teknologi lain seperti pencetakan 3D menambah masalah. Penguatkuasaan undang-undang telah pun menghadapi kes persenjataan DIY, seperti dakwaan tindakan Luigi Mangione, yang dilaporkan menggunakan bahagian bercetak 3D untuk memasang senjata api. Teknologi ini mengurangkan halangan bagi individu untuk mencipta sistem autonomi dengan potensi maut.

Projek STS 3D menunjukkan cara alat AI yang boleh diakses boleh disesuaikan untuk tujuan yang tidak diingini. Tindakan tegas OpenAI dalam hal ini menunjukkan komitmennya untuk mencegah penyalahgunaan, tetapi ia juga menekankan kesukaran untuk mengawal sepenuhnya cara teknologinya digunakan sebaik sahaja ia memasuki domain awam.

Insiden itu menimbulkan persoalan yang lebih luas tentang tadbir urus teknologi AI. Peguambela untuk peraturan menekankan keperluan untuk piawaian global yang jelas untuk memastikan pembangunan AI sejajar dengan prinsip etika. Walau bagaimanapun, mencapai kata sepakat di kalangan negara yang mempunyai kepentingan dan keutamaan yang berbeza masih menjadi tugas yang sukar.