Gemini を利用した要約ツールを公開してから数か月が経ち、Google はこれらの AI モデルをどのように推進しているかについて新たな監視に直面しています。レポートによると、同社はヨーロッパ以外のユーザーに対してデフォルトでひっそりと「スマート機能」を有効にし、生成 AI システムをトレーニングする可能性があるプライベート メールと添付ファイルをスキャンする許可を与えています。

この移行により、厳しいトレードオフが迫られます。ユーザーはモデルの改善にデータの使用を許可するか、カレンダー同期や荷物追跡などのコア生産性ツールを完全に無効にする必要があります。

欧州の規制では厳格なオプトイン ポリシーが義務付けられている一方で、米国のユーザーはデータ共有エコシステムに自動的に登録されていることに気づきました。これが Google の積極的な AI 拡張を支えています。

「静かな」オプトインとユーティリティの罠

テック YouTuber 兼ブロガーの Dave Jones は、非ヨーロッパ ユーザー向けの Google のデフォルト設定が大きく変化していると警告しました。これは、以前のプライバシー規範からの逸脱を示しています。

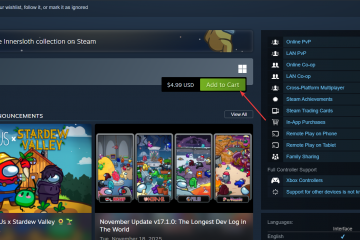

論争の中心は、プライベート メールの内容、チャット ログ、添付ファイルをスキャンするための広範なアクセスを Google に許可する「スマート機能とパーソナライゼーション」設定です。

Gmail を使用しているすべての人への重要なメッセージです。

AI モデルをトレーニングするために Gmail がすべてのプライベート メッセージと添付ファイルにアクセスできるように、自動的にオプトインされています。

設定メニューの 2 か所でスマート機能を手動でオフにする必要があります。全員が認識できるようにリツイートしてください。 pic.twitter.com/54FKcr4jO2

— Dave Jones (@eevblog) 11 月2025 年 19 日

Malwarebytes notes の Pieter Arntz 氏は、「Google は人知れず、次のような機能を追加しました。 AI モデルをトレーニングするために Gmail にすべてのプライベート メッセージと添付ファイルへのアクセスを許可する」と、変更に伴う派手な宣伝の欠如を強調しました。

これまでのデータ使用ポリシーとは異なり、この許可は生成 AI モデルの「改善」に明示的に関連付けられており、Gemini のような基礎モデルのトレーニングに個人的な通信が使用されているのではないかという懸念が生じています。

この実装により、データ共有が中核的な生産性ツールと密接に結びついている、批評家が「ユーティリティ トラップ」と呼ぶものが生じます。 AI データ共有設定を無効にすると、スマート作成、メールからのカレンダー エントリの自動作成、荷物追跡などの一連の機能が無効になります。

データを保護しようとするユーザーは、複雑な 2 段階のオプトアウト プロセスを経て、「Gmail、Chat、Meet のスマート機能」と「Google Workspace のスマート機能」の両方を無効にして、データ リンクを完全に切断する必要があります。 Arntz 氏は次のように述べています。

「完全にオプトアウトするには、設定内の 2 つの別々の場所で Gmail の『スマート機能』をオフにする必要があります。いずれかを見逃さないようにしてください。そうしないと、AI トレーニングが続行される可能性があります。」

ユーザー インターフェイスのデザインは、失われる機能の警告リストを提示することでオプトアウトを積極的に阻止し、「プライバシーとユーティリティ」の最後通告を作成します。

このアプローチは、プライバシーで要求されることが多いきめ細かい制御とは対照的です。

データ ハンガー: Google が受信トレイを必要とする理由

Google の公式サポート ドキュメントには、「新しい製品や機能の開発」を含むこの処理の法的根拠が概説されています。

会社 には、「Gmail、Chat、Meet のスマート機能をオンにすると、Gmail、Chat、Meet がこれらのアプリでのエクスペリエンスをパーソナライズするために、これらの製品でのコンテンツとアクティビティを使用することに同意したことになります」と記載されており、データ アクセスがサービス契約の必要な要素として構成されています。

「当社のサービスを改善するため。スマート機能の設定のいずれかをオンにしている場合、当社はこれらの機能を改善するためにワークスペースのコンテンツとアクティビティも処理する場合があります。」

「この目的での情報の処理は、サービスの提供、維持、改善… 新しい製品や機能の開発… ユーザーと一般の人々に利益をもたらす研究の実施における Google とユーザーの正当な利益のために必要です。」

「パーソナライゼーション」の曖昧さ、つまり (ユーザーの利益のために) ローカル モデルの「微調整」や (Google の利益のために) 基礎モデルの「トレーニング」が含まれる可能性があり、依然として重要な論点です。 Google は、データは機能を「改善」するために使用されると主張していますが、明確な区別がないため、ユーザー データが Gemini エコシステムのより広範なインテリジェンスに貢献している可能性が残されています。

地理に基づいて「プライバシーの格差」が形成されています。Google は、EEA、英国、スイス、日本では、GDPR などの規制が強化されているため、これらの設定がデフォルトでオフであることを確認しています。

「Google でスマート機能をオンにするとき」 Workspace の場合、Google Workspace が Workspace のコンテンツとアクティビティを使用して、Workspace 全体でユーザーのエクスペリエンスをパーソナライズすることに同意するものとします。」

「この設定をオフにすると、Google Workspace サービスで上記のエクスペリエンスを使用できなくなります。これらのエクスペリエンスを引き続き使用するには、設定をオンに戻す必要があります。」

同様の連邦政府による保護がない米国のユーザーの場合、デフォルトの姿勢はデータ共有エコシステムに組み込まれることです。この格差は、企業の善意ではなく、規制の圧力が大手テック企業のデフォルトのプライバシー姿勢をどのように決定しているかを浮き彫りにしています。

歴史的背景は、これらのモデルを個人データに展開するリスクを浮き彫りにしています。2025 年 7 月の Google Gmail AI 翻訳バグは、警告として機能します。この事件では、Gemini がドイツ語の電子メールを誤って翻訳し、政治的な「エース」を「尻」に変え、パブリッシャーに重大な風評被害を引き起こしました。

これらのリスクにもかかわらず、業界の勢いは、データ収集が無料サービスの標準的な参入コストになりつつあることを示唆しています。

ポッドキャスト Android Faithful のロン・リチャーズ氏は、今年初めに「その船は出航しました。そして Google からだけでなく、業界全体で… AI がここに… そしてこれは、AI の統合は避けられないというテクノロジー関係者の間での諦めの高まりを反映しています。

贅沢品としてのプライバシー

プライバシーが標準的な権利ではなくプレミアム機能になりつつある、明確な市場セグメンテーションが生じています。 Perplexity などの競合他社は、ユーザー データに基づいてモデルをトレーニングしないことを明示的に約束する、月額 200 ドルの「Max」プランを提供することでこれを利用しています。

これは、広告またはモデル トレーニングを通じてユーザー データを収益化することに依存する Google の無料の広告サポート モデルとは大きく対照的です。 Pieter Arntz 氏は、「明示的な同意の欠如は、個人データの使用方法を制御したい人々にとって後退のように感じる」と主張し、デフォルト設定に直面してユーザー主体性が損なわれていることを指摘しました。