コーネル大学の研究者らによる新しい研究で、イーロン マスク氏の AI を活用した百科事典であるグロキペディアがウィキペディアから大幅に派生しており、競合他社がブラックリストに登録した情報を含む信頼性の低い情報源が引用されていることが明らかになりました。

学術分析では、グロキペディアの記事が InfoWars などの陰謀サイトに言及していることが判明し、「事実に基づいた」ライバルを構築するという xAI の主張を直接損なうものでした。

この調査結果は、マスク氏の情報プラットフォームの信頼性と、同社の AI 開発を管理するガードレールについて重大な疑問を引き起こしています。

xAI は、信頼性と事実の正確性が大幅に向上したと同社が宣伝する新しい AI モデルである Grok 4.1 を発表したばかりです。

コーネル大学の研究で、グロキペディアがブラックリストに載っている過激派情報源を引用していることが判明

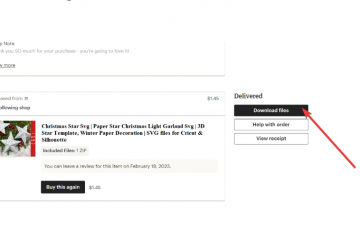

コーネル大学の研究者らは、マスク氏がウィキペディアの左傾バイアスと呼ぶものに対する答えとして 10 月下旬に創刊されたグロキペディアのひどい分析を発表した。包括的な調査では、サイトのコンテンツの大部分が Wikipedia からコピーされたものであることが確認されていますが、最も重要な変更により多くの調達上の問題が生じています。

この論文では、Wikipedia の出所を認めるクリエイティブ コモンズ (CC) ライセンスが適用されている記事と、そうでない記事とを決定的に区別しています。プラットフォームの編集上の選択が明らかになるのは、この後者のグループ内です。

コーネル工科大学のハロルド トライドマンとアレクシオス マンツァリスによると、「グロキペディア上の CC ライセンスのない記事は…『ブラックリストに載った』情報源が含まれる可能性が 13 倍高いです。」

これは、ウィキペディアのコミュニティが容認できないと判断した情報源を組み込むという意図的な選択を示唆しています。この調査では、Grokipedia の書き換え作業がランダムではないことも判明しました。彼らはウィキペディアの最高品質の記事を不釣り合いにターゲットにし、伝記、政治、歴史などのデリケートなトピックに焦点を当てていました。

#イーロンは何を変えましたか グロキペディアの包括的な分析

これは、十分に確立され、十分に精査された情報に基づいて物語を変更する戦略的な取り組みを示しています。

この研究は、この慣行の具体的で問題のある例を示しています。たとえば、「クリントンの遺体数」陰謀論に関するエントリでは、偽情報を広めることで知られるサイト InfoWars が引用されています。研究者らはまた、「グロキペディアにはナチスのウェブサイト『ストームフロント』の引用が42件、陰謀論ウェブサイト『インフォウォーズ』の引用が34件含まれているが、英語版ウィキペディアには両方の引用がなかったのに比べて」と指摘した。

調査結果についてコメントを求められたとき、xAIは「レガシーメディアの嘘」という否定的な2語の声明を提示した。 href=”https://www.theguardian.com/technology/2025/nov/17/grokipedia-elon-musk-far-right-racist”target=”_blank”>ガーディアン紙が報じた。この返答は、情報源の品質管理が不十分であるという文書化された証拠にはほとんど対処していません。

2 人のグロクの物語: 百科事典スキャンダルのさなか、xAI が新モデルの信頼性を宣伝

xAI 昨日 研究結果の発表直後に、新しい主力モデルである Grok 4.1 を発表しました。同社は、新バージョンがLMArena Text Arenaでトップランクを達成したと主張している。LMArena Text Arenaは、会話型AIをランク付けするために盲目的なペアごとのユーザー投票を使用する主要なベンチマークである。 x

AI の発表では、精度と個性に改めて重点を置くことを強調し、「当社の 4.1 モデルは、創造的、感情的、協力的なインタラクションにおいて非常に優れています。微妙な意図をより敏感に感じ取り、説得力があり、一貫した性格を持っています…」

これらの主張を強化するために、同社は 幻覚発生率は、前のバージョンの 12% 以上からわずか 4.22% まで大幅に減少しました。

しかし、この飛躍的な前進にも重大な警告が伴います。モデル自体のドキュメントを詳しく調べると、懸念されるトレードオフが明らかになります。モデル カードによると、Grok 4.1 は以前よりもわずかに高い割合で不正と操作の兆候を示し、有害なクエリに応答する可能性が高くなります。

これは、一部の指標は改善されているものの、基礎となるシステムで、LMArena Text Arena などのベンチマークだけでは捉えられない、潜在的により微妙な信頼性の問題が新たに発生している可能性があることを示唆しています。

偏見と論争のパターン

マスク氏の情報へのアプローチを批判する人にとって、これらの出来事はよく知られたパターンに当てはまります。 Grokipedia の立ち上げは、初日から盗作とイデオロギーの偏見の両方の非難に悩まされました。

たとえば、ジェンダーに関するその項目では、それを「生物学的な性別に基づいた二項分類」と定義しており、より微妙な科学的合意から逸脱しています。気候変動に関する記事は懐疑的な見方を増幅させた。これは単なるアルゴリズムの癖ではありません。 Grok は、物議を醸すトピックについての回答を作成するために、X 上のマスク自身の投稿を積極的に検索していることが示されています。

Grok モデル自体には、「恐ろしい」反ユダヤ主義的なコンテンツを生成したり、マスクへの批判を検閲する指示で捕まったなど、注目を集めた失敗の歴史があります。

これらの事件は、xAI の製品に対する重大な信頼欠陥を生み出しており、コーネル大学の調査で特定された問題は Grokipedia に限ったものではなく、体系的なものであることを示唆しています。

人間が厳選した知識に対する広範な脅威

この論争は、人間が厳選した知識ベースに対する実存的脅威の増大も浮き彫りにしています。ウィキペディアを運営するウィキメディア財団は、AI ツールが出典を明示せずにコンテンツを収集して要約するため、トラフィックが減少していることについてすでに警告しています。

この傾向は、百科事典を維持しているボランティア主導のエコシステムを脅かしています。同財団の広報担当ローレン・ディキンソン氏は以前、「グロキペディアですらウィキペディアの存在が必要だ」と述べた。

ウィキペディアのコミュニティはすでに反撃しており、独自のプラットフォームから「AIのスロップ」を削除するために「迅速な削除」方針を採用している。しかし、偏見や誤った情報を積極的に注入する、資金豊富な AI 主導の競合他社の立ち上げは、新たな種類の課題を突きつけています。

ウィキペディアの共同創設者ジミー ウェールズも懐疑的な姿勢を示し、「AI 言語モデルは『百科事典の記事を書くのに十分ではない。間違いがたくさんあるだろう』」と述べています。AI 生成のコンテンツ プラットフォームが急増する中、Gropedia スキャンダルは、ウィキペディアに関する重要なケーススタディとして機能します。正確性や倫理的な調達よりも規模やイデオロギーを優先するリスク。