Nvidia は、エージェント AI システムの信頼性、セキュリティ、信頼性に対するニーズの高まりに対応する一連のツールを発表しました。

Nvidia Inference Microservices (NIM) として知られる、新しいサービス企業が安全ガイドラインに準拠し、意図しない結果を防ぐ AI アプリケーションを展開できるように設計されています。

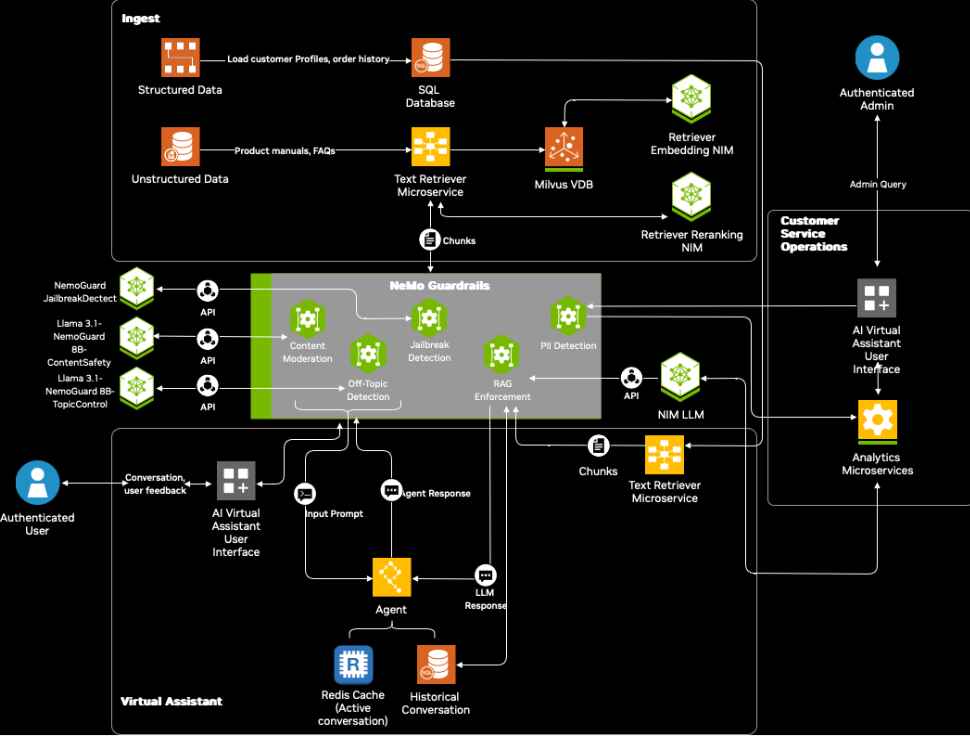

NeMo Guardrails フレームワークの一部として、これらのマイクロサービスは、コンテンツのモデレート、保守のための特殊なソリューションを提供します。

Nvidia のエンタープライズ AI モデル担当副社長、Kari Briski 氏は、今日のアプリケーションにおける AI の安全性を確保することの重要性を強調しました。 「AI エージェントは対話を自動化することで業界を急速に変革していますが、そのセキュリティと信頼性を確保することが重要です」と彼女は公式発表で述べました。

[埋め込みコンテンツ]

特化したマイクロサービスで AI の安全性の課題に対処

タスクを自律的に実行する人工知能の一種である Agentic AI は、小売、医療、自動車などの業界全体で導入が増加しています。システムは効率性と顧客エンゲージメントを強化しますが、有害な出力、データ プライバシー、敵対的な脆弱性に関する懸念も引き起こします。Nvidia の NIM は、次の 3 つの対象を絞ったソリューションでこれらのリスクを軽減することを目指しています。

コンテンツ セーフティ NIM。独自の Aegis コンテンツ セーフティについてトレーニングを受けています。データセットは、AI システムからの不適切または有害な出力を検出してブロックするように設計されており、人間が注釈を付けた 35,000 を超えるサンプルで構成されており、モデルが有害なコンテンツを効果的に識別して対応できるようになります。

関連: NVIDIA、Llama および Cosmos Nemotron モデルで Agentic AI を推進

NVIDIA は、今年後半に Hugging Face を通じてデータセットを一般公開し、そのデータセットを拡張する予定です。開発者や研究者へのアクセシビリティ。

トピック コントロール NIM は、AI によって生成されたインタラクションが定義された境界内に留まり、システムのドリフトを防ぎます。無関係または許可されていないトピックに参加します。このツールは、一貫性があり状況に応じた適切な応答が不可欠な顧客サービス シナリオで特に役立ちます。

ジェイルブレイク検出 NIM は、増大する敵対的攻撃の懸念に対処します。 17,000 件の既知の脱獄試行のデータセットに対して入力を分析することで、マイクロサービスはシステムの安全保護を無効にするように設計された悪意のあるプロンプトを特定し、ブロックします。

フローチャートNeMo ガードレールを使用した顧客サービスのための安全なインテリジェント仮想 AI アシスタント (画像: Nvidia)

フローチャートNeMo ガードレールを使用した顧客サービスのための安全なインテリジェント仮想 AI アシスタント (画像: Nvidia)

Briski 氏は、これらのツールの効率性を強調し、次のように述べました。 NeMo Guardrails コレクションは遅延を低減し、倉庫や病院などのリソースに制約のある環境へのシームレスな統合を可能にします。」

AI の安全性とパフォーマンスのバランス

A Nvidia のアプローチの重要な点は、安全性の必要性と高性能の要求のバランスを取ることです。初期のテストでは、新しいマイクロサービスが安全対策を 50% 向上させながら、レイテンシーの追加はわずか 0.5 秒しかないことが示されていると Nvidia は述べています。

関連: NVIDIA、音楽、音声、音響効果用の Fugatto AI モデルを発表

このレベルの最適化は、エンタープライズ AI における最も一般的な懸念事項の 1 つに対処します—セキュリティを損なうことなく、迅速な応答時間を確保します。

「ユーザーの操作に応じて、多くの異なる LLM または操作が行われる可能性があり、それらのそれぞれをガードレールする必要があります」と Kar 氏は言いました。 Briski.

企業のユースケースと業界での導入

いくつかの大手企業は、安全性と信頼性を向上させるために、すでに NeMo ガードレールを AI ワークフローに組み込んでいます。ホームセンターの小売店である Lowe’s は、これらのツールを使用して顧客とのやり取りを改善し、AI が生成する応答の正確性を確保しています。

自動車 AI のリーダーである Cerence AI は、マイクロサービスを活用して電力を供給しています。車載アシスタント技術。「NeMo ガードレールは、信頼できる、思いやりのある、幻覚のない応答を提供し、有害な出力からモデルを保護するのに役立ちます」と、Cerence AI の製品およびテクノロジー担当エグゼクティブ バイス プレジデントの Nils Schanz 氏は説明しました。

関連: Microsoft、Nvidia GB200 の注文を削減、生産遅延の中で GB300 を優先

さらに、Amdocs や Taskus などの企業もこれらを利用しています顧客エンゲージメントとサポートのための、より安全で信頼性の高い AI システムを作成するためのツール。通信およびメディア用ソフトウェアの世界的なプロバイダーである Amdocs は、NeMo Guardrails を使用して AI 主導の顧客インタラクションを強化しています。

オープンソースの取り組みと広範な影響

開発者による AI の安全性のテストと強化をサポートするために、Nvidia は、AI を識別するためのオープンソース ツールキットである Garak を導入しました。 AI システムの脆弱性。

Garak は、プロンプト インジェクションや脱獄の試みなどの敵対的なシナリオをシミュレートし、組織が AI モデルを強化できるようにします。

開発者は、 にアクセスすることもできます。 href=”https://developer.nvidia.com/blog/how-to-safeguard-ai-agents-for-customer-service-with-nvidia-nemo-guardrails/”>詳細なチュートリアル と 参照ブループリント。これらのリソースは、カスタマー サービスのチャットボットから小売業や医療現場の自動アシスタントに至るまで、さまざまなユースケースをカバーしています。