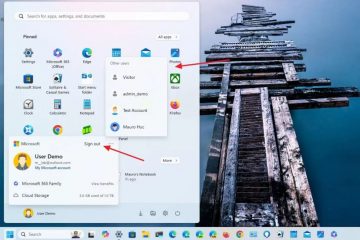

Il CEO di OpenAI, Sam Altman, ha espresso le preoccupazioni su una clausola nei documenti di uscita della società che potrebbe potenzialmente revocare il capitale acquisito. Altman ha chiarito che OpenAI non ha mai applicato questa clausola e non lo farà se i dipendenti si rifiutano di firmare accordi di separazione o di non denigrazione.

Come recentemente rivelato, OpenAI ha fatto firmare ai nuovi dipendenti accordi di non divulgazione (NDA) altamente restrittivi che impedire loro di criticare OpenAI a tempo indeterminato. Questi accordi stabiliscono inoltre che qualsiasi violazione potrebbe comportare la perdita del capitale proprio acquisito, che per molti potrebbe ammontare a milioni di dollari.

Preoccupazioni in materia di equità dei dipendenti

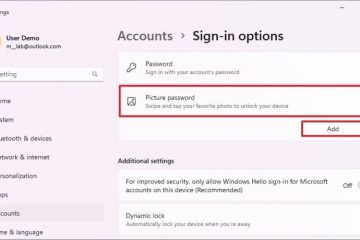

Altman, in una dichiarazione sui social media, ha sottolineato che il patrimonio acquisito rimane sicuro indipendentemente dalla firma degli accordi di separazione. Ha riconosciuto la presenza di una clausola controversa nei documenti di uscita ma ha assicurato che non è mai stata data attuazione.”Questo è colpa mia e una delle poche volte in cui mi sono sentito sinceramente imbarazzato a usare openai”, ha scritto Altman.

per quanto riguarda cose recenti su come openai gestisce il capitale:

non abbiamo mai recuperato il capitale acquisito di nessuno, né lo faremo se le persone non lo fanno firmare un accordo di separazione (o non stipulare un accordo di non denigrazione). il patrimonio acquisito è patrimonio acquisito, punto.

c’era…

— Sam Altman (@sama) 18 maggio 2024

I commenti di Altman arrivano in risposta alle recenti crescenti preoccupazioni sulla gestione dell’equità dei dipendenti da parte di OpenAI, in particolare per quanto riguarda il potenziale di equità cancellazione legata agli accordi di non denigrazione rivelati.

Reazioni del pubblico e dei media

La questione ha scatenato una discussione significativa su varie piattaforme e forum di social media. Su X (ex Twitter), utenti e giornalisti hanno messo in dubbio l’etica e la trasparenza di tali clausole. Alcuni hanno suggerito che la clausola sarebbe ancora in vigore se non fosse stato per il controllo dei media. Altri hanno chiesto a OpenAI di liberare gli ex dipendenti da questi accordi restrittivi e di consentire loro di vendere le proprie azioni.

Sono lieto che OpenAI riconosca questo come un imbarazzo, un errore e non va bene. È in loro potere porre rimedio rilasciando tutti coloro che sono stati minacciati di perdita di capitale a causa degli NDA firmati sotto questa minaccia.

— Kelsey Piper (@KelseyTuoc) 18 maggio 2024

Cultura della sicurezza e risposte della leadership

Oltre alle preoccupazioni in termini di equità, in questi giorni anche la cultura della sicurezza di OpenAI è stata messa a dura prova. Jan Leike si è dimesso dalla carica di responsabile dell’allineamento presso OpenAI e ha sollevato questioni sulla priorità dell’azienda allo sviluppo del prodotto rispetto alla sicurezza. La partenza di Leike ha suscitato risposte da parte di Altman e Greg Brockman, che hanno ribadito il loro impegno per la sicurezza e la ricerca sull’intelligenza artificiale.

Altman e Brockman hanno risposto alle critiche affermando che sono grati per il contributo di Leike e continueranno a farlo concentrarsi sulla sicurezza dell’intelligenza artificiale. Hanno riconosciuto le sfide nel percorrere il percorso verso l’intelligenza generale artificiale (AGI) e hanno sottolineato l’importanza della ricerca continua sulla sicurezza.