OpenAI sta affrontando aspre critiche da parte degli sviluppatori per la sua politica che richiede la verifica dell’identità del governo per accedere ai suoi modelli API avanzati come GPT-5.

La reazione è incentrata sul rifiuto di OpenAI di rimborsare i crediti prepagati agli utenti che non sono disposti a fornire dati personali. Gli sviluppatori si ritrovano con fondi intrappolati sulla piattaforma, impossibilitati a utilizzare i servizi per cui hanno pagato.

Mentre OpenAI cita la sicurezza come motivo del cambiamento, la sua rigida posizione di non rimborso viene definita un servizio clienti scadente. La mossa di OpenAI evidenzia una crescente tendenza del settore verso la verifica degli utenti, innescando nuovi dibattiti sulla privacy e sul futuro dell’accesso anonimo a potenti strumenti di intelligenza artificiale.

Paga prima, verifica dopo: nessun rimborso La politica suscita indignazione

Per gli sviluppatori che hanno precaricato i propri account con fondi per sperimentare modelli all’avanguardia, l’improvviso cancello di verifica è sembrato un’esca e un cambio.

Un utente su Hacker News, ha dettagliato la esperienza frustrante. Dopo aver acquistato crediti appositamente per utilizzare GPT-5, sono stati bloccati dal nuovo requisito.

“Ho accreditato crediti sul mio account API OpenAI e poi ho scoperto che dovevo sottopormi a un processo di verifica… Quindi ho chiesto un rimborso e mi è stato detto che i rimborsi sono contrari alla loro politica.”

Il rifiuto del rimborso ha lasciato allo sviluppatore crediti inutilizzabili e lo ha spinto a contestare l’addebito e passa al concorrente cinese DeepSeek.

La posizione di OpenAI è supportata dai suoi termini di servizio ufficiali. Secondo i Termini dei crediti di servizio, aggiornati l’ultima volta nel luglio 2025, la società mantiene una politica rigorosa sui fondi pagati per la sua API.

“Tutte le vendite di servizi, comprese le vendite di servizi prepagati, sono definitive. I crediti di servizio non sono rimborsabili tranne nei casi previsti dalla legge e scadono un anno dopo la data di acquisto o di emissione se non utilizzati…”

Sebbene giuridicamente chiara, la clausola è stata criticata come anti-consumatore quando abbinata con un requisito di accesso recentemente imposto che per molti non era in vigore al momento dell’acquisto.

Un altro utente di Hacker News ha commentato:”Sembra assolutamente un servizio clienti terribile e orribile non concedere rimborsi in questo caso… Cosa sta pensando OpenAI?”

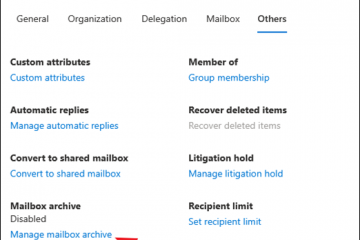

Citando la necessità di mitigare l’uso improprio, la documentazione ufficiale della guida spiega la logica dietro il nuovo ostacolo.”La verifica dell’organizzazione aiuta a prevenire usi non sicuri continuando a rendere disponibili funzionalità avanzate di intelligenza artificiale a una più ampia comunità di sviluppatori.”

Tuttavia, la politica non è stata una completa sorpresa, ma piuttosto un cambiamento strategico pianificato. L’azienda stava gettando le basi per un sistema di questo tipo già in aprile, notando che una pagina di supporto era stata aggiornata per descrivere un potenziale processo di”Organizzazione verificata”per futuri modelli avanzati.

La recente applicazione sembra essere la realizzazione di quel piano a lungo termine, sincronizzato con la più ampia disponibilità dei suoi modelli più recenti e potenti.

La fine dell’anonimato? OpenAI si unisce alla tendenza dei controlli d’identità obbligatori

Stimolando un dibattito più ampio sull’identità digitale e sulla privacy, la mossa di OpenAI è vista da molti come parte di una tendenza inquietante del settore. Richiedere che un account di sviluppo software sia collegato a un documento d’identità governativo reale colpisce al cuore il valore dell’anonimato, da lungo tempo mantenuto da Internet.

Un commentatore di Hacker News ha lamentato il passaggio da un web più pseudonimo.

“Internet era un dominio di pseudonimi e alter-ego. L’anonimato era apprezzato perché ci proteggeva da mali (allora) per lo più immaginari. Ora che quei mali sono esistono… stiamo insegnando ai bambini a rinunciare al loro anonimato.”

Il sentimento diffuso mostra che molti sviluppatori esprimono una posizione dura contro la condivisione di documenti sensibili con grandi aziende tecnologiche.

“Non avrei mai caricato una copia di documenti personali sensibili come una patente di guida o un passaporto su aziende del calibro di Google, Facebook, Microsoft, Amazon, OpenAI…”

Tali preoccupazioni non esistono infondato. Una discussione separata sullo stesso forum ha spiegato in dettaglio come Google stia ora utilizzando l’intelligenza artificiale per stimare l’età degli utenti, bloccando l’accesso ai contenuti e richiedendo patenti di guida o passaporti agli adulti contrassegnati erroneamente come minorenni.

Come ha notato un utente in quella discussione,”È un precedente preoccupante. Le leggi sulla verifica dell’età avevano lo scopo di proteggere i minori, non di obbligare ogni adulto a consegnare i documenti d’identità governativi solo per leggere i contenuti.”

Molto probabilmente, questa spinta è guidata da normative nascenti come l’AI Act dell’UE, che costringe le piattaforme a implementare preventivamente controlli più severi.

Una strategia contraddittoria: corteggiare la fiducia delle imprese mentre si aliena Sviluppatori

La dura posizione di OpenAI nei confronti dei singoli sviluppatori è in contrasto con la sua recente offensiva di fascino rivolta ai clienti delle grandi aziende e alla base di utenti più ampia. Solo nella scorsa settimana, l’azienda ha compiuto diverse mosse di alto profilo per costruire relazioni più profonde e basate sulla fiducia.

Ha acquisito l’interfaccia AI nativa per Mac Sky per integrare meglio ChatGPT nei flussi di lavoro desktop e ha lanciato”Company Knowledge”, una funzionalità progettata per connettere in modo sicuro ChatGPT con dati aziendali interni sensibili.

Entrambe le iniziative sono state basate su un messaggio di fiducia e integrazione perfetta.

Un approccio a doppio binario, ovvero rassicurare le aziende e imporre termini rigidi e non rimborsabili agli sviluppatori più piccoli, suggerisce una priorità strategica per gli account di alto valore. Allo stesso tempo, l’azienda sta effettuando ingenti investimenti di capitale per assicurarsi il suo posto come fornitore fondamentale di intelligenza artificiale.

Secondo quanto riferito, sta lavorando con Oracle su un pacchetto di debiti da record di 38 miliardi di dollari per finanziare l’espansione del suo progetto di data center”Stargate”.

In un contesto di finanziamenti così colossali, il rifiuto di rimborsare importi relativamente piccoli di crediti API appare particolarmente stonato.

Il suo tempismo segue anche un’importante spinta per consolidare la sua piattaforma come ecosistema di riferimento per lo sviluppo di intelligenza artificiale.

Dopo aver lanciato la sua API GPT-5 ad agosto, l’azienda ha organizzato un Dev Day all’inizio di ottobre per annunciare l’accesso API per il suo potente Modello GPT-5 Pro e nuovi toolkit come AgentKit, progettati per semplificare la creazione di agenti IA.

Attirando gli sviluppatori con nuovi potenti strumenti e implementando quindi un cancello di verifica restrittivo senza una politica di rimborso flessibile, OpenAI rischia di alienare proprio la comunità di cui ha bisogno per costruire una piattaforma fiorente.