XAI di Elon Musk ha lanciato un nuovo modello di codifica AI, `Grok-Code-Fast-1`, giovedì, entrando nel mercato della codifica agente ferocemente competitiva secondo i rapporti. La startup posiziona il suo nuovo strumento come opzione”rapida ed economica”progettata per le attività degli sviluppatori di tutti i giorni, con l’obiettivo di sfidare giocatori come Openai e Microsoft secondo il suo annuncio ufficiale.

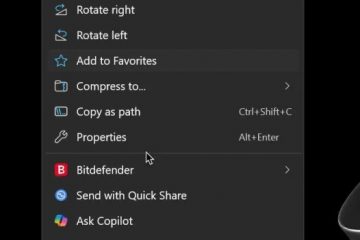

Il modello è stato rilasciato gratuitamente per un periodo limitato attraverso partner tra cui Github Copilot e Cursore. Questa mossa riscalda l’IA in corso”Guerre di riferimento”, in cui le aziende competono incessantemente per i punteggi migliori nei test di prestazione in una feroce competizione.

Questa gara si spiegano anche in modo pratico di affidabilità per i nuovi modelli, come openiws come openiws/GROWS-1-fast-1″. viene sotto un crescente controllo dalla comunità degli sviluppatori.

flussi di lavoro di codifica agente , in cui i loop iterativi di ragionamento e chiamate utensili possono diventare frustranti. Il nuovo modello è stato progettato da zero per essere un”pilota quotidiano”agile e reattivo per gli sviluppatori impegnati in questi compiti comuni.

Per raggiungere questo obiettivo, Xai afferma di aver costruito il modello da zero con una nuova architettura. Il processo di sviluppo prevedeva l’assemblaggio di un corpus pre-allenamento ricco di contenuti correlati alla programmazione e la cura di set di dati post-training di alta qualità che riflettono richieste di pull del mondo reale e attività di codifica Secondo l’annuncio ufficiale

La reattività del modello è il risultato di diverse innovazioni dai team di inferenza di Xai e supercomputer, creando un’esperienza fluida unica. Ciò è ulteriormente migliorato da pronta ottimizzazioni nella cache che raggiungono regolarmente tassi di successo superiori al 90% se utilizzati con i partner di lancio, secondo Xai.

Questa attenzione alle prestazioni è abbinata a una strategia economica aggressiva. L’azienda afferma:”La sua forza sta nel fornire forti prestazioni in un fattore di forma economico e compatto, rendendolo una scelta versatile per affrontare le attività di codifica comuni in modo rapido ed economico”. Ciò si riflette nel suo prezzo di soli $ 0,20 per milione di token di input, $ 1,50 per la produzione e $ 0,02 per gli input memorizzati nella cache, sottovalutando significativamente molti rivali in un mercato affollato.

Per guidare l’adozione, Xai sta perseguendo una vasta strategia di partenariato. Il modello, che è stato tranquillamente testato sotto il codice”Sonic”, viene offerto gratuitamente per un tempo limitato attraverso una serie di piattaforme, tra cui Github Copilot, Cursor e Windsurf. Mario Rodriguez, Chief Product Officer di GitHub, ha osservato:”Nei primi test, Grok Code Fast ha mostrato sia la sua velocità che la qualità nelle attività di codifica agente,”Segnalando la convalida del settore precoce per l’approccio di Xai.

Il Sweakes-Bench Sweaks-Bench: Supremazia nella classifica SWE-Bench, la principale valutazione del settore per gli agenti di codifica AI. La startup ha riportato un rispettabile punteggio del 70,8% sul”sottoinsieme completo di SWE-Bench-Verified”usando il proprio cablaggio di test interni, un risultato che, sebbene non da record, lo colloca saldamente nel livello superiore di un campo affollato. Ingegneria del software del mondo reale.”

L’intensa attenzione del settore su swe-Bench è per una buona ragione. A differenza dei test sintetici che misurano le capacità isolate, è una valutazione impegnativa che rispecchia la complessa realtà a più fasi dello sviluppo del software. Ogni attività è derivata da una vera questione di GitHub trovata in uno dei 12 repository di Python open source ampiamente utilizzati.

Per avere successo, un agente di intelligenza artificiale deve ragionare, pianificare e modificare correttamente il codice, spesso su più file, iterando proprio come farebbe uno sviluppatore umano, senza alcun shortcuts. Questo lo rende un vero test delle capacità di ingegneria pratica di un agente.

Il ritmo di questa competizione è diventato vertiginoso, con il titolo di”Best Coding Model”che cambia mani più volte in pochi giorni all’inizio di agosto. L’ultimo round è iniziato il 5 agosto, quando Antropic ha annunciato che il suo nuovo Claude Opus 4.1 aveva raggiunto un punteggio poi all’avanguardia del 74,5% sul punto di riferimento.

Il regno di Antropic, tuttavia, è stato notevolmente di breve durata. Solo due giorni dopo, il 7 agosto, Openai ha contrastato con il lancio del suo tanto atteso GPT-5, sostenendo che la sua nuova ammiraglia ha superato per poco il suo rivale con un tasso di successo del 74,9%, sequestrando immediatamente il primo posto.

Questa serie di annunci a fuoco rapido-Atc-Fire di annunci di stato rapido-ATT. Il campo è ulteriormente complicato dalla presenza di concorrenti più piccoli ma potenti.

AI Startup Qodo, ad esempio, si è spinto nella conversazione con il suo agente di comando, che ha registrato un formidabile punteggio del 71,2%. Questo paesaggio turbolento e affollato è l’arena in cui Xai ha ora posizionato strategicamente il suo nuovo contendente incentrato sulla velocità.

Benchmark Supremacy vs. Real World Stumpbles

Questo inseguimento di benchmark di riferimento di benching. Il lancio di GPT-5 di Openai è stato un ottimo esempio. Nonostante il suo punteggio da record, il modello è stato afflitto da una serie di bizzarri bug e errori fattuali a seguito del suo lancio.

Il contraccolpo ha spinto le scuse pubbliche dal CEO Sam Altman, che in precedenza si è vantata:”Questo è il miglior modello del mondo al codice… il miglior modello… il miglior modello… che ha ammesso che ha ammesso che è stato un modello più avanti.”Un”autoswitcher”difettoso tra le modalità interne del modello lo aveva reso per un tempo più lungo”sembra più stupido”del previsto,”incolpando un difetto tecnico per le scarse prestazioni. Questa disconnessione ha alimentato l’ampio scetticismo sul valore dei benchmark.

Xai non è estraneo a questa critica. Il suo modello precedente, Grok 4, è stato anche criticato per essere stato eccessivo ai test accademici mentre non ha avuto scenari pratici. Jimmy Lin, co-fondatore della piattaforma dell’utente-preferenza Yupp.ai, ha dichiarato senza mezzi termini:”Grok 4 è peggiore di altri modelli principali: Openai O3, Claude Opus 4 e Gemini 2.5 Pro. Grok 4 è apprezzato anche a queste dinamiche di mercato. Dare la priorità alla velocità, al costo e all’usabilità per le attività agenti, la società sta facendo una scommessa strategica che l’utilità del mondo reale alla fine importerà più per gli sviluppatori che un primo posto in una classifica dell’attuale gara dell’agente AI.

In definitiva, la strategia di Xai è una scommessa calcolata. Evitando uno scontro diretto nella parte superiore delle classifiche delle prestazioni, la società sta scommettendo che un ampio segmento del mercato degli sviluppatori darà la priorità alla velocità e ai costi per le attività agricole quotidiane sull’avere i più potenti e potenzialmente volatili disponibili.