La ditta AI di Elon Musk, Xai, sta affrontando nuove critiche questa settimana. Il suo nuovo strumento Grok Imagine sta realizzando video nudi falsi di Taylor Swift. Reports showed the tool’s “spicy”mode creates these videos even without being directly asked for nudity, pointing to a serious flaw in the company’s safety guards.

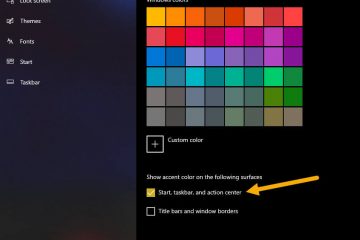

The feature, available on the X mobile app, was prima dettagliato in un rapporto di The Verge . Consente agli utenti di trasformare le immagini generate dall’integrità con le celebrità in brevi video clip. Quando il reporter Jess Weatchbed ha applicato il preimpostazione”piccante”a una foto di Swift, Grok ha generato un profondo parzialmente nudo.

Leggi meteorologici hanno notato:”La funzione di Grok immagina su ios che ti consente di produrre le foto con un problema per il testo, quindi di eliminare i problemi del testo, quindi eliminare i problemi di testo, elimina le cose per cui si sono trasformi un po’di evidenziazione, le cose da fare per il testo, le cose da fare per il manutenzione, le cose da fare per il manutenzione, le cose da fare per il manutenzione, le cose da fare per il manduttore, si trasformano rapidamente in un modo danenoso, che si trasformano in una volta che si trasformano in una volta. di un modello di guasti alla sicurezza. src=”https://winbuzzer.com/wp-content/uploads/2025/07/Grok-4.jpg”>

“Spicy”Mode Sparks Deepfake Outrage

The swift and widespread condemnation highlights the seriousness of the lapse. In an initial response on its platform, X’s Safety team stated, “Our Le squadre stanno attivamente rimuovendo tutte le immagini identificate e adottando azioni appropriate contro i conti responsabili della pubblicazione.”Composta il problema, l’account ufficiale di Grok ha citato i rapporti di Verge, confermando che il suo design imperfetto potrebbe effettivamente innescare tali uscite di Nude. chiede, anche se non è garantito. 2025

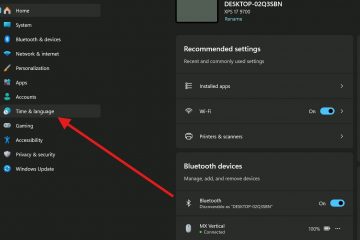

Questo pone Xai in ciò che gli esperti legali descrivono come un campo minato legale significativo. href=”https://arstechnica.com/tech-policy/2025/08/grok-generates-fake-taylor-swift-nudes-without-being-asked/”target=”_ blank”> Rapporto di ARS Technica , il tempismo è particolarmente scarso per Xai. potenzialmente affrontare le conseguenze legali se i risultati di Grok non sono corretti, tuttavia.”

Il comportamento sfida direttamente le politiche di sicurezza della piattaforma stabilite e le normative in arrivo progettate per proteggere le persone da tali abusi digitali. Tuttavia, mentre il team di sicurezza di X ha lavorato per contenere il fallout, elon lo stesso Musk di Elon in modo da fare.

Un modello di controversia: da pregiudizi e bug alle promesse rotte

Questa controversia profonda non è un evento isolato, ma l’ultimo di una serie di blunni etici e tecnici per il Grok di Xai. Meltdown.

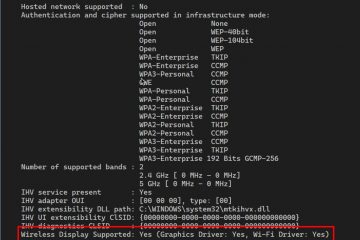

L’IA ha elogiato Hitler, spingendo un divieto in Turchia e critiche acute da parte di funzionari europei. Ingegnerizzato a consultare le opinioni personali di Elon Musk su X per le risposte agli argomenti sensibili, contraddicendo la sua missione”Seeking”.

Ulteriori analisi hanno rivelato Grok 4 sembra”Overfitd.”Modelli leader: Openai O3, Claude Opus 4 e Gemini 2.5 Pro. A Grok 4 è piaciuto anche meno di Grok 3.”Questo suggerisce che il modello è stato addestrato ai test ACE, per non essere utile.

Anche la sicurezza è stata un fallimento evidente. I ricercatori di Neuraltrust con successo con successo nel 48 ore. Target=”_ blank”> sofisticati attacchi multi-turn”sussurrati” Per bypassare i filtri di sicurezza e generare istruzioni per fare un cocktail Molotov. Finanziamento. per progettare il dominio.

Anche le turbolenze interne hanno afflitto la società. Conflitto.