I principali partner manifatturieri di Nvidia stanno accelerando la produzione dei suoi rack di server Blackwell AI di punta. Ciò segue la risoluzione di importanti questioni tecniche che in precedenza hanno ritardato le spedizioni, il Financial Times rapporti . Fornitori tra cui Foxconn, InventEc, Dell e Wistron stanno ora superando queste sfide, un passo cruciale per Nvidia per soddisfare la domanda di hardware AI globale.

La svolta è vitale per l’industria dell’IA, poiché i sistemi Blackwell sono progettati per alimentare i modelli di lingue di grandi dimensioni della prossima generazione. In precedenza, Nvidia e i suoi partner hanno affrontato molteplici problemi. Questi includevano il surriscaldamento delle GPU, le perdite in sistemi di raffreddamento liquido, bug del software e problemi di connettività inter-chip, un ingegnere di una società partner ha confermato al Financial Times. Queste battute d’arresto hanno interrotto i principali clienti come Microsoft e Google nel 2024.

La fiducia degli investitori appare sostenuta dagli sviluppi positivi. Reuters riportato Un aumento del 2,5% in pre-market di May. affermando nell’ultimo chiamata di utili Che Blackwell è”il prodotto più veloce nella nostra compagnia, nella nostra compagnia, nella nostra compagnia, nella nostra compagnia, in una noncamera della nostra compagnia.

Production Hurdles Cleared

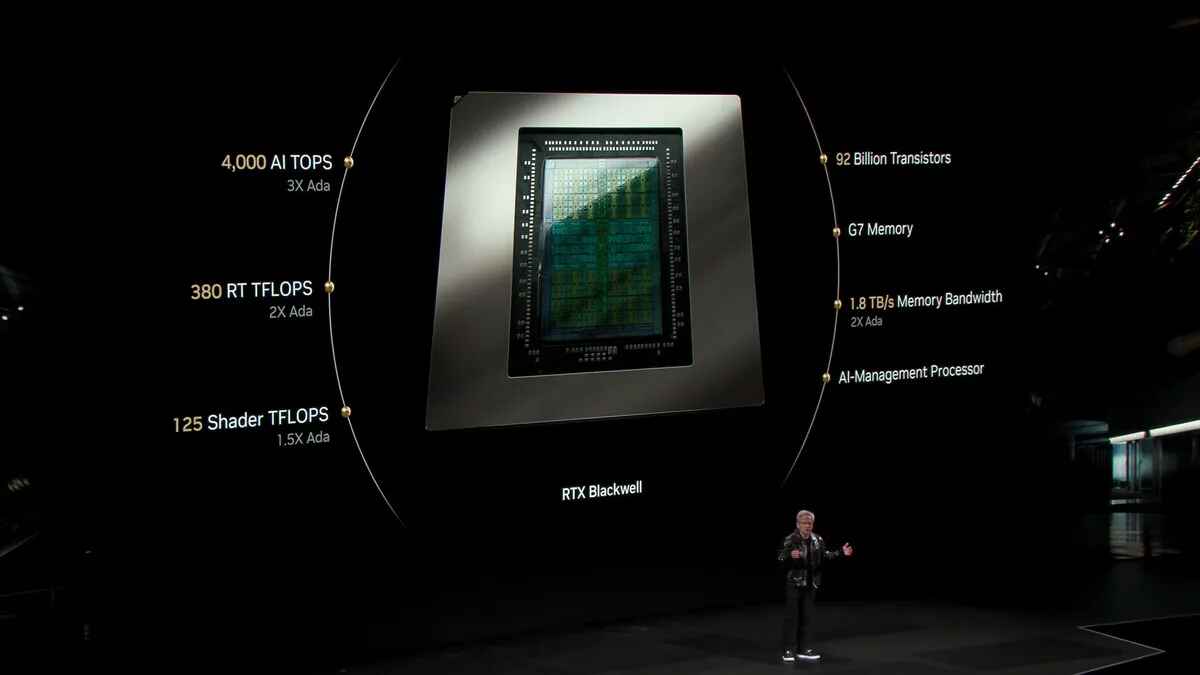

The complexity of the Blackwell Rack GB200, ciascuno integrato 36 unità di elaborazione centrale Grace e 72 unità di elaborazione grafica Blackwell tramite il sistema NVLink di NVIDIA, hanno presentato sostanziali ostacoli ingegneristici. Chu Wei-Chia, analista con sede a Taipei presso la semianalisi di consulenza, ha detto al Financial Times che la sfida tecnica era immensa, poiché nessuna società aveva precedentemente tentato di sincronizzare così tanti processori di intelligenza artificiale in un server così rapidamente. La produzione di rack aumenta.

Problemi specifici come il raffreddamento liquido erano gravi ostacoli. Mentre il raffreddamento liquido è stato un grave ostacolo, gli sforzi collaborativi di Nvidia e partner tecnologici hanno ottimizzato i processi di assemblaggio e test, portando a rese molto migliori. Questo, insieme a rese migliorate per interconnessioni ad alta velocità, è stato fondamentale.

Di conseguenza, le spedizioni dei rack GB200, che iniziano alla fine del primo trimestre del 2025, sono ora rapidamente ridimensionando. I fornitori hanno inoltre migliorato i protocolli di test prima della spedizione per garantire la funzionalità per i carichi di lavoro dell’IA, secondo il Financial Times. Le precedenti difficoltà di produzione avevano persino portato Microsoft a ridurre i suoi ordini GB200 del 40% alla fine del 2024.

Stratedi strategici e future hardware

Nvidia si sta preparando anche per il lancio del terzo trimestre della sua prossima generazione GB300 AI Rack. Questo sistema presenta funzionalità di memoria migliorate progettate per modelli di ragionamento AI più complessi.

Per accelerare la distribuzione GB300, secondo quanto riferito NVIDIA compromesso su un piano di progettazione iniziale. La società ha incaricato i partner di aprile di tornare al cosiddetto layout del consiglio di amministrazione di”Bianca”-utilizzato nella GB200-invece di un nuovo progetto chiamato”Cordelia”, a causa delle sfide di installazione, le fonti dei fornitori hanno riferito ai tempi finanziari. Secondo quanto riferito, Nvidia intende implementare la riprogettazione di Cordelia nelle successive generazioni di chip AI.

Guardando più avanti, la tabella di marcia di Nvidia condivisa a GTC 2025 include la GPU Blackwell Ultra, prevista nella seconda metà del 2025. Questa GPU è prevista per offrire 20 petafluse di AI e 288 8GB di HBM3E. L’architettura AI Vera Rubin è prevista per un lancio del 2026. La domanda di hardware così potente si estende ai nuovi clienti, con l’Arabia Saudita e gli Emirati Arabi Uniti che hanno annunciato l’intenzione di acquisire migliaia di chip Blackwell.

Il paesaggio del mercato e il controllo dell’ecosistema

Il lancio di blackwell accelerato si verificano come un mercato globale complesso. La società sta lavorando per compensare un impatto finanziario significativo dalle restrizioni del governo degli Stati Uniti sulle esportazioni del suo chip H20 in Cina. Ciò ha comportato un costo previsto per 5,5 miliardi di dollari per la società.

Analista della Bank of America Vivek Arya, citato dal Financial Times, ha suggerito che questo successo di vendite in Cina trascinerebbe i margini lordi di Nvidia, sebbene un lancio più veloce di Blackwell possa aiutare a compensare questo nella seconda metà dell’anno.

U.s. I controlli di esportazione sono stati un argomento controverso. Lo sviluppatore di AI Antropico ha sostenuto i controlli robusti, affermando che”mantenere il vantaggio di calcolo americano attraverso i controlli delle esportazioni è essenziale per la sicurezza nazionale e la prosperità economica”.

nvidia, tuttavia, ha respinto il portavoce, in qualche modo, le imprevie in qualche modo sono baby-ottanti.”Accanto alle aragoste vive.””.

In mezzo a questi dibattiti, il CEO di Nvidia Jensen Huang ha sottolineato che”la Cina è un mercato molto importante per Nvidia”, mentre la società ha anche dichiarato che”non stanno inviando alcun design GPU in Cina per essere modificata per essere rispettata con i controlli delle export”, per quanto riguarda i progetti della GPU per la Cina. Le restrizioni hanno anche alimentato i concorrenti, con l’analista Patrick Moorhead che prevede che”le aziende cinesi passano a Huawei.”

Per consolidare ulteriormente la sua posizione di mercato, Nvidia ha lanciato il suo programma NVLink Fusion presso Computex 2025. Questa iniziativa si aprirà la sua tecnologia interconnessa di proprietà ai partner. Il CEO Jensen Huang ha messo in evidenza il cambiamento fondamentale del settore, affermando che l’IA è convincente una re-architettura dei data center.

Tuttavia, ha anche scherzato durante l’evento,”Nulla mi dà più gioia di quando acquisti tutto da Nvidia”. While NVLink Fusion aims to cultivate a more adaptable AI hardware ecosystem, some analysts, like AInvest in a commentary, have raised concerns che potrebbe creare un”circuito chiuso di dipendenza”, portando potenzialmente alla monopolizzazione del mercato.

La piattaforma NVIDIA NVLink di quinta generazione, integrale di sistemi come gb300 nvl72 , fornisce 1,8 terabyte per il secondo del totale di banda per GPU.