Google DeepMind sta ampliando l’accesso al suo sandbox di AI musicale, equipaggia la piattaforma con il suo modello di generazione di musica Lyria 2 aggiornata e introducendo nuove funzionalità rivolte a musicisti, cantautori e produttori. Questa espansione posiziona la musica AI

sandbox come set di strumenti collaborativi per i creatori, che arriva poco dopo il debutto iniziale di Lyria in un’anteprima aziendale limitata e su uno sfondo di contesa in corso del settore sull’uso di materiale musicale di copyright. href=”https://deepmind.google/technologies/lyria/”target=”_ blank”> lyria 2 , che la società sostiene produce alte funzionalità di 48 khz, output audio stereo a 48 khz su diversi generi.

>

Un modello correlato, lyria realtime , consente la creazione e la manipolazione della musica interattiva al volo. Le caratteristiche chiave all’interno del sandbox includono”create”, che genera parti musicali da descrizioni di testo o testi forniti dall’utente;”Extend”, progettato per generare continue musicali da clip audio esistenti, mirate a scattare idee; e”Modifica”, che fornisce controlli per trasformare l’umore o lo stile delle clip audio usando preset o istruzioni di testo e può anche fondere sezioni diverse.

Google inquadra questo sviluppo come un’estensione del suo impegno a lungo termine con la comunità musicale, facendo riferimento al lavoro risalente al Magenta Project Nel 2016 e incorporando il feedback raccolto attraverso l’incubatore di AI Music AI di YouTube. Per ora, un accesso più ampio oltre i tester iniziali è limitato ai creatori con sede negli Stati Uniti che si iscrivono tramite a waitlist .

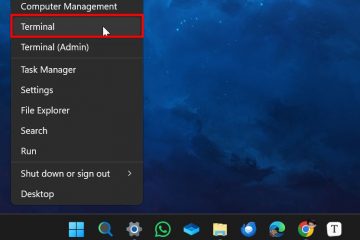

Google Music AI Sandbox (Fonte: Google)

Gli artisti coinvolti nei primi test hanno offerto reazioni iniziali positive. Isabella Kensington, artista di Tunecore, lo ha descritto come”esperienza divertente e unica”,”evidenziando la funzione”estendi”per aiutare a”formulare strade diverse per la produzione mentre fornisce spazio per il mio songwriting.”

La gamma ha notato il suo potenziale per superare il blocco dello scrittore:”Ho trovato davvero utile per aiutarmi a tagliare il blocco di Writer direttamente nel punto in cui si è impegnata a farmi costruire.”Adrie, un artista di Believe, lo ha trovato utile per sperimentare, ma ha aggiunto la prospettiva che”la musica avrà sempre bisogno di un tocco umano dietro di essa”. Sidecar Tommy ha osservato la generazione di orchestrazioni, affermandolo”mi ha dato carburante per seguire un percorso che non sarei andato!”

[contenuto incorporato] [contenuto incorporato]

navigando sul campo minato del copyright

L’espansione di Google della sua musica AI è quando la industria confonde nelle implicazioni legali della formazione di tali modelli. Nel giugno 2024, la Recording Industry Association of America (RIAA), in rappresentanza delle principali etichette, ha intentato azioni legali contro le startup musicali di AI Suno e Udio, sostenendo una violazione del copyright di massa attraverso raschiatura non autorizzata e uso di canzoni protette. Il presidente e CEO di RIAA Mitch Glazier ha dichiarato all’epoca,”Servizi senza licenza come Suno e Udio che affermano che è”giusto”copiare il lavoro di una vita di un artista… ha riposto la promessa di AI veramente innovativa per tutti noi”. Le cause ( lamentazione suno , Udio complaint) seek damages up to $150,000 per work.

Suno and Udio formally responded in August 2024, invoking the “fair use”dottrina come difesa. Udio ha sostenuto specificamente il suo sistema”ascolta”alla musica simile a uno studente umano, imparando le”idee musicali”per creare”nuove idee musicali”, sostenendo che”è completamente non interessato alla riproduzione di contenuti nel nostro set di formazione.”

la RIAA contrastato con forza , chiamando l’ammissione delle registrazioni delle registrazioni di una”grande concessione”e reiterando che usare gli artisti senza lezioni di equamente. Questo stallo legale evidenzia anche il complesso terreno che Google deve affrontare. La società sottolinea un approccio responsabile, affermando che le uscite di Lyria 2 sono filigranee utilizzando la sua tecnologia sintetica.

Synthid, ora ampliato oltre l’audio, incorpora un segnale digitale impercettibile direttamente nello spettrogramma della forma d’onda audio, progettata per sopravvivere a modifiche comuni come la compressione mp3, potenzialmente aiuta a tracciare l’origine del audio generato. Tuttavia, come molti sviluppatori di intelligenza artificiale in esame, Google non ha dettagliato i set di dati specifici utilizzati per la formazione di Lyria.

Parte di una più ampia push di AI Media

La più ampia disponibilità della musica AI Sandbox segue l’inizio di Lyria all’inizio di aprile 2025 sulla piattaforma di AI vertice di Google, che serve come Platform Ai di apprendimento delle imprese di Google Cloud. Strumenti come il sandbox per i singoli creatori, possibilmente incanalati attraverso piattaforme come Google’s AI Studio . Lyria si unisce ad altri modelli di media generativi di Google recentemente aggiornati o introdotti, incluso il generatore di video Veo 2, il modello audio CHIRP 3 (con caratteristiche di clonazione vocale) e il generatore di immagini Imagen 3, tutti mirati a migliorare gli utensili di Vertex AI. Stabilità della concorrenza AI ha rilasciato Audio 2.0 stabile nell’aprile 2024, fornendo accesso al web gratuito per la generazione di tracce fino a tre minuti e consente agli utenti di caricare i propri campioni di audio per la trasformazione ai-una funzionalità simile a una funzionalità di slaccia di slaybox”.

Stabilità AI ha collaborato con Audible Magic per controlli sul copyright. Al contrario, Nvidia ha annunciato il suo modello audio Fugatto nel novembre 2024, ma ha scelto di non rilasciarlo pubblicamente a causa delle potenziali preoccupazioni per l’uso improprio.”Qualsiasi tecnologia generativa comporta sempre alcuni rischi, perché le persone potrebbero usarlo per generare cose che preferiremmo no”, ha detto Bryan Catanzaro di Nvidia. Mentre alcuni creatori visualizzano strumenti come la musica di Ai Sandbox come aumento dell’abilità umana, altri si preoccupano dello sfollamento della creatività umana, facendo eco a

La facilità di generazione solleva anche domande sulla potenziale svalutazione della musica, ricordando una previsione di David Bowie che la musica potrebbe diventare come”acqua di corsa o elettricità”La qualità percepita e l’autenticità della musica di intelligenza artificiale contro la creazione umana rimangono punti di discussione man mano che la tecnologia avanza.