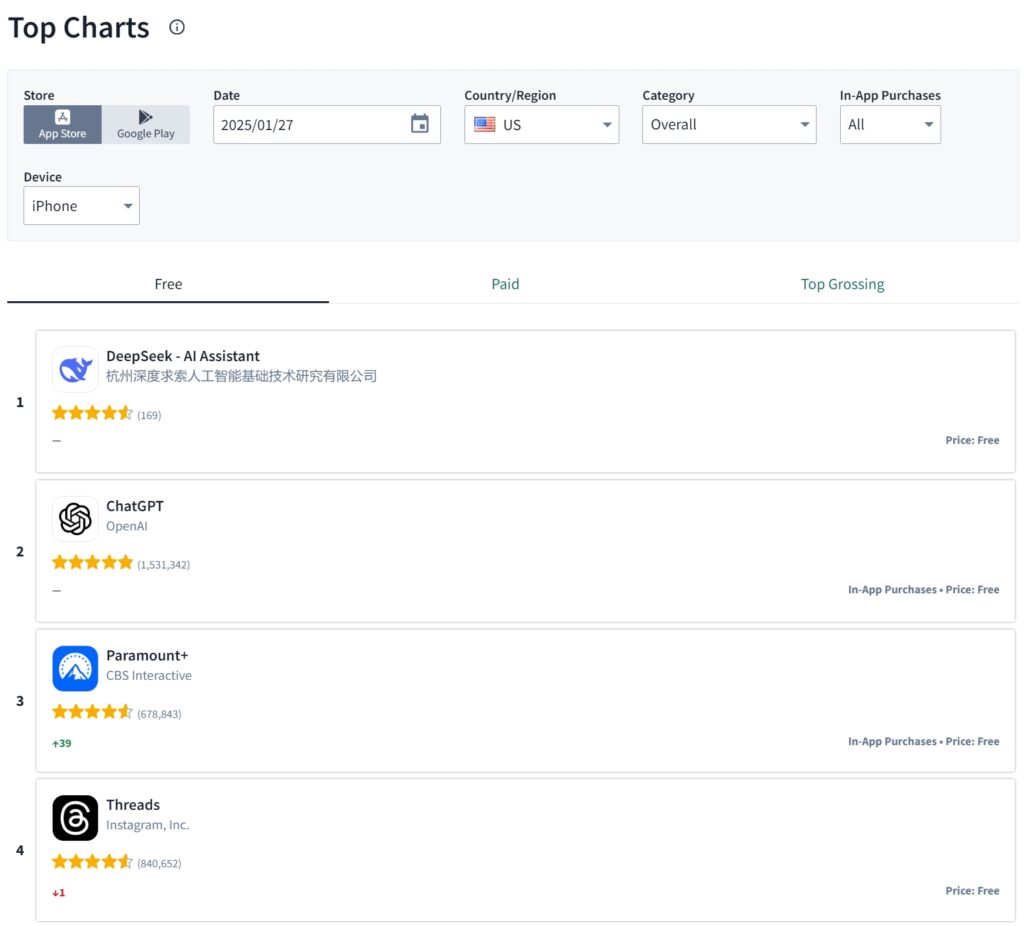

DeepSeek, una startup cinese di intelligenza artificiale, ha conquistato il primo posto nell’App Store statunitense di Apple lo scorso fine settimana, superando ChatGPT di OpenAI nei download.

Questo traguardo arriva dopo il rilascio, il 20 gennaio, del modello di ragionamento di punta di DeepSeek, R1, che ha rapidamente ottenuto riconoscimenti per la sua capacità di rivaleggiare con i sistemi di intelligenza artificiale avanzati operando con una frazione delle risorse normalmente richieste.

Fonte: Sensor Tower

Fonte: Sensor Tower

DeepSeek R1 offre prestazioni all’avanguardia, pur essendo allo stesso tempo censurato secondo le regole del PCC.

La rapida ascesa dell’app basata su R1 riflette l’ingegneria innovativa e l’uso strategico di DeepSeek delle GPU Nvidia H800, la cui esportazione in Cina è limitata a causa delle sanzioni statunitensi.

Correlato: Perché le sanzioni statunitensi potrebbero avere difficoltà a frenare la crescita tecnologica della Cina

Sviluppando metodi di formazione efficienti, l’azienda con sede a Hangzhou ha dimostrato che il progresso dell’intelligenza artificiale è possibile anche in presenza di vincoli geopolitici. Questo sviluppo mette in discussione la percezione del dominio degli Stati Uniti nel campo dell’intelligenza artificiale e solleva interrogativi sull’efficacia delle restrizioni all’esportazione volte a frenare le capacità tecnologiche della Cina.

Costruire un’intelligenza artificiale sotto restrizioni: un approccio pieno di risorse

Il modello R1 di DeepSeek è stato addestrato utilizzando solo 2.048 GPU Nvidia H800 per un costo totale inferiore a 6 milioni di dollari, secondo un documento di ricerca pubblicato dall’azienda a dicembre 2024.

Queste GPU sono versioni intenzionalmente limitate dei chip H100 utilizzati da aziende statunitensi come OpenAI e Meta. Nonostante le limitazioni hardware, gli ingegneri di DeepSeek hanno sviluppato nuove tecniche di ottimizzazione che hanno consentito a R1 di ottenere risultati paragonabili a modelli addestrati su infrastrutture molto più potenti.

Il fondatore Liang Wenfeng, ex gestore di hedge fund, ha spiegato l’approccio dell’azienda durante un intervista con 36Kr.”Dobbiamo consumare quattro volte più potenza di calcolo per ottenere lo stesso effetto,”

Correlato: DeepSeek AI Open Sources VL2 Series of Vision Language Models

Liang ha detto: “Ciò che dobbiamo fare è ridurre continuamente queste lacune”. La lungimiranza di Liang nell’accumulare scorte di GPU Nvidia prima che entrassero in vigore le restrizioni statunitensi è stata un fattore critico nella capacità dell’azienda di innovare in circostanze difficili.

Gli ingegneri di DeepSeek si sono concentrati anche sulla riduzione dell’utilizzo della memoria e del sovraccarico computazionale, consentendo un’elevata precisione nonostante i vincoli hardware. Dimitris Papailiopoulos, ricercatore principale presso il laboratorio AI Frontiers di Microsoft, ha evidenziato l’efficienza del design di R1.

“Hanno mirato a risposte precise piuttosto che a dettagliare ogni passaggio logico, riducendo significativamente i tempi di elaborazione mantenendo un elevato livello di efficacia”, ha dichiarato al MIT Technology Review.

Prestazioni Benchmark e riconoscimenti del settore

Le prestazioni di R1 sono state particolarmente elevate sui benchmark tecnici, ottenendo punteggi del 97,3% su MATH-500 e del 79,8% su AIME 2024. Questi risultati collocano R1 accanto alla serie o1 di OpenAI, dimostrando che il modello efficiente in termini di risorse di DeepSeek può competere con i leader del settore.

Oltre al suo modello di punta, DeepSeek ha anche rilasciato versioni più piccole di R1 in grado di funzionare su consumer-hardware di livello superiore. Questa accessibilità ha ampliato l’attrattiva del modello tra sviluppatori, educatori e hobbisti. Sui social media, gli utenti hanno condiviso esempi di R1 che gestisce attività complesse come sviluppo web, codifica e matematica avanzata risoluzione dei problemi.

Correlati: Mistral AI debutta con Pixtral 12B per l’elaborazione di testo e immagini

I risultati di DeepSeek hanno ricevuto elogi da figure di spicco nel campo dell’intelligenza artificiale. Yann LeCun, capo scienziato AI di Meta, ha sottolineato il ruolo della collaborazione open source nel successo di DeepSeek.”DeepSeek ha tratto profitto dalla ricerca aperta e dall’open source (ad esempio, PyTorch e Llama di Meta). Hanno avuto nuove idee e le hanno costruite basandosi sul lavoro di altre persone.”ha scritto LeCun su LinkedIn. Poiché il loro lavoro è pubblicato e open source, tutti possono trarne profitto. Questo è il potere della ricerca aperta e dell’open source.”

Allo stesso modo, Marc Andreessen, co-fondatore di Andreessen Horowitz, ha descritto R1 come”una delle scoperte più sorprendenti che abbia mai visto”. Queste conferme evidenziano l’impatto globale dell’approccio pieno di risorse di DeepSeek all’intelligenza artificiale sviluppo.

Convenienza ed etica open source

A differenza delle piattaforme proprietarie come ChatGPT di OpenAI, DeepSeek ha abbracciato una filosofia open source che l’azienda ha creato i pesi del modello R1, le ricette di formazione e la documentazione sono disponibili al pubblico, consentendo agli sviluppatori di tutto il mondo di replicare o sviluppare il suo lavoro. Questa trasparenza ha contraddistinto DeepSeek in un settore spesso caratterizzato dalla segretezza.

Anche la convenienza è stata un fattore chiave della popolarità di R1. L’uso dell’app è gratuito e l’accesso all’API ha un prezzo notevolmente inferiore rispetto alle offerte della concorrenza. Queste strategie di prezzo, combinate con le solide capacità del modello, hanno reso DeepSeek un’opzione interessante sia per i privati che per le aziende.

Correlato: LLaMA AI Under Fire – What Meta Isn’t Telling Tu sui modelli”Open Source”

Implicazioni geopolitiche del successo di DeepSeek

L’ascesa di DeepSeek arriva in un momento di maggiore tensioni geopolitiche tra Stati Uniti e Cina, in particolare nel campo dell’intelligenza artificiale.

Dal 2021, l’amministrazione Biden ha ampliato le restrizioni sull’esportazione di chip avanzati verso la Cina, con l’obiettivo di limitare la capacità di sviluppo del Paese. tecnologie di intelligenza artificiale competitive Tuttavia, i risultati di DeepSeek suggeriscono che tali misure potrebbero non impedire completamente l’innovazione.

Il successo dell’azienda ha stimolato dibattiti all’interno dei circoli tecnologici statunitensi sulle conseguenze indesiderate dell’esportazione. Alcuni dirigenti sostengono che queste restrizioni potrebbero stimolare l’innovazione tra le aziende cinesi. La strategia di Liang di accumulare GPU e concentrarsi sull’efficienza ha dimostrato che i vincoli possono stimolare la risoluzione creativa dei problemi anziché soffocarla del tutto.

Correlato: Le nuove regole statunitensi sull’esportazione di chip IA affrontano la reazione negativa del settore di Nvidia e altri

Un movimento più ampio nell’intelligenza artificiale cinese

L’approccio open source di DeepSeek si allinea con una tendenza più ampia nell’intelligenza artificiale cinese settore. Anche altre aziende, tra cui Alibaba Cloud e 01.AI di Kai-Fu Lee, hanno dato priorità alle iniziative open source negli ultimi anni. Liang ha descritto la necessità di affrontare quello che definisce un”divario di efficienza”tra le iniziative di intelligenza artificiale cinesi e occidentali, spiegando che le aziende locali spesso richiedono il doppio delle risorse per ottenere risultati comparabili.

Correlati: Alibaba Qwen rilascia l’anteprima del modello AI di ragionamento multimodale QVQ-72B

Nel luglio 2024, Liang ha dichiarato:”Stimiamo che i migliori modelli nazionali ed esteri possano presentare un divario pari a una volta nella struttura del modello e formazione Solo per questo motivo, per ottenere lo stesso effetto dobbiamo consumare il doppio della potenza di calcolo. Inoltre, potrebbe esserci anche un divario pari a una volta nell’efficienza dei dati, ovvero dovremmo consumare il doppio della formazione dati e potenza di calcolo per ottenere lo stesso effetto. Insieme, dobbiamo consumare quattro volte più potenza di calcolo. Ciò che dobbiamo fare è ridurre costantemente queste lacune.”

La sua leadership ha guadagnato il riconoscimento di DeepSeek sia in Cina che a livello internazionale. Nel 2024, è stato invitato a riunioni di alto livello con funzionari cinesi per discutere le strategie per far avanzare le capacità di intelligenza artificiale del Paese.

Sfide e opportunità future

As DeepSeek continua a perfezionare i suoi modelli, l’azienda deve affrontare sia opportunità che sfide. Sebbene i risultati ottenuti abbiano dimostrato la fattibilità di un’intelligenza artificiale efficiente in termini di risorse, rimangono dubbi sulla possibilità che tali approcci possano essere scalati per competere con i massicci investimenti di giganti della tecnologia come OpenAI e Meta.

In un post dopo il rilascio di DeepSeek R1 , Mark Zuckerberg, CEO di Meta, ha sottolineato l’importanza di investimenti su larga scala nelle infrastrutture di intelligenza artificiale, affermando: “Questo sarà un anno decisivo per l’intelligenza artificiale. Nel 2025, mi aspetto che Meta AI diventi l’assistente leader al servizio di oltre 1 miliardo di persone, Llama 4 diventerà il modello all’avanguardia e creeremo un ingegnere AI che inizierà a contribuire con quantità crescenti di codice ai nostri sforzi di ricerca e sviluppo. Per alimentare tutto ciò, Meta sta costruendo un data center da 2 GW+ così grande da coprire una parte significativa di Manhattan.

Porteremo online circa 1 GW di elaborazione nel’25 e finiremo l’anno con oltre 1,3 milioni di GPU. Quest’anno prevediamo di investire 60-65 miliardi di dollari in capex, facendo crescere significativamente anche i nostri team di intelligenza artificiale e disponiamo del capitale per continuare a investire negli anni a venire. Si tratta di uno sforzo enorme che, nei prossimi anni, stimolerà i nostri prodotti e il nostro business principali, sbloccherà innovazioni storiche ed estenderà la leadership tecnologica americana. Andiamo a costruire!”

Per ora, il successo di DeepSeek con R1 ha dimostrato che l’innovazione non è solo dominio degli attori con maggiori finanziamenti. Dando priorità all’efficienza, alla trasparenza e all’accessibilità, l’azienda ha creato un impatto duraturo sul settore globale dell’intelligenza artificiale.