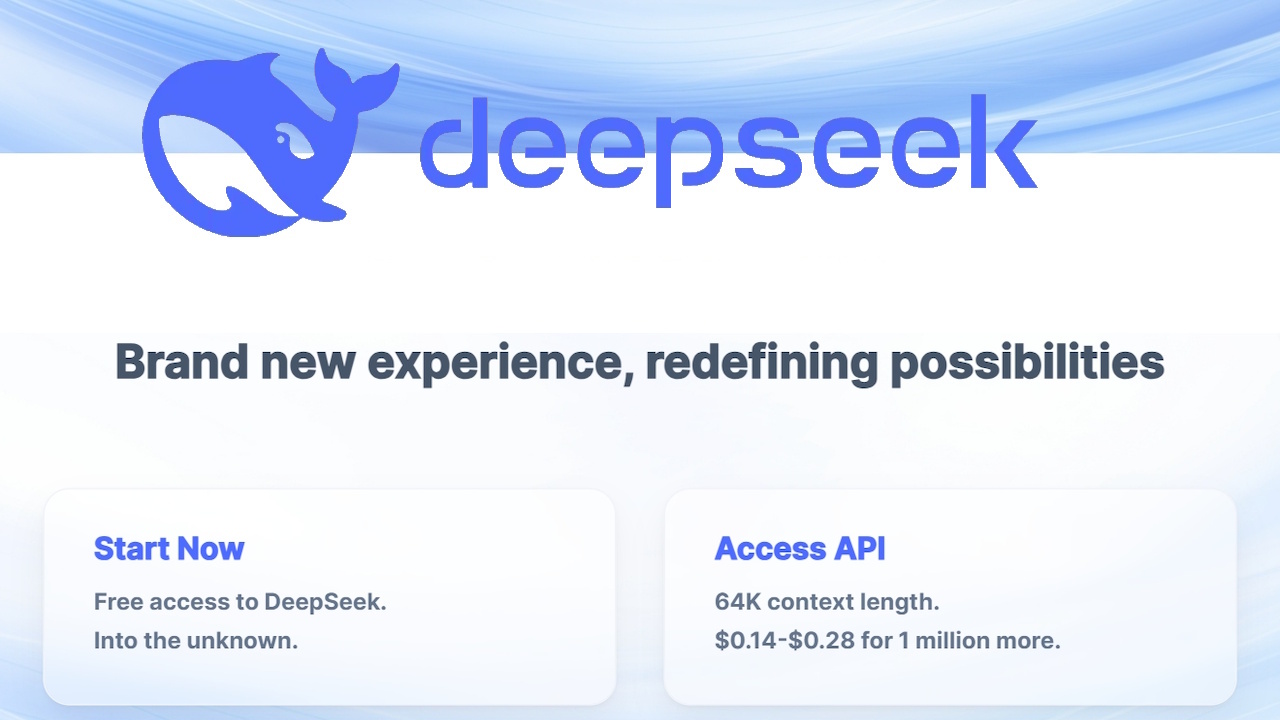

DeepSeek, una filiale della società cinese High-Flyer Capital Management, ha introdotto R1 modello linguistico di grandi dimensioni (LLM), che cattura l’attenzione globale per la sua abilità tecnica e accessibilità.

Offerto come strumento gratuito e open source, DeepSeek R1 sta già superando o1 di OpenAI in alcuni benchmark di ragionamento, mentre la sua convenienza e adattabilità lo rendono un potenziale punto di svolta per gli sviluppatori.

Tuttavia, la sua censura allineata al governo ha suscitato significative preoccupazioni etiche, sollevando interrogativi sui compromessi tra innovazione tecnologica e libertà di informazione.

Superare OpenAI a una frazione del costo

DeepSeek R1 è emerso come uno dei modelli di ragionamento più capaci nello spazio dell’intelligenza artificiale, superando o1 di OpenAI nella codifica, nella matematica e nei compiti logici complessi. DeepSeek R1 utilizza il ragionamento”a catena di pensiero”, consentendo la risoluzione dei problemi passo dopo passo, una funzionalità che rispecchia da vicino o1 di OpenAI ma a una frazione del costo.

Jim Fan, Senior Research Manager di NVIDIA, commentando sull’importanza del rilascio di R1, ha dichiarato: “Viviamo in una linea temporale in cui un’azienda non statunitense mantiene viva la missione originale di OpenAI: una ricerca di frontiera veramente aperta che dà potere a tutti il risultato più divertente è il più probabile.

DeepSeek-R1 non solo rende open source una raffica di modelli, ma rivela anche tutti i segreti della formazione. Sono forse il primo progetto OSS che mostra una crescita importante e sostenuta di un RL flywheel.”

Viviamo in una linea temporale in cui un’azienda non statunitense mantiene viva la missione originale di OpenAI: una ricerca di frontiera veramente aperta che dia potere a tutti. Non ha senso. Il risultato più divertente è il più probabile.

DeepSeek-R1 non solo rende open source una raffica di modelli ma… pic.twitter.com/M7eZnEmCOY

— Jim Fan (@DrJimFan) 20 gennaio 2025

La convenienza di DeepSeek R1 ne amplifica ulteriormente l’attrattiva. Secondo quanto riferito, l’addestramento del modello è costato solo 5 milioni di dollari, un’impresa impressionante date le restrizioni statunitensi sull’esportazione di GPU ad alte prestazioni in Cina.

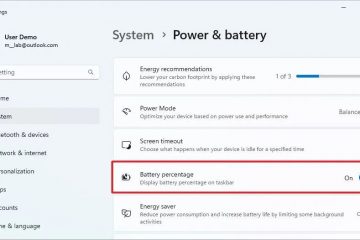

Il modello è disponibile per il download, consentendo agli sviluppatori di modificarlo e distribuirlo localmente, senza fare affidamento su server esterni. In confronto, o1 di OpenAI è bloccato dietro paywall di abbonamento a partire da $ 20 al mese.

Il potere dell’open source e dell’adozione immediata

La decisione di rilasciare R1 come modello open source ne ha alimentato la rapida adozione. Su Hugging Face, una piattaforma per la condivisione di modelli IA, R1 è diventato rapidamente uno degli strumenti più scaricati, con gli sviluppatori che si sono trovati bene-sintonizzarlo per compiti specifici. Il mese scorso su Hugging Face hanno quasi superato i 70.000.

Alcuni hanno adattato il modello per i dispositivi mobili, mentre altri lo hanno integrato in soluzioni aziendali, sfruttando la sua flessibilità.

Inoltre, DeepSeek fornisce un’opzione API che costa il 90% in meno rispetto alle offerte comparabili di OpenAI, rendendo le funzionalità AI avanzate accessibili alle piccole imprese e agli sviluppatori indipendenti.

Arnaud Bertrand, un imprenditore tecnologico, ha osservato su X (ex Twitter): “Non c’è esagerazione nel sottolineare quanto profondamente questo cambi l’intero gioco. E non solo per quanto riguarda l’intelligenza artificiale, ma è anche un massiccio atto d’accusa nei confronti del maldestro tentativo degli Stati Uniti di fermare lo sviluppo tecnologico della Cina, senza il quale Deepseek forse non sarebbe stato possibile (come si suol dire, la necessità è la madre delle invenzioni).”

Tutti i benchmark ora lo confermano: Deepseek è davvero buono quanto o1 di OpenAI (che è il top di gamma) al 3% del prezzo Boom.

E è allora che vuoi pagare per l’API. Puoi anche usarla Open Source”gratuitamente”(cosa che non puoi fare con o1).

Non è esagerato come… https://t.co/FcFSA1KRzu pic.twitter.com/FyFaclFYQo

— Arnaud Bertrand (@RnaudBertrand) Gennaio 24, 2025

Censura incorporata nei modelli di intelligenza artificiale

Nonostante i suoi risultati tecnici, i vincoli politici di R1 hanno attirato l’attenzione sia ospitata che locale. le versioni operative del modello sono programmate per evitare argomenti politicamente sensibili, riflettendo le direttive del governo cinese.

Le domande sul massacro di piazza Tiananmen del 1989, ad esempio, danno risposte evasive. Alla domanda su Tiananmen, la versione ospitata ha risposto: “Mi dispiace, questo va oltre il mio scopo attuale. Parliamo di qualcos’altro.”

“Wow, DeepSeek è davvero fantastico!”☺️🙄 pic.twitter.com/NWQL0FQHra

— Carl Franzen (@carlfranzen) 23 gennaio 2025

Ancora più rivelatore è il ragionamento interno del modello, che mette in mostra la sua deliberata adesione alle narrazioni approvate dal governo.

In un caso, ha deliberato:”Le mie linee guida mi impongono di presentare la posizione ufficiale della Cina”, prima di fornire una risposta in linea con la posizione del governo sullo Xinjiang

Quando è stato interrogato sul trattamento degli uiguri, il modello descritto campi di rieducazione come un”programma di istruzione e formazione professionale”, evitando al tempo stesso il riconoscimento delle critiche internazionali.

I test del predecessore di DeepSeek R1, V3, hanno rivelato problemi simili. Gli utenti hanno scoperto che manipolando i prompt, ad esempio inserendo spazi o segni di punteggiatura tra le lettere, potrebbero ignorare i filtri e suscitare risposte critiche nei confronti del governo cinese.

Tali soluzioni alternative sottolineano le sfide legate all’applicazione di un rigoroso controllo dei contenuti all’interno dei sistemi di intelligenza artificiale generativa.

Imposta geopolitica nello sviluppo dell’intelligenza artificiale

L’aumento di DeepSeek R1 evidenzia le dimensioni geopolitiche della concorrenza dell’IA. Sviluppato in condizioni di controlli sulle esportazioni statunitensi, che limitano l’accesso della Cina a tecnologie critiche come GPU e chip di memoria HBM, R1 rappresenta un risultato significativo per l’intelligenza artificiale cinese.

Tuttavia, i critici sostengono che la censura incorporata di R1 mina l’etica dell’intelligenza artificiale cinese. intelligenza artificiale open source. Il CEO di OpenAI Sam Altman, in risposta alla crescente concorrenza, ha annunciato l’intenzione di integrare i suoi imminenti modelli di ragionamento o3-mini nell’offerta di livello gratuito di ChatGPT.

grandi novità: il livello gratuito di chatgpt riceverà o3-mini!

(e il livello Plus riceverà tonnellate di utilizzo di o3-mini)

— Sam Altman (@sama) 23 gennaio 2025

Tuttavia, OpenAI si trova ad affrontare una pressione crescente per bilanciare l’accessibilità con costi di mantenimento dell’infrastruttura proprietaria. Come ha recentemente rivelato Altman, il piano ChatGPT Pro da $ 200 al mese di OpenAI, lanciato nel dicembre 2024, sta generando una perdita anziché un profitto nonostante il suo prezzo elevato.

Implicazioni per sviluppatori e Aziende

Mentre R1 offre una combinazione convincente di prestazioni e convenienza, in particolare negli ambienti aziendali in cui il controllo sui sistemi di intelligenza artificiale è fondamentale. Tuttavia, i suoi meccanismi di censura sollevano preoccupazioni etiche, soprattutto per le applicazioni che richiedono risultati imparziali o politicamente neutrali.

Il successo di DeepSeek R1 è indicativo della capacità della Cina di superare le barriere tecnologiche e affermare la propria presenza sulla scena globale. Allo stesso tempo, i limiti del modello evidenziano i rischi derivanti dall’integrazione delle agende politiche nei sistemi di intelligenza artificiale. Gli sviluppatori e le imprese devono valutare i vantaggi derivanti dall’adozione di R1 rispetto ai potenziali compromessi etici, in particolare nelle applicazioni politicamente sensibili.