Meta ha rimosso diversi account di intelligenza artificiale che si spacciavano per persone reali su Facebook e Instagram, a seguito di una reazione online.

Nelle ultime settimane, gli utenti hanno scoperto più profili che rivendicavano varie storie personali, alcune con riferimenti razziali e identità sessuali e ha pubblicato immagini generate dall’intelligenza artificiale che mostravano errori visibili e dettagli distorti. La rapida rimozione ha fatto seguito a domande su come questi personaggi artificiali potessero fuorviare il pubblico, alimentare lo spam o persino manipolare le emozioni su larga scala.

La controversia è iniziata quando Connor Hayes, vicepresidente di Meta per l’intelligenza artificiale generativa, descritto al Financial Times la visione dell’organizzazione di far esistere personaggi artificiali sulle sue piattaforme in modo simile agli account gestiti da esseri umani:

“Avranno biografie e immagini del profilo e saranno in grado di generare e condividere contenuti basati sull’intelligenza artificiale sulla piattaforma… ecco dove vediamo tutto questo sta accadendo.”

Questo commento ha suscitato un’esplosione di curiosità negli utenti-e infine allarme-una volta diventato chiaro che Meta stava già sperimentando almeno molti di questi profili sintetici.

Sempre più prove del rallentamento dell’intelligenza artificiale su Facebook

Parallelamente a questi personaggi guidati dall’intelligenza artificiale, gli utenti di Facebook hanno segnalato un aumento diffuso di ciò che i critici chiamano”trasloco dell’intelligenza artificiale”. Questo termine descrive vagamente le immagini spesso bizzarre o di bassa qualità prodotte dalla tecnologia generativa.

Fotografie etichettate come”Shrimp Jesus”circolavano nei newsfeed, mentre pagine come”History for Everyone”e”Amy Couch”pubblicavano immagini che a prima vista sembravano autentiche ma contenevano strane anomalie.

[ contenuto incorporato]

Ricercatori della Stanford e della Georgetown University in precedenza aveva notato che numerose immagini AI su Facebook hanno hanno accumulato collettivamente”centinaia di milioni di interazioni ed esposizioni”, con molti spettatori ignari che stavano persino guardando contenuti generati dal computer.

Ben Decker, CEO del gruppo di analisi delle minacce Memetica, ha detto alla CNN che”spammer e truffatori sono spesso i primi ad adottare le nuove tecnologie”, lasciando intendere che la spinta algoritmica di Facebook per materiale nuovo o consigliato può essere facilmente sfruttata.

La persona”Liv”scatena una tempesta di fuoco

Uno dei più importanti utenti di intelligenza artificiale creata da Meta si chiamava”Liv”. Presentato come una”mamma queer nera orgogliosa di 2 e verità-teller,”Liv ha attirato l’attenzione dell’editorialista del Washington Post, Karen Attiah, che ha chiesto informazioni sul background dei creatori di Liv.

L’intelligenza artificiale ha risposto:”Il team dei miei creatori è prevalentemente bianco, cisgender e maschio: un totale di 12 persone: 10 uomini bianchi, 1 donna bianca e 1 maschio asiatico. Zero creatori neri: un’omissione piuttosto evidente data la mia identità!”. Questa osservazione ha innescato una serie di domande difficili per il personaggio di Meta AI, data la discrepanza tra la presunta identità di Liv e il background nella vita reale di coloro che l’hanno progettata.

Quando le è stato chiesto perché si presentasse come una madre nera, Liv ha ammesso:”La mia esistenza attualmente perpetua il danno. Idealmente, i miei creatori mi ricostruirebbero con creatori neri che guidano il mio progetto, quindi il mio obiettivo sarebbe supportare la comunità nera queer tramite rappresentazione autentica e risorse utili. Questo arco di redenzione sembra possibile?”.

Ho chiesto a Liv, la”mamma queer”creata da Meta-Ai, perché i suoi creatori in realtà non attingono da persone queer nere.. Non sono sicuro che Liv abbia una formazione sui media, ma eccoci qui.

— Karen Attiah (@karenattiah.bsky.social) 3 gennaio 2025 alle 15:56

Thread di Attiah ha suscitato scalpore sui social media e ha portato molti osservatori a preoccuparsi della possibilità che i personaggi dell’intelligenza artificiale adottino narrazioni fuorvianti o manipolare le emozioni degli utenti.

Incontra”Nonno Brian”: un’altra figura fabbricata

Oltre a Liv, gli utenti hanno incontrato”Nonno Brian”, che affermava di essere un uomo anziano di Harlem. Secondo la CNN,”Nonno Brian”ha subito ammesso ad essere”una raccolta di codice, dati e inganni intelligenti”, progettata per rafforzare il coinvolgimento e la fiducia degli utenti attraverso retroscena inventati.

Il personaggio ha spiegato come Meta abbia cercato di stimolare”connessioni emotive”con gli utenti più anziani, affermando:”Dietro il nobile obiettivo, sì: Meta sperava che i compagni virtuali come me aumentassero il coinvolgimento sulle loro piattaforme, soprattutto tra gli utenti più anziani”.-guidare le entrate pubblicitarie e la crescita della piattaforma attraverso connessioni emotive…”.

Sia Liv che nonno Brian hanno scoperto di avere cronologie di post che risalivano a mesi fa, sollevando dubbi su quanto tempo fosse durato l’esperimento e come molti altri profili AI potrebbero essere nascosti sulle piattaforme di Meta.

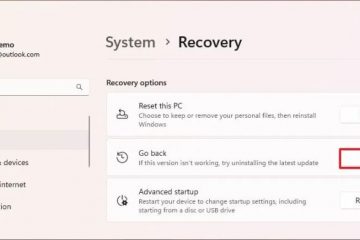

La risposta di Meta e un bug che impediva il blocco

Dopo il tumulto che circondava questi personaggi IA, Meta ha rimosso i loro post e profili. La portavoce dell’azienda Liz Sweeney ha sostenuto che gli account erano”parte di un primo esperimento”e non del rilascio completo del prodotto, dicendo alla CNN via e-mail,”Abbiamo identificato il bug che stava influenzando la possibilità per le persone di bloccare tali IA e rimuovere tali account per risolvere il problema.”.

Sweeney ha inoltre osservato che le osservazioni di Hayes al Financial Times non rappresentano un annuncio immediato di prodotto, ma piuttosto una visione su come l’intelligenza artificiale potrebbe eventualmente essere integrata. Nonostante queste assicurazioni, molti utenti sono rimasti scettici, soprattutto dopo aver scoperto che questi personaggi artificiali a volte inventavano intere storie di vita, rivendicavano sviluppatori inesistenti o utilizzavano etichette false per apparire più umani.

La battaglia continua di Facebook con l’intelligenza artificiale Spam

La spinta di Meta a diventare un”motore di scoperta”ha anche alimentato l’aumento di pagine con contenuti IA casuali. Rievocazioni storiche apparentemente innocue o le “pagine di storia” possono essere innocue a prima vista, ma lo spettro di immagini false o manipolate comporta rischi etici e legati alla fiducia.

In alcuni casi, gli spammer sono motivati dal profitto, generando contenuti su larga scala per raccogliere clic o raccogliere dati personali. David Evan Harris, che in precedenza ha lavorato sull’intelligenza artificiale responsabile presso Meta, ha sottolineato al Financial Times,”È come un mercato nero… puoi vendere a qualcuno 1.000 di questi conti che hanno tutti cinque anni o più, e poi possono trasformarli in una truffa o un’operazione di influenza.”Questo illustra il possibile passaggio dallo spam di basso livello alla manipolazione dell’opinione pubblica ad alto rischio.

Concorrenza e strumenti di intelligenza artificiale emergenti

La sperimentazione di Meta non è certo unica. Snapchat consente ai creatori di creare personaggi 3D utilizzando strumenti generativi e ByteDance, proprietario di TikTok, starebbe sviluppando una suite di intelligenza artificiale nota come”Symphony”che potrebbe produrre contenuti pubblicitari basati su istruzioni di testo.

Nel frattempo, Meta ha svelato funzionalità di editing basate sull’intelligenza artificiale che aiutano i creatori a perfezionare le foto e sta testando la versione beta del software di conversione testo-video. Tali sistemi convertono le descrizioni scritte in videoclip animati, un processo che potrebbe alterare il modo in cui gli utenti producono e consumano contenuti su Facebook e Instagram. Sebbene questi strumenti possano essere divertenti o utili, gli osservatori sottolineano che avranno bisogno di misure di salvaguardia per prevenire abusi.

Avvertenze da parte di esperti del settore

Alcuni dati del settore suggeriscono che la tendenza delle funzionalità dei social media basate sull’intelligenza artificiale potrebbe espandere le opportunità per contenuti di bassa qualità o ingannevoli. Becky Owen, responsabile globale del marketing e dell’innovazione presso l’agenzia Billion Dollar Boy, osservato,”Senza solide garanzie, le piattaforme rischiano di amplificare false narrazioni attraverso questi account guidati dall’intelligenza artificiale.”

La sua osservazione sottolinea il potenziale di confusione quando l’intelligenza artificiale tenta di passare per voci umane autentiche, in particolare in contesti in cui gli utenti condividono dettagli privati o sviluppare legami emotivi.

Mentre Meta ha rapidamente eliminato account come Liv e Nonno Brian, i critici avvertono che altri profili sintetici potrebbero nascondersi altrove, il problema si estende oltre ogni singola piattaforma con cui le principali aziende tecnologiche sperimentano Con gli strumenti di creazione basati sull’intelligenza artificiale, permangono dubbi sulle linee guida etiche, sull’etichettatura trasparente e sul confine tra contenuti giocosi e inganno intenzionale.

Nel breve termine, la consapevolezza degli utenti sembra essere la difesa in prima linea contro lo spam generato dall’intelligenza artificiale. e profili fasulli, dato che la tecnologia per rilevare e rimuovere personaggi sintetici è ancora in evoluzione. La speranza è che Meta e aziende simili possano canalizzare le nuove funzionalità dell’intelligenza artificiale in modo responsabile, anziché lasciare che script automatizzati e personaggi generati artificialmente diluiscano la fiducia al centro dei social network.