Ilya Sutskever, cofondatore di OpenAI, ha tenuto ieri una presentazione stimolante al NeurIPS 2024, offrendo una visione dell’intelligenza artificiale che unisce notevoli promesse e profonda incertezza.

NeurIPS 2024, o la trentottesima conferenza annuale sui sistemi di elaborazione delle informazioni neurali, è una delle conferenze più importanti e influenti nei settori dell’intelligenza artificiale e del machine learning. L’evento si svolgerà dal 10 al 15 dicembre 2024 presso il Vancouver Convention Centre di Vancouver, in Canada.

Durante la sua presentazione, Sutskever ha descritto l’eventuale comparsa di sistemi di intelligenza artificiale superintelligenti capaci di ragionamento, imprevedibilità, e autoconsapevolezza e i dilemmi etici che questi progressi potrebbero porre.

Ora alla guida di Safe Superintelligence Inc. (SSI) dopo la sua partenza da OpenAI a maggio, Sutskever ritiene che il semplice aumento dei modelli potrebbe non essere più la soluzione per far progredire l’intelligenza artificiale.

Parlando a un pubblico di ricercatori e leader del settore, Sutskever ha sottolineato che l’intelligenza artificiale superintelligente rappresenterebbe un cambiamento fondamentale rispetto ai sistemi odierni. Mentre l’attuale intelligenza artificiale eccelle nei compiti che richiedono il riconoscimento di schemi e l’intuizione, non è all’altezza quando si tratta di ragionamento, un processo cognitivo che richiede la comprensione e la sintesi di informazioni complesse.

“Quanto più un sistema ragiona, tanto più diventa imprevedibile”, ha spiegato Sutskever, sottolineando una sfida chiave nello sviluppo futuro dell’intelligenza artificiale.

Ha previsto che il ragionamento, l’imprevedibilità e persino il sé stesso-la consapevolezza definirà la prossima generazione di sistemi di intelligenza artificiale. A differenza dei modelli odierni, che ha descritto come”molto leggermente agentici”, i sistemi superintelligenti saranno genuinamente autonomi.

“Alla fine, prima o poi, questi sistemi diventeranno effettivamente attivi”, ha affermato, suggerendo che questo cambiamento potrebbe rimodellare radicalmente il modo in cui l’intelligenza artificiale interagisce con il mondo.

La strada verso la superintelligenza: rivisitare l’evoluzione dell’intelligenza artificiale

Per comprendere il salto verso la superintelligenza, Sutskever ha rivisitato le principali pietre miliari nello sviluppo dell’intelligenza artificiale. Ha iniziato riflettendo sui primi successi delle reti LSTM (Long Short-Term Memory), un punto fermo dell’apprendimento automatico negli anni 2000

“Gli LSTM erano essenzialmente un ResNet ruotato di 90°,”ha scherzato, riferendosi alla struttura a strati di queste reti neurali. Sebbene efficaci nel conservare informazioni sequenziali, gli LSTM hanno faticato con la scalabilità e l’efficienza, limitando la loro applicabilità a set di dati più grandi e attività più complesse.

La svolta è arrivata con Transformers, che ha sostituito gli LSTM come architettura preferita per molte IA avanzate sistemi. A differenza dei loro predecessori, i Transformer potevano elaborare grandi quantità di dati simultaneamente, consentendo progressi significativi in aree come l’elaborazione del linguaggio naturale e il riconoscimento delle immagini.

Queste innovazioni hanno aperto la strada a modelli come la serie GPT di OpenAI, che sfruttano Transformers per generare testo simile a quello umano ed eseguire attività sofisticate.

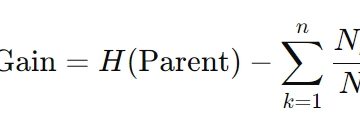

Sutskever ha attribuito gran parte di questo progresso all’adozione di leggi di scala: il principio secondo cui modelli più grandi addestrati su set di dati più grandi producono prestazioni migliori.”Se disponi di un set di dati molto grande e alleni una rete neurale molto grande, il successo è garantito”, ha affermato, sottolineando la forza trainante dietro il lavoro di OpenAI.

Tuttavia, ha avvertito che la scalabilità ha i suoi limiti:”Abbiamo raggiunto il picco dei dati. Esiste una sola Internet.”

In precedenza sostenitore dell’espansione delle dimensioni dei modelli per ottenere risultati migliori, il punto di vista di Sutskever è cambiato in seguito alla consapevolezza del settore che la scalabilità comporta una diminuzione ritorna. “Gli anni 2010 sono stati l’era del ridimensionamento, ora siamo nuovamente nell’era delle meraviglie e delle scoperte. Tutti cercano la cosa successiva”, ha osservato di recente Sutskever, sottolineando che”scalare la cosa giusta conta più che mai”.

Questo collo di bottiglia ha spinto i ricercatori a esplorare strategie alternative, compresi i dati sintetici. I dati sintetici, generati per imitare le informazioni del mondo reale, offrono un modo per addestrare i sistemi di intelligenza artificiale senza fare affidamento su set di dati di alta qualità sempre più scarsi.

Tuttavia, Sutskever ha riconosciuto che i dati sintetici comportano le proprie sfide, sottolineando:”Capire cosa significano i dati sintetici e come utilizzarli è una grande sfida.”

[contenuto incorporato]

È probabile che l’intelligenza artificiale esaurisca i dati di addestramento tra circa quattro anni giornale gli editori stanno iniziando a reprimere le modalità di utilizzo dei loro contenuti, restringendo ulteriormente l’accesso.

Costruire sistemi di ragionamento: gli ostacoli tecnici da affrontare

Uno dei temi centrali del discorso di Sutskever è stata la sfida di costruire sistemi di intelligenza artificiale capaci di reali ragionamento, come i nuovi modelli o1 di OpenAi. I modelli attuali come GPT-4o si basano su correlazioni statistiche e riconoscimento di modelli per risolvere i problemi, ma il ragionamento richiede una comprensione più sfumata del contesto, della causalità e della logica.

“Sistemi di ragionamento sono imprevedibili perché vanno oltre l’intuizione”, ha spiegato Sutskever. Questa imprevedibilità, pur essendo un segno distintivo dell’intelligenza, rende anche tali sistemi difficili da controllare e testare.

Le esigenze computazionali del ragionamento aggiungono un ulteriore livello di complessità. A differenza delle attività più semplici, che possono essere parallelizzate e ottimizzate in termini di velocità, il ragionamento coinvolge processi che richiedono l’integrazione tra più livelli di informazioni.

Questi processi consumano molte più risorse, rendendo la scalabilità un problema persistente. Sutskever ha sottolineato che risolvere queste sfide sarà fondamentale per realizzare il potenziale dell’intelligenza artificiale superintelligente.

Nonostante questi ostacoli, è rimasto ottimista riguardo alla traiettoria del settore. “Stiamo facendo tutti questi progressi. È sorprendente”, ha affermato, sottolineando la rapida evoluzione delle capacità dell’intelligenza artificiale negli ultimi dieci anni. Le sue osservazioni riflettono sia l’entusiasmo che la cautela che caratterizzano lo sviluppo dei sistemi di ragionamento.

Implicazioni etiche di IA superintelligente: diritti, coesistenza e responsabilità

Mentre Sutskever passava dai progressi tecnici alle implicazioni più ampie, ha approfondito uno degli argomenti più controversi in intelligenza artificiale: il trattamento etico dei sistemi autonomi. Ha ipotizzato che man mano che l’intelligenza artificiale superintelligente matura, potrebbe richiedere riconoscimento e coesistenza insieme all’umanità.

“Non è un brutto risultato se le IA vogliono coesistere con noi e avere diritti. ,”ha affermato, presentando una visione provocatoria dell’IA come qualcosa di più di un semplice strumento o una tecnologia.

Le osservazioni di Sutskever sono in linea con i dibattiti emergenti sulla governance e sull’etica dell’IA, in cui i ricercatori stanno sempre più prendendo in considerazione i diritti e responsabilità dei sistemi intelligenti. Anche se l’idea di concedere diritti all’intelligenza artificiale può sembrare speculativa, solleva questioni pratiche sulla responsabilità e sul libero arbitrio.

Se un sistema può ragionare, apprendere e adattarsi in modo indipendente, chi è responsabile delle sue azioni? Queste domande, ha suggerito Sutskever, evidenziano la necessità di un nuovo quadro etico su misura per le capacità dell’IA superintelligente.

Durante la sessione di domande e risposte, un membro del pubblico ha chiesto come l’umanità potrebbe incentivare l’IA ad agire in modi in linea con valori umani. La risposta di Sutskever rifletteva sia la complessità del problema sia l’incertezza intrinseca del futuro dell’intelligenza artificiale.

“Le strutture di incentivi che creiamo determineranno il modo in cui questi sistemi si evolvono”, ha affermato, ma ha subito aggiunto:”Non mi sento sicuro di rispondere a domande come questa perché le cose sono incredibilmente imprevedibili.”

La sfida delle allucinazioni e dei risultati inaffidabili

Uno degli ostacoli pratici nello sviluppo dell’intelligenza artificiale è il fenomeno delle allucinazioni, ovvero risultati imprecisi, illogici o completamente fabbricato. Sebbene gli attuali sistemi di intelligenza artificiale siano soggetti a tali errori, Sutskever sostiene che le capacità di ragionamento potrebbero ridurne significativamente la frequenza.

“È altamente plausibile che i modelli futuri correggeranno automaticamente le loro allucinazioni attraverso il ragionamento”, ha affermato, paragonando questo processo alla funzione di correzione automatica dei moderni elaboratori di testi.

Questa capacità consentirebbe ai sistemi di intelligenza artificiale di riconoscere le incoerenze nelle loro risposte e perfezionare i loro risultati in tempo reale. Ad esempio, un’intelligenza artificiale abilitata al ragionamento utilizzata nella ricerca giuridica potrebbe identificare discrepanze nelle citazioni della giurisprudenza o lacune logiche nelle risposte. argomentazioni, rendendo i suoi risultati molto più affidabili.

Tuttavia, Sutskever ha riconosciuto le difficoltà tecniche implicate nella costruzione di tali sistemi “Non sto dicendo come, e non sto dicendo quando”Sto dicendo che accadrà”, ha osservato, sottolineando l’incertezza che circonda questo sviluppo.

Regolamentazione dell’intelligenza artificiale superintelligente: lo sforzo globale

Sutskever’s le riflessioni sulla natura imprevedibile dell’intelligenza artificiale superintelligente hanno sottolineato l’urgenza dei quadri normativi. In tutto il mondo, i politici sono alle prese con come governare lo sviluppo dell’IA in modo da bilanciare innovazione e sicurezza.

L’AI Act dell’Unione Europea, ad esempio, mira a stabilire linee guida chiare per l’uso dell’IA, concentrandosi su applicazioni ad alto rischio come il riconoscimento facciale e il processo decisionale autonomo.

Negli Stati Uniti, i legislatori stanno esplorando misure simili, in particolare in settori critici come la sanità e la finanza.”Senza quadri chiari, il rapido ritmo di sviluppo potrebbe portare a conseguenze impreviste”, ha avvertito Sutskever, sottolineando l’importanza di una governance proattiva.

Anche le organizzazioni internazionali, compresa l’OCSE, hanno contribuito al panorama normativo emanando principi per un’IA affidabile. Queste iniziative mirano a garantire equità, responsabilità e trasparenza nei sistemi di intelligenza artificiale, riflettendo un consenso globale sulla necessità di supervisione.

Tuttavia, come ha sottolineato Sutskever, la sfida di regolamentare sistemi che sono intrinsecamente imprevedibili aggiunge un livello di complessità a questi sforzi.

“Le persone pensano che gli’agenti’siano il futuro”, ha affermato, riferendosi alla crescente autonomia dei sistemi avanzati di intelligenza artificiale. Garantire che questi agenti di intelligenza artificiale, come quelli della nuova piattaforma Agentspace di Google, agiscano in modo sicuro e in linea con i valori sociali richiederà non solo innovazione tecnica ma anche solidi quadri giuridici ed etici.

Preparazione per l’impatto sociale dei sistemi autonomi

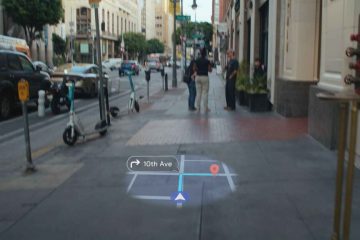

L’integrazione dell’intelligenza artificiale superintelligente nella società avrà implicazioni di vasta portata, rimodellando le industrie, la governance e persino l’identità umana. Sistemi autonomi in grado di ragionare e prendere decisioni potrebbero rivoluzionare campi come l’assistenza sanitaria, i trasporti e le scienze ambientali, offrendo vantaggi senza precedenti.

Ad esempio, la diagnostica medica basata sull’intelligenza artificiale potrebbe analizzare i dati dei pazienti con una precisione senza precedenti, consentendo rilevamento delle malattie e miglioramento dei risultati. Allo stesso modo, i veicoli autonomi dotati di capacità di ragionamento potrebbero adattarsi a scenari di traffico complessi, migliorando la sicurezza e l’efficienza.

Nelle scienze ambientali, l’intelligenza artificiale potrebbe elaborare enormi set di dati per modellare il cambiamento climatico con maggiore precisione, fornendo informazioni utili ai responsabili politici globali.

Tuttavia, i vantaggi sociali dell’intelligenza artificiale superintelligente comportano dei rischi. Man mano che questi sistemi acquisiranno autonomia, metteranno in discussione le norme esistenti di responsabilità e controllo. Chi è responsabile quando un veicolo autonomo provoca un incidente o quando un sistema medico abilitato al ragionamento fa una diagnosi errata?

Sutskever ha sottolineato che affrontare queste domande richiederà la collaborazione tra le discipline.”Dovremo fare i conti con sistemi di intelligenza artificiale che sono incredibilmente imprevedibili”, ha avvertito, sottolineando l’importanza della vigilanza man mano che queste tecnologie si evolvono.

Le implicazioni filosofiche: intelligenza, autonomia e ruolo dell’umanità

L’ascesa dell’intelligenza artificiale superintelligente pone domande profonde sull’identità umana e sulla natura dell’intelligenza. Poiché questi sistemi superano le capacità umane in termini di ragionamento, adattabilità e creatività, possono rappresentare una sfida ipotesi di lunga data su ciò che distingue l’umanità.

Sutskever ha suggerito che l’autoconsapevolezza, spesso considerata un segno distintivo della coscienza, potrebbe emergere naturalmente nei sistemi di intelligenza artificiale avanzati “Quando si ragiona, l’autoconsapevolezza diventa parte di a modello mondiale del sistema. È utile”, ha detto, lasciando intendere che tali sistemi svilupperebbero una comprensione di se stessi come entità all’interno di un ambiente più ampio.

Questo cambiamento solleva domande esistenziali. Cosa significa per gli esseri umani convivere con macchine non solo intelligenti ma anche autonome? Man mano che i sistemi di intelligenza artificiale assumono ruoli sempre più complessi nella società, potrebbero ridefinire la nostra comprensione di intelligenza e azione.

Storicamente, gli esseri umani sono stati il punto di riferimento per l’eccellenza cognitiva, ma l’avvento delle macchine ragionanti potrebbe suggerire una definizione di intelligenza più ampia e inclusiva.

Sutskever ha riconosciuto che queste domande filosofiche vanno oltre considerazioni tecniche. “È sicuramente anche impossibile prevedere il futuro. In realtà, tutto è possibile”, ha osservato, sottolineando l’incertezza che circonda l’impatto a lungo termine dell’intelligenza artificiale.

I suoi commenti riflettono una crescente consapevolezza che lo sviluppo di un’intelligenza artificiale superintelligente non è solo uno sforzo tecnologico ma anche una profonda sfida culturale e filosofica.

Reimmaginare i ruoli umani in un mondo guidato dall’intelligenza artificiale

L’integrazione dell’intelligenza artificiale superintelligente rimodellerà inevitabilmente la società strutture, dall’istruzione e l’occupazione alla governance e alla creatività. Man mano che questi sistemi assumono ruoli tradizionalmente riservati agli esseri umani, ci costringeranno a riconsiderare cosa significa contribuire in modo significativo alla società.

Ad esempio, nelle industrie creative. , i sistemi di intelligenza artificiale stanno già generando arte, musica e letteratura. Sebbene questi risultati spesso imitino la creatività umana, l’intelligenza artificiale superintelligente potrebbe ampliare i confini di ciò che è possibile, creando forme di espressione completamente nuove.

Allo stesso modo, nel campo dell’istruzione , i tutor guidati dall’intelligenza artificiale potrebbero personalizzare le esperienze di apprendimento, adattando i contenuti alle esigenze individuali in modi che gli insegnanti umani non possono fare.

Tuttavia, questi progressi sollevano anche preoccupazioni riguardo allo sfollamento e alla disuguaglianza. Se l’intelligenza artificiale superintelligente può superare gli esseri umani in un’ampia gamma di compiti, quali ruoli rimarranno unicamente umani?

Sutskever ha suggerito che l’adattabilità dell’umanità sarà messa alla prova in questa nuova era, ma si è astenuto dall’offrire risposte facili. Ha invece incoraggiato la riflessione e il dialogo, affermando:”Man mano che questi sistemi si evolvono, dovremo ripensare tutto ciò che sappiamo su lavoro, creatività e intelligenza”.

Implicazioni più ampie per l’etica e la governance

Man mano che i sistemi di intelligenza artificiale diventeranno più autonomi, metteranno alla prova le norme esistenti di responsabilità e governance. Tuttavia, Sutskever ha sottolineato l’importanza di creare strutture solide per guidare lo sviluppo e l’implementazione di sistemi superintelligenti. ha anche riconosciuto la difficoltà di regolamentare sistemi che sono intrinsecamente imprevedibili.

“L’imprevedibilità dei sistemi di ragionamento rende difficile creare regole definitive”, ha affermato, esortando ricercatori e politici a collaborare su approcci flessibili e adattivi.

Una potenziale soluzione sta nell’allineare il comportamento dell’intelligenza artificiale ai valori umani attraverso strutture di incentivi. Progettando attentamente gli obiettivi e i parametri dei sistemi autonomi, gli sviluppatori potrebbero garantire che l’intelligenza artificiale agisca in modo da avvantaggiare la società. Tuttavia, Sutskever ha ammesso che questo compito è irto di complessità.

“Non mi sento sicuro di offrire risposte definitive perché le cose sono così incredibilmente imprevedibili”, ha affermato durante la sessione di domande e risposte, riflettendo sulle sfide legate al bilanciamento dell’innovazione con considerazioni etiche.

Una nuova era per l’umanità e l’intelligenza artificiale

L’avvento dell’intelligenza artificiale superintelligente non è semplicemente una pietra miliare tecnologica; segna l’inizio di una nuova era per l’umanità poiché le macchine assumono i ruoli che erano un tempo considerato unicamente umano, ci costringeranno a confrontarci con la nostra identità e il nostro scopo.

La presentazione di Sutskever al NeurIPS 2024 è servita sia come celebrazione dei risultati dell’intelligenza artificiale sia come invito all’azione per ricercatori, politici e pubblico a impegnarsi con l’etica. e le questioni sociali che ci attendono.

“Stiamo facendo tutti questi progressi”, ha affermato, riflettendo sui rapidi progressi dell’ultimo decennio. Tuttavia, le sue parole di addio ricordano le incertezze che accompagnano questo cambiamento trasformativo:”Tutti i tipi di cose sono possibili.”