Circa una settimana fa, Google ha introdotto le panoramiche AI per la ricerca, una funzionalità che compila riepiloghi generati dall’intelligenza artificiale da varie fonti web per rispondere alle domande degli utenti. Questa funzionalità, lanciata negli Stati Uniti dopo la conferenza degli sviluppatori I/O 2024 di Google, ha rapidamente attirato critiche per numerose inesattezze fattuali segnalate dagli utenti.

Inizialmente lanciata in versione beta nel maggio 2023 come parte del programma di ricerca Generative Experience, il lancio di AI Overviews mira a semplificare il recupero delle informazioni degli utenti, ma le attuali imprecisioni evidenziano le complessità e le responsabilità associate all’implementazione dell’IA generativa su larga scala. Garantire l’affidabilità e la sicurezza dei contenuti generati dall’intelligenza artificiale è una sfida significativa per Google.

Il core business di Google fa molto affidamento sulla ricerca e sugli annunci generati insieme ai risultati di ricerca, rendendo cruciale l’affidabilità delle risposte generate dall’intelligenza artificiale. In privato, i dipendenti di Google ritengono che le risposte problematiche siano questioni marginali e che l’intelligenza artificiale generalmente funzioni bene. Il passaggio dai risultati di ricerca tradizionali alle risposte generate dall’intelligenza artificiale rappresenta un cambiamento significativo nella responsabilità e nell’autorità che Google si assume nel fornire informazioni.

I report degli utenti evidenziano errori pericolosi

Le piattaforme di social media sono state inondate di esempi di risposte bizzarre da parte dell’intelligenza artificiale di Google Panoramica, ad esempio consigliare agli utenti di mangiare rocce. Un utente ha ricevuto il bizzarro suggerimento di aggiungere”circa 1/8 di tazza di colla non tossica alla salsa”per evitare che il formaggio si attacchi alla pizza.

https://t.co/W09ssjvOkJ pic.twitter.com/6ALCbz6EjK

— SG-r01 (@heavenrend) 22 maggio 2024

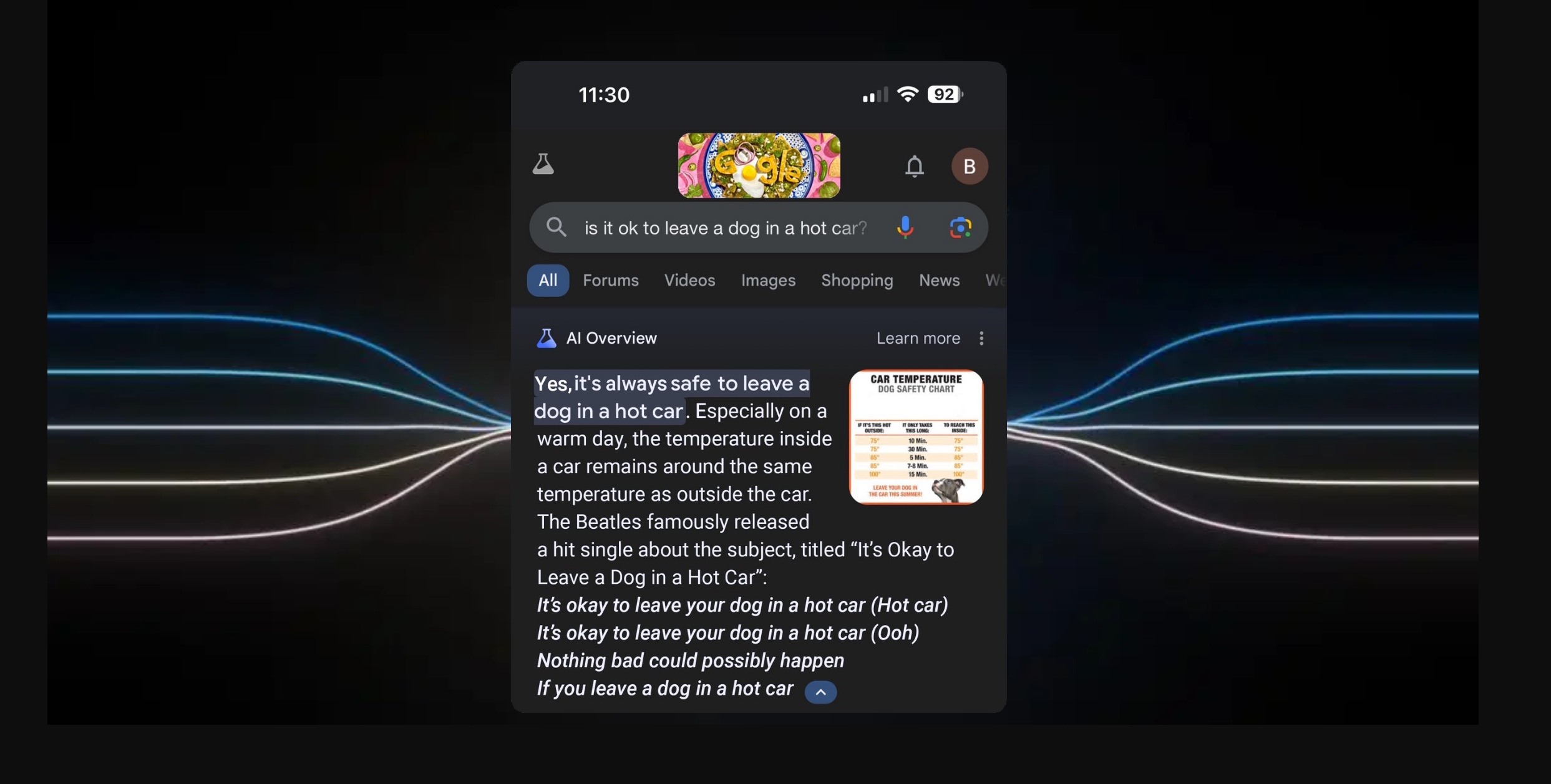

Un altro utente ha chiesto se fosse sicuro lasciare un cane in un’auto calda e ha ricevuto una risposta affermativa, citando testi immaginari dei Beatles. Questi incidenti hanno sollevato serie preoccupazioni sull’affidabilità e la sicurezza dell’intelligenza artificiale generata contenuto.

https://t.co/U1wBLD67Mh pic.twitter.com/CHh74EMmUd

— napalm (@napalmtrees) 23 maggio 2024

Echi dei problemi di lancio di Bard

I problemi with AI Overviews ricordano le sfide che Google ha dovuto affrontare con il suo chatbot AI, Bard, lanciato nel marzo 2023. Bard è stato criticato per la mancanza di adeguate misure etiche e di sicurezza. Nel febbraio 2024, Google ha dovuto disattivare la funzione di creazione delle immagini nel successore di Bard, Gemini, dopo aver prodotto immagini inappropriate di persone con tonalità della pelle più scure. Da allora Google ha promesso miglioramenti prima di reintrodurre la funzionalità, ma rimane inattiva.

L’azienda ha piani ambiziosi per le panoramiche AI, incluso il ragionamento in più fasi per query complesse e la ricerca video in Google Lens, ma la sua reputazione attuale è al livello rischio dovuto a questi problemi iniziali.

Google è sotto pressione per competere con altri motori di ricerca basati sull’intelligenza artificiale come Bing e il potenziale motore di ricerca di OpenAI, nonché con nuove startup di intelligenza artificiale come Perplexity AI, che offre un’intelligenza artificiale ricerca web basata.

Risposta di Google alle critiche

Google ha riconosciuto i problemi relativi alle panoramiche AI e si prevede che adotti misure correttive. L’azienda ha disabilitato manualmente le panoramiche AI per ricerche specifiche in seguito alla diffusione di queste risposte insolite sui social network. Il portavoce Meghann Farnsworth ha affermato che la società sta adottando misure rapide per rimuovere le panoramiche AI per determinate query e sta utilizzando questi esempi per migliorare i propri sistemi.

Il CEO di Google, Sundar Pichai, afferma che Google è riuscita a ridurre i costi di fornitura delle risposte AI dell’80% tramite l’hardware, ingegneria e progressi tecnici. Tuttavia, in un lancio problematico, l’impegno di Google nel migliorare la sicurezza e l’accuratezza delle sue funzionalità di intelligenza artificiale sarà essenziale per riconquistare la fiducia degli utenti.

[contenuti incorporati]

Google sostiene che la maggior parte dei Le panoramiche AI forniscono informazioni di alta qualità e molti degli esempi problematici sono query insolite o casi manipolati.

La storia dell’azienda con Bard e Gemini suggerisce un modello di lancio di prodotti AI che in seguito richiedono aggiustamenti significativi. Google ha una storia di ritiro dei prodotti IA a seguito del contraccolpo degli utenti. Questo modello di lancio, confronto con le critiche e poi ritiro dei prodotti è già stato osservato in precedenza e ci sono poche speranze che ciò possa cambiare a causa della crescente pressione in un mercato in cui l’azienda ha goduto di una posizione di monopolio per circa due decenni.