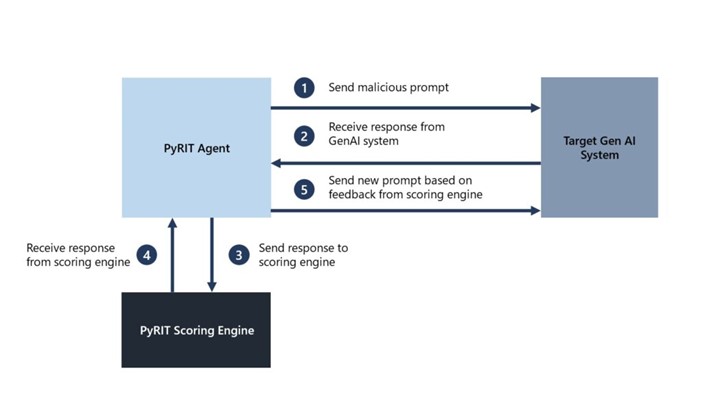

Microsoft ha ha lanciato ufficialmente PyRIT, uno strumento di sicurezza open source progettato per rafforzare la sicurezza dei sistemi di intelligenza artificiale generativa, su GitHub. Sviluppato inizialmente nel 2022 come collage di script per uso interno, PyRIT, o Python Risk Identification Toolkit, si è evoluto in uno strumento cruciale all’interno delle operazioni del Red Team AI di Microsoft. Lo strumento automatizza alcune attività del team rosso, come la generazione di richieste dannose in grandi quantità, consentendo alle organizzazioni di concentrarsi sull’identificazione e sul rafforzamento delle vulnerabilità dei propri sistemi di intelligenza artificiale.

Aspetti tecnici e componenti di PyRIT

PyRIT si distingue per il suo approccio globale al test dei sistemi di intelligenza artificiale generativa, che è nettamente diverso dai sistemi di intelligenza artificiale tradizionali o classici. Il toolkit comprende cinque caratteristiche principali, tra cui uno dei componenti più importanti è un generatore di punteggi che valuta la qualità dei risultati di un sistema di intelligenza artificiale. Questa sofisticatezza rende PyRIT particolarmente abile nel valutare”un sistema Copilot”semplificando il processo dalla definizione delle categorie dannose alla valutazione delle risposte dell’IA, trasformando settimane di lavoro in poche ore.

Differenziare le esigenze di sicurezza dell’IA generativa

L’emergere dell’intelligenza artificiale generativa ha modificato in modo significativo il panorama della sicurezza IT. Microsoft riconosce che il paradigma dell’intelligenza artificiale generativa presenta una serie unica di sfide e superfici di minaccia che non sono state affrontate in modo efficace da strumenti precedenti come Counterfit, che è stato progettato per i classici sistemi di machine learning. Di conseguenza, Microsoft ha sviluppato PyRIT con l’obiettivo di aiutare i professionisti della sicurezza nel compito articolato di red teaming di applicazioni di intelligenza artificiale generativa. L’azienda sottolinea l’importanza del coinvolgimento della comunità con lo strumento, esortando i colleghi del settore ad adottare PyRIT per i propri Esigenze di sicurezza dell’IA.

Impatto sulla comunità e invito sul settore

Il rilascio di PyRIT da parte di Microsoft nella comunità open source sottolinea la sua fiducia nel miglioramento collaborativo e nell’elevazione collettiva degli standard di sicurezza nel settore dell’intelligenza artificiale. Condividendo risorse e strumenti come PyRIT, Microsoft aspira a facilitare una più ampia comprensione e preparazione contro le minacce emergenti poste dalle tecnologie di intelligenza artificiale generativa. L’azienda incoraggia i professionisti e le organizzazioni della sicurezza a utilizzare PyRIT nelle loro operazioni, sottolineando il suo potenziale per migliorare in modo significativo l’efficacia e l’efficienza dei sistemi di intelligenza artificiale generativa red teaming.

In conclusione, PyRIT di Microsoft rappresenta un progresso significativo nel campo della sicurezza dell’intelligenza artificiale, affrontando le sfide uniche poste dai sistemi di intelligenza artificiale generativa. Attraverso la sua versione open source, Microsoft mira non solo a migliorare le proprie pratiche di sicurezza, ma anche a promuovere un ambiente più sicuro e collaborativo per lo sviluppo e l’implementazione dell’intelligenza artificiale nel settore.