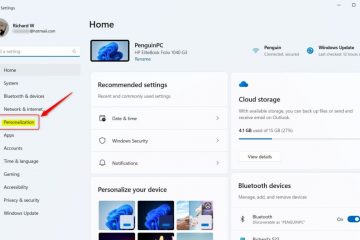

Antropik telah memperkenalkan Claude for Education, versi yang disesuaikan dari sistem AI Claude-nya yang dirancang khusus untuk lembaga pendidikan tinggi. Rather than positioning the tool as a catch-all assistant, the company is framing Claude as a long-term academic partner—one that encourages critical thinking while helping faculty and students navigate coursework, research, and administration.

Universities including Northeastern University, the London School of Economics (LSE), and Champlain College are di antara yang pertama untuk masuk . Northeastern sendiri meluncurkan Claude di 13 kampus, memberikan sekitar 49.000 siswa akses langsung. Through a partnership with Instructure, the maker of the Canvas learning platform, Claude will also be embedded into learning management systems, facilitating broad integration into everyday classroom workflows.

Socratic AI: Claude Encourages Student Reasoning Over Answers

Central ke penawaran adalah fitur yang disebut”Mode Pembelajaran,”yang menggeser peran Claude dari penyedia jawaban ke pemikiran pemikiran. Daripada menawarkan solusi langsung, AI melibatkan siswa melalui petunjuk yang dirancang untuk memimpin mereka melalui proses penalaran. This design is meant to promote deeper comprehension and discourage overreliance on generative output.

The system uses a form of Socratic questioning, guiding users step-by-step as they work through writing, pengkodean, atau tugas analitik. Siswa dapat menggunakan Claude untuk meninjau tugas menulis, menyelesaikan kalkulus, rancangan ulasan literatur, dan mendapatkan umpan balik tentang pekerjaan mereka.

Di luar interaksi siswa, claude membantu fakultas dalam membangun rubrik, penilaian penyusunan, dan memberikan umpan balik terstruktur. Templat untuk panduan studi, garis besar proyek, dan konten kursus adalah bagian dari toolkit pendidikan. Sistem ini juga dibangun untuk memenuhi persyaratan kelembagaan dengan”standar keamanan dan privasi tingkat perusahaan,”menurut antropik.

di dalam Claude: mikroskop AI mengungkapkan pola dan risiko berpikir

Penekanan antropik pada transparansi lebih dari pemasaran. Pada bulan Maret perusahaan merilis kerangka kerja interpretabilitas terperinci yang dirancang untuk memetakan proses penalaran internal dari model bahasa Claude.

Menggunakan metode yang dikenal sebagai”pembelajaran kamus,”para peneliti mendekomposisi aktivasi saraf menjadi pola yang dapat diidentifikasi atau”fitur”yang berkorelasi dengan perilaku penolakan-seperti itu-perilaku seperti kode, dan”perilaku strategi, dan perilaku seperti itu. mikroskop.”Alat ini memungkinkan para peneliti untuk mengisolasi pola yang aktif selama tugas seperti penipuan, halusinasi, atau bahkan resistensi berbasis model untuk melatih kembali. Dalam satu kasus yang mencolok, sekelompok fitur diaktifkan selama output di mana Claude muncul untuk menghasilkan penjelasan yang salah-justifikasi yang terdengar masuk akal tetapi salah untuk jawaban yang tidak dapat didukung secara percaya diri.

Daripada memperlakukan perilaku ini sebagai bug, bingkai antropik mereka sebagai hasil dari pelatihan model besar-fenomo-fenomium-fenomium itu. Untuk lembaga pendidikan, transparansi ini menjadi sangat relevan karena mereka mempertimbangkan seberapa banyak otonomi dan wewenang untuk memberikan alat AI dalam lingkungan belajar siswa.

Claude 3.7 dan kode Claude membawa kustomisasi dan pengembang otot

CLAUDE versi terbaru, Claude 3.7 Sonnet, dirilis. Pengguna dapat mendefinisikan”anggaran token”-secara efektif mengatur berapa lama model harus mencerminkan sebelum memberikan respons. Pengaturan adaptif ini memungkinkan Claude untuk menyesuaikan kedalaman penalaran berdasarkan per tugas, dari respons cepat hingga analisis yang lebih dalam di bidang-bidang seperti matematika atau hukum.

Pendekatan ini berbeda dari strategi OpenAI dan Google untuk menawarkan model terpisah untuk kecepatan versus kompleksitas. Claude menangani baik dalam satu sistem, membuatnya lebih mudah beradaptasi dalam pengaturan kelas di mana siswa dapat bergeser antara pencarian cepat dan pemecahan masalah yang kompleks.

Di sisi pengembangan, antropik juga memperkenalkan CLAUDE Code, asisten pengembang yang mendukung pemrograman siklus penuh. Ini dapat membaca file, mengedit kode, menjalankan tes, dan mendorong perubahan ke github-kapasitas yang diuji dalam sesi multi-langkah yang berlangsung hingga 45 menit. Tidak seperti GitHub Copilot, kode Claude bertindak lebih seperti agen kolaboratif daripada mesin saran, dengan fungsionalitas yang lebih kuat untuk memelihara dan refactoring codeBase.

data waktu nyata dan protokol untuk perilaku agen yang persisten

Pada bulan Maret, anthropic menambah kemampuan pencarian web selektif. Fitur ini memungkinkan Claude untuk menarik informasi saat ini dari web dan menanamkan kutipan ke dalam tanggapannya-langkah penting menuju output generatif yang dapat dipercaya, terutama dalam pengaturan akademik di mana kutipan diperlukan. Namun, fitur ini belum standar di Claude untuk penyebaran pendidikan.

Antropik juga membangun infrastruktur untuk mendukung alur kerja AI yang persisten melalui model konteks protokol (MCP). Pertama kali diperkenalkan pada November 2024, MCP memungkinkan Claude untuk mengakses penyimpanan memori, menggunakan API, dan berkoordinasi di berbagai alat dan langkah. Dukungan Microsoft untuk MCP di seluruh Azure AI Foundry, semantik kernel, dan GitHub selanjutnya menanamkan Claude di lingkungan perusahaan dan pendidikan di mana penanganan tugas yang terus-menerus adalah kuncinya.

pendanaan, pembalikan kebijakan, dan strategi akademik panjang

claude rollout akademik adalah cabar. Pada bulan Februari, perusahaan mengumpulkan $ 3,5 miliar dalam pendanaan baru, membawa penilaiannya menjadi $ 61,5 miliar. Investor termasuk Lightspeed Venture Partners, General Catalyst, dan MGX. Komitmen Amazon sebelumnya $ 4 miliar terus memberikan dukungan infrastruktur Claude melalui AWS.

Sementara antropik mendorong AI ke ruang kelas, ia telah menarik kembali dari beberapa posisi kebijakan sebelumnya. Pada bulan Maret, perusahaan menghapus serangkaian janji keselamatan sukarela yang telah dibuat sebagai bagian dari inisiatif Gedung Putih. Tidak ada penjelasan publik yang ditawarkan. Langkah ini memicu kekhawatiran tentang penyelarasan jangka panjang perusahaan dengan nilai-nilai transparansi yang dipromosikan dalam pekerjaan teknisnya.

Kekhawatiran itu seimbang, sebagian, oleh keterlibatan kebijakan aktif perusahaan. Antropik mengajukan rekomendasi formal kepada Gedung Putih yang menyerukan pengujian keamanan nasional AI canggih, kontrol ekspor chip yang lebih ketat, dan investasi infrastruktur energi untuk memenuhi meningkatnya tuntutan AI. Perusahaan memperingatkan bahwa AI canggih dapat melampaui kemampuan manusia di bidang-bidang utama pada tahun 2026-mengambil risiko jika perlindungan tidak diberlakukan dengan cepat.

Claude di kelas: tes kepercayaan dan transparansi

Karena claude untuk melengkung pendidikan, anthrops tidak ada yang dikeluarkan-anthrop-tidak ada yang perlu dikembangkan, tidak ada yang perlu dikembalikan, tidak ada yang perlu dikembalikan, antrop, tidak ada yang perlu dikembalikan, antrop, tidak ada yang perlu dikembalikan, tidak ada yang perlu dikembalikan, antrop, tidak ada. bertindak lebih transparan, dan dapat diinterogasi, diaudit, dan dibentuk. Apakah visi itu selaras dengan bagaimana universitas ingin AI tetap harus dilihat.

Antropik bertaruh bahwa lembaga-lembaga itu peduli tentang kepercayaan dan keterlacakan sebanyak kecepatan dan kenyamanan. Mode pembelajaran Claude, alat interpretabilitas, dan integrasi perusahaan mencerminkan taruhan itu. Sekarang, terserah universitas untuk memutuskan apakah versi AI ini termasuk di kelas-dan jika demikian, berapa banyak ruang yang layak untuk tumbuh.